Data Science Stack: Die perfekte Technik-Architektur für Profis

Du glaubst, ein bisschen Python und ein paar Jupyter Notebooks machen dich zum Data Scientist? Schön wär’s. Wer heute im Big-Data-Zirkus mitspielen will, braucht mehr als ein paar hippe Skripte. Der Data Science Stack ist das Rückgrat echter datengetriebener Unternehmen – und wehe, du setzt auf das falsche Pferd. In diesem Artikel zerlegen wir die moderne Data-Science-Architektur bis zur letzten Library, zerfetzen Mythen und zeigen, wie der perfekte Stack aufgebaut sein muss, wenn du wirklich skalieren willst. Bereit für die hässliche Wahrheit? Willkommen im Maschinenraum der Daten-Profis.

- Was ein Data Science Stack wirklich ist – und warum du ohne Struktur baden gehst

- Die wichtigsten Komponenten: von Datenquellen bis zu MLOps

- Warum Cloud-Infrastruktur und Container kein Luxus, sondern Pflicht sind

- Step-by-Step: Der Aufbau eines robusten Data Science Stacks für Profis

- Die besten Tools und Frameworks für jede Schicht – und welche Zeitverschwendung sind

- Wie du Skalierbarkeit, Reproduzierbarkeit und Security in den Griff bekommst

- Data Engineering vs. Data Science: Warum die Trennung im Stack entscheidend ist

- Monitoring, Deployment und MLOps: Ohne Automatisierung bist du raus

- Praxisfehler, die dich Jahre kosten – und wie du sie vermeidest

- Das Fazit: Warum dein Stack über Erfolg oder Debakel entscheidet

Der Data Science Stack ist das Fundament jeder datengetriebenen Organisation – und damit das Zentrum, um das sich alles dreht: AnalyticsAnalytics: Die Kunst, Daten in digitale Macht zu verwandeln Analytics – das klingt nach Zahlen, Diagrammen und vielleicht nach einer Prise Langeweile. Falsch gedacht! Analytics ist der Kern jeder erfolgreichen Online-Marketing-Strategie. Wer nicht misst, der irrt. Es geht um das systematische Sammeln, Auswerten und Interpretieren von Daten, um digitale Prozesse, Nutzerverhalten und Marketingmaßnahmen zu verstehen, zu optimieren und zu skalieren...., Machine LearningMachine Learning: Algorithmische Revolution oder Buzzword-Bingo? Machine Learning (auf Deutsch: Maschinelles Lernen) ist der Teilbereich der künstlichen Intelligenz (KI), bei dem Algorithmen und Modelle entwickelt werden, die aus Daten selbstständig lernen und sich verbessern können – ohne dass sie explizit programmiert werden. Klingt nach Science-Fiction, ist aber längst Alltag: Von Spamfiltern über Gesichtserkennung bis zu Produktempfehlungen basiert mehr digitale Realität..., Business Intelligence, Automatisierung und letztlich auch der Umsatz. Wer den Stack falsch baut, sabotiert sich selbst: von unsauberen Pipelines über unkontrollierte Datenquellen bis hin zu “Machine Learning-Modellen”, die im Elfenbeinturm versauern. Hier gibt’s keine Ausreden, keine halben Sachen. Der Data Science Stack ist hochkomplex, dynamisch, und nur wer die Architektur versteht, kann im Wettbewerb bestehen. Vergiss die Mär von der “All-in-one-Lösung”. Was du brauchst, ist ein modularer, wartbarer, skalierbarer Stack – und den gibt es nicht von der Stange.

Data Science Stack ist nicht gleich Data Science Stack. Die Werkzeugkiste muss sitzen: von der Datenextraktion über das Datenmanagement bis zur Modellbereitstellung und kontinuierlichen Überwachung (Stichwort: MLOps). Jede Komponente ist kritisch. Wenn du ein Glied der Kette ignorierst, reißt sie – und du stehst wieder bei Null. Dieser Artikel ist der Deep-Dive für alle, die wissen wollen, wie ein moderner Data Science Stack 2025 aussieht, was du auf keinen Fall vergessen darfst und wo die Fallstricke liegen, die dir keiner erzählt.

Was ist ein Data Science Stack – und warum entscheidet er über Sieg oder Untergang?

Ein Data Science Stack ist die komplette technische Architektur, die es ermöglicht, Daten effektiv zu sammeln, zu speichern, zu verarbeiten, zu analysieren und Modelle produktiv einzusetzen. Es handelt sich um ein hochgradig spezialisiertes Ökosystem, das weit mehr ist als eine Aneinanderreihung von Tools. Der Data Science Stack entscheidet, wie flexibel, robust und skalierbar deine Analysen und Machine-Learning-Projekte wirklich sind. Falsche Entscheidungen auf Stack-Ebene bedeuten: Inkompatibilitäten, technische Schulden, Sicherheitslücken und endlosen manuellen Aufwand.

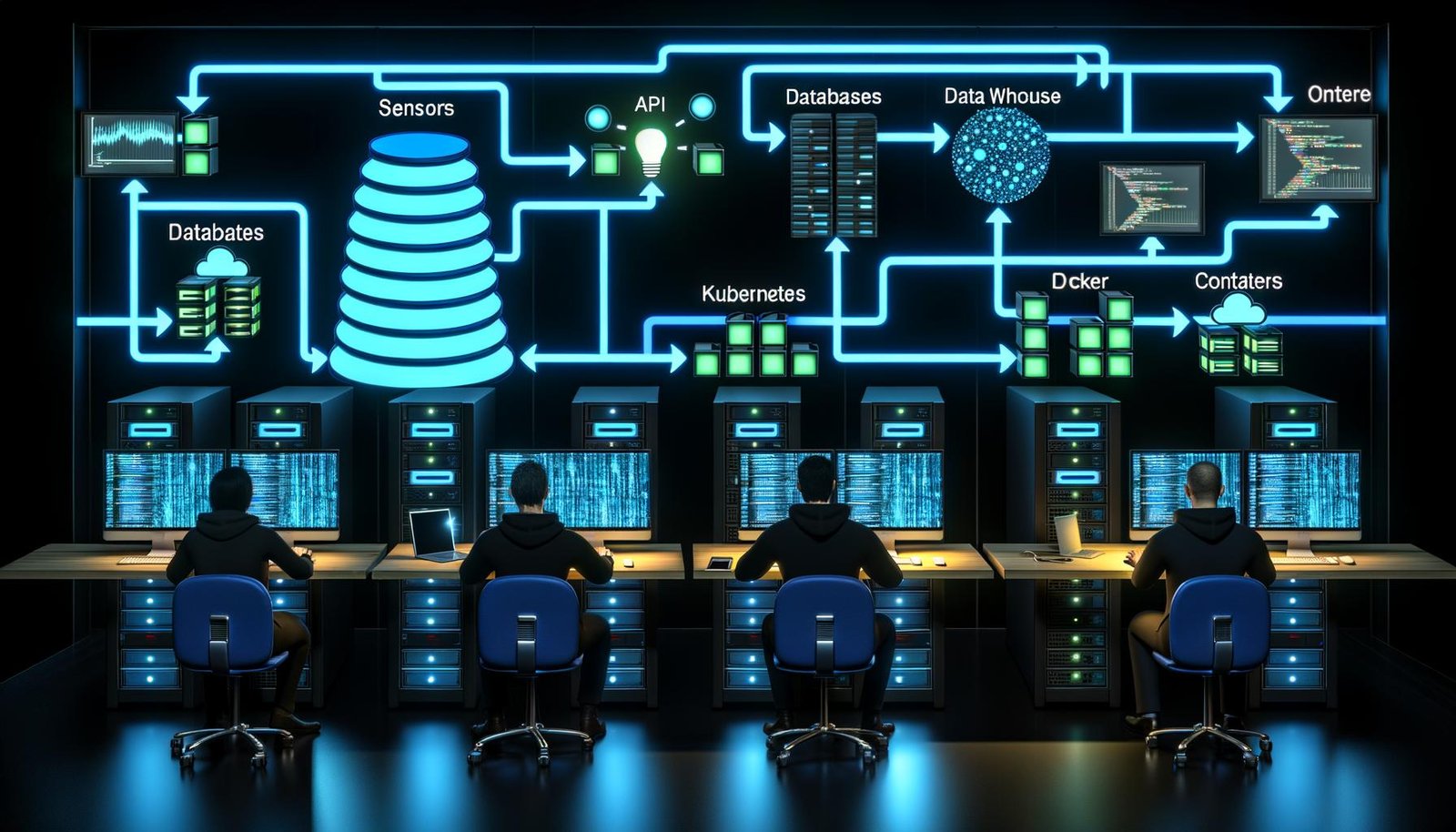

Im Zentrum steht die Pipeline: Rohdaten fließen aus diversen Quellen in den Stack, werden bereinigt, transformiert (ETL oder ELT), gespeichert, analysiert und schließlich für Machine LearningMachine Learning: Algorithmische Revolution oder Buzzword-Bingo? Machine Learning (auf Deutsch: Maschinelles Lernen) ist der Teilbereich der künstlichen Intelligenz (KI), bei dem Algorithmen und Modelle entwickelt werden, die aus Daten selbstständig lernen und sich verbessern können – ohne dass sie explizit programmiert werden. Klingt nach Science-Fiction, ist aber längst Alltag: Von Spamfiltern über Gesichtserkennung bis zu Produktempfehlungen basiert mehr digitale Realität... oder Reporting genutzt. Ohne einen konsistenten Data Science Stack ist dieser Prozess ein Flickenteppich – mit allen klassischen Problemen: inkonsistente Ergebnisse, nicht reproduzierbare Modelle, Datenchaos und hohe Ausfallwahrscheinlichkeit. Ein sauberer Stack verhindert genau das – und verschafft dir den entscheidenden Wettbewerbsvorteil.

Der perfekte Data Science Stack beginnt bei der Datenquelle und endet beim Deployment und Monitoring von Modellen. Dazwischen liegen Schichten wie Data Ingestion, Data Lake, Data Warehouse, Feature Engineering, Model Training, Model Serving und MLOps. Jede Schicht hat eigene Anforderungen, Technologien und Fallstricke. Wer hier schlampig arbeitet, zahlt später – mit Frust, technischen Sackgassen und Datenleichen im Keller. Und das ist keine Übertreibung, sondern Alltag in Unternehmen, die “irgendwie” Data Science machen.

Der Data Science Stack ist kein statisches Gebilde. Neue Technologien, Frameworks und Paradigmen tauchen ständig auf. Wer 2025 noch mit dem Stack von 2018 arbeitet, ist technisch abgehängt. Die Kunst besteht darin, einen Stack zu bauen, der modular, erweiterbar und zukunftssicher ist. Monolithische Lösungen oder proprietäre Blackboxes sind das Gegenteil von zukunftsfähig – sie sind technische Zeitbomben.

Die wichtigsten Komponenten im Data Science Stack: Von Datenquellen bis MLOps

Der Data Science Stack besteht aus klar abgegrenzten Schichten, die jeweils eine zentrale Aufgabe übernehmen. Jede Schicht benötigt spezialisierte Tools, Frameworks und Prozesse. Hier ein Überblick über die essenziellen Komponenten, die im Data Science Stack für Profis nicht fehlen dürfen:

- Datenquellen & Ingestion: APIs, Datenbanken, Streaming-Systeme (Kafka, Kinesis), Flat Files, IoT-Sensoren. Die erste Hürde: Daten sauber, sicher und automatisiert in den Stack bringen.

- Datenmanagement: Data Lake (z.B. S3, Google Cloud Storage), Data Warehouse (Snowflake, BigQuery, Redshift), Data Catalogs (Amundsen, DataHub). Ohne zentrale, versionierte Datenspeicherung wird jede Analyse zur Lotterie.

- Data Engineering Layer: ETL/ELT-Tools (Airflow, dbt, Talend), Datenbereinigung, Transformation, Feature Engineering. Hier entscheidet sich, ob deine Modelle Müll oder Mehrwert produzieren.

- AnalyticsAnalytics: Die Kunst, Daten in digitale Macht zu verwandeln Analytics – das klingt nach Zahlen, Diagrammen und vielleicht nach einer Prise Langeweile. Falsch gedacht! Analytics ist der Kern jeder erfolgreichen Online-Marketing-Strategie. Wer nicht misst, der irrt. Es geht um das systematische Sammeln, Auswerten und Interpretieren von Daten, um digitale Prozesse, Nutzerverhalten und Marketingmaßnahmen zu verstehen, zu optimieren und zu skalieren.... & Data Science Layer: Jupyter, Zeppelin, RStudio, Python (pandas, scikit-learn, TensorFlow, PyTorch), R, Julia. Das kreative Zentrum – aber nur so gut wie die darunterliegenden Schichten.

- Machine LearningMachine Learning: Algorithmische Revolution oder Buzzword-Bingo? Machine Learning (auf Deutsch: Maschinelles Lernen) ist der Teilbereich der künstlichen Intelligenz (KI), bei dem Algorithmen und Modelle entwickelt werden, die aus Daten selbstständig lernen und sich verbessern können – ohne dass sie explizit programmiert werden. Klingt nach Science-Fiction, ist aber längst Alltag: Von Spamfiltern über Gesichtserkennung bis zu Produktempfehlungen basiert mehr digitale Realität... Operations (MLOps): Model Registry, CI/CD für ML (MLflow, Kubeflow, TFX), Model Deployment (Docker, Kubernetes, Seldon, BentoML), Monitoring (Prometheus, Grafana). Hier trennt sich die Spreu vom Weizen: Nur wer Modelle automatisiert und überwacht, spielt in der Champions League.

Wer eine Schicht ignoriert, riskiert Chaos: Daten, die nicht versioniert sind, machen Modelle nicht reproduzierbar. Fehlende Automatisierung in der Pipeline sorgt für manuelle Fehler und ein Deployment, das mehr Glück als Verstand ist. MLOps ist längst kein Buzzword mehr, sondern Überlebensstrategie. Ohne ein solides MLOps-Setup versauern die besten Modelle im Notebook und verpassen jede Realität.

Ein moderner Stack muss Cloud-native sein. On-Premise-Lösungen sind für Spezialfälle okay, aber für Skalierbarkeit, Security und Kostenkontrolle führt 2025 kein Weg an AWS, Azure oder Google Cloud vorbei. Containerisierung (Docker), Orchestrierung (Kubernetes), Infrastructure as Code (Terraform, Pulumi) – das ist kein Luxus, sondern Pflicht. Wer hier spart, zahlt doppelt – mit Ausfällen, Downtimes und Explosionskosten bei jedem Wachstumsschub.

Step-by-Step: Aufbau eines robusten Data Science Stacks für Profis

Der perfekte Data Science Stack ist kein Zufallsprodukt, sondern das Ergebnis eines durchdachten, systematischen Aufbaus. Hier die wichtigsten Schritte, mit denen du deinen Stack von Grund auf richtig aufsetzt – und dabei typische Anfängerfehler vermeidest:

- Anforderungsanalyse:

- Welche Datenquellen müssen integriert werden? (APIs, Sensoren, Legacy-Systeme)

- Wie hoch ist das Datenvolumen – heute und in zwei Jahren?

- Welche Compliance- und Security-Anforderungen gibt es?

- Datenintegration & Ingestion-Architektur:

- Setze auf skalierbare Pipelines (z.B. Apache Airflow, Kafka Streams, Fivetran)

- Automatisiere Datenaufnahme und -validierung

- Datenmanagement und -speicherung:

- Nutze einen Data Lake für Rohdaten, ein Data Warehouse für strukturierte Analysen

- Implementiere Data Catalogs für Transparenz

- Data Engineering Layer:

- Setze auf dbt für Transformationen und Versionierung

- Automatisiere Feature Engineering

- AnalyticsAnalytics: Die Kunst, Daten in digitale Macht zu verwandeln Analytics – das klingt nach Zahlen, Diagrammen und vielleicht nach einer Prise Langeweile. Falsch gedacht! Analytics ist der Kern jeder erfolgreichen Online-Marketing-Strategie. Wer nicht misst, der irrt. Es geht um das systematische Sammeln, Auswerten und Interpretieren von Daten, um digitale Prozesse, Nutzerverhalten und Marketingmaßnahmen zu verstehen, zu optimieren und zu skalieren.... & Data Science Layer:

- Nutze JupyterHub oder Databricks für kollaboratives Arbeiten

- Stelle sicher, dass Umgebungen reproduzierbar sind (Conda, Docker)

- Machine LearningMachine Learning: Algorithmische Revolution oder Buzzword-Bingo? Machine Learning (auf Deutsch: Maschinelles Lernen) ist der Teilbereich der künstlichen Intelligenz (KI), bei dem Algorithmen und Modelle entwickelt werden, die aus Daten selbstständig lernen und sich verbessern können – ohne dass sie explizit programmiert werden. Klingt nach Science-Fiction, ist aber längst Alltag: Von Spamfiltern über Gesichtserkennung bis zu Produktempfehlungen basiert mehr digitale Realität... & MLOps:

- Implementiere MLflow oder Kubeflow für Modellmanagement

- Nutze CI/CD-Pipelines für automatisiertes Deployment

- Setze auf Monitoring-Frameworks, um Drift und Fehler zu erkennen

- Security & Governance:

- Rollenbasiertes Zugriffsmanagement (IAM)

- Data Lineage und Audit Trails

Jeder Schritt baut auf dem vorherigen auf. Wer mit dem Data Science Notebook beginnt, ohne die Data Pipeline zu sichern, baut auf Sand. Und wer das Deployment ignoriert, produziert Modelle, die nie das Licht der Produktivwelt sehen.

Die besten Tools, Frameworks und Libraries – und welche du vergessen kannst

Im Data Science Stack gibt es für jede Schicht unzählige Tools und Frameworks. Die Kunst besteht darin, das richtige Setup für dein Team, dein Datenvolumen und deine Use Cases zu wählen. Hier eine Übersicht der wichtigsten Technologien – und ein paar Mythen, die du getrost vergessen kannst:

- Datenaufnahme: Apache NiFi, Kafka, Fivetran, Talend. Finger weg von handgestrickten Bash-Skripten – dafür ist dein Stack zu kostbar.

- Datenmanagement: AWS S3, Google Cloud Storage, Snowflake, BigQuery, Delta Lake. Dropbox und Google Drive? Nur für Hobbyisten.

- Data Engineering: dbt, Apache Airflow, Spark. Excel-Makros sind kein Data Engineering.

- Data Science: JupyterLab, Databricks, Visual Studio Code, Python (pandas, scikit-learn, PyTorch, TensorFlow), R (tidyverse, caret), Julia. Matlab? Nett, aber in der Praxis kaum noch relevant.

- MLOps & Deployment: MLflow, Kubeflow, Seldon Core, BentoML, Docker, Kubernetes, GitLab CI/CD. Wer Modelle noch manuell deployed, hat die Kontrolle verloren.

- Monitoring: Prometheus, Grafana, Evidently AI. Ohne Monitoring keine Kontrolle – und keine Sicherheit.

Die wichtigste Erkenntnis: Weniger ist mehr. Ein zu komplexer Stack bringt Chaos. Setze auf bewährte, offene Standards, die gut dokumentiert und breit akzeptiert sind. Proprietäre Insellösungen sind nett fürs MarketingMarketing: Das Spiel mit Bedürfnissen, Aufmerksamkeit und Profit Marketing ist weit mehr als bunte Bilder, Social-Media-Posts und nervige Werbespots. Marketing ist die strategische Kunst, Bedürfnisse zu erkennen, sie gezielt zu wecken – und aus Aufmerksamkeit Profit zu schlagen. Es ist der Motor, der Unternehmen antreibt, Marken formt und Kundenverhalten manipuliert, ob subtil oder mit der Brechstange. Dieser Artikel entlarvt das..., aber ein Albtraum beim Wechsel oder bei der Integration neuer Komponenten. Und lass die Finger von Tools, die nicht aktiv weiterentwickelt werden – technische Schulden sind vorprogrammiert.

Für die ersten drei Schichten (Datenaufnahme, -management, -engineering) ist die Cloud heute Standard. Hybride Lösungen funktionieren – machen das Setup aber unnötig kompliziert. Wer nicht zwingend On-Premise muss, fährt mit einem cloud-nativen Stack am besten. Das spart Ressourcen, Kosten und Nerven.

Data Engineering vs. Data Science: Warum die Trennung im Stack entscheidend ist

Der größte Fehler in vielen Unternehmen: Data Science und Data Engineering werden vermischt, Stack-seitig und organisatorisch. Die Folge: Datenchaos, unklare Verantwortlichkeiten und Modelle, die auf wackeligen Datenfundamenten stehen. Ein sauberer Data Science Stack trennt die Verantwortlichkeiten und Technologien klar:

- Data Engineering: Verantwortlich für Datenaufnahme, Transformation, Speicherung, Data Quality und Pipeline-Automatisierung.

- Data Science: Verantwortlich für Analyse, Modellierung, Feature Engineering und Machine LearningMachine Learning: Algorithmische Revolution oder Buzzword-Bingo? Machine Learning (auf Deutsch: Maschinelles Lernen) ist der Teilbereich der künstlichen Intelligenz (KI), bei dem Algorithmen und Modelle entwickelt werden, die aus Daten selbstständig lernen und sich verbessern können – ohne dass sie explizit programmiert werden. Klingt nach Science-Fiction, ist aber längst Alltag: Von Spamfiltern über Gesichtserkennung bis zu Produktempfehlungen basiert mehr digitale Realität.... Arbeitet auf bereitgestellten, sauberen, versionierten Daten.

Technisch bedeutet das: Unterschiedliche Zugriffsrechte, unterschiedliche Entwicklungsumgebungen, andere Test- und Deployment-Prozesse. Wer Data Engineers und Data Scientists im selben Stack auf denselben Ressourcen herumfuhrwerken lässt, riskiert Datenverlust, Konflikte und endloses Debugging. Die Trennung ist kein Luxus, sondern Grundvoraussetzung für Skalierbarkeit und Sicherheit.

Auch beim Deployment trennt sich die Spreu vom Weizen: Data Engineers verantworten die produktive Pipeline, Data Scientists liefern Modelle, die in den Produktionsprozess integriert werden. Ohne klare Schnittstellen endet jeder Data Science Stack im Disaster. Die Folge: “Notebooks in Produktion”, Copy-Paste-Deployments, keine Reproduzierbarkeit und ein Security-Albtraum.

Die Zukunft ist DevOps für Daten: DataOps und MLOps. Automatisierte Pipelines, Infrastructure as Code, Version Control für Daten und Modelle – das ist keine Kür, sondern Pflicht. Und der einzige Weg, wie Data Science langfristig in Unternehmen funktionieren kann.

Monitoring, Deployment und MLOps – ohne Automatisierung bist du raus

Ein Data Science Stack ist nur dann robust, wenn er kontinuierlich überwacht, gewartet und automatisiert deployed wird. Das klingt nach Konzern, ist aber in jedem ernsthaften Projekt Pflicht. Ohne MLOps bleibt jedes Machine Learning-Modell ein Prototyp – und du als Data Scientist ein Hobbyprogrammierer mit akademischem Touch.

Monitoring ist mehr als ein paar Alerts für CPU-Auslastung. Es geht um Model Drift, Data Drift, Anomalieerkennung im Input und Output, Performance-Metriken und Echtzeit-Feedback aus dem Produktivbetrieb. Tools wie Evidently AI, Prometheus und Grafana sind Pflicht, keine Kür. Nur so erkennst du, ob deine Modelle noch valide sind oder längst Unsinn produzieren.

Deployment muss CI/CD-basiert sein. Jedes Modell, jede Pipeline, jede neue Datenquelle wird automatisiert getestet, validiert und ausgerollt. Docker, Kubernetes, GitLab oder GitHub Actions sind Standard. Wer noch manuell deployed, riskiert Ausfälle, Inkonsistenzen und – im schlimmsten Fall – katastrophale Fehlentscheidungen im Unternehmen.

MLOps ist das Bindeglied zwischen Data Science und Produktion. Es sorgt dafür, dass Modelle nicht nur gebaut, sondern auch kontinuierlich verbessert, überwacht, zurückgerollt oder neu trainiert werden können. Das ist die Basis für echten Business Value – alles andere bleibt Spielerei.

Fazit: Warum der richtige Data Science Stack über Erfolg oder Scheitern entscheidet

Der Data Science Stack ist das technische Rückgrat moderner, datengetriebener Unternehmen. Wer hier spart, experimentiert oder auf halbgare Lösungen setzt, verliert im digitalen Wettbewerb – meist schneller, als er denkt. Ein sauberer Stack ist modular, skalierbar, Cloud-native, automatisiert und klar getrennt nach Data Engineering, Data Science und MLOps. Nur so lassen sich Datenprojekte wirklich reproduzierbar, sicher und mit echtem Mehrwert betreiben.

Der perfekte Data Science Stack ist nie fertig – er lebt, wächst und passt sich an neue Herausforderungen an. Aber die Grundprinzipien sind klar: Automatisierung, Skalierbarkeit, Security und Trennung der Schichten. Wer das beherrscht, baut keine Luftschlösser, sondern echte Wertschöpfung. Alles andere ist 2025 nur noch digitales Rauschen. Und das interessiert wirklich niemanden mehr.