SEO Performance via Server Metrics clever messen und steigern

Wenn du glaubst, dass SEOSEO (Search Engine Optimization): Das Schlachtfeld der digitalen Sichtbarkeit SEO, kurz für Search Engine Optimization oder Suchmaschinenoptimierung, ist der Schlüsselbegriff für alle, die online überhaupt gefunden werden wollen. Es bezeichnet sämtliche Maßnahmen, mit denen Websites und deren Inhalte so optimiert werden, dass sie in den unbezahlten, organischen Suchergebnissen von Google, Bing und Co. möglichst weit oben erscheinen. SEO ist längst... nur noch auf KeywordsKeywords: Der Taktgeber jeder erfolgreichen Online-Marketing-Strategie Keywords sind das Herzstück jeder digitalen Sichtbarkeitsstrategie. Sie sind die Brücke zwischen dem, was Nutzer in Suchmaschinen eintippen, und den Inhalten, die Unternehmen bereitstellen. Ob SEO, SEA, Content-Marketing oder Conversion-Optimierung – ohne die richtigen Keywords läuft gar nichts. Wer denkt, Keywords seien nur ein alter SEO-Hut, hat die Entwicklung der letzten Jahre schlicht verschlafen...., BacklinksBacklinks: Der heilige Gral der Offpage-SEO – Macht, Manipulation und Mythen Backlinks sind das Rückgrat der Offpage-Suchmaschinenoptimierung – und für viele das Synonym für Autorität im Netz. Ein Backlink ist nichts anderes als ein eingehender Link von einer externen Website auf die eigene Seite. Klingt simpel? Ist es nicht. Im Kosmos der SEO sind Backlinks Vertrauensbeweis, Rankingfaktor, Manipulationsobjekt und bis... und ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... basiert, dann hast du die Rechnung ohne die Server gemacht. Denn hinter jeder guten Platzierung steckt eine unsichtbare Welt aus Server-Performance, Response-Zeiten und Infrastruktur-Metriken, die über Erfolg oder Misserfolg im Google-Ranking entscheiden. Wer hier nicht mitmischt, bleibt auf der Strecke – egal wie groß dein ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... ist oder wie clever deine KeywordsKeywords: Der Taktgeber jeder erfolgreichen Online-Marketing-Strategie Keywords sind das Herzstück jeder digitalen Sichtbarkeitsstrategie. Sie sind die Brücke zwischen dem, was Nutzer in Suchmaschinen eintippen, und den Inhalten, die Unternehmen bereitstellen. Ob SEO, SEA, Content-Marketing oder Conversion-Optimierung – ohne die richtigen Keywords läuft gar nichts. Wer denkt, Keywords seien nur ein alter SEO-Hut, hat die Entwicklung der letzten Jahre schlicht verschlafen.... gewählt sind. Zeit, den Blick unter die Motorhaube zu richten und deine Server-Metriken als echten Gamechanger zu erkennen.

- Warum Server-Metriken für SEOSEO (Search Engine Optimization): Das Schlachtfeld der digitalen Sichtbarkeit SEO, kurz für Search Engine Optimization oder Suchmaschinenoptimierung, ist der Schlüsselbegriff für alle, die online überhaupt gefunden werden wollen. Es bezeichnet sämtliche Maßnahmen, mit denen Websites und deren Inhalte so optimiert werden, dass sie in den unbezahlten, organischen Suchergebnissen von Google, Bing und Co. möglichst weit oben erscheinen. SEO ist längst... unerlässlich sind und was sie über deine Website aussagen

- Die wichtigsten Server-Performance-Indikatoren und ihre Bedeutung für das RankingRanking: Das kompromisslose Spiel um die Sichtbarkeit in Suchmaschinen Ranking bezeichnet im Online-Marketing die Platzierung einer Website oder einzelner URLs in den organischen Suchergebnissen einer Suchmaschine, typischerweise Google. Es ist der digitale Olymp, auf den jeder Website-Betreiber schielt – denn nur wer bei relevanten Suchanfragen weit oben rankt, existiert überhaupt im Kopf der Zielgruppe. Ranking ist keine Glückssache, sondern das...

- Tools und Methoden, um Serverdaten zu messen, zu analysieren und zu optimieren

- Wie Response-Zeiten, TTFB und Server-Status den Crawl-Bock beeinflussen

- Die Bedeutung von CDN, Caching und HTTP/2 für eine schnelle Serverperformance

- Schritt-für-Schritt: So steigerst du deine Server-Performance für SEOSEO (Search Engine Optimization): Das Schlachtfeld der digitalen Sichtbarkeit SEO, kurz für Search Engine Optimization oder Suchmaschinenoptimierung, ist der Schlüsselbegriff für alle, die online überhaupt gefunden werden wollen. Es bezeichnet sämtliche Maßnahmen, mit denen Websites und deren Inhalte so optimiert werden, dass sie in den unbezahlten, organischen Suchergebnissen von Google, Bing und Co. möglichst weit oben erscheinen. SEO ist längst...

- Fehlerquellen und Fallstricke bei der Server-Messung – was viele übersehen

- Langfristige Monitoring-Strategien für stabile Performance und bessere Rankings

- Warum Server-Optimierung kein IT-Kram ist, sondern eine Marketing-Strategie

- Fazit: Ohne technische Performance keine Spitzenposition in 2025

Warum Server-Metrics im SEO mehr zählen als je zuvor

Wer heute im SEO-Kampf bestehen will, der muss verstehen, dass die Server-Performance längst kein technisches Beiwerk mehr ist. Sie ist die Basis, auf der alles andere aufbaut. Google bewertet die Ladezeiten, die Response-Zeiten und die Verfügbarkeit deiner Server direkt in den Rankings. Lange TTFB-Werte (Time to First Byte) sind das Äquivalent zu einem schlechten ersten Eindruck – nur, dass Google hier gnadenlos ist. Denn eine Website, die zu langsam lädt, wird abgestraft, noch bevor der Nutzer überhaupt den ersten Klick gemacht hat.

Im Kern geht es um die Frage: Wie schnell kann dein Server ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... liefern? Und noch wichtiger: Wie zuverlässig ist er? Denn Ausfälle, Timeouts oder Inkonsistenzen in der Server-Antwort bedeuten für Google, dass deine Seite weniger vertrauenswürdig ist. Das wiederum führt zu einer schlechteren Crawl-Effizienz, sinkenden Rankings und letztlich zu weniger SichtbarkeitSichtbarkeit: Die unbarmherzige Währung des digitalen Marketings Wenn es im Online-Marketing eine einzige Währung gibt, die wirklich zählt, dann ist es Sichtbarkeit. Sichtbarkeit – im Fachjargon gern als „Visibility“ bezeichnet – bedeutet schlicht: Wie präsent ist eine Website, ein Unternehmen oder eine Marke im digitalen Raum, insbesondere in Suchmaschinen wie Google? Wer nicht sichtbar ist, existiert nicht. Punkt. In diesem.... Und wer hier nicht mitmischt, verliert im SEO-Game enorm viel Potenzial. Server-Metrics sind also kein technisches Spielzeug, sondern die Grundlage für nachhaltigen Erfolg.

Zudem beeinflusst die Server-Performance die Core Web VitalsCore Web Vitals: Die Messlatte für echte Website-Performance Core Web Vitals sind Googles knallharte Antwort auf die Frage: „Wie schnell, stabil und nutzerfreundlich ist deine Website wirklich?“ Es handelt sich um eine Reihe von Metriken, die konkret messbar machen, wie Besucher die Ladezeit, Interaktivität und visuelle Stabilität einer Seite erleben. Damit sind die Core Web Vitals kein weiteres Buzzword, sondern..., die seit 2021 das Rückgrat des Google-Rankings bilden. Besonders TTFB, LCP (Largest Contentful Paint) und Cumulative Layout Shift werden direkt durch Server-Response-Zeiten beeinflusst. Wenn dein Server nicht schnell genug auf Anfragen reagiert, leidet die Nutzererfahrung – und Google quittiert das mit Abstrafung. Das ist kein Hokuspokus, sondern pure Technik, die im echten Leben messbar ist.

Die wichtigsten Server-Performance-Indikatoren für SEO im Detail

Wer wirklich versteht, was im Server-Performance-Universum zählt, der sollte sich auf eine handvoll Indikatoren konzentrieren. Denn nur mit klaren Metriken kannst du gezielt optimieren und den Erfolg messen. Hier die wichtigsten:

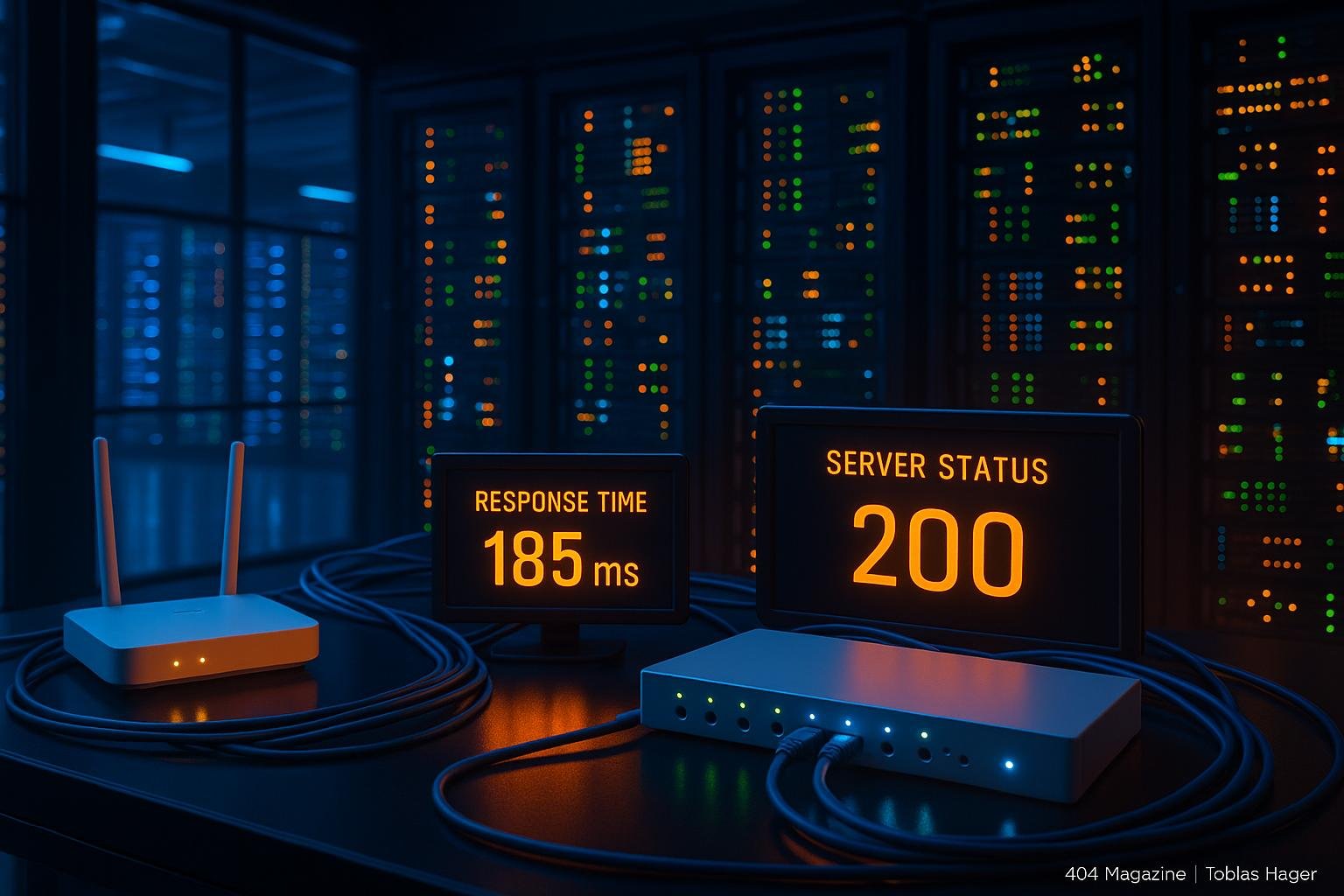

- Time to First Byte (TTFB): Die Zeit, die der Server braucht, um auf eine Anfrage zu reagieren. Ein Wert unter 200 ms gilt als optimal. Alles darüber hinaus kostet Rankings und Nutzerbindung.

- Response-Statuscodes: 200er sind gut, 404, 500 oder 503 sind Katastrophen. Fehlerhafte Statuscodes verhindern IndexierungIndexierung: Wie Webseiten den Weg in die Suchmaschine finden (und warum sie dort bleiben wollen) Autor: Tobias Hager Was bedeutet Indexierung? Definition, Grundlagen und der technische Prozess Indexierung ist im SEO-Kosmos das Eintrittsticket ins Spiel. Ohne Indexierung kein Ranking, keine Sichtbarkeit, kein Traffic – schlicht: keine Relevanz. Kurz gesagt bezeichnet Indexierung den Prozess, durch den Suchmaschinen wie Google, Bing oder... und Nutzererfahrung.

- Server-Uptime: Verfügbarkeit rund um die Uhr ist kein Nice-to-have, sondern Pflicht. Downtimes kosten Rankings, Nutzer und Umsatz.

- Ladezeit (Load Time): Die tatsächliche Dauer, bis die Seite vollständig gerendert ist. Hier gilt: Je kürzer, desto besser.

- Request-Handling & Queueing: Wie viele Anfragen verarbeitet dein Server gleichzeitig? Überlastung führt zu Verzögerungen und Timeouts, die Google abstraft.

Diese Metriken sind die Grundlage, um technische Schwachstellen zu identifizieren. Mit ihnen kannst du gezielt in Infrastruktur, Server-Konfiguration und Content-Delivery investieren, um die Performance auf das nächste Level zu heben.

Tools und Methoden: Wie du Serverdaten richtig misst, analysierst und optimierst

Die Messung der Server-Performance ist keine Zauberei, sondern Technik. Wer hier nur auf Bauchgefühl setzt, landet schnell im Blindflug. Stattdessen brauchst du eine Auswahl an Tools, die tief in die Infrastruktur eindringen und mit klaren Kennzahlen aufwarten. Die besten Werkzeuge dafür sind:

- Pingdom: Liefert präzise Response-Zeiten, Server-Status und Load-Analysen. Ideal für schnelle Checks und Monitoring.

- GTmetrix: Kombiniert PageSpeed- und Server-Performance-Daten, zeigt Wasserfall-Diagramme und gibt konkrete Optimierungsvorschläge.

- WebPageTest.org: Simuliert Ladezeiten aus verschiedenen Regionen, inklusive Filmstreifen und Waterfall-Analysen. Perfekt für globale Performance-Checks.

- Google Lighthouse: Nicht nur für Frontend-Performance, sondern auch für Server-Response-Details. Integriert in Chrome DevTools oder als eigenständiges Tool.

- Server-Logfile-Analyse (z.B. ELK Stack, Screaming Frog Log Analyzer): Zeigt, wie der Googlebot tatsächlich deine Seite besucht, wo es Engpässe gibt und welche URLs Probleme machen.

Der Schlüssel liegt in der Kombination: Mit diesen Tools sammelst du Daten, interpretierst sie kritisch und leitest konkrete Maßnahmen ab. Nur so kannst du den technischen Grundstein für bessere Rankings legen.

Response-Zeiten, TTFB und Server-Status: Der direkte Einfluss auf SEO

Wenn Google deine Seite crawlt, ist die Response-Zeit das erste, was er sieht. Und hier entscheidet sich, ob dein ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... überhaupt in die Bewertung einfließt. Ein hoher TTFB bedeutet, dass Google lange warten muss, bevor es überhaupt mit dem CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... loslegen kann. Das kostet nicht nur bei den Crawling-Rimits Punkte, sondern auch bei der Nutzererfahrung. Denn Websites, die zu langsam sind, verlieren Nutzer – und Google erkennt das.

Besonders kritisch sind Response-Statuscodes. Fehler wie 404, 500 oder 503 führen dazu, dass Google die Seiten nicht crawlen kann. Bei wiederholten Fehlern droht die Entfernung aus dem Index. Ein sauber konfigurierter Server gibt nur 200er, vermeidet Fehler und sorgt für eine stabile, verlässliche Datenbasis.

Ein weiterer wichtiger Punkt: Der Server-Status. Wenn dein Server regelmäßig down ist oder sporadisch antwortet, leidet die Crawl-Effizienz massiv. Google wird weniger Seiten crawlen, du verlierst SichtbarkeitSichtbarkeit: Die unbarmherzige Währung des digitalen Marketings Wenn es im Online-Marketing eine einzige Währung gibt, die wirklich zählt, dann ist es Sichtbarkeit. Sichtbarkeit – im Fachjargon gern als „Visibility“ bezeichnet – bedeutet schlicht: Wie präsent ist eine Website, ein Unternehmen oder eine Marke im digitalen Raum, insbesondere in Suchmaschinen wie Google? Wer nicht sichtbar ist, existiert nicht. Punkt. In diesem... – und das bei einem fundamentalen technischen Problem, das sich meist mit einem Blick in die Server-Logs oder Monitoring-Tools erkennen lässt.

CDN, Caching & HTTP/2: Die Performance-Boost-Strategie für 2025

Die technische Infrastruktur entscheidet maßgeblich darüber, wie schnell deine Server ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... ausliefern können. Moderne Content-Delivery-Networks (CDN) verteilen deine Inhalte weltweit, reduzieren die Latenz und sorgen für eine gleichbleibend schnelle Performance. Caching-Strategien auf Server- und Browserebene minimieren unnötige Serveranfragen und beschleunigen die Ladezeiten erheblich.

HTTP/2 ist heute Standard. Es erlaubt parallele Requests, Header-Kompression und effizientere Datenübertragung. Wer noch auf HTTP/1.1 setzt, schiebt sich unnötige Latenz auf. Zusätzlich sollte GZIP oder Brotli-Kompression aktiviert sein, um die Datenmenge beim Transport zu minimieren. All diese Maßnahmen sind nicht nur technische Details, sondern direkte Rankingfaktoren, die du nicht ignorieren kannst.

Schritt-für-Schritt: So steigerst du deine Server-Performance für SEO

Hier eine klare Anleitung, um die Server-Performance gezielt zu verbessern:

- Bestandsaufnahme machen: Nutze Tools wie GTmetrix oder WebPageTest, um den aktuellen Stand deiner Server-Response-Zeiten zu dokumentieren. Notiere TTFB, Ladezeiten, Fehlercodes.

- Server-Logs analysieren: Lade Logfiles herunter und prüfe, wie Googlebot deine Seite besucht. Identifiziere Engpässe, langsame Antworten oder fehlende Ressourcen.

- Infrastruktur verbessern: Implementiere CDN, aktiviere GZIP/Brotli, stelle sicher, dass HTTP/2 läuft, und optimiere den Server-Response durch Hardware-Upgrade oder Server-Optimierung.

- Cache-Strategien ausbauen: Nutze Browser-Caching, serverseitiges Caching und Edge-Caching, um wiederkehrende Anfragen zu beschleunigen.

- Content-Delivery und Datenminimierung: Reduziere unnötige Scripts, minifiziere CSSCSS (Cascading Style Sheets): Die Sprache des Webdesigns entschlüsselt CSS steht für Cascading Style Sheets und ist die Sprache, mit der das Web schön gemacht wird. Ohne CSS wäre das Internet ein monochromes, typografisches Trauerspiel. CSS trennt die inhaltliche Struktur von HTML sauber von der Präsentation und sorgt für Layout, Farben, Schriftarten, Animationen und sogar komplexe Responsive Designs. Kurz gesagt:... und JavaScriptJavaScript: Das Rückgrat moderner Webentwicklung – und Fluch für schlechte Seiten JavaScript ist die universelle Programmiersprache des Webs. Ohne JavaScript wäre das Internet ein statisches Museum aus langweiligen HTML-Seiten. Mit JavaScript wird aus einer simplen Webseite eine interaktive Webanwendung, ein dynamisches Dashboard oder gleich ein kompletter Online-Shop. Doch so mächtig die Sprache ist, so gnadenlos ist sie auch bei schlechter..., lade nur das, was wirklich gebraucht wird.

- Monitoring etablieren: Richte automatische Tests und Alerts ein, um Performance-Einbrüche sofort zu erkennen und zu beheben.

Nur durch konsequentes Monitoring und iterative Optimierung kannst du dauerhaft eine Top-Performance sicherstellen, die Google im RankingRanking: Das kompromisslose Spiel um die Sichtbarkeit in Suchmaschinen Ranking bezeichnet im Online-Marketing die Platzierung einer Website oder einzelner URLs in den organischen Suchergebnissen einer Suchmaschine, typischerweise Google. Es ist der digitale Olymp, auf den jeder Website-Betreiber schielt – denn nur wer bei relevanten Suchanfragen weit oben rankt, existiert überhaupt im Kopf der Zielgruppe. Ranking ist keine Glückssache, sondern das... honoriert.

Fehlerquellen und Fallstricke bei der Server-Messung – was viele übersehen

Viele SEO-Profis und Webmaster machen den Fehler, nur oberflächlich zu messen oder sich auf einzelne Tools zu verlassen. Dabei gibt es zahlreiche Fallstricke:

- Messungen nur aus einer Region: Performance kann je nach Standort variieren. Nutze Tools, die aus verschiedenen Regionen testen.

- Veraltete Daten: Server-Performance ist dynamisch. Regelmäßiges Monitoring ist Pflicht.

- Falsch interpretierte Response-Zeiten: Nicht nur TTFB ist relevant, auch die Gesamt-Ladezeit im Zusammenspiel mit Frontend-Optimierungen.

- Ignorieren von Server-Errors: 5xx-Fehler in Logfiles oder Monitoring-Tools offenbaren gravierende Probleme, die die Crawl-Quote reduzieren.

Der Trick ist: Daten kritisch hinterfragen, Ursachen genau analysieren und immer wieder nachjustieren. Fehler erkennen und beheben, bevor sie den SEO-Status ruinieren.

Langfristiges Monitoring und Performance-Management

Performance-Optimierung ist kein einmaliges Projekt, sondern eine dauerhafte Aufgabe. Google ändert ständig seine Algorithmen, Frameworks entwickeln sich weiter, und dein ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... wächst. Deshalb brauchst du eine Monitoring-Strategie, die dauerhaft greift:

- Regelmäßige Performance-Checks mit Lighthouse, GTmetrix, WebPageTest

- Automatisierte Alerts für TTFB, Response-Status und Ausfälle

- Logging und Logfile-Analyse in Echtzeit oder periodisch

- Performance-Reports und Trendanalysen

- Ständige Infrastruktur-Optimierung basierend auf den Daten

Nur so bleibst du im grünen Bereich und kannst proaktiv auf technische Performance-Hürden reagieren – lange bevor sie dein RankingRanking: Das kompromisslose Spiel um die Sichtbarkeit in Suchmaschinen Ranking bezeichnet im Online-Marketing die Platzierung einer Website oder einzelner URLs in den organischen Suchergebnissen einer Suchmaschine, typischerweise Google. Es ist der digitale Olymp, auf den jeder Website-Betreiber schielt – denn nur wer bei relevanten Suchanfragen weit oben rankt, existiert überhaupt im Kopf der Zielgruppe. Ranking ist keine Glückssache, sondern das... killen.

Fazit: Ohne technische Performance keine Spitzenposition in 2025

Wer im SEOSEO (Search Engine Optimization): Das Schlachtfeld der digitalen Sichtbarkeit SEO, kurz für Search Engine Optimization oder Suchmaschinenoptimierung, ist der Schlüsselbegriff für alle, die online überhaupt gefunden werden wollen. Es bezeichnet sämtliche Maßnahmen, mit denen Websites und deren Inhalte so optimiert werden, dass sie in den unbezahlten, organischen Suchergebnissen von Google, Bing und Co. möglichst weit oben erscheinen. SEO ist längst... 2025 bestehen will, der muss verstehen, dass Server-Metrics kein technisches Beiwerk sind, sondern das Fundament für nachhaltigen Erfolg. Schnelle Response-Zeiten, stabile Infrastruktur und kontinuierliches Monitoring sind keine Extras, sondern Pflicht. Denn Google ist kein Freund deines langsamen Servers, sondern der härteste Performance-Cop im Web. Wer hier nicht mitmischt, wird abgehängt – egal wie groß dein ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... ist oder wie clever du keywordsKeywords: Der Taktgeber jeder erfolgreichen Online-Marketing-Strategie Keywords sind das Herzstück jeder digitalen Sichtbarkeitsstrategie. Sie sind die Brücke zwischen dem, was Nutzer in Suchmaschinen eintippen, und den Inhalten, die Unternehmen bereitstellen. Ob SEO, SEA, Content-Marketing oder Conversion-Optimierung – ohne die richtigen Keywords läuft gar nichts. Wer denkt, Keywords seien nur ein alter SEO-Hut, hat die Entwicklung der letzten Jahre schlicht verschlafen.... setzt. Technik ist das neue SEO-Backbone, das dich auf die Pole Position katapultiert.

Fazit: Wer langfristig gewinnen will, investiert in Server-Performance, misst genau, optimiert kontinuierlich – und versteht, dass SEOSEO (Search Engine Optimization): Das Schlachtfeld der digitalen Sichtbarkeit SEO, kurz für Search Engine Optimization oder Suchmaschinenoptimierung, ist der Schlüsselbegriff für alle, die online überhaupt gefunden werden wollen. Es bezeichnet sämtliche Maßnahmen, mit denen Websites und deren Inhalte so optimiert werden, dass sie in den unbezahlten, organischen Suchergebnissen von Google, Bing und Co. möglichst weit oben erscheinen. SEO ist längst... heute vor allem eine Frage der Infrastruktur ist. Ohne diese Basis ist alles andere nur heiße Luft. Und in der Welt von 2025 heißt Erfolg: Schnelligkeit, Stabilität und technische Exzellenz – alles andere ist Zeitverschwendung.