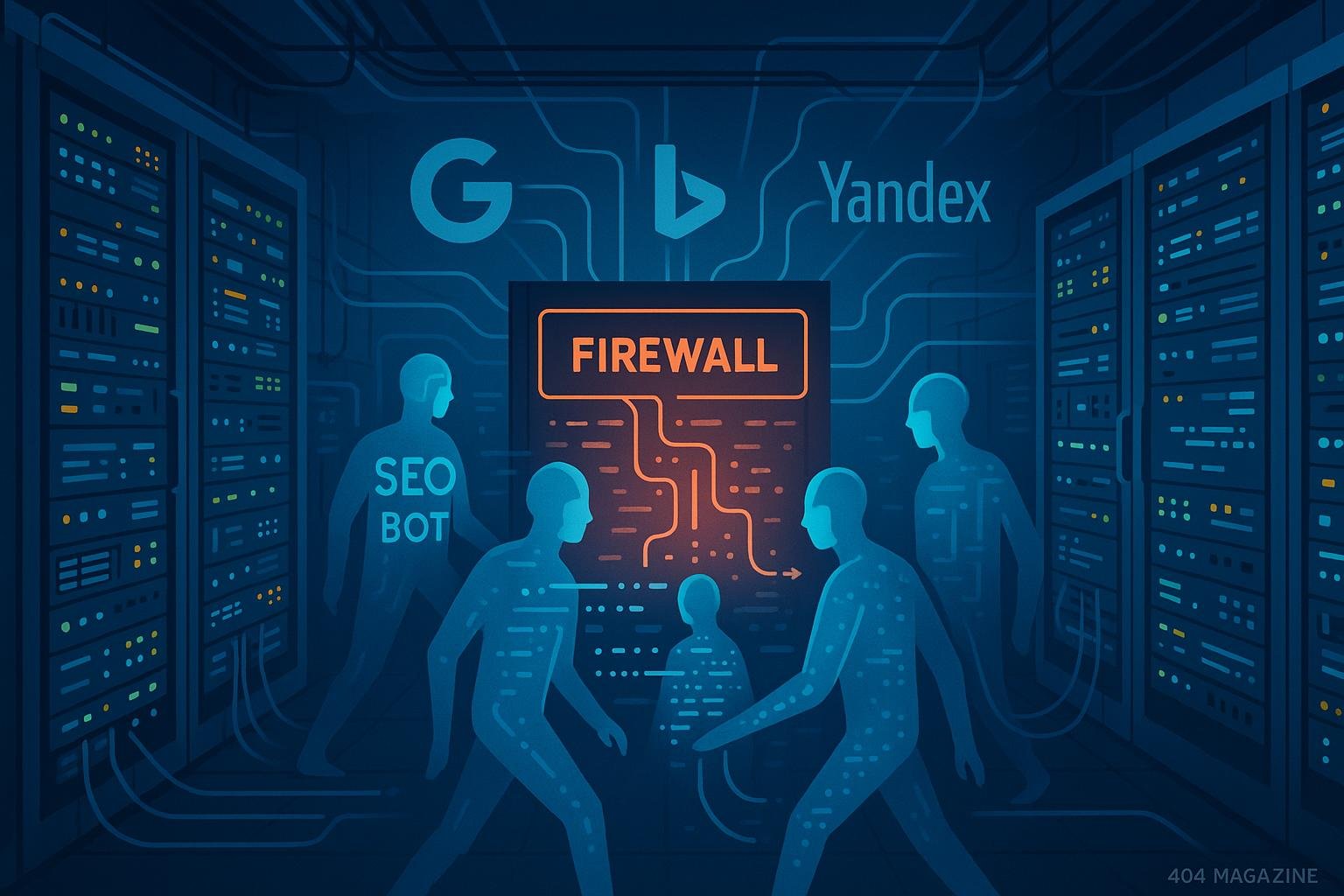

SEO-Bots per Firewall-Regeln: Cleverer Schutz für Webseiten

Wenn du denkst, deine Firewall schützt deine Webseite nur vor Hackern, dann hast du noch nicht mit den echten Game-Changers gerungen: den SEO-Bots. Diese kleinen digitalen Spione kennen keine Gnade, und wenn du sie nicht clever in den Griff bekommst, kannst du deine Rankings gleich direkt in den Papierkorb werfen. Es wird Zeit, die Firewall nicht nur als Schutzschild gegen Angriffe zu sehen, sondern als strategisches Werkzeug, um den Googlebot und Co. richtig zu steuern. Denn nur wer seine Bots kennt und kontrolliert, kann im SEO-Kampf bestehen – alles andere ist Selbstbetrug.

- Warum Firewall-Regeln für SEO-Bots essenziell sind und wie sie deine Rankings beeinflussen

- Die wichtigsten Arten von Bots: Googlebot, Bingbot, Yandex und weniger bekannte

- Wie du deine Firewall so konfigurierst, dass sie Bots gezielt steuert – Schritt für Schritt

- Risiken und Fallstricke: Was passiert, wenn du SEO-Bots blockierst oder falsch leitest

- Tools und Techniken zur Überwachung und Feinjustierung deiner Bot-Regeln

- Best Practices: Welche Firewall-Regeln bewähren sich in der Praxis wirklich?

- Wie du mit Firewall-Regeln das Crawling-Budget optimierst und Serverlast reduzierst

- Fallbeispiele: Erfolgreiche Strategien gegen Bot-Overload und für bessere IndexierungIndexierung: Wie Webseiten den Weg in die Suchmaschine finden (und warum sie dort bleiben wollen) Autor: Tobias Hager Was bedeutet Indexierung? Definition, Grundlagen und der technische Prozess Indexierung ist im SEO-Kosmos das Eintrittsticket ins Spiel. Ohne Indexierung kein Ranking, keine Sichtbarkeit, kein Traffic – schlicht: keine Relevanz. Kurz gesagt bezeichnet Indexierung den Prozess, durch den Suchmaschinen wie Google, Bing oder...

- Langfristige Wartung: Warum Firewall-Regeln kein Setup-Set-and-Forget sind

- Fazit: Die Zukunft der Firewall-gesteuerten SEO-Strategie

Wer heute im digitalen Wettbewerb bestehen will, darf das Thema Firewall-Regeln für SEO-Bots nicht unterschätzen. Während viele Webmaster und SEOs noch glauben, dass der Server nur für Besucher da ist, die echten Nutzer, wird die Realität von den Suchmaschinen-Bots diktiert. Diese Bots sind die unermüdlichen Arbeiter, die dein ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... crawlen, indexieren und letztlich deine Rankings bestimmen. Doch was, wenn diese Bots deine Serverressourcen verseucht oder deine Inhalte blockieren? Hier kommt die Kunst ins Spiel: Die geschickte Steuerung der Bot-Zugriffe per Firewall-Regeln. Denn wer es schafft, Googlebot & Co. gezielt zu lenken, hat einen entscheidenden Vorteil im SEO-Kampf – ohne dabei die Nutzererfahrung zu gefährden.

Warum Firewall-Regeln für SEO-Bots die neue Waffe im digitalen Arsenal sind

In der Welt des technischen SEOSEO (Search Engine Optimization): Das Schlachtfeld der digitalen Sichtbarkeit SEO, kurz für Search Engine Optimization oder Suchmaschinenoptimierung, ist der Schlüsselbegriff für alle, die online überhaupt gefunden werden wollen. Es bezeichnet sämtliche Maßnahmen, mit denen Websites und deren Inhalte so optimiert werden, dass sie in den unbezahlten, organischen Suchergebnissen von Google, Bing und Co. möglichst weit oben erscheinen. SEO ist längst... wird die Firewall oft als Schutzschild gegen Hacker, DDoS-Attacken oder unerwünschte Zugriffe betrachtet. Doch das ist nur die halbe Wahrheit. Eine gut durchdachte Firewall kann auch als gezieltes Steuerungsinstrument für SEO-Bots eingesetzt werden. Es geht darum, den Googlebot korrekt zu lenken, Crawling-Resourcen effizient zu nutzen und gleichzeitig die eigene Serverlast im Griff zu behalten. Die Herausforderung besteht darin, zwischen nützlichen Bots und schädlichen Traffic-Quellen zu unterscheiden und die Regeln entsprechend anzupassen.

Bei der Konfiguration von Firewall-Regeln für SEO-Bots geht es vor allem um die Kontrolle der Zugriffsrechte. Dabei spielt die IP-Whitelist eine zentrale Rolle: Nur die bekannten und vertrauenswürdigen Bots dürfen alles, während andere nur eingeschränkt oder gar nicht durchgelassen werden. Gleichzeitig ist es wichtig, bestimmte Bots gezielt zu blockieren, die etwa zu aggressiv crawlen oder die Serverressourcen unnötig belasten. Das Ziel ist eine Balance zwischen optimaler IndexierungIndexierung: Wie Webseiten den Weg in die Suchmaschine finden (und warum sie dort bleiben wollen) Autor: Tobias Hager Was bedeutet Indexierung? Definition, Grundlagen und der technische Prozess Indexierung ist im SEO-Kosmos das Eintrittsticket ins Spiel. Ohne Indexierung kein Ranking, keine Sichtbarkeit, kein Traffic – schlicht: keine Relevanz. Kurz gesagt bezeichnet Indexierung den Prozess, durch den Suchmaschinen wie Google, Bing oder... und minimaler Serverbelastung. Denn eine Überladung durch Bots kann deine Website zum Absturz bringen – und damit dein RankingRanking: Das kompromisslose Spiel um die Sichtbarkeit in Suchmaschinen Ranking bezeichnet im Online-Marketing die Platzierung einer Website oder einzelner URLs in den organischen Suchergebnissen einer Suchmaschine, typischerweise Google. Es ist der digitale Olymp, auf den jeder Website-Betreiber schielt – denn nur wer bei relevanten Suchanfragen weit oben rankt, existiert überhaupt im Kopf der Zielgruppe. Ranking ist keine Glückssache, sondern das... gleich mit.

Technisch gesehen erfolgt die Steuerung auf IP- oder User-Agent-Basis. Während IP-Whitelist-Listen eine zuverlässige Methode sind, ist der User-Agent-String eine flexible Alternative, die jedoch leicht manipuliert werden kann. Deshalb empfiehlt es sich, beide Methoden in Kombination zu nutzen, um maximale Kontrolle zu gewährleisten. Darüber hinaus gibt es die Möglichkeit, anhand von Verhaltensmustern oder Request-Headern bestimmte Bots zu identifizieren und gezielt zu steuern. Das erfordert allerdings eine tiefgehende Analyse deiner Serverlogs und eine kontinuierliche Feinjustierung.

Die wichtigsten Arten von Bots: Googlebot, Bingbot & Co. richtig steuern

Bevor du Firewall-Regeln für SEO-Bots aufsetzt, solltest du genau wissen, wer da eigentlich auf deiner Seite unterwegs ist. Die wichtigsten Akteure sind Googlebot, Bingbot, Yandex sowie eine Vielzahl weniger bekannter CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer.... Jeder dieser Bots hat seine Eigenheiten, Crawl-Strategien und Prioritäten. Googlebot ist der dominierende Akteur, der bei der IndexierungIndexierung: Wie Webseiten den Weg in die Suchmaschine finden (und warum sie dort bleiben wollen) Autor: Tobias Hager Was bedeutet Indexierung? Definition, Grundlagen und der technische Prozess Indexierung ist im SEO-Kosmos das Eintrittsticket ins Spiel. Ohne Indexierung kein Ranking, keine Sichtbarkeit, kein Traffic – schlicht: keine Relevanz. Kurz gesagt bezeichnet Indexierung den Prozess, durch den Suchmaschinen wie Google, Bing oder... den Ton angibt – doch auch BingBing: Microsofts Suchmaschine zwischen Außenseiter und Innovationstreiber Bing ist die hauseigene Suchmaschine von Microsoft und gilt als das ewige Nummer-zwei-Kind im Schatten von Google. Doch wer Bing immer noch als Randerscheinung abtut, hat die Entwicklungen der letzten Jahre verschlafen. Bing ist heute mehr als nur eine Suchmaschine – es ist ein komplexes Ökosystem mit eigener Indexierung, KI-Integration, Werbenetzwerk und technischer... und Yandex haben ihre Eigenheiten, die du kennen solltest, um gezielt zu steuern.

Googlebot beispielsweise arbeitet mit einer Vielzahl von User-Agent-Strings, die sich je nach Version und Einsatz unterscheiden. Zudem nutzt Google eine intelligente Crawl-Strategie, die auf maschinellem Lernen basiert. Das bedeutet, dass du nicht nur IPs, sondern auch das Verhalten der Bots im Blick haben solltest. Bingbot ist meist weniger aggressiv, kann aber bei großen Seiten ebenfalls die Server ausbremsen. Yandex wiederum ist in Russland stark vertreten und benötigt eigene Regeln, wenn du dort sichtbar sein willst. Die Herausforderung liegt darin, alle relevanten Bots zu erkennen, zu unterscheiden und entsprechend zu steuern.

Nicht zu vergessen sind die sogenannten „Bad Bots“ – also automatisierte Skripte, Scraper, Spam-Bots und andere unerwünschte Besucher. Diese sollten in Firewall-Regeln konsequent blockiert werden, um Ressourcen zu schonen und die Integrität deiner Daten zu sichern. Hier helfen Mustererkennung, Request-Analysen und spezielle Bot-Filter, um den TrafficTraffic: Die wahre Währung des digitalen Marketings Traffic – der Begriff klingt harmlos, fast banal. Tatsächlich ist Traffic das Lebenselixier jeder Website, der Pulsschlag des Online-Marketings und der ultimative Gradmesser für digitale Sichtbarkeit. Ohne Traffic bleibt jede noch so geniale Seite ein Geisterschiff im Ozean des Internets. Dieser Glossar-Artikel zerlegt das Thema Traffic in seine Einzelteile, von Definition bis Technologie,... zu filtern und nur die gewünschten Crawling-Partner durchzulassen.

Schritt-für-Schritt: So konfigurierst du deine Firewall-Regeln für SEO-Bots

Der Schlüssel zu einer effektiven Bot-Steuerung liegt in einer systematischen Herangehensweise. Hier eine Schritt-für-Schritt-Anleitung, um deine Firewall optimal für SEO-Bots zu konfigurieren:

- Bestandsaufnahme: Analysiere deine Serverlogs, um die IP-Adressen und User-Agent-Strings der Bots zu identifizieren, die regelmäßig auf deiner Seite unterwegs sind.

- Liste der vertrauenswürdigen Bots erstellen: Sammle die offiziellen IP-Blocks von Google, BingBing: Microsofts Suchmaschine zwischen Außenseiter und Innovationstreiber Bing ist die hauseigene Suchmaschine von Microsoft und gilt als das ewige Nummer-zwei-Kind im Schatten von Google. Doch wer Bing immer noch als Randerscheinung abtut, hat die Entwicklungen der letzten Jahre verschlafen. Bing ist heute mehr als nur eine Suchmaschine – es ist ein komplexes Ökosystem mit eigener Indexierung, KI-Integration, Werbenetzwerk und technischer..., Yandex und anderen relevanten SuchmaschinenSuchmaschinen: Das Rückgrat des Internets – Definition, Funktionsweise und Bedeutung Suchmaschinen sind die unsichtbaren Dirigenten des digitalen Zeitalters. Sie filtern, sortieren und präsentieren Milliarden von Informationen tagtäglich – und entscheiden damit, was im Internet gesehen wird und was gnadenlos im Daten-Nirwana verschwindet. Von Google bis Bing, von DuckDuckGo bis Yandex – Suchmaschinen sind weit mehr als simple Datenbanken. Sie sind....

- Firewall-Regeln für Whitelisting: Erstelle Regeln, die nur diese bekannten IPs und User-Agents zulassen, um alle anderen Bots zu blockieren oder einzuschränken.

- Blockiere schädliche oder unerwünschte Bots: Nutze Blacklist-Regeln gegen bekannte Spam- und Scraper-Bots, um deine Ressourcen zu schützen.

- Testphase: Überprüfe die Regeln in einer Staging-Umgebung oder im Live-Betrieb mit Monitoring, um sicherzustellen, dass legitime Bots ungehindert crawlen können.

- Monitoring & Feinjustierung: Nutze Tools wie Web-Log-Analyzer, um das Verhalten der Bots zu überwachen und die Regeln bei Bedarf anzupassen.

- Automatisierung & Wartung: Setze auf regelmäßige Updates der IP-Listen und automatisierte Skripte, um mit wechselnden Bot-IPs Schritt zu halten.

Risiken und Fallstricke: Was passiert, wenn du SEO-Bots blockierst oder falsch leitest

Die größte Gefahr bei der Firewall-Optimierung für SEO-Bots ist die falsche Konfiguration. Blockierst du versehentlich Googlebot oder andere wichtige CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer..., riskierst du, dass deine Website nicht mehr richtig indexiert wird. Das bedeutet, deine Rankings sinken, SichtbarkeitSichtbarkeit: Die unbarmherzige Währung des digitalen Marketings Wenn es im Online-Marketing eine einzige Währung gibt, die wirklich zählt, dann ist es Sichtbarkeit. Sichtbarkeit – im Fachjargon gern als „Visibility“ bezeichnet – bedeutet schlicht: Wie präsent ist eine Website, ein Unternehmen oder eine Marke im digitalen Raum, insbesondere in Suchmaschinen wie Google? Wer nicht sichtbar ist, existiert nicht. Punkt. In diesem... schwindet und du hast am Ende gar keinen TrafficTraffic: Die wahre Währung des digitalen Marketings Traffic – der Begriff klingt harmlos, fast banal. Tatsächlich ist Traffic das Lebenselixier jeder Website, der Pulsschlag des Online-Marketings und der ultimative Gradmesser für digitale Sichtbarkeit. Ohne Traffic bleibt jede noch so geniale Seite ein Geisterschiff im Ozean des Internets. Dieser Glossar-Artikel zerlegt das Thema Traffic in seine Einzelteile, von Definition bis Technologie,... mehr.

Ein weiterer Fallstrick ist die Überblockade. Wenn du alle Bots, inklusive der guten, ausschließt, leidet deine IndexierungIndexierung: Wie Webseiten den Weg in die Suchmaschine finden (und warum sie dort bleiben wollen) Autor: Tobias Hager Was bedeutet Indexierung? Definition, Grundlagen und der technische Prozess Indexierung ist im SEO-Kosmos das Eintrittsticket ins Spiel. Ohne Indexierung kein Ranking, keine Sichtbarkeit, kein Traffic – schlicht: keine Relevanz. Kurz gesagt bezeichnet Indexierung den Prozess, durch den Suchmaschinen wie Google, Bing oder... stark. Das kann dazu führen, dass Google deine Inhalte nicht mehr entdeckt oder alte Versionen cached werden. Zudem besteht die Gefahr, dass du durch zu strikte Regeln legitimen TrafficTraffic: Die wahre Währung des digitalen Marketings Traffic – der Begriff klingt harmlos, fast banal. Tatsächlich ist Traffic das Lebenselixier jeder Website, der Pulsschlag des Online-Marketings und der ultimative Gradmesser für digitale Sichtbarkeit. Ohne Traffic bleibt jede noch so geniale Seite ein Geisterschiff im Ozean des Internets. Dieser Glossar-Artikel zerlegt das Thema Traffic in seine Einzelteile, von Definition bis Technologie,... blockierst, was die Nutzererfahrung verschlechtert und dein Google-Ranking indirekt schädigt.

Hinzu kommt das Risiko, dass du durch ungenaue IP-Listen oder User-Agent-Filter falsche Annahmen triffst. Viele Bots verwenden dynamische IPs oder manipulieren ihre User-Agents, um Erkennung zu umgehen. Deshalb ist es wichtig, regelmäßig zu prüfen, ob deine Regeln noch aktuell sind und keine unerwünschten Nebenwirkungen haben.

Tools und Techniken zur Überwachung und Feinjustierung deiner Bot-Regeln

Effektive Firewall-Regeln sind kein „Set-and-Forget“. Du benötigst eine kontinuierliche Überwachung, um auf Veränderungen zu reagieren. Hier kommen Tools ins Spiel, die dir helfen, das Verhalten deiner Bots zu analysieren und die Regeln bei Bedarf anzupassen.

Server-Log-Analyse-Tools wie AWStats, GoAccess oder Elastic Stack bieten tiefe Einblicke in die Request-Muster. Sie zeigen dir, welche IPs, User-Agents und Request-Häufigkeiten auftreten. Damit kannst du Black- und Whitelists stets aktuell halten.

Darüber hinaus gibt es spezielle Bot-Detection-Tools wie Botify, DataDome oder Cloudflare Bot Management, die auf maschinellem Lernen basieren und Bot-Verkehr in Echtzeit klassifizieren. Diese Tools ergänzen Firewall-Regeln durch intelligente Erkennung und automatisierte Blockaden.

Regelmäßige Tests mit Tools wie curl, Postman oder custom Scripts ermöglichen dir, die Wirksamkeit deiner Firewall-Konfiguration laufend zu prüfen. Mit Monitoring-Alerts kannst du bei ungewöhnlichem TrafficTraffic: Die wahre Währung des digitalen Marketings Traffic – der Begriff klingt harmlos, fast banal. Tatsächlich ist Traffic das Lebenselixier jeder Website, der Pulsschlag des Online-Marketings und der ultimative Gradmesser für digitale Sichtbarkeit. Ohne Traffic bleibt jede noch so geniale Seite ein Geisterschiff im Ozean des Internets. Dieser Glossar-Artikel zerlegt das Thema Traffic in seine Einzelteile, von Definition bis Technologie,... oder plötzlichen Crawling-Einschränkungen sofort reagieren.

Best Practices: Welche Firewall-Regeln bewähren sich in der Praxis wirklich?

Die Praxis zeigt, dass einfache Whitelists für bekannte Suchmaschinen-IPs in Kombination mit intelligenten User-Agent-Filter die besten Ergebnisse liefern. Wichtig ist, die Listen regelmäßig zu aktualisieren und auf dem neuesten Stand zu halten.

Ein bewährter Ansatz ist, die wichtigsten Bots explizit zu erlauben, alle anderen aber nur eingeschränkt oder gar nicht zuzulassen. Dadurch kannst du eine effiziente Crawling-Rate sicherstellen, ohne deine Server zu überlasten. Zudem empfiehlt sich, bestimmte Requests, die ungewöhnlich erscheinen, automatisch zu blockieren oder zu throttlen.

Wichtig ist auch, das Crawling-Budget intelligent zu steuern. Indem du weniger relevante URLs per Firewall blockierst und die Zugriffe auf wichtige Seiten priorisierst, kannst du Googlebots effizient lenken. Das spart Ressourcen und sorgt für eine bessere IndexierungIndexierung: Wie Webseiten den Weg in die Suchmaschine finden (und warum sie dort bleiben wollen) Autor: Tobias Hager Was bedeutet Indexierung? Definition, Grundlagen und der technische Prozess Indexierung ist im SEO-Kosmos das Eintrittsticket ins Spiel. Ohne Indexierung kein Ranking, keine Sichtbarkeit, kein Traffic – schlicht: keine Relevanz. Kurz gesagt bezeichnet Indexierung den Prozess, durch den Suchmaschinen wie Google, Bing oder... deiner wichtigsten Inhalte.

Schließlich sollten Firewall-Regeln nicht statisch bleiben. Die beste Strategie ist, sie regelmäßig anhand von Monitoring-Daten zu prüfen und bei Bedarf anzupassen. So bleibst du flexibel und vermeidest unnötige Fehler.

Langfristige Wartung: Warum Firewall-Regeln kein Setup-Set-and-Forget sind

Firewall-Regeln für SEO-Bots sind kein einmaliges Projekt, sondern ein kontinuierlicher Prozess. Die IP-Adressen der Bots ändern sich, Verhaltensmuster entwickeln sich weiter und neue Bots tauchen auf. Daher ist es essenziell, die Regeln regelmäßig zu überprüfen und zu aktualisieren.

Zudem solltest du eine Dokumentation deiner Firewall-Regeln führen. So behältst du den Überblick, warum bestimmte Regeln gesetzt wurden, und kannst bei Änderungen schnell reagieren. Automatisierte Updates und regelmäßige Audits sind Pflicht, wenn du dauerhaft im SEO-Kampf bestehen willst.

Ein weiterer Punkt ist die Zusammenarbeit mit deinem Hosting-Provider oder deiner Security-Abteilung. Nur gemeinsam könnt ihr eine Firewall-Infrastruktur aufbauen, die sowohl Sicherheit als auch SEO-Performance optimal unterstützt. Dabei gilt: Je feingliedriger die Regeln, desto besser die Kontrolle – aber auch desto komplexer die Wartung.

Und last but not least: Bleib am Ball. Die SEO-Landschaft ändert sich, Google passt seine Crawl-Algorithmen an, und die Bots werden immer intelligenter. Nur wer seine Firewall-Regeln regelmäßig anpasst, bleibt vorne.

Fazit: Die Zukunft der Firewall-gesteuerten SEO-Strategie

Firewall-Regeln für SEO-Bots sind kein nettes Extra mehr, sondern ein essenzielles Element für den Erfolg im digitalen Zeitalter. Sie ermöglichen nicht nur den Schutz vor Angriffen, sondern auch eine gezielte Steuerung des Crawlings, eine bessere Ressourcenverwaltung und letztlich bessere Rankings.

In einer Welt, in der Google und Co. immer intelligenter werden, ist die Fähigkeit, Bots präzise zu lenken, ein entscheidender Wettbewerbsvorteil. Wer jetzt noch glaubt, dass Firewall nur Sicherheits-Thematik ist, der unterschätzt die Macht der Kontrolle. Die Zukunft gehört denjenigen, die ihre SEO-Bots wie eine Waffe in der Hand halten – durch kluge, flexible und laufend gepflegte Firewall-Regeln.