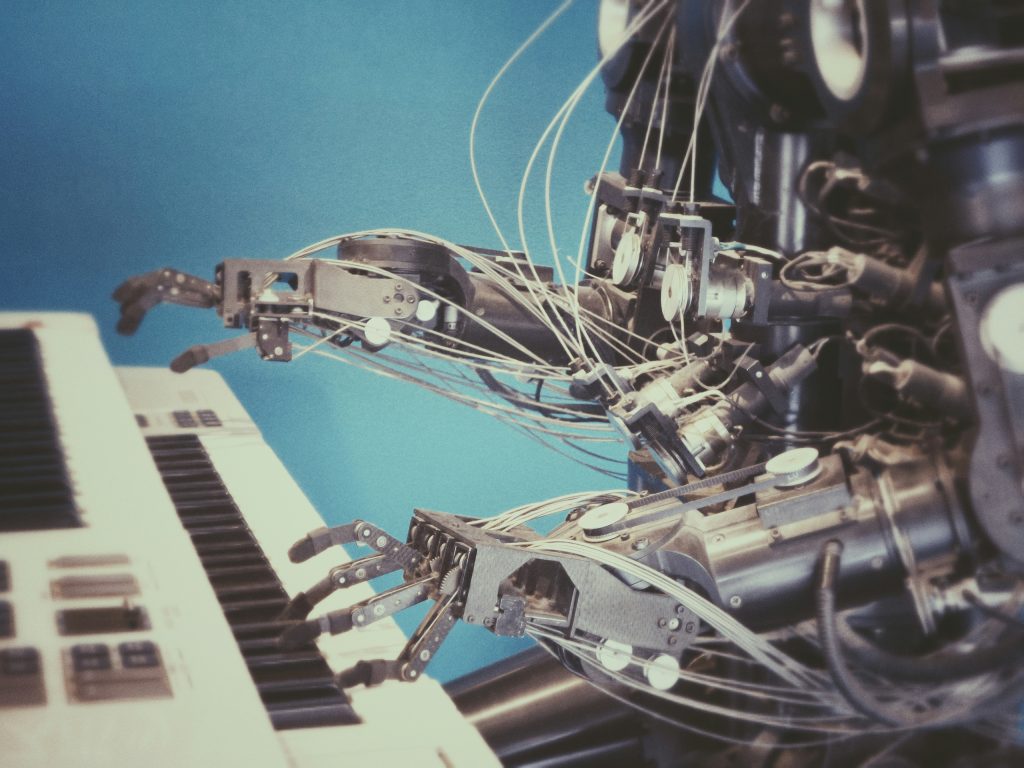

AI Music: Wie Künstliche Intelligenz Hits neu komponiert

Stell dir vor, der nächste Sommerhit kommt nicht aus einem verrauchten Berliner Studio, sondern aus einem GPU-Cluster im Silicon Valley – und die Charts werden von Algorithmen, nicht von Songwritern, dominiert. Klingt wie Science-Fiction? Willkommen in der knallharten Realität der AI Music. Hier entscheidet nicht mehr das Bauchgefühl eines Produzenten, sondern Machine Learning, neuronale Netze und Daten, wer die Playlist regiert. Zeit, der Wahrheit ins Auge zu sehen: Künstliche Intelligenz hat die Musikbranche nicht nur disruptiert, sondern gleich neu komponiert. Und das ist erst der Anfang.

- Künstliche Intelligenz revolutioniert die Musikproduktion – und macht traditionelle Songwriting-Methoden alt.

- Von neuronalen Netzen über Transformer-Modelle bis hin zu Generative Adversarial Networks (GANs): Die aktuellen Tech-Stacks hinter AI Music.

- Wie AI Tools wie Google Magenta, OpenAI Jukebox und AIVA Hits im Akkord produzieren – und was sie besser (oder schlechter) machen als Menschen.

- Technische und ethische Herausforderungen: Urheberrecht, Stilplagiate, und die Frage, wem ein KI-Track überhaupt gehört.

- Musikmarketing im Zeitalter der KI: Playlists, Targeting, und die neue Rolle von Daten in der Hit-Produktion.

- Die Zukunft des Musikgeschäfts: Warum Labels, Publisher und Künstler ohne KI-Skills bald raus sind.

- Step-by-Step: So nutzt du AI Music Tools, um selbst Tracks zu generieren – und worauf du achten musst, bevor du deinen “AI Hit” veröffentlichst.

- Fazit: KI-Musik ist gekommen, um zu bleiben – und wird die Branche tiefer verändern als jeder Synthesizer oder Streamingdienst zuvor.

AI Music ist kein Marketing-Gimmick mehr, sondern eine technologische Revolution, die jeden Aspekt der Musikproduktion, -vermarktung und -konsumtion radikal umkrempelt. Wer immer noch glaubt, dass künstliche Intelligenz bloß ein weiteres Tool für Nerds ist, hat die eigentliche Pointe verpasst. Hier entstehen neue Genres, neue Geschäftsmodelle, neue Machtverhältnisse – und vor allem: neue Hits, die so nie ein Mensch geschrieben hätte. In diesem Artikel bekommst du die volle Breitseite: von den technischen Grundlagen über die wichtigsten AI Music Tools bis hin zu den konkreten Implikationen für Künstler, Labels und Marketer. Keine romantischen Mythen, keine KI-Propaganda – nur die ungeschönte Wahrheit über die Musik der Zukunft.

AI Music: Definition, Funktionsweise und die wichtigsten Technologien

Der Begriff “AI Music” ist längst mehr als ein Buzzword für Tech-Blogs oder Pitch-Decks von Startups. Es geht um die systematische Anwendung künstlicher Intelligenz auf sämtliche Stadien der Musikproduktion: Komposition, Arrangement, Sounddesign, Mixing und sogar Mastering. Die Hauptrolle spielen dabei Machine Learning Algorithmen, Deep Learning und speziell neuronale Netze, die musikalische Muster erkennen, imitieren und eigenständig neue Kompositionen generieren. Das ist kein “Autotune on Steroids”, sondern eine grundlegende Verschiebung, wie Musik überhaupt entsteht.

Typische AI Music Systeme nutzen riesige Datensätze aus bestehenden Tracks, Notenblättern, MIDI-Dateien und Audioaufnahmen. Über supervised und unsupervised Learning lernt das Modell, musikalische Strukturen, Harmonien, Rhythmen und Stile zu analysieren. Besonders beliebt sind dabei Recurrent Neural Networks (RNNs) und deren moderner Nachfolger: Transformer-Modelle. Letztere, wie sie auch in GPT-4 oder Google BERT zum Einsatz kommen, ermöglichen es, musikalische Abfolgen mit beispielloser Kohärenz und Kontextsensitivität zu generieren.

Ein weiteres technisches Schwergewicht sind Generative Adversarial Networks (GANs). Hier konkurrieren zwei neuronale Netze miteinander: Das eine generiert Musikfragmente, das andere bewertet sie – ein Wettstreit, der zu immer besseren Ergebnissen führt. Die technischen Buzzwords sind kein Selbstzweck: Wer heute AI Music wirklich nutzen will, muss wissen, was hinter Modellen wie OpenAI Jukebox, Google Magenta oder AIVA steckt. Ignoranz ist keine Option mehr, wenn der Algorithmus das nächste Release dominiert.

Warum dieses technische Fundament wichtig ist? Weil die Qualität, Kreativität und Originalität eines AI-Tracks maßgeblich davon abhängt, wie das jeweilige Modell trainiert wurde: Datensatz-Größe, Diversität, Preprocessing, Feature Engineering – alles Faktoren, die am Ende über Hit oder Flop entscheiden. Wer glaubt, ein paar Klicks im Interface reichen, um einen Chartbreaker zu bauen, hat das Prinzip AI Music nicht verstanden. Es ist ein Spiel mit Daten, Architektur und Trainingstiefe – und genau das macht es für Tech-Nerds wie für Musiker gleichermaßen spannend.

Die wichtigsten AI Music Tools: Von Magenta bis Jukebox – was kann die Technologie wirklich?

Wenn von AI Music die Rede ist, fallen immer dieselben Schlagworte: Google Magenta, OpenAI Jukebox, AIVA, Amper Music, Boomy, Ecrett, Soundraw. Doch was steckt technisch hinter diesen Tools? Und wie weit sind sie tatsächlich in der Lage, menschliche Kreativität zu emulieren oder gar zu übertreffen? Wer glaubt, die Tools seien “nur” neue Instrumente, unterschätzt die disruptive Kraft dieser Technologien.

Google Magenta baut auf TensorFlow und nutzt eine breite Palette neuronaler Netzarchitekturen, darunter RNNs, LSTMs und Transformer. Das System kann Melodien, Drum-Patterns, Harmonien und sogar komplexe Arrangements generieren – in MIDI oder direkt als Audio. Besonders spannend: Magenta bietet Open-Source-Code, mit dem Entwickler eigene Modelle trainieren oder bestehende anpassen können. Wer nicht nur konsumieren, sondern selbst gestalten will, findet hier die perfekte Spielwiese.

OpenAI Jukebox geht noch einen Schritt weiter: Hier handelt es sich um ein mehrstufiges Transformer-Modell, das direkt auf Roh-Audio (Waveform) trainiert wurde. Jukebox kann Songs in unterschiedlichen Stilen, Stimmen und sogar Sprachen generieren – inklusive Vocals. Das Modell arbeitet mit einer Kombination aus VQ-VAE (Vector Quantized Variational Autoencoder) und autoregressiven Transformer-Stacks, um Musik nicht nur zu komponieren, sondern auch zu “performen”. Die Ergebnisse? Beeindruckend, aber nicht ohne Artefakte – vor allem in längeren Passagen.

AIVA (Artificial Intelligence Virtual Artist) fokussiert sich auf Komposition im klassischen und filmmusikalischen Bereich. Das System nutzt Deep Learning, um Stilmerkmale berühmter Komponisten zu imitieren – von Mozart bis Hans Zimmer. AIVA produziert komplette Partituren, die von echten Orchestern eingespielt werden können. Der Vorteil: Präzise Steuerung von Stimmung, Tempo und Instrumentierung, aber (noch) weniger kreative Ausreißer als bei manchen Open-Source-Alternativen.

Was all diese Tools eint: Sie sind nicht bloß “Helferlein”, sondern ernstzunehmende Konkurrenz für menschliche Komponisten – zumindest in bestimmten Genres und Produktionsstufen. Die Qualität hängt vom Modell, Trainingsdaten und der Feinsteuerung ab. Wer AI Music strategisch einsetzen will, muss die Limitierungen kennen: Künstliche Intelligenz ist (noch) kein Genie, aber ein verdammt schneller und vielseitiger Handwerker – und genau da liegt ihr Killerargument.

Technische Grenzen, Urheberrecht und ethische Fallstricke von AI Music

So disruptiv AI Music auch sein mag, es gibt technische, juristische und ethische Stolperfallen, die man nicht ignorieren kann. Die erste: Urheberrecht. Wer einen AI Track erzeugt, nutzt in der Regel Trainingsdaten, die aus bestehenden Werken extrahiert wurden – oft ohne explizite Genehmigung der Rechteinhaber. Das wirft die Frage auf: Ist ein KI-generierter Song ein Plagiat? Und wem gehört das Ergebnis, wenn das “Original” ein Algorithmus ist?

Juristisch ist AI Music ein Minenfeld. In den meisten Ländern gilt: Nur Werke mit “menschlichem Schöpfungsanteil” sind urheberrechtlich geschützt. Reine KI-Kompositionen könnten also gemeinfrei sein – ein Albtraum für Labels und Publisher, die auf Exklusivität setzen. Noch komplizierter wird es, wenn AI Tracks gezielt im Stil bekannter Künstler generiert werden. Stilplagiate, Soundalikes und Deepfakes sind längst Realität. Die Frage, ob ein AI-Track “zu ähnlich” klingt, ist nicht nur technisch, sondern auch rechtlich umstritten.

Technisch gibt es ebenfalls klare Grenzen. Auch das beste Modell ist nur so gut wie sein Datensatz. Bias, Overfitting, mangelnde Diversität der Trainingsdaten – all das führt dazu, dass AI Music oft vorhersehbar, “glattgebügelt” oder schlicht langweilig klingt. Artefakte, Timing-Probleme und kontextlose Harmoniewechsel sind keine Seltenheit. Wer AI Music ernsthaft nutzen will, braucht ein kritisches Ohr – und sollte die KI als Werkzeug, nicht als Endlösung betrachten.

Ethisch steht die Branche vor einer Zerreißprobe. Wenn Playlists von Algorithmen dominiert werden, verschwimmt die Grenze zwischen “kreativ” und “generisch”. Die Gefahr: Musik wird zum reinen Datenprodukt. Die Chance: Radikal neue Sounds, die jenseits menschlicher Konventionen entstehen. Wer hier keine Position bezieht, wird von der eigenen Technologie überholt.

AI Music im Online-Marketing: Neue Strategien für Labels, Künstler und Marketer

Spätestens an dieser Stelle wird klar: AI Music ist nicht nur ein Produktionstool, sondern ein Gamechanger für das gesamte Musikmarketing. Wer weiß, wie Algorithmen Hits komponieren, kann auch Marketingstrategien radikal neu denken. Stichwort: datengetriebene Zielgruppenansprache. KI-Tools erzeugen nicht nur Musik, sondern liefern auch Metadaten, Analysen und sogar automatisierte Vorschläge für Songtitel, Cover-Art und Zielgruppen-Targeting.

Im Streaming-Zeitalter entscheidet der Algorithmus, was gehört wird. Spotify, Apple Music und YouTube setzen auf Recommendation Engines, die AI-generierte Tracks nahtlos in Playlists einbauen. Für Labels und Marketer heißt das: Wer AI Music versteht, kann Playlists strategisch beeinflussen, Trends antizipieren und virale Effekte gezielt triggern. Die neue Formel lautet: Daten + KI + gezieltes Marketing = maximierte Reichweite.

Auch im Bereich Content Monetarisierung entstehen neue Modelle. AI Tracks können massenhaft für Werbespots, Games, Social Media Clips oder Podcasts produziert werden – mit minimalem Aufwand und maximaler Geschwindigkeit. Das Problem: Die Luft wird dünner für klassische Musiker, die noch auf Honorar oder Tantiemen hoffen. Wer jetzt nicht auf KI setzt, spielt im Marketing von gestern.

- Schritt-für-Schritt-Anleitung für AI Music im Marketing:

- 1. Zielgruppe und Plattform analysieren: Wer soll den AI Track hören? Wo wird er ausgespielt?

- 2. Passendes AI Tool auswählen: Google Magenta für elektronische Stile, Jukebox für Pop/Rock, AIVA für orchestrale Kompositionen.

- 3. Track generieren und Metadaten optimieren: Genre, Stimmung, Keywords, Cover-Art, Songtitel.

- 4. Zielgerichtetes Pitching: Playlists, Influencer, Werbekampagnen – alles datengetrieben.

- 5. Monitoring und Feintuning: Analyse der Reichweite, Feedbackschleifen, Anpassung der AI-Parameter für nächste Releases.

Wer diese Schritte beherrscht, kann Marketing nicht nur automatisieren, sondern exponentiell skalieren. Die Konkurrenz? Arbeitet vielleicht noch mit Bauchgefühl – und wird gnadenlos abgehängt.

AI Music selbst einsetzen: Workflow, Tools und Stolperfallen

Du willst nicht nur über AI Music reden, sondern endlich selbst den ersten KI-Track produzieren? Dann vergiss die romantische Vorstellung vom genialen Einzelkünstler. Hier regieren Daten, Modelle, Schnittstellen und ganz viel technisches Know-how. Der Workflow ist radikal anders als in klassischen Studios – aber auch deutlich effizienter, wenn du weißt, was du tust.

1. Tool auswählen: Entscheide dich für eine Plattform wie Google Magenta (Open-Source, MIDI/Audio), OpenAI Jukebox (Audio mit Vocals), AIVA (klassische Kompositionen), Boomy oder Soundraw (Web-Interfaces, schnelle Ergebnisse).

2. Trainingsdaten anpassen (optional): Fortgeschrittene Nutzer trainieren eigene Modelle mit spezifischen Datensätzen, um Stil und Sound zu individualisieren. Wer auf Standard-Modelle setzt, bekommt “Mainstream” – wer eigene Daten einspielt, kann echte Unikate erzeugen.

3. Parameter einstellen: Genre, Stimmung, Tempo, Instrumentierung, Länge. Die meisten Tools bieten eine Vielzahl von Reglern, die das Ergebnis massiv beeinflussen. Wer hier schlampig arbeitet, bekommt generische Tracks – wer gezielt steuert, bekommt Hits mit Charakter.

4. Track generieren und exportieren: Die KI produziert meist mehrere Varianten. Kritisch: Auswählen, nachbearbeiten, Audioqualität checken. Viele AI Tracks brauchen noch menschliches Feintuning beim Mixing und Mastering.

5. Rechte, Credits, Veröffentlichung: Vor dem Upload klären: Wem gehören die Rechte am Track? Gibt es Lizenzmodelle oder Open-Source-Fallen? Erst danach auf Spotify, YouTube & Co. veröffentlichen – alles andere ist juristischer Harakiri.

- Profi-Tipp: Kombiniere mehrere AI Tools, um Stärken auszuspielen.

- Fehler vermeiden: Verlass dich nie auf “one click” – AI Music braucht Kontrolle, Iteration und kritisches Editing.

- Bonus: Nutze AI auch für Cover-Art, Metadaten und automatisiertes Marketing – so entsteht ein komplett datengetriebenes Release.

Fazit: AI Music ist die radikalste Disruption seit dem Synthesizer – und der Anfang einer neuen Ära

Wer glaubt, AI Music sei ein kurzfristiger Hype oder ein “nice to have” für hippe Startups, hat die Entwicklung verschlafen. Die Kombination aus Deep Learning, Big Data und kreativen Algorithmen verändert die Musikbranche tiefer als jede technologische Innovation zuvor. Hits entstehen heute im Code – und wer die Spielregeln nicht kennt, spielt schon morgen keine Rolle mehr.

Ob du Künstler, Label, Marketer oder einfach nur Musikfan bist: Es ist höchste Zeit, die eigene Komfortzone zu verlassen und sich mit AI Music ernsthaft auseinanderzusetzen. Die Tools sind da, die Märkte sind offen, und die nächste Generation von Hits wartet nicht auf Nostalgiker. In der Musik von morgen ist Künstliche Intelligenz nicht nur Co-Produzent – sondern der eigentliche Komponist. Alles andere ist Vergangenheit.