AI Upscaler: Bildqualität neu definiert und skaliert

Dein Bild ist matschig, die Pixel schreien um Hilfe, und doch willst du’s auf Plakatgröße aufblasen? Willkommen in der Welt der AI Upscaler, wo Super-Resolution nicht nur Buzzword-Bingo ist, sondern handfeste Signalverarbeitung auf Steroiden.

- AI Upscaler erklären: Was Super-Resolution wirklich leistet – und was nicht.

- Modelle im Klartext: ESRGAN, Real-ESRGAN, SwinIR, SR3, Diffusion und Face-Restoration mit GFPGAN/CodeFormer.

- Pipeline-Architektur: Preprocessing, Upscaling, Postprocessing – sauber getrennt, sauber messbar.

- Deployment in Produktion: ONNX Runtime, TensorRT, WebGPU, Core Web Vitals und CDN-Strategien.

- Einsatzfälle mit ROI: E‑Commerce, Print, Video-Upscaling, UGC-Optimierung, Archivierung.

- Qualitätsmetriken: PSNR, SSIM, LPIPS, NIQE – und warum nur LPIPS deinem Auge nahe kommt.

- Farbmanagement & Bit-Tiefe: ICC, sRGB, P3, 8‑Bit vs. 10‑Bit – damit Upscaling nicht Farbsuppe wird.

- Tools & Services: Topaz Gigapixel, Photoshop Super Resolution, waifu2x, Cloudinary AI, Open-Source mit ESRGAN/SwinIR.

AI Upscaler ist nicht die Zauberfee für schlechte Fotografie, aber er ist verdammt nah dran, wenn du ihn verstehst. AI Upscaler hebt Details scheinbar aus dem Nichts, obwohl er in Wahrheit statistische Muster rekonstruiert. AI Upscaler ist Super-Resolution auf Deep-Learning-Basis, trainiert auf Millionen Bildpatches mit realen Artefakten. AI Upscaler liefert Ergebnisse, die klassische Spline- oder Lanczos-Filter gnadenlos alt aussehen lassen. AI Upscaler skaliert nicht nur die Auflösung, er rekonstruiert Texturen, Kanten und Mikrokontrast. AI Upscaler ist deshalb eine Waffe – und wie jede Waffe musst du wissen, wo du zielst.

AI Upscaler Grundlagen: Super-Resolution, Bildqualität, Limits und Mythen

Super-Resolution beschreibt die Rekonstruktion hochauflösender Bildinhalte aus niedrig aufgelöstem Material, und AI Upscaler sind die derzeit effektivste Implementierung davon. Statt simplen Interpolationen wie Bilinear, Bicubic oder Lanczos nutzt ein AI Upscaler neuronale Netze, die Kanten, Texturen und Rauschprofile gelernt haben. Das Netz antizipiert fehlende Bildfrequenzen und füllt diese plausibel auf, was subjektiv schärfere Details liefert. Objektiv sind diese Details nicht “wahr”, sondern statistisch wahrscheinlich, was in vielen Business-Cases völlig ausreichend ist. Genau hier liegt die erste harte Wahrheit: Ein AI Upscaler kann keine echten Informationen aus dem Nichts herzaubern, er extrapoliert. Je besser das Training und die Domänenpassung, desto realistischer die Rekonstruktion.

Ein zweiter Kernpunkt betrifft Artefakte, die jede Skalierungsmethode erzeugt, nur in unterschiedlicher Ausprägung. Klassische Filter verursachen Aliasing, Ringing und Halos, während ein AI Upscaler zu “Halluzinationen” neigt, wenn das Modell nicht zur Bilddomäne passt. Gesichter können plastikartig wirken, Texturen können repetitiv werden, und feine Muster wie Moiré in Textilien können eskalieren. Das bedeutet, dass Modellwahl, Upscaling-Faktor und Postprocessing als geschlossenes System gedacht werden müssen. Ein sauberer Workflow trennt Schärfung, Rauschunterdrückung und Farbraummanagement strikt, um keine kumulativen Artefakte zu provozieren. So verhinderst du, dass das Ergebnis wie ein KI-Poster statt wie ein Foto aussieht.

Ein dritter Aspekt ist die Signalverarbeitung rund um die Frequenzbänder, denn ein AI Upscaler ist am Ende auch nur ein Filter mit komplexem Verhalten. Hochfrequente Details wie Haare, Fell, Texturen und Typografie profitieren überproportional, wenn das Modell dies gelernt hat. Niedrigfrequente Flächen wie Himmel oder Haut neigen zu Banding und Posterisierung, wenn du in 8-Bit arbeitest und aggressiv komprimierst. Deshalb ist es eine gute Idee, vor dem AI Upscaler in 16‑Bit oder zumindest 10‑Bit intern zu arbeiten und erst am Ende zu quantisieren. Farbmanagement via ICC-Profilen (sRGB/Display P3/Rec.709/Rec.2020) ist Pflicht, sonst stimmen Sättigung und Gamut-Mapping nicht. Ohne korrektes Profiling kannst du jedes noch so brillante Upscale mit einem falschen Renderintent ruinieren.

Modelle und Algorithmen im AI Upscaler: ESRGAN, Real-ESRGAN, SwinIR, SR3 und Gesichtsmodelle

ESRGAN ist der Klassiker unter den AI Upscaler-Modellen und setzt auf Generative Adversarial Networks, um realistischere Texturen als reine L1/L2-Loss-Netze zu erzeugen. Das Training kombiniert Content-Loss (L1/L2), Perceptual Loss (VGG) und Adversarial Loss, wodurch die Ausgabe knackig, aber manchmal überbissen wirkt. Real-ESRGAN adressiert All-in-the-Wild-Material mit realistischeren Degradationsmodellen, also echten JPEG-Artefakten, Rauschen, Blur und Kompressionsmustern. SwinIR bringt Transformer-Architekturen in die Super-Resolution und skaliert über lokale Selbstaufmerksamkeit robuste Details. Für Gesichter sind GFPGAN und CodeFormer State of the Art, weil sie Gesichtsstrukturen priorisieren und uncanny-valley-Effekte vermeiden.

Diffusionsbasierte Upscaler wie SR3 oder latent-diffusion Upscaler arbeiten iterativ, indem sie Rauschen entfernen und schrittweise Details rekonstruieren. Dieser Prozess ist rechenintensiver, liefert aber oft bessere Texturkohärenz und weniger GAN-Glitches. In der Praxis bedeutet das, dass ein AI Upscaler auf Diffusionsbasis für High-End-Prints oder VFX sinnvoll ist, wo Renderzeit zweitrangig ist. Für Realtime-Szenarien wie Web-Delivery oder Batch-Verarbeitung bei großen Katalogen bleiben ESRGAN/Real-ESRGAN/SwinIR die pragmatische Wahl. Ein Mischansatz ist häufig ideal: Face-Restoration mit GFPGAN, dann Real-ESRGAN 4x, gefolgt von leichter Unsharp-Mask im Linearraum. So hältst du die Balance aus knackigen Details und natürlicher Anmutung.

Damit Modelle reproduzierbar liefern, spielen Daten und Loss-Design eine dominante Rolle. Trainingssets wie DIV2K, Flickr2K oder DF2K sind Standards, aber domänenspezifische Fine-Tunes schlagen generische Modelle fast immer. Für Produktbilder lohnt ein eigenes Fine-Tuning mit Makrotexturen, Text, Stoffen und Metalloberflächen. Für Kunst und Anime ist waifu2x bzw. Anime-fokussiertes ESRGAN unschlagbar, weil die Kantenlogik dort völlig anders ist. Ohne passenden Trainingsfokus riskiert ein AI Upscaler repetitive Texturen und unpassende Mikrodetails, die im Zoom auffallen und Vertrauen kosten.

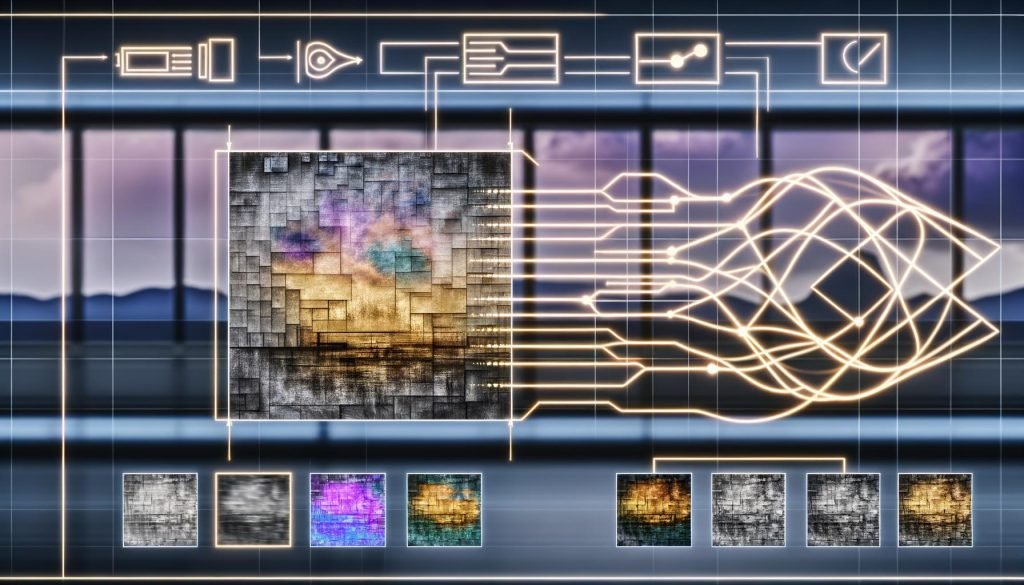

Pipeline-Architektur: Preprocessing, AI Upscaler, Postprocessing und Dateiformate

Die beste AI Upscaler-Qualität bekommst du nicht mit einem Klick, sondern mit einer sauberen Pipeline. Preprocessing beginnt bei der Rauschklassifikation: Ist es sensorisches Rauschen, Kompressionsrauschen oder Motion-Blur? Je nach Antwort setzt du Denoising (BM3D/NLM/DNN), Deblur (blind deconvolution) oder Anti-Aliasing-Prepass ein. Danach normalisierst du Farbraum und Dynamik in einen linearen Arbeitsfarbraum mit korrektem ICC-Profil. Ein Spline-Pre-Scale auf 1.5x vor dem AI Upscaler kann Banding reduzieren, wenn du danach auf 2x/4x gehst. Ziel ist ein wohldefinierter Input, damit das Modell nicht raten muss, was Artefakt und was Detail ist.

Der AI Upscaler selbst ist der zentrale Schritt, aber nicht der letzte. Nach dem Upscaling folgen Postprocessing-Module wie mildes Sharpening im Frequenzbereich, Halo-Suppression, Grain-Reintroduktion und Text-Preserving-Filter. Ein dezentes synthetisches Grain in 16‑Bit verhindert Banding und lässt Flächen lebendig wirken. Für Text solltest du Kanten mit edge-aware Sharpening schützen, damit Typografie nicht ausfranst. Wenn Gesichter im Spiel sind, ordnest du Face-Restoration vor den globalen Schärfefiltern ein. So entstehen konsistente Resultate, die auch im Print bestehen.

Dateiformate entscheiden über Endqualität, Ladezeit und Kompatibilität. Für Web sind AVIF und WebP die erste Wahl, wobei AVIF häufig 20–30 Prozent kleinere Dateien bei gleicher Qualität liefert. PNG ist sinnvoll für Grafiken mit Transparenzen und scharfem Text, aber für Fotos meist Overkill. JPEG ist kompatibel, aber zickig bei feinen Texturen und erzeugt schnell Mosquito-Noise; wenn JPEG, dann mit moderater Schärfung. Für Farbräume gilt: sRGB im Web, P3 bei kontrollierten Umgebungen, Rec.709 für Video-Delivery und Rec.2020/HLG/PQ für HDR. Ohne durchgehendes Profil-Management riskiert dein AI Upscaler eine Farbschlacht, die niemand will.

- Analyse: Bildquelle prüfen, Rauschtyp, Artefakte, Farbraum und Bit-Tiefe identifizieren.

- Preprocessing: Denoise/DeBlur, Farbmanagement einrichten, linearen Arbeitsraum wählen.

- Upscaling: Passendes Modell (Real-ESRGAN/SwinIR/GFPGAN) und Faktor (2x/4x/8x) wählen.

- Postprocessing: Halo-Reduction, Grain-Add, edge-aware Sharpening, Banding-Schutz.

- Export: AVIF/WebP mit angepasstem CRF/Quality, ICC einbetten, Metadaten/EXIF kuratieren.

Deployment in Produktion: AI Upscaler mit ONNX, TensorRT, WebGPU, CDN und Core Web Vitals

Ein AI Upscaler ist erst dann geschäftsrelevant, wenn er in deiner Produktionskette stabil, schnell und messbar läuft. Für Server-Side-Inferenz ist ONNX Runtime der pragmatische Standard, weil du Modelle framework-agnostisch betreibst. Auf NVIDIA-GPUs liefert TensorRT massive Durchsatzgewinne mit FP16/INT8-Quantisierung, solange Qualitätsverlust akzeptabel bleibt. Für AMD/Apple-Hardware ist DirectML oder Core ML ein solider Weg, während WebGPU/wasm für Client-Side-Inferenz interessantes Terrain ist. Client-Side klingt sexy, killt aber schnell Batterien und kann in Low-End-Geräten aus dem Ruder laufen. Die Wahrheit: Für Shops und Medienseiten ist ein CDN-gestütztes Server-Upscaling mit Caching häufig die einzige erwachsene Lösung.

Core Web Vitals sind kein Deko-Metrikpaket, sie entscheiden über Ranking und Conversion. Ein AI Upscaler lässt sich nutzen, um kleinere Quellbilder mit nachträglichem Upscale zu liefern, aber Vorsicht bei LCP: Das größte Content-Element muss schnell erscheinen, sonst sinkt die UX. Besser ist ein Build-Time- oder Edge-Upscaling, das fertige Derivate in allen Breakpoints bereitstellt (SRCSET + SIZES). Client Hints (DPR, Width, Viewport-Width) und ein intelligenter Image-Resizer wie imgproxy, Thumbor, Cloudinary oder Cloudflare Images sind Pflicht. Kombiniert mit AVIF/WebP Negotiation bekommst du Qualität, Größe und Geschwindigkeit unter einen Hut. Ein AI Upscaler ist hier der Qualitätsmotor, nicht der Performance-Feigenblatt.

Betriebssicherheit verlangt Observability und wiederholbare Deployments. Logge Inferenzezeiten, GPU-Speicher, Fehlerraten, Cache-Hit-Rates, und verknüpfe sie mit Metriken wie LCP, CLS und INP. A/B-Tests zeigen, wann Upscaling-Prozesse ROI liefern, und wann “native hochauflösend” günstiger wäre. Rollouts steuerst du via Feature Flags, damit du Modelle ohne Downtime wechseln kannst. Mit ONNX-Model-Zoo, eigenen Checkpoints und Versionierung (SemVer) behältst du die Kontrolle. Und wenn du wirklich skaliert, gehören Autoscaling und Job-Queues (Celery, Sidekiq, SQS) zu deiner Grundausstattung.

- Modell wählen und nach ONNX konvertieren, Validierung gegen Golden Set durchführen.

- Beschleuniger aktivieren (TensorRT/DirectML/Core ML), Qualität nach Quantisierung prüfen.

- Edge/Server-Architektur definieren, Caching-Strategien und Derivate festlegen.

- Bild-Delivery integrieren (SRCSET, Client Hints, AVIF/WebP), LCP/INP überwachen.

- Monitoring (APM, Logs, Traces), A/B-Testing und Kanarien-Rollouts etablieren.

Einsatzszenarien für AI Upscaler: E‑Commerce, Print, Video-Upscaling, UGC und Archivierung

Im E‑Commerce sind viele Produktbilder zu klein, zu alt oder zu hart komprimiert, und ein AI Upscaler rettet hier bares Geld. Du holst aus historischen Assets neue Detailtiefe heraus, ohne jedes Produkt neu zu fotografieren. Kritisch sind Kanten und Text, insbesondere bei Etiketten, Mustern und feinen Linien. Deshalb empfiehlt sich eine zweistufige Pipeline mit text-schonendem Filter und optionaler Face-Restoration bei Personenfotografie. Conversion-Rate-Optimierung profitiert direkt, weil klarere Bilder Vertrauen schaffen und Bounce Rates senken. In Kombination mit einem sauberen CDN wird Upscaling zum stillen Umsatzhebel.

Für Print gelten strengere Anforderungen, weil Fehler gnadenlos sichtbar werden. Ein AI Upscaler sollte hier mit konservativen Einstellungen laufen, idealerweise mit Diffusionsmodellen für großformatige Reproduktionen. Arbeite in 16‑Bit, halte den gesamten Workflow farbverbindlich, und prüfe Raster- und Moiré-Interaktionen. Ein leichter Grain kann Wunder wirken, um Flächen “filmisch” zu halten und Banding zu kaschieren. Bevor du in die Druckerei läufst, misst du visuell mit 200–300 Prozent Zoom und instrumentell via LPIPS/SSIM und Farbfeldern. So vermeidest du den peinlichen Moment, wenn das Plakat wie ein Instagram-Filter aussieht.

Video-Upscaling ist ein eigenes Biest, denn zeitliche Konsistenz ist wichtiger als der letzte Pixel. Modelle wie EDVR, BasicVSR++ oder RealBasicVSR berücksichtigen temporale Informationen und vermeiden Flicker zwischen Frames. Für 1080p→4K oder 720p→4K sind diese Netze die Referenz, kombiniert mit Motion-Compensation und optionaler Frame-Interpolation (RIFE) bei niedriger Framerate. Encodingseitig fährst du mit AV1 oder HEVC solide, während H.264 als Fallback bleibt. FFmpeg integriert SR-Workflows über externe Skripte oder Pipes, und GPU-Pfade entscheiden über Durchsatz. Für Streaming musst du trotzdem Bitrate und Buffer unter Kontrolle halten, sonst killt dich die Latenz.

Qualitätsmessung und Governance: PSNR, SSIM, LPIPS, Farbmanagement, Rechte und Ethik

Wer qualitativ arbeitet, misst – und verlässt sich nicht auf Bauchgefühl. PSNR und SSIM sind schnelle Indikatoren, korrelieren aber begrenzt mit menschlicher Wahrnehmung. LPIPS und DISTS liefern bessere Annäherungen an visuelle Qualität, verlangen aber Referenzbilder. In der Praxis nutzt du einen Golden-Set-Katalog aus repräsentativen Bildern mit Ground Truth oder zumindest Standard-Konkurrenzmethoden. Für blind bewertete Szenarien sind MOS-Studien sinnvoll, auch wenn sie aufwendiger sind. Wichtig ist, dass du Metriken über Versionen vergleichbar machst und nicht bei jedem Modellwechsel deine Maßstäbe verschiebst.

Farbmanagement ist Governance in Reinform, denn ohne konsistente Farbräume sind Metriken wertlos. Arbeite intern in einem definierten Gamut (z. B. Display P3) und mappe am Ende in den Zielraum (Web: sRGB). Verwende eingebaute Profile, versiegle sie beim Export, und prüfe auf Systemebene, ob Browser oder Betriebssystem dein ICC korrekt respektieren. 8‑Bit ist für Web pragmatisch, aber 10‑Bit/16‑Bit im Workflow verhindert Quantisierungsfehler, die ein AI Upscaler gnadenlos verstärkt. Wenn du Farbkonstanz vernachlässigst, zerlegst du deine Bildserie in eine unbrauchbare Patchwork-Decke. Nichts senkt Vertrauen schneller als wechselnde Hauttöne zwischen Produktbildern.

Rechtlich und ethisch solltest du Klarheit schaffen, besonders bei Journalismus, Forensik und Kunst. Ein AI Upscaler kann Details halluzinieren und damit Beweise verfälschen, weshalb Kennzeichnung und Originalaufbewahrung Pflicht sind. Für redaktionelle Kontexte empfiehlt sich eine Policy: Original archivieren, Upscale-Varianten labeln, Metadaten mit Prozess- und Modellinfos ergänzen. In Werbekontexten reicht meist ein interner Audit-Trail, der Entscheidungen nachvollziehbar macht. Und nein, Gesichtsglättung ist keine “Qualitätssteigerung”, wenn das Ergebnis die Person verfremdet. Qualität bedeutet hier, die Intention und Integrität des Originals zu respektieren.

Tool-Stack und AI Upscaler Vergleich: Topaz, Photoshop, waifu2x, Cloud-Dienste, Open-Source

Topaz Gigapixel AI ist die schnelle Allzweckwaffe, liefert starke Ergebnisse bei Fotos und hat gute Presets für Gesichter, Architektur und Tiere. Die Batch-Funktion ist robust, die Schärfe oft mutig, deshalb lohnt ein weniger aggressives Preset plus eigenes Sharpening. Adobe Photoshop Super Resolution ist stabil im Ökosystem, schnell auf modernen GPUs und im RAW-Workflow sauber integriert. Für viele Teams ist das “gut genug”, vor allem wenn du ohnehin Camera Raw benutzt. Wer mehr Kontrolle will, landet früher oder später bei Open-Source und eigenen Modellen, weil Flexibilität schlicht wichtig ist.

Open-Source-Workflows mit Real-ESRGAN, SwinIR und GFPGAN laufen heute bequem über GUIs wie Automatic1111 oder nodebasierte Pipelines wie ComfyUI. Vorteil sind modulare Graphen, reproduzierbare Exporte und einfache Model-Swaps. Mit ONNX-Builds bringst du dieselben Modelle in Produktionsumgebungen, was eine Brücke zwischen Kreativ- und DevOps-Welt schlägt. Für Anime/Illustration bleiben waifu2x und Anime-fine-tuned ESRGANs schwer zu schlagen. Sie liefern bei Kanten und Flächen genau die Optik, die Fans erwarten, ohne Texturen unnötig zu “fotografisieren”. Diese Domänenpassung ist der eigentliche Geheimtipp für konsistente Qualität.

Cloud-Services wie Cloudinary, Imgix, Cloudflare Images oder Akamai Image Manager integrieren AI Upscaler zunehmend als Feature. Vorteil ist die Nähe zum CDN, was Response-Zeiten und Cache-Hits freundlich gestaltet. Du definierst Transformationen via URL-Parameter oder API und bekommst fertige Derivate in AVIF/WebP mit korrektem Profil. Im Enterprise-Kontext zählen SLAs, Observability und Kosten pro 1.000 Transformationen; rechnest du das gegen Studiozeiten, kommt schnell ein positiver ROI. Wer volle Kontrolle will, hostet imgproxy/Thumbor selbst und hängt ONNX-Inferenz an den Transform-Pfad. So bekommst du die gleiche Flexibilität ohne Vendor-Lock, zahlst aber mit eigener Betriebsverantwortung.

Schritt-für-Schritt-Playbook: Von kaputt zu knackscharf mit AI Upscaler

Ein AI Upscaler rettet keine Wunder, aber ein planvoller Ablauf macht aus mittelmäßigen Assets verwendbare Premium-Bilder. Zuerst sichtet dein Team Quelle, Artefakte und Zielkanal, denn Web-Thumbnail, Instagram-Story und 4K-Print haben unterschiedliche Ansprüche. Dann wählst du Modell und Faktor, immer mit einer Golden-Set-Preview, die Stakeholder abnicken. Plattformseitig stellst du sicher, dass Farbmanagement, Bit-Tiefe und ICC-Profile konsistent sind. Ohne diese Basics optimierst du ins Leere, egal wie smart dein Netz ist. Und ja, du dokumentierst alles, weil Reproduzierbarkeit sonst ein Wunschtraum bleibt.

- Discovery: Zieldefinition, Kanäle, Breakpoints, Qualitätsbudget, Metriken festlegen.

- Technik-Setup: Arbeitsfarbraum, 16‑Bit-Workflow, GPU/ONNX/TensorRT vorbereiten.

- Preprocessing: Denoise/Deblur, Farbraum normalisieren, optional Vor-Scaling.

- AI Upscaler: Modellwahl (Real-ESRGAN/SwinIR/GFPGAN), Faktor 2x/4x/8x, Parameter konservativ starten.

- Postprocessing: Edge-aware Sharpening, Grain-Reintroduktion, Halo- und Banding-Korrektur.

- Export & Delivery: AVIF/WebP, Profil einbetten, SRCSET/Client Hints, CDN-Caching.

- QA: Visuelle Checks, LPIPS/SSIM, Color-Patches, Seitenladezeiten und LCP kontrollieren.

- Iteration: Feedback einarbeiten, Presets versionieren, Automatisierung ausrollen.

Wenn du das Playbook sauber fährst, entsteht eine Pipeline, die messbar bessere Bilder bei stabilen Ladezeiten liefert. Teams arbeiten schneller, weil Presets und Golden Sets Klarheit bringen. Stakeholder diskutieren weniger über Geschmack und mehr über Metriken, was Projekte kalkulierbarer macht. Entwickler haben weniger Stress, weil Delivery und Caching planbar ist. Das Ergebnis sind Bilder, die wirken, ohne zu schreien. Genau das wollten wir doch.

Fazit: AI Upscaler als Qualitätsmotor – nicht als Wunderkerze

AI Upscaler sind kein Gimmick, sondern ein massiver Qualitätshebel entlang der gesamten Medienkette. Wer Modelle, Pipeline und Delivery im Griff hat, skaliert Bildqualität und Performance gleichzeitig. Das ist der Punkt, an dem Marketing nicht nur hübsch, sondern effizient wird. Und ja, du brauchst Technikdisziplin, sonst fährt dir das System vor die Wand.

Die Kombination aus Real-ESRGAN/SwinIR, sauberem Pre-/Postprocessing, AVIF-Delivery und observabler Produktion ist 2025 der nüchterne Standard. Alles andere ist Spielerei oder Glückstreffer. Wenn du jetzt anfängst, bist du den meisten schon voraus. Wenn nicht, skaliert dein Wettbewerb deine Bilder – und deinen Marktanteil gleich mit.