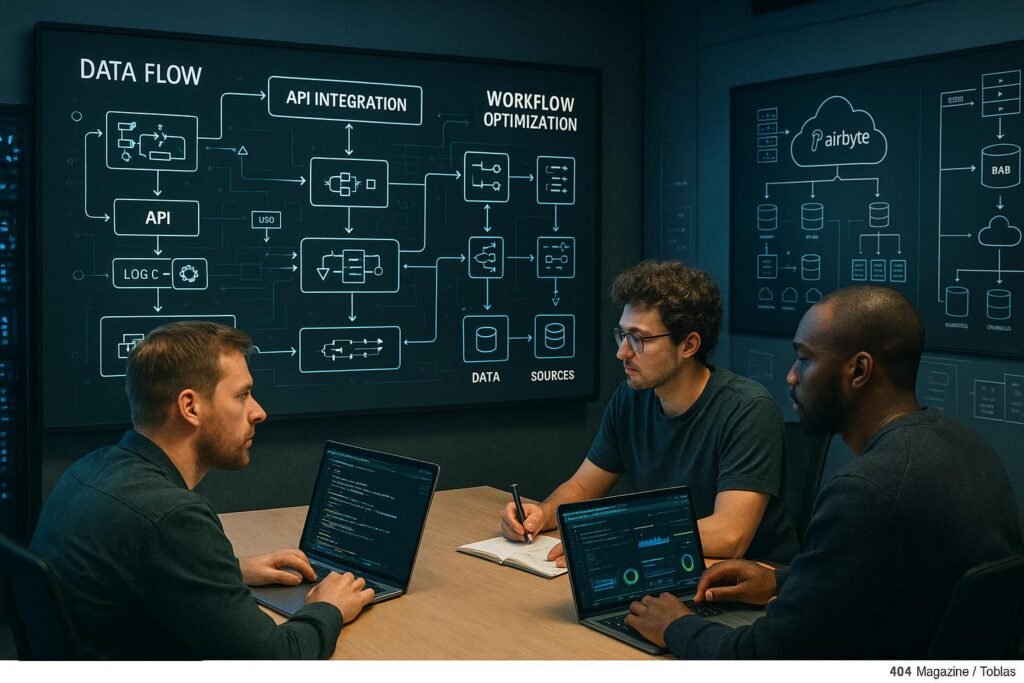

Airbyte Data Sync Pipelines Workflow: Clevere Meisterstrategien für effiziente Datenintegration

Wenn du denkst, dass Datenintegration nur ein weiteres technisches Ärgernis ist, dann hast du noch nicht die Kunst des Airbyte-Workflows gemeistert. Hier geht es um mehr als nur Daten kopieren – es ist eine strategische Disziplin, bei der jede Millisekunde zählt und jede Pipeline perfekt abgestimmt sein muss. Willkommen im Deep Dive, wo wir dir zeigen, wie du mit cleveren Workflow-Strategien und technischen Meisterleistungen das volle Potenzial deiner Data Sync Pipelines entfesselst.

- Was sind Airbyte-Data-Pipelines und warum sie der Schlüssel zur modernen Datenstrategie sind

- Die Architektur von Airbyte: Komponenten, Datenquellen, Destinations und Konnektoren

- Effiziente Workflow-Optimierung: Von der Planung bis zur Automatisierung

- Best Practices für Data Sync Pipelines: Fehlervermeidung, Monitoring und Skalierung

- Technische Tiefe: API-Integrationen, Datenformatierung, Handling von Datenkonflikten

- Tools und Automatisierung: Airbyte-Plugins, Orchestrierung, CI/CD in Data Pipelines

- Fallstricke und häufige Fehler: Was die meisten übersehen und wie man es besser macht

- Langfristige Strategien: Sicherheit, Datenschutz, Datenqualität und Performance

Wenn du dich bisher nur mit halbgarer Datenübertragung durch den Dschungel der ETL-Tools gekämpft hast, dann wird es Zeit, den Blick zu schärfen. Airbyte ist kein gewöhnliches Data-Integration-Tool. Es ist die flexible, offene Plattform, die dir erlaubt, komplexe Data Pipelines smarter, schneller und vor allem stabiler zu bauen. Doch der Schlüssel liegt nicht nur im Tool-Setup, sondern im Workflow-Design, der Automatisierung und der technischen Raffinesse. Wer hier nur auf „Next, Next, Finish“ klickt, der lässt wertvolle Daten auf der Strecke – und das in einer Zeit, in der Daten das neue Öl sind.

Was sind Airbyte-Data-Pipelines und warum sie der Schlüssel zur modernen Datenstrategie sind

Airbyte Data Pipelines sind im Grunde genommen automatisierte Datenflüsse, die es ermöglichen, Daten aus unterschiedlichsten Quellen zu extrahieren, zu transformieren und in Zielsysteme zu laden. Sie sind das Rückgrat jeder modernen Datenstrategie, weil sie Flexibilität, Geschwindigkeit und Kontrolle bieten. Im Gegensatz zu klassischen ETL-Tools, die oft monolithisch und schwer skalierbar sind, setzt Airbyte auf offene Schnittstellen, modulare Konnektoren und eine API-zentrierte Architektur. Das macht es möglich, Daten in Echtzeit, periodisch oder sogar eventbasiert zu synchronisieren.

Ein weiterer Vorteil: Airbyte lässt sich nahtlos in bestehende Data-Infrastructure-Stacks integrieren. Ob Cloud-Data Lakes, Data Warehouses oder On-Premise-Lösungen – die Plattform ist so flexibel, dass sie sich an jede Umgebung anpasst. Damit hast du die Kontrolle über den Datenfluss und kannst ihn genau auf deine Anforderungen abstimmen – ohne dich in unnötigen Komplexitäten zu verlieren. Es ist, als würde man mit einem Schweizer Taschenmesser arbeiten, das alle Werkzeuge in einem vereint – nur smarter.

Das Herzstück ist die Fähigkeit, heterogene Datenquellen zu verbinden, sie zuverlässig zu synchronisieren und im gleichen Atemzug Datenqualität, Konsistenz und Compliance zu gewährleisten. Wer hier nur auf manuelle Prozesse setzt, verliert nicht nur Zeit, sondern riskiert auch Fehler, die in der Produktion teuer werden können. Die Data Pipelines von Airbyte sind die Grundlage für datengetriebene Entscheidungen, automatisierte Workflows und letztlich für den digitalen Erfolg.

Die Architektur von Airbyte: Komponenten, Datenquellen, Destinations und Konnektoren

Airbyte basiert auf einer modularen Architektur, die aus mehreren Kernkomponenten besteht: Konnektoren, Scheduler, Orchestrator und Monitoring. Jeder Konnektor ist eine Art Schnittstelle, die entweder Daten ausliest (Source) oder in eine Zielplattform schreibt (Destination). Das Spannende: Die Konnektoren sind offen, erweiterbar und werden ständig durch die Community verbessert. Damit kannst du praktisch jede Datenquelle anbinden – von SaaS-Apps über Datenbanken bis hin zu Filesystemen.

Die Data Pipelines werden durch den Scheduler gesteuert, der entweder zeitgesteuert (z.B. alle 15 Minuten) oder ereignisbasiert (Webhook, API-Trigger) läuft. Der Orchestrator sorgt für die Koordination der einzelnen Schritte, inklusive Transformationen, Datenvalidierung und Fehlerhandling. Das Monitoring schließlich überwacht die Pipelines in Echtzeit und gibt dir sofort Rückmeldung bei Problemen.

Was die technische Tiefe betrifft: Airbyte nutzt APIs, um Daten zu extrahieren, unterstützt verschiedene Datenformate wie JSON, CSV, Parquet und Avro. Dabei sind Transformationsprozesse häufig in Form von SQL-Queries oder Python-Skripten eingebunden. Für komplexe Szenarien kannst du eigene Konnektoren entwickeln oder bestehende erweitern. Das macht das System extrem anpassbar – perfekt für Unternehmen mit individuellen Anforderungen.

Effiziente Workflow-Optimierung: Von der Planung bis zur Automatisierung

Ein smarter Workflow beginnt mit der klaren Planung der Datenflüsse. Definiere, welche Datenquellen du wann und wie regelmäßig synchronisieren willst. Nutze dafür die Automatisierungsfunktionen von Airbyte, um wiederkehrende Tasks ohne manuellen Eingriff laufen zu lassen. Wichtig: Dokumentiere deine Pipelines genau, damit du sie bei Änderungen schnell anpassen kannst.

In der Praxis empfiehlt es sich, folgende Schritte zu befolgen:

- Identifiziere kritische Datenquellen und priorisiere sie nach Geschäftswert

- Setze auf inkrementelle Synchronisationen, um Bandbreite und Ressourcen zu schonen

- Implementiere Fehlerbehandlung und Retry-Mechanismen, um Ausfälle zu minimieren

- Automatisiere Monitoring und Alerts, damit du bei Problemen sofort eingreifen kannst

- Nutze Versionierung für deine Konfigurationen, um Änderungen nachvollziehbar zu machen

Darüber hinaus solltest du regelmäßig Performance-Analysen durchführen, um Bottlenecks zu erkennen. Das bedeutet: Überwache die Latenzzeiten, Response-Codes und die Datenqualität. Mit diesen Insights kannst du deine Workflows kontinuierlich verbessern und auf wechselnde Anforderungen anpassen.

Best Practices für Data Sync Pipelines: Fehlervermeidung, Monitoring und Skalierung

Fehler in Data Pipelines sind nicht nur ärgerlich, sondern können auch katastrophale Folgen haben – von Datenverlust bis hin zu Compliance-Problemen. Deshalb gilt: Fehlervermeidung ist die oberste Maxime. Nutze Validierungsroutinen, Datenintegritätschecks und automatische Alarmierungssysteme.

Monitoring ist essenziell: Implementiere Dashboards, die dir Echtzeit-Status, Auslastung und Fehlerquellen anzeigen. Mit Tools wie Prometheus, Grafana oder integrierten Lösungen in Airbyte kannst du den Überblick behalten. Wichtig: Automatisiere auch die Skalierung deiner Pipelines, sobald das Datenvolumen wächst. Cloud-native Plattformen bieten hier flexible Ressourcen, die du nach Bedarf hoch- oder runterfahren kannst.

Weitere Tipps:

- Setze auf inkrementelle Updates, um Bandbreite zu sparen und die Effizienz zu erhöhen

- Implementiere Data-Validation-Checks nach jeder Pipeline-Phase

- Nutze Versionierung und Rollback-Mechanismen für Konfigurationen

- Automatisiere die Dokumentation aller Prozesse

- Integriere kontinuierliche Performance-Tests in den Workflow

Technische Tiefe: API-Integrationen, Datenformatierung, Handling von Datenkonflikten

In der Tiefe der Data Pipelines liegt die Kunst des technischen Geschicks. API-Integrationen sind das Rückgrat: REST, GraphQL, SOAP – alles möglich, alles machbar. Doch die Herausforderung liegt in der Handhabung unterschiedlicher Authentifizierungsmechanismen, Rate-Limits und Datenformaten. Hier solltest du auf robuste, wiederverwendbare Konnektoren setzen und API-Clients mit Retry-Logik versehen.

Beim Datenformat ist Flexibilität gefragt. JSON ist Standard, aber für große Datenmengen sind Parquet oder Avro effizienter. Transformationsprozesse sollten automatisiert und optimiert sein, um unnötigen Overhead zu vermeiden. Bei Konflikten – etwa doppelte Daten, widersprüchliche Werte oder veraltete Einträge – ist eine klare Strategie notwendig: Deduplication, Daten-Validierung und Konfliktauflösung in Vorfeld. Nur so bleibt deine Datenqualität hoch und deine Analysen valide.

Datenkonflikte sind der Killer jeder Pipeline. Mit intelligenten Checks, Versionierung und sauberen Migrationswegen kannst du sie frühzeitig erkennen und beheben. Automatisierte Tests, Logging und Alerting sind hier Pflicht, um im Fehlerfall schnell reagieren zu können. Das ist die technische Basis für stabile, zuverlässige Data Syncs, die den Unterschied zwischen Chaos und Kontrolle ausmachen.

Tools und Automatisierung: Airbyte-Plugins, Orchestrierung, CI/CD in Data Pipelines

Airbyte bietet eine Vielzahl an Plugins, die dir das Leben erheblich erleichtern. Von Standard-Konnektoren bis hin zu eigenen Entwicklungen – alles ist offen und erweiterbar. Für die Orchestrierung solltest du auf Tools wie Prefect, Apache Airflow oder Dagster setzen, die deine Pipelines steuern, automatisieren und überwachen.

CI/CD-Methoden (Continuous Integration / Continuous Deployment) spielen hier eine immer größere Rolle. Automatisiere Tests, Validierungen und Deployment-Prozesse für deine Data Pipelines, um Fehler frühzeitig zu erkennen und schnelle Iterationen zu ermöglichen. Versioniere Konfigurationen, Automatisiere Rollbacks bei Problemen und setze auf Infrastructure-as-Code (IaC), um deine Umgebung reproduzierbar zu machen.

Damit erreichst du eine nachhaltige, skalierbare Data-Infra, die auch bei steigendem Datenvolumen stabil bleibt. Die Automatisierung minimiert menschliche Fehler und erhöht die Geschwindigkeit – genau das, was du für eine erfolgreiche Data-Strategie brauchst.

Fallstricke und häufige Fehler: Was die meisten übersehen und wie man es besser macht

Viele scheitern an vermeintlich kleinen Details. Die häufigsten Fehler: unzureichendes Monitoring, fehlende Fehlerbehandlung, veraltete Konfigurationen und mangelnde Dokumentation. Besonders fatal: das Ignorieren von Datenqualität und -sicherheit. Schlechte Validierung, unzureichende Zugriffssteuerung und mangelhafte Verschlüsselung können your Data-Strategie schnell kippen.

Ein weiterer Klassiker: Nicht-automatisierte Tests und Deployment. Das führt zu Inkonsistenzen in den Pipelines, ungeplanten Downtimes und unerwarteten Fehlern. Auch das Nicht-Optimieren für Skalierung ist eine Falle: Datenmengen wachsen, aber die Pipeline bleibt starr – das endet in Flaschenhälsen und Verzögerungen.

Die Lösung: Setze auf robuste Automatisierung, regelmäßige Audits, klare Verantwortlichkeiten und eine Kultur des kontinuierlichen Lernens. Nur so kannst du langfristig stabile, performante und sichere Data Pipelines bauen.

Langfristige Strategien: Sicherheit, Datenschutz, Datenqualität und Performance

Ein nachhaltiger Data-Workflow braucht mehr als nur schnelle Pipelines. Sicherheit und Datenschutz sind Pflicht, nicht Kür. Verschlüsselung bei Übertragung und Speicherung, rollenbasierte Zugriffskontrollen und Audit-Logs sind unerlässlich. Besonders bei sensiblen Daten musst du die Compliance-Anforderungen (DSGVO, CCPA) immer im Blick haben.

Qualitätskontrolle ist ebenso wichtig: Automatisierte Validierungen, Data Lineage Tracking und Daten-Governance-Tools helfen, Fehler frühzeitig zu erkennen und zu beheben. Performance-Optimierungen wie Caching, Komprimierung und effiziente Abfragen sorgen dafür, dass deine Pipelines auch bei steigendem Datenvolumen performant bleiben.

Langfristig solltest du auf eine skalierbare Infrastruktur setzen, die Cloud-native, containerisiert und Infrastructure-as-Code basiert. Nur so kannst du flexibel auf neue Anforderungen reagieren, Kosten kontrollieren und eine hohe Verfügbarkeit sichern. Data Governance, Monitoring und Security sind die Säulen, auf denen dein Data-Ökosystem wächst und gedeiht.

Fazit: Wer die Workflow-Strategie in der Datenintegration nur dem Zufall überlässt, der verliert. Es ist die technische Meisterschaft, die den Unterschied macht – zwischen einer ineffizienten, fehleranfälligen Pipeline und einer robusten, skalierbaren Data-Engine. Wer hier investiert, gewinnt langfristig.

Wenn du heute noch glaubst, Datenintegration sei nur Technik für Nerds, dann hast du den digitalen Krieg schon verloren. Es ist Zeit, die Workflow-Strategien zu beherrschen, die Komplexität zu zähmen und mit cleveren Meisterleistungen das volle Potenzial deiner Data Pipelines zu entfesseln. Denn in der Welt von 404 Magazine gilt: Wer nicht mit der Zeit geht, wird vom Datenstrom mitgerissen.