Edge AI: Intelligenz am Netzwerkrand neu definiert

Cloud ist gut, aber die Party findet längst am Rand statt: Edge AI verlegt Rechenpower, Modelle und Entscheidungen dorthin, wo Daten entstehen – an Kameras, Gateways, Smartphones, Industriesteuerungen und PoPs von CDNs. Wer heute noch alles in die Cloud kippt, bezahlt mit Latenz, Kosten, Datenschutzrisiken und verpassten Chancen. In diesem Artikel zerlegen wir den Hype, erklären die Technik, legen Architekturen offen und zeigen, wie du Edge AI richtig baust, wartest und skalierst – ohne dabei dein Budget, deine Compliance oder deine Nerven zu ruinieren.

- Edge AI reduziert Latenz, Traffic-Kosten und Datenschutzrisiken, indem Inferenz direkt am Netzwerkrand erfolgt – von On-Device bis Near-Edge.

- Hardware matters: Von NPU über GPU und TPU bis TinyML auf Mikrocontrollern entscheidet die Plattform über Durchsatz, Energieverbrauch und Modellwahl.

- Optimierung ist Pflicht: Quantisierung, Pruning, Distillation und Runtime-Engines wie TensorRT, OpenVINO, Core ML und TFLite sind die Praxis-Werkzeuge.

- K3s, MicroK8s, Container, OTA-Updates und ein sauberes MLOps-Setup machen Edge-Flotten überhaupt erst betreibbar.

- Datenschutz und Sicherheit stehen im Zentrum: DSGVO, AI Act, Federated Learning, TEEs und Signaturen schützen Daten, Modelle und Nutzer.

- Web-Edge ist real: WebAssembly, WebGPU, WebNN und ONNX Runtime Web bringen Edge AI in Browser, PWAs und CDNs.

- Typische Fallstricke heißen Konzeptdrift, thermische Limits, instabile Netze, Log-Limitierungen und fehlendes Observability-Design.

- Edge AI ist kein Spielzeug für Demo-Decks, sondern ein skalierbares Muster mit harten SLOs, messbaren p95-Latenzen und echten Business-KPIs.

- Ein klarer Rollout-Plan mit A/B, Canary, sicheren OTA-Mechanismen und Device-Identity trennt robuste Deployments von Karriere-suizidalen Experimenten.

Edge AI ist mehr als nur ein Buzzword mit eingebautem Investorenzucker. Edge AI ist der nüchterne Gegenentwurf zum reflexhaften Cloud-Reflex, der jedes Byte und jede Entscheidung quer durch halbe Kontinente schiebt. Edge AI verlagert Inferenz dorthin, wo Daten entstehen, wo Millisekunden zählen, wo Bandbreite teuer ist und wo Datenschutz nicht verhandelbar bleibt. Edge AI ist damit nicht die Verneinung von Cloud, sondern ihr muskulöser Komplementär, der Workloads drosselt, die nie hätten wandern sollen. Wer Edge AI ignoriert, optimiert die falsche Seite der Gleichung.

Das Entscheidende an Edge AI ist die Architektur, nicht die Schlagzeile. Ohne saubere Pipeline von Datenerfassung über Preprocessing, Modellbereitstellung, Inferenz und Postprocessing bis hin zu Rückkanälen für Telemetrie und Retraining gleicht Edge AI einem Schrank voller Prototypen. Edge AI verlangt klare SLOs, definierte Latenzbudgets, Energie- und Wärmeprofile sowie eine Fleet-Strategie, die im Feld funktioniert. Edge AI heißt auch: Modelle schrumpfen, Daten bleiben lokal, Entscheidungen fallen deterministisch genug, um auditierbar zu sein. Wer damit nicht anfangen kann, sollte erst messen und dann codieren.

Edge AI ist kein Heilsbringer. Edge AI verschiebt nur die Schmerzen: von Cloud-Rechnung und Netzwerk-Lags hin zu Hardware-Constraints, OTA-Risiken und lebensnotwendigem Observability. Edge AI zwingt dich, dich mit NPUs, quantisierten Gewichten, Gateways, MQTT, K3s, TPMs, attestierten Updates und einer MLOps-Story auseinanderzusetzen. Edge AI macht dich schneller, günstiger und datenschutzfreundlicher – sofern du bereit bist, die Technik ernst zu nehmen. Wenn nicht, bleib bei der Cloud und budgetiere die Latenz mit ein. Deine Nutzer werden es merken, deine Wettbewerber auch.

Edge AI Grundlagen: Definition, Architektur und warum Latenz tötet

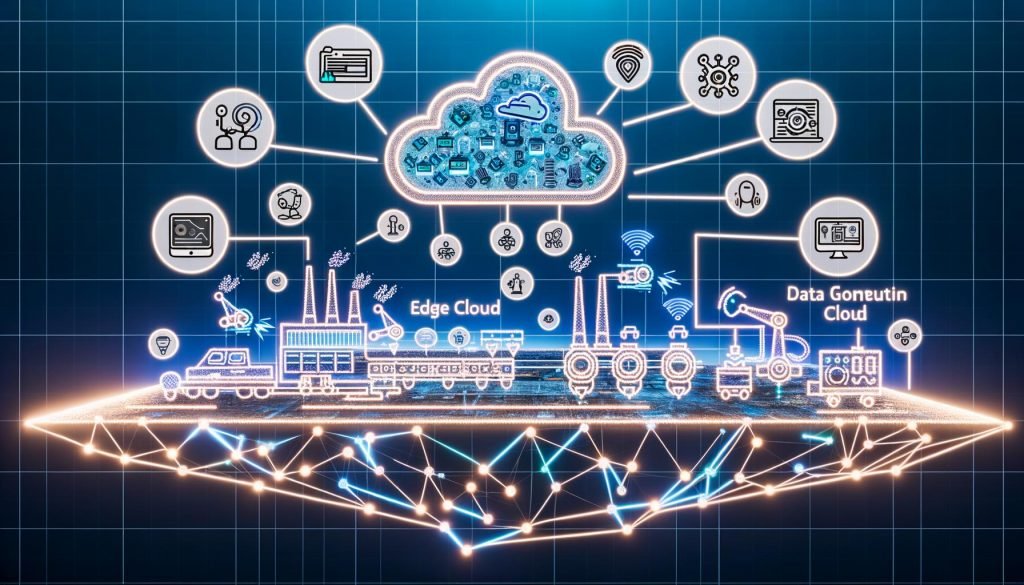

Edge AI bezeichnet die Ausführung von KI-Inferenz am Netzwerkrand, also dort, wo Daten entstehen, statt zentral in Rechenzentren. Das Spektrum reicht von On-Device-AI auf Mikrocontrollern und Smartphones über Gateway-Edge in Fabriken bis zum Near-Edge in PoPs eines CDN. Diese Topologie hat klare Vorteile: weniger Roundtrips, niedrigere Latenz, geringere Bandbreitenkosten, höhere Verfügbarkeit und bessere Datenhoheit. Die Grundarchitektur umfasst Sensoren, eine Edge-Compute-Einheit, eine Runtime für Modelle, ein lokales Messaging-Backbone und einen optionalen Sync in die Cloud für Telemetrie. Im Zentrum steht die Inferenz-Engine, die die Modelle in Formate lädt, die auf der Zielhardware effizient laufen. Edge AI ist nicht zwingend offline, aber es muss offlinefähig sein, sonst ist es kein Edge, sondern ein riskanter Remote-Desktop mit Marketing-Schild.

Eine saubere Edge-AI-Pipeline beginnt mit Datenerfassung und Preprocessing, oft unter Echtzeitanforderungen. Kameras erzeugen Videostreams, Mikrofone Audiospektren, Vibrationssensoren Zeitreihen; alle benötigen Filtering, Normalisierung und Pufferung. Dann folgt die Modellinferenz, die nach Möglichkeit strikt deterministisch und innerhalb eines p95-Latenzbudgets bleibt. Postprocessing extrahiert Ereignisse, Bounding Boxes, Labels, Scores und liefert Entscheidungen an Aktoren oder Anwendungen. Ein lokaler Eventbus wie MQTT oder NATS entkoppelt Komponenten und verhindert monolithische Abhängigkeiten. Telemetrie erfasst Latenzen, Throughput und Fehlerraten, aber auch Temperatur und Energieverbrauch, damit das System sich selbst nicht ausbremst.

Architekturell unterscheiden wir zwischen Hot Path und Cold Path. Der Hot Path ist die Echtzeitstrecke, auf der das Modell inferiert, Entscheidungen trifft und unmittelbar reagiert. Der Cold Path kapselt Batch-Übertragungen, Modell-Feedback, Retraining-Signale sowie eventuell aggregierte Statistiken in die Cloud. Diese Trennung ist kein Luxus, sondern ein Stabilitätsanker, denn Datenspikes, Funklöcher oder Cloud-Ausfälle dürfen niemals den Hot Path verstopfen. Edge AI verlangt außerdem klare Zustandsmodelle: was passiert bei Paketverlusten, Clock-Drifts, Neustarts oder Modellinkompatibilitäten. Ein Edge-System ohne definierten Degradationsmodus ist unsicher, unzuverlässig und im Ernstfall teuer. Latenz tötet Features, und deterministische Pfade retten Produkte.

Technisch brauchst du eine Runtime-Strategie, die zur Plattform passt. Auf MCU-Level laufen TinyML-Modelle oft direkt im Bare-Metal- oder RTOS-Kontext, auf SBCs und Gateways dominieren Linux, Container und Hardwarebeschleuniger. APIs wie ONNX Runtime, TensorFlow Lite, Core ML oder OpenVINO liefern Portabilität, doch Treiber und Kernel-Implementierungen entscheiden über echte Performance. Datenpfade müssen zero-copy sein, Buffersharing zwischen Kamera, Preprocessor und Inferenz spart Millisekunden. Scheduling beeinflusst Stabilität: Pinne Threads, isoliere Kerne, setze Realtime-Prioritäten nur dort, wo sie nötig sind. Edge AI ist am Ende Systemengineering, nicht nur ein hübsches Notebook mit einem Modell, das lokal gerade so läuft.

Hardware für Edge AI: NPU, GPU, TPU, MCU, TinyML und Beschleuniger

Wer Edge AI ernst meint, muss Hardware lesen können. NPUs (Neural Processing Units) liefern spezialisierte Matrix-MULs, geringere Latenz und hohe Effizienz bei INT8- oder sogar INT4-Repräsentationen. GPUs sind flexibel, stark bei FP16/FP32 und vielseitig, brauchen aber mehr Energie und thermische Reserven. TPUs oder Tensor-ASICs wie Google Coral/Edge TPU sind brutal schnell bei bestimmten Operatoren, aber abhängig von Compiler-Stacks und Modelldialekten. MCUs mit DSP-Erweiterungen ermöglichen TinyML mit Mikroampere-Budgets, aber mit harten Limits bei Speicher, Modellgröße und Operatorabdeckung. Die Auswahl entscheidet, welche Modelle überhaupt praktikabel sind, und sie bestimmt deine Optimierungspfade. Ohne realistische Power- und Wärmeprofile wird jede Benchmark zur Lüge.

Konkrete Plattformen setzen den Rahmen für die Runtime. NVIDIA Jetson kombiniert CUDA, Tensor Cores und TensorRT und eignet sich für Vision-Workloads mit hohem Durchsatz. Intel Movidius Myriad X über OpenVINO ist stark für beschleunigte Vision, allerdings mit spezifischer Operatorabdeckung. Google Coral bietet spitzen INT8-Inferenz mit Edge TPU, verlangt aber quantisierte, kompatible Modelle. ARM Ethos-N und Qualcomm Hexagon DSP/HTP integrieren Edge-Beschleunigung direkt in mobile SoCs und sind via NNAPI nutzbar. Apple Neural Engine spielt im iOS-Ökosystem über Core ML stark auf, liefert aber proprietäre Pfade. Wer Multi-Vendor-Strategien fährt, muss mit ONNX und Compiler-Toolchains wie TVM Flexibilität zurückerobern – und zahlt mit Integrationsaufwand.

Energie, Temperatur und Formfaktor sind keine Nebensächlichkeiten. Eine Gate-Kamera, die im Sommer thermal throttelt, liefert p95-Latenzen, die jede SLA sabotieren. Kühlkonzepte, Gehäuse, Luftströmungen und Staubfilter spielen plötzlich im Data-Science-Projekt mit. Edge AI im Fahrzeug braucht Automotive-Grade-Temperaturen, Vibrationsfestigkeit und eine Bordnetzstrategie. Battery-betriebene Sensoren fordern Edge-Algorithmen, die Sleep-Zyklen respektieren und Wake Words oder Anomalieerkennung extrem effizient umsetzen. Die besten Modelle sind wertlos, wenn die Hardware sie im Feld nicht dauerhaft tragen kann.

Die knallharte Wahrheit: Du wirst Kompromisse eingehen. Operatoren fehlen, Treiber sind buggy, Compiler haben Eigenheiten, die Dokumentation ist optimistisch. Deshalb braucht jede Hardwareentscheidung ein POC mit echten Daten, realen Lasten und Messungen von Installationszeit, Bootdauer, Idle-Verbrauch, Kaltstart-Latenz und Fehlerverhalten. Dabei zählen nicht nur Tops: Du brauchst Worst-Case-Profile, p99-Latenzen, thermische Sättigung und Verhalten bei gedrosselter Taktung. Nur wer die Hardware unter Stress sieht, kann Edge AI mit geradem Rücken verantworten.

Modelle und Optimierung: Quantisierung, Pruning, Distillation und Runtime-Engines

Modelle sind am Rand kleiner, härter optimiert und gnadenlos pragmatisch. Quantisierung reduziert Gewichte von FP32 auf INT8 oder INT4 und spart Speicher, Bandbreite und Rechenzeit. Post-Training Quantization (PTQ) ist schnell, aber weniger präzise, während Quantization-Aware Training (QAT) Genauigkeit zurückholt, indem es Quantisierungsfehler im Training simuliert. Pruning entfernt unwichtige Gewichte oder ganze Kanäle, strukturiertes Pruning ist hardwarefreundlicher als unstrukturiertes, weil es besser von Kernels genutzt wird. Knowledge Distillation überträgt Wissen eines großen Teacher-Modells an ein kleineres Student-Modell und rettet Genauigkeit bei geringerer Komplexität. Compression ist kein optionales Add-on, sondern das Eintrittsticket für Edge AI, wenn du Latenzbudgets ernst nimmst.

Runtime-Engines entscheiden über echte Geschwindigkeit. TensorRT kompiliert Graphen, fusioniert Operatoren, plant Speicher und nutzt FP16/INT8 auf NVIDIA-Hardware maximal aus. OpenVINO beschleunigt auf Intel-CPUs, iGPUs und Myriad-basierten NPUs mit umfangreichen Post-Training-Optimierungen. Core ML konvertiert Modelle für Apple-Chips und ermöglicht die Apple Neural Engine, inklusive sicheren Enclave-Pfaden für sensible Daten. TensorFlow Lite liefert portable Inferenz auf ARM/Android mit XNNPACK-Beschleunigung und NNAPI-Offload. ONNX Runtime ist das neutrale Rückgrat, das via Execution Provider von TensorRT bis OpenVINO hardwareübergreifend beschleunigt, sofern das Operator-Set passt. Das Ökosystem ist fragmentiert, und genau deshalb ist ein sauberer Build- und Testprozess über alle Zielplattformen Pflicht.

Architekturen müssen zum Edge passen. MobileNetV3, EfficientNet-Lite, Nano/Small-Varianten von YOLO, Fast-SCNN für Semantik, DistilBERT oder MobileBERT für NLP und Whisper-tiny/int8 für On-Device-Spracherkennung sind etablierte Kandidaten. Sequenzen werden in Fenster geschnitten, Streaming-Inferenz vermeidet lange Lagen, und Caching von Key/Values macht kleine Transformer brauchbar. Feature-Extraktion via Mel-Spectrogram und Per-Channel-Normalisierung stabilisieren Audio-Modelle, während Vision-Modelle von letterboxing, Kalibrierung und festen Input-Shapes leben. Variabilität kostet Performance, deterministische Input-Pfade zahlen sich am Rand aus. Wer alles dynamisch halten will, soll auch die Latenz dynamisch in Kauf nehmen.

Evaluation muss Edge-realistisch sein. Miss nicht nur Top-1-Accuracy, sondern auch p95-Latenz, Energy-per-Inference, RAM-Footprint, Start-up-Latenz und Warm/Cold-Start-Unterschiede. Kalibriere für Quantisierung mit Distributionen aus dem Feld, nicht mit sauber sortierten Labordaten. Messe Robustheit gegenüber Beleuchtungswechseln, Rauschen, Kompression, Motion Blur, Dialekten oder Maschinenlärm, je nach Use Case. Logge Confidence-Drifts und vergleiche Score-Verteilungen nach Updates, sonst fliegen dir stille Regressions um die Ohren. Das beste Modell ist das, das im Feld konstant genug liefert, um Entscheidungen zu tragen – nicht das, das in deinem Notebook den schönsten Plot hatte.

Edge AI Infrastruktur: Deployments, Container, K3s/K3sup, OTA und MLOps am Rand

Edge AI ist kein Einzelfall, sondern eine Flotte. Containerisieren ist Standard, weil du damit Abhängigkeiten einfrierst, Treiber sauber layerst und Upgrades reproduzierbar ausrollst. K3s oder MicroK8s bringen Kubernetes-Patterns an den Rand, inklusive Deployment, Service, Secret- und Config-Management. Nicht jede Edge-Box braucht volles K8s, aber ein orchestriertes Lebenszyklus-Management spart später Monate. Für Geräte ohne Container bleibt Systemd mit sauber isolierten Services, Watchdogs und Read-only-Root-Filesystemen eine robuste Option. OTA-Updates sind der Herzschlag, und signierte Artefakte, Version-Pinning, Rollback-Slots und Staging-Kanäle sind keine Kür, sondern Pflicht.

Messaging und Datenflüsse müssen lokal resilient sein. MQTT ist der bewährte Lightweight-Bus für Edge-Events, QoS 1/2 sichern Zustellung auch bei Netzflattern. NATS bietet schnelles Pub/Sub mit geringen Latenzen und ist stark für Microservices am Rand. Persistenz braucht einen pragmatischen Ansatz: SQLite oder RocksDB sind robust für lokale Caches und Feature-Stores, während Timeseries lokal gepuffert und später gebündelt synchronisiert werden. Kafka/Redpanda am Edge ist möglich, aber meist Overkill, wenn Ressourcen knapp sind. Wichtiger ist eine klare Backpressure-Strategie, damit Inferenz nicht von Telemetrie blockiert wird. Wer Hot und Cold Path nicht trennt, baut Trojaner in sein eigenes System.

Observability entscheidet über Betriebskosten. Du brauchst Metriken (Prometheus/OpenMetrics), Logs (lokal gedrosselt, remote aggregiert) und Traces, zumindest für Hot-Path-Abschnitte. Sampling verhindert Logfluten, während Edge-aggregierte Statistiken die Cloud entlasten. Geräte-Identität via TPM/PKI, mTLS zwischen Diensten, sichere Boot-Ketten und Remote Attestation schützen vor Supply-Chain-Angriffen. Ein Model Registry (MLflow, Sagemaker, Vertex AI oder self-hosted) hält Versionen, Metadaten, Artefakte und Signaturen zusammen. Ohne durchgängige IDs für Build, Modell, Konfiguration und Gerät bist du im Incident mit leeren Händen. Edge AI ohne Observability ist eine Blackbox, die im Feld zufällig funktioniert – bis sie es nicht mehr tut.

Rollout braucht Disziplin und Checklisten. Erst Staging-Lab, dann Limited-Pilot, dann Canary, dann Wellen. Feature-Flags sorgen für kontrollierte Aktivierung, Blue/Green oder A/B testen reale Effekte. Rollbacks müssen automatisiert und schnell sein, weil Edge-Teams nicht überall gleichzeitig sein können. Validierungen am Gerät prüfen nach dem Update Kompatibilität von Treibern, Modellen und Konfiguration. Telemetrie nach Rollout überwacht p95/p99, Fehlerraten, Temperatur und Energie. Wer ohne diese Sicherungen losläuft, betet oder hat einen sehr kurzen Zeithorizont.

- Schritt 1: Definiere SLOs (p95-Latenz, Energie, Verfügbarkeit) und messbare KPIs.

- Schritt 2: Wähle Hardware auf Basis echter POCs, nicht Datenblätter.

- Schritt 3: Containerisiere Runtime und Inferenz, friere Treiberstände ein.

- Schritt 4: Richte K3s/MicroK8s oder systemd-Services mit Watchdogs ein.

- Schritt 5: Implementiere OTA mit Signaturen, Canary und automatischem Rollback.

- Schritt 6: Etabliere Model Registry, CI/CD, Versionierung und Artefakt-Hashes.

- Schritt 7: Baue Observability mit Metriken, Logs, Traces und Gesundheitschecks.

- Schritt 8: Teste Degradationsmodi, Netzausfälle, Thermik und Neustarts.

- Schritt 9: Rolle in Wellen aus, überwache, iteriere, dokumentiere.

Datenschutz, Sicherheit und Compliance: DSGVO, AI Act, Federated Learning und Confidential Computing

Edge AI ist Datenschutz aus der Architektur heraus. Daten bleiben lokal, nur anonymisierte Aggregate oder Ereignisse verlassen das Gerät. Das reduziert Angriffsflächen, erleichtert DSGVO-Konformität und senkt Risiken bei PII. Privacy-by-Design heißt: Data Minimization, lokale Pseudonymisierung, kurze Retention und klare Zugriffspfade. Für sensible Workloads gilt: Verschlüsselung at rest (z. B. dm-crypt), in transit (mTLS), im Speicher so wenig wie möglich und mit Schutzmechanismen wie Memory Tagging, wenn die Plattform es hergibt. Audit-Logs dokumentieren Entscheidungen und Modellversionen, damit Nachvollziehbarkeit nicht zur Legende wird.

Der AI Act verlangt Risikoklassifizierung, Transparenz und Governance. Edge-Entscheidungen müssen erklärbar genug sein, um Audits zu überstehen, besonders bei Hochrisikoanwendungen. Das bedeutet, Feature-Attributionsverfahren wie Grad-CAM, Integrated Gradients oder SHAP lokal oder near-edge bereitzuhalten, zumindest für Stichproben oder Debug-Fälle. Model Cards und Data Sheets gehören ins Repository und werden mit ausgeliefert. Consent-Management bindet Edge-Pipelines an rechtliche Grundlagen, insbesondere bei Audio/Video-Workloads. Wer Privacy in Presales-Folien statt in Code abbildet, landet schnell im Compliance-Schmerz.

Federated Learning ist die elegante Antwort auf Datenhoheit. Modelle werden zentral initialisiert, lokal trainiert und nur Gradienten oder Gewichts-Updates aggregiert (FedAvg, FedProx). Differential Privacy und Secure Aggregation verhindern, dass einzelne Beiträge rekonstruiert werden. In Kombination mit On-Device-Feature-Engineering entsteht ein Lernkreislauf ohne zentrale Datenablage. Nicht jedes Problem braucht FL, aber bei heterogenen, sensiblen Daten ist es oft der einzige skalierbare Weg. Beachte, dass FL Bandbreite spart, aber strenge Versionierung, Zeitsynchronisation und striktes Client-Health-Checking verlangt.

Confidential Computing und TEEs (z. B. Intel SGX, ARM TrustZone) sichern Modelle und Schlüssel gegen physischen Zugriff. Remote Attestation stellt sicher, dass nur authentische Software auf authentischer Hardware läuft. Signierte OTA-Updates mit Verify-before-Activate reduzieren Brick-Risiken und Supply-Chain-Angriffe. Model Watermarking und Fingerprinting helfen, Leaks zu identifizieren, ohne echte Sicherheit zu ersetzen. Zero Trust am Edge bedeutet: Jede Verbindung ist misstrauisch, jedes Gerät hat eine Identität, jedes Artefakt ist verifizierbar. Sicherheit ist hier kein Projekt, sondern ein Zustand, den du täglich verteidigst.

Web-Edge und Marketing-Perspektive: WebAssembly, WebGPU, PWAs und Analytics ohne Tracking-Desaster

Edge AI passiert auch im Browser. WebAssembly (WASM) bringt native Performance ins Web, während WebGPU den Zugriff auf moderne Grafik- und Compute-Pipelines öffnet. ONNX Runtime Web und TensorFlow.js machen Modelle im Client ausführbar, ganz ohne Server-Roundtrip. WebNN standardisiert den Zugriff auf lokale Beschleuniger, sobald Implementierungen reifen. Das ist keine Spielerei, sondern eine Antwort auf Privacy-Restriktionen, Cookieless-Realitäten und Performance-Anforderungen. On-Device-Personalisierung erlaubt Ranking, Creative-Optimierung und Content-Selektion, ohne Nutzerdaten den Rechner zu verlassen. Das Ergebnis sind schnellere Erlebnisse und rechtlich entspanntere Analytics.

PWAs mit Service Workern, lokalem Cache und Hintergrundsync kombinieren Edge AI mit robusten Offline-Fähigkeiten. Ein Beispiel: Der Browser klassifiziert Frames lokal, speichert nur Ereignisse und sendet aggregierte Metriken, wenn eine Verbindung steht. Kreativ-Engines adaptieren Visuals, Copy und Reihenfolge ohne RTT zur Cloud. In Commerce-Setups priorisiert ein on-device Recommender lokale Session-Signale, während die Cloud später lernt. Marketing redet gerne über Personalisierung, liefert aber oft zähe Roundtrips und krachende CMPs. Edge AI im Web dreht das Verhältnis um: schnell, lokal, rechtsnah – und endlich messbar sinnvoll.

Edge in der CDN-Schicht verschiebt Compute in PoPs weltweit. Cloudflare Workers, Fastly Compute@Edge oder Vercel Edge Functions führen Lightweight-Inferenz oder Preprocessing nahe am Nutzer aus. Das ist kein Ersatz für On-Device, aber ein mächtiger Near-Edge-Booster für Latenz und Datenschutz. Modelle können verdichtet oder als Feature-Filter laufen, bevor Daten in die Zentrale gehen. Kombiniert mit KV-Stores, Durable Objects oder Edge Caches entstehen Architekturen, die Skalierung elegant verteilen. Wer Performance ernst meint, muss diese Ebene mitdenken, statt alles auf eine monolithische Region zu werfen.

Für Marketer zählt am Ende der Lift, nicht der Lyrik-Level des Techblogs. Edge AI verkürzt Time-to-First-Action, steigert Mikrokonversionsraten, reduziert Bounce, spart Cloud-Kosten und schafft Spielräume bei Consent. Attribution wird robuster, weil weniger Tracking-Noise entsteht und Entscheidungen konsistenter werden. A/B auf Edge-Ebene liefert schnellere Signale und verhindert, dass Netzwerk-Zufälligkeiten Experimente verzerren. Wer diese Effekte messen will, definiert SLOs für Experience, nicht nur CTRs. Der Unterschied zwischen Buzzword und Budget-Effekt ist ein sauberer Edge-Stack.

Use Cases und Fallstricke: Von Vision über Sprache bis Betrugserkennung

Industrielle Qualitätssicherung ist der Klassiker: Kameras erfassen Produkte, Edge AI detektiert Defekte in Millisekunden, und Aktoren sortieren aus. Der Hot Path toleriert keine Cloud-Latenz, die Produktion auch nicht. Retail nutzt Edge Vision für Planogramm-Checks, Out-of-Stock-Erkennung und Warteschlangenmanagement – ohne personenbezogene Daten zu speichern. Im Fahrzeug überwacht Driver Monitoring Aufmerksamkeit und Müdigkeit, streng unter Echtzeit- und Safety-Anforderungen. Akustische Anomalieerkennung hört Maschinen zu und meldet Abweichungen, lange bevor etwas bricht. Edge NLP versteht Wake Words, Kommandos und Seriennummern lokal, statt jedes Flüstern in die Cloud zu streamen.

Im Finanzbereich erkennt Edge AI an POS-Terminals Anomalien, bevor Transaktionen an zentrale Systeme gehen. In Healthcare-Setups segmentieren Geräte Bilder vor, prüfen Plausibilität und senden nur relevante Ausschnitte verschlüsselt weiter. Smart Cities aggregieren Edge-Events, klassifizieren Verkehr in Echtzeit und priorisieren Notfälle, ohne individuelle Bewegungsprofile zu erzeugen. Medien-Apps komprimieren und transkodieren intelligent am Rand, wählen Bitraten und Modelle dynamisch. Das Spektrum ist breit, die gemeinsamen Nenner sind Latenz, Bandbreite, Datenschutz und Resilienz. Edge AI ist dort stark, wo das Jetzt zählt.

Fallstricke liegen überall, nicht nur im Code. Konzeptdrift sorgt dafür, dass Modelle im Feld langsam verblöden, wenn sich Umgebungen ändern: andere Beleuchtung, neue Maschinen, neue Betrugsmuster. Ohne Monitoring der Score-Verteilungen und ohne Ghost-Labels rutscht Qualität unbemerkt weg. Thermik killt Performance, wenn Kühlung unterschätzt wird, und Interferenzen bringen Funkverbindungen ins Wanken. Logging ohne Drosselung verstopft Speicher, und ungezügelte Telemetrie frisst die Bandbreite, die du einsparen wolltest. Das sind keine hypothetischen Probleme, sondern die Alltagsrealität in Edge-Flotten.

Die Gegenmittel sind boring und brillant. Definiere Data Contracts für Input-Streams und prüfe sie am Edge, bevor du inferierst. Logge nur Ereignisse und Statistiken, die du wirklich brauchst, und nutze Lossy-Compression für Rohdaten-Samples. Richte Shadow-Deployments ein, bei denen ein neues Modell am Edge mitläuft, aber keine Entscheidungen trifft, um driftende Effekte zu erkennen. Nutze Canary-Prozente und harte Abort-Kriterien für OTA. Baue eine kleine, robuste Feedbackschleife für kuratierte Samples, damit Retraining Daten aus der echten Welt sieht. Edge AI funktioniert, wenn du dich um die unglamourösen Teile kümmerst.

Und ja, Metriken müssen wehtun. p95/p99 statt Durchschnitt, SLO-Violation Budgets statt “läuft bei mir”, Energie pro Inferenz statt nur FPS, RAM-Footprint unter Stress statt Idle. Jedes Update braucht Release Notes mit Metrikvergleich, Operator-Änderungen und Validierungsstrategie. Ohne diese Disziplin bist du ein Hobbyist mit Firmenkreditkarte. Mit ihr baust du eine Edge-Organisation, die zuverlässig liefert, skaliert und auditierbar bleibt. Der Unterschied zeigt sich im Feld, nicht in der Folie.

Edge AI ist keine Mode – es ist die logische Antwort auf die Physik des Netzes, die Ökonomie von Bandbreite und die Politik der Daten. Wer die Cloud nicht mehr als Default, sondern als Werkzeug betrachtet, baut Systeme, die schneller, günstiger und vertrauenswürdiger sind. Der Weg dorthin ist technisch, unbequem und gespickt mit Entscheidungen, die sich nicht delegieren lassen. Aber er lohnt sich, weil Produkte entstehen, die im Hier und Jetzt performen, statt im Datencenter hübsch auszusehen. Edge AI bringt Intelligenz dorthin, wo sie gebraucht wird, nicht dorthin, wo sie gerade billig zu rechnen ist.

Wenn du Edge AI ernst nimmst, strukturiere, miss und automatisiere. Baue Runtimes, die portabel sind, Modelle, die komprimiert sind, und Deployments, die sicher reversibel sind. Schaffe Observability, der du vertraust, und Security, die Angriffe vorausdenkt. Den Rest erledigen Physik und Nachfrage für dich. Und falls du dich fragst, ob sich das alles lohnt: Schau auf Latenz, Conversion, Support-Tickets und Cloud-Rechnung. Die Antwort steht bereits dort, in nüchternen Zahlen – genau da, wo Marketing aufhört und Engineering beginnt.