Dataframes Pipeline: Effiziente Datenströme clever gestalten

Du glaubst, du hast Daten im Griff, nur weil du irgendwo mal ein CSV in ein Dataframe gekippt hast? Willkommen in der Realität der modernen Datenströme: Wer 2024/2025 mit Dataframes Pipelines nicht aufgeräumt, modular und skalierbar arbeitet, produziert bestenfalls Datenmüll und schlimmstenfalls einen digitalen Rohrbruch. In diesem Artikel bekommst du den kompromisslos ehrlichen Deep Dive, wie du mit Dataframes Pipelines Datenströme baust, die mehr liefern als nur Feigenblatt-ETL – von Architektur über Performance bis zu den fiesesten Bottlenecks. Schluss mit Bastellösungen und Copy-Paste-Skripten: Hier kommt das Handbuch für Datenfluss-Profis.

- Was eine Dataframes Pipeline wirklich ist – und warum sie mehr als nur ein Pandas-Workflow ist

- Die wichtigsten Bausteine effizienter Datenströme mit Dataframes Pipelines

- Welche Tools und Frameworks 2025 wirklich skalieren – von Pandas bis Spark

- Warum schlechte Architektur in der Pipeline zum Daten-Desaster wird

- Wie du Dataframes Pipelines modular, testbar und wartbar gestaltest

- Step-by-Step: Aufbau einer robusten Dataframes Pipeline, die auch morgen noch läuft

- Fehlerquellen, Performance-Killer und Best Practices für produktive Datenströme

- Warum “Nur mal eben schnell” der Tod jeder Dataframes Pipeline ist

- Fazit: Datenströme sind kein Kindergeburtstag – so hebst du sie aufs nächste Level

Dataframes Pipeline – das klingt nach Buzzword-Bingo aus der Data-Science-Hölle? Mag sein. Aber wer glaubt, dass ein Dataframe und ein paar Zeilen ETL-Code reichen, um aus Big Data echten Business Value zu machen, der hat die letzten Jahre verpennt. Moderne Dataframes Pipelines sind das Fundament für effiziente, skalierbare und kontrollierbare Datenströme – egal, ob du mit Pandas, Spark oder Dask hantierst. Und weil der Datenwahnsinn 2025 garantiert nicht kleiner wird, sondern exponentiell wächst, ist jetzt der Zeitpunkt, deine Pipeline-Architektur auf Linie zu bringen. Sonst bist du morgen nur noch Zuschauer, wenn die Konkurrenz mit automatisierten, optimierten Datenströmen an dir vorbeizieht.

Was macht eine Dataframes Pipeline aus? Es geht um mehr als nur Daten von A nach B zu schaufeln. Es geht um Transformation, Validierung, Fehlerkontrolle, Parallelisierung, Wiederholbarkeit – und vor allem um Transparenz. Wer hier improvisiert, landet früher oder später im Datenchaos: Nullwerte, inkonsistente Typen, Speicherfresser und Performance-Kollaps inklusive. Die gute Nachricht: Mit den richtigen Konzepten und Tools kannst du Dataframes Pipelines bauen, die robust, schnell und zukunftsfähig sind. Die schlechte Nachricht: Das erfordert Disziplin, technisches Know-how und die Bereitschaft, alte Zöpfe abzuschneiden.

In diesem Artikel zerlegen wir das Thema Dataframes Pipeline bis aufs Byte: Was sind die Must-Haves, wie vermeidest du die typischen Fehler, welche Tools spielen 2025 in der ersten Liga – und warum ist “Nur mal schnell ein Skript schreiben” der größte Feind produktiver Datenströme? Willkommen bei der hässlichen Wahrheit. Willkommen bei 404.

Was ist eine Dataframes Pipeline? Mehr als nur Pandas und ein bisschen ETL

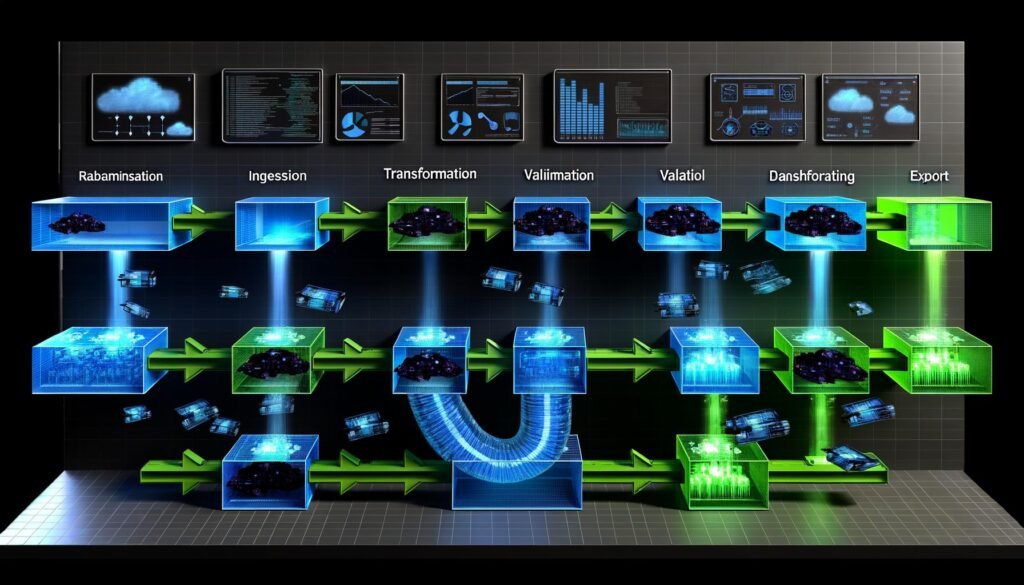

Dataframes Pipeline – klingt schick, ist aber kein Selbstzweck und schon gar kein weiteres Buzzword im Data-Engineering-Zirkus. Im Kern steht eine Dataframes Pipeline für einen durchstrukturierten, modularisierten Datenverarbeitungsprozess, in dem Daten in Form von Dataframes Schritt für Schritt durch verschiedene Transformations-, Validierungs- und Analysephasen geschleust werden. Ob mit Pandas, Spark, Polars oder Dask: Das Prinzip ist immer gleich – aber die Umsetzung macht den Unterschied zwischen Daten-GAU und Daten-Gold.

Der Begriff Dataframe beschreibt eine tabellarische Datenstruktur, die Spalten mit unterschiedlichen Datentypen und Zeilen mit einzelnen Observations kombiniert. Klingt nach Excel? Falsch gedacht – Dataframes sind optimiert für Massendaten, bieten Vektorisierung, effiziente Speicherverwaltung und eine API, die komplexe Transformationen in wenigen Zeilen abbildet. Die Pipeline ist das Orchestrierungs-Framework, das diese Dataframes von Stufe zu Stufe schiebt: Einlesen, Filtern, Joinen, Aggregieren, Validieren, Exportieren – in genau definierter Reihenfolge und möglichst ohne menschliche Intervention.

Warum reicht ein einfaches Skript nicht? Weil deine Daten real nicht sauber sind, weil Anforderungen sich ändern, weil Volumina explodieren und weil Fehler in der Pipeline teuer werden. Die klassische “Quick & Dirty”-Lösung endet meist in unwartbaren, monolithischen Skripten voller Copy-Paste, die beim nächsten Schema-Update kollabieren. Eine echte Dataframes Pipeline ist modular, wiederverwendbar, getestet – und läuft automatisiert, egal ob auf dem Laptop oder im Cluster.

Wichtig: Eine Dataframes Pipeline ist kein Einweg-Workflow, sondern ein wiederholbares, kontrolliertes Datenfluss-System. Jede Stufe ist klar definiert, dokumentiert und im besten Fall mit Monitoring und Logging ausgestattet. Nur so kannst du Fehlerquellen aufspüren, Performance bottlenecks identifizieren und deine Datenströme kontinuierlich verbessern.

Die Bausteine effizienter Dataframes Pipelines: Architektur, Modularität, Skalierbarkeit

Eine Dataframes Pipeline ist nur so stark wie ihr schwächstes Glied. Wer wild Dataframes zusammenkleistert, produziert früher oder später Datenmüll – und das oft unbemerkt, bis das Reporting kollabiert oder der Data Lake umkippt. Deshalb braucht jede effiziente Dataframes Pipeline eine klare Architektur, strikte Modularität und Skalierbarkeit, die nicht nur auf dem Papier funktioniert.

Die wichtigsten Komponenten im Überblick:

- Ingestion Layer: Hier entscheidet sich, ob du mit sauberem Input arbeitest oder schon beim Einlesen Fehler einbaust. Ob CSV, Parquet, Datenbank oder REST-API – die Datenquelle muss sauber angebunden, Typen müssen früh validiert, und Encoding-Probleme müssen erkannt werden.

- Transformation Layer: Hier werden die Dataframes gefiltert, gemappt, gejoint und aggregiert. Modularität ist das A und O: Jede Transformation sollte eine einzige Aufgabe erledigen (Single Responsibility Principle), testbar und wiederverwendbar sein.

- Validation Layer: Datenqualität entscheidet über alles. Nullwerte, Ausreißer, inkonsistente Typen oder Dubletten müssen vor dem nächsten Schritt erkannt und behandelt werden. Tools wie Great Expectations bringen hier echte Value.

- Export Layer: Am Ende steht immer ein Ziel: Datenbank, Data Lake, Dashboard oder API. Der Export muss so robust sein, dass fehlerhafte Exporte erkannt und gestoppt werden – bevor sie Schaden anrichten.

- Monitoring & Logging: Ohne Monitoring ist jede Pipeline ein Blindflug. Fehler, Laufzeiten und Datenqualitätsmetriken müssen zentral erfasst und ausgewertet werden.

Skalierbarkeit ist kein Nice-to-have. Wer heute noch glaubt, dass Pandas auf einem Laptop für alles reicht, hat Big Data nicht verstanden. Spätestens ab ein paar Millionen Zeilen brauchst du ein Konzept für verteilte Verarbeitung – Spark, Dask oder Polars sind hier echte Alternativen. Und ja, schon der Import von 10GB CSV kann ohne Chunking oder Streaming zur Geduldsprobe werden. Modularität wiederum ist dein Rettungsanker gegen Spaghetti-Code: Jede Pipeline-Stage gehört in eine eigene Funktion oder Klasse, am besten mit klaren Ein- und Ausgabetypen.

Die Architektur einer Dataframes Pipeline entscheidet, wie schnell du neue Anforderungen umsetzen, Fehler finden und Performance optimieren kannst. Wer hier auf “Quick & Dirty” setzt, zahlt spätestens beim nächsten Outage – mit Datenverlust, Überstunden und einem verärgerten Stakeholder-Kreis.

Tools und Frameworks für Dataframes Pipelines: Pandas, Spark, Dask & Co im Jahr 2025

Dataframes Pipelines leben und sterben mit dem richtigen Werkzeug. 2025 gibt es keine Ausreden mehr für schlechte Tool-Entscheidungen – der Markt ist voll, aber nicht jedes Framework taugt für produktive Datenströme. Wer Pandas noch als Allzweckwaffe einsetzt, übersieht die Limitierungen: Single-Threaded, nicht verteilt, Speicherfresser. Für kleine Daten reicht das, für alles andere brauchst du Skalierung und Parallelisierung.

Hier die wichtigsten Player im Dataframes Pipeline Game:

- Pandas: Der Klassiker, ideal für explorative Datenanalyse und kleine bis mittlere Datenmengen. APIs sind mächtig, aber ohne Parallelisierung schnell am Limit. Keine echte Streaming-Unterstützung.

- PySpark: Der Big-Data-King. Dataframes auf verteilten Clustern. Skalierbar, performant, mit SQL-Support und Anbindung an Hadoop-Ökosystem. Steile Lernkurve, aber alternativlos bei richtig viel Daten.

- Dask: Die Brücke zwischen Pandas und Spark. API-kompatibel zu Pandas, aber mit Parallelisierung und verteiltem Scheduling. Für viele Workloads effizienter als Spark, aber weniger Features bei sehr großen Deployments.

- Polars: Der neue Star am Horizont: Rust-basiert, extrem schnell, unterstützt Lazy Evaluation und Streaming. Ideal für Workloads, bei denen Performance zählt und Pandas zu langsam ist.

- Great Expectations: Kein Dataframe-Framework, aber das Tool für Data Quality in Pipelines. Automatisierte Validierung, Dokumentation und Monitoring in jedem Step.

Die Wahl des Frameworks entscheidet, wie viel Schmerz oder Freude du in deiner Dataframes Pipeline hast. Pandas ist für die Ad-hoc-Analyse unschlagbar, Spark für Big Data unverzichtbar, Dask für skalierbare Workflows im Mittelbau optimal. Polars könnte der Gamechanger werden – wer Performance liebt, sollte es testen. Wichtig: Die Integration mit Workflow-Orchestratoren wie Airflow, Prefect oder Dagster ist Pflicht. Sonst bleibt deine Pipeline ein Flickenteppich ohne Automatisierung.

2025 gilt: Wer immer noch mit Jupyter-Skripten produktive Datenströme fährt, spielt russisches Datenroulette. Dataframes Pipelines gehören in automatisierte, versionierte, getestete Workflows – alles andere ist Daten-Fahrlässigkeit.

Fehlerquellen, Bottlenecks und Best Practices: Wie Dataframes Pipelines wirklich produktiv werden

Die Theorie klingt schön, die Praxis ist brutal: Dataframes Pipelines scheitern nicht an der Technik, sondern an schlechten Konzepten, fehlender Disziplin und mangelndem Monitoring. Die häufigsten Fehlerquellen sind so alt wie die Datenverarbeitung selbst – und trotzdem findet man sie in 90% aller Projekte.

Hier die Top-Performance-Killer und wie du sie umgehst:

- Monolithische Skripte: Alles in eine Datei, kein Modulsystem, Copy-Paste-Orgien. Refaktorisieren, modularisieren, testen – alles andere ist Legacy-Müll.

- Speicherfresser: Dataframes ohne Typenoptimierung, keine Chunking-Logik, keine Lazy Evaluation. Resultat: Out-of-Memory, abgebrochene Jobs, Frust.

- Fehlende Validierung: Wer Datenqualität ignoriert, produziert Datenmüll. Jede Pipeline braucht Validierungs- und Error-Handling-Mechanismen.

- Keine Logging-Strategie: Ohne Logs keine Fehleranalyse, keine Performance-Metriken, kein Alerting. Logging ist Pflicht in jeder Stage.

- Ad-hoc-Änderungen im Code: Schnell mal was ändern und deployen? Willkommen im Debugging-Höllenkreis. Tests, Code-Reviews und CI/CD sind keine Kür, sondern Pflicht.

Best Practices sind kein Luxus, sondern Überlebensstrategie:

- Jede Pipeline-Stage als eigene, testbare Funktion/Klasse

- Frühe Typenvalidierung und Nullwert-Handling

- Chunking und Streaming, wo immer möglich

- Parallelisierung durch Frameworks, nicht durch Bastel-Threads

- Monitoring, Logging, Alerting – von Anfang an

- Versionierung von Code UND Daten (Stichwort: Data Lineage)

Und der wichtigste Punkt: “Nur mal eben schnell” ist der Tod jeder produktiven Dataframes Pipeline. Wer keine Zeit für Architektur hat, hat später genug Zeit für Bugfixing, Outages und Nachtschichten. Wer jetzt sauber arbeitet, spart morgen hundertfach Zeit, Geld und Nerven.

Step-by-Step: Aufbau einer soliden Dataframes Pipeline

Du willst endlich wissen, wie man eine Dataframes Pipeline aufzieht, die nicht beim ersten Fehler implodiert? Hier ist das Rezept – kein Bullshit, keine Abkürzungen, sondern der Blueprint für produktive, skalierbare Datenströme:

- 1. Datenquellen definieren: Klare Definition aller Quellen, Typen, Encodings und Zugriffsmethoden. Dokumentiere alles – auch das vermeintlich Offensichtliche.

- 2. Ingestion Layer modularisieren: Ein Modul pro Datenquelle, mit Typvalidierung, Fehlerbehandlung und Logging.

- 3. Transformationen als Funktionen/Klassen: Jede Transformation ist eine Funktion – keine endlosen Methodenketten. Nutze Frameworks für Mapping, Joins und Aggregationen.

- 4. Validierung mit Rulesets: Nutze Tools wie Great Expectations oder eigene Validatoren. Jede Pipeline-Stufe hat eigene Checks.

- 5. Export Layer: Schreibe Exporte modular, mit Error-Handling. Keine Ad-hoc-Exporte aus dem Notebook.

- 6. Logging & Monitoring einbauen: Jeder Step schreibt Logs, Metriken und Fehler. Am besten zentralisiert, mit Alerting für Ausreißer.

- 7. Automatisierung per Workflow-Orchestrator: Airflow, Prefect oder Dagster orchestrieren die Pipeline. Kein manuelles Triggern, keine Cronjob-Hacks.

- 8. Tests und CI/CD: Automatisierte Tests für jede Pipeline-Komponente. CI/CD-Integration für Deployments.

- 9. Dokumentation und Data Lineage: Jede Änderung wird dokumentiert, Data Lineage ist Pflicht. So weiß jeder, woher die Daten kommen – und wohin sie gehen.

- 10. Performance-Optimierung: Regelmäßiges Profiling, Bottleneck-Analyse und Refactoring. Performance ist kein Zufall, sondern harte Arbeit.

Wer diese Schritte ignoriert, baut Datenströme auf Sand. Wer sie beherzigt, hat produktive, skalierbare und zukunftsfähige Pipelines – und endlich wieder Zeit für die echten Data-Science-Fragen.

Fazit: Dataframes Pipelines – Das Rückgrat moderner Datenströme

Dataframes Pipelines sind das technische Rückgrat moderner Datenströme. Sie entscheiden, ob aus Big Data Business Value wird – oder Datenmüll. Effiziente, modulare und skalierbare Pipelines sind kein Luxus, sondern Überlebensstrategie im digitalen Zeitalter. Wer hier spart, zahlt später mit Datenverlust, Frust und verlorener Wettbewerbsfähigkeit. Die Zeiten der Quick & Dirty-Lösungen sind vorbei – ab jetzt zählen Architektur, Automatisierung und Monitoring.

Die Wahrheit ist unbequem: Wer Dataframes Pipelines immer noch als lästige Pflicht sieht, hat den Anschluss schon verloren. Nur mit Disziplin, technischer Tiefe und den richtigen Tools hebst du deine Datenströme aufs nächste Level. Willkommen bei der Zukunft der Datenverarbeitung. Willkommen bei 404.