Crawlersteuerung durch JavaScript: Clever steuern, effizient crawlen

Wenn du glaubst, dass deine Website nur mit hübschen Buttons und schicken Lazy Load-Plugins durchs Google-Labyrinth kommt, hast du die Rechnung ohne den Googlebot gemacht. Denn moderne Crawler sind kein Staubsauger, der alles aufsaugt, was du ihm vorsetzt. Sie sind hochkomplexe Parsing-Engines, die im Schatten der Frontend-Frameworks operieren – und dabei jede Menge Fallen und Tricks mitbringen. Wer heute noch glaubt, JavaScript sei nur ein nettes Beiwerk, sollte schnellstens umdenken. Denn die Steuerung deiner Crawler-Performance durch JavaScript ist kein Nice-to-have mehr, sondern die einzige Chance, im SEO-Game 2025 noch zu bestehen.

- Warum JavaScript im SEO-Context eine Herausforderung ist – und warum es keine Ausrede mehr gibt

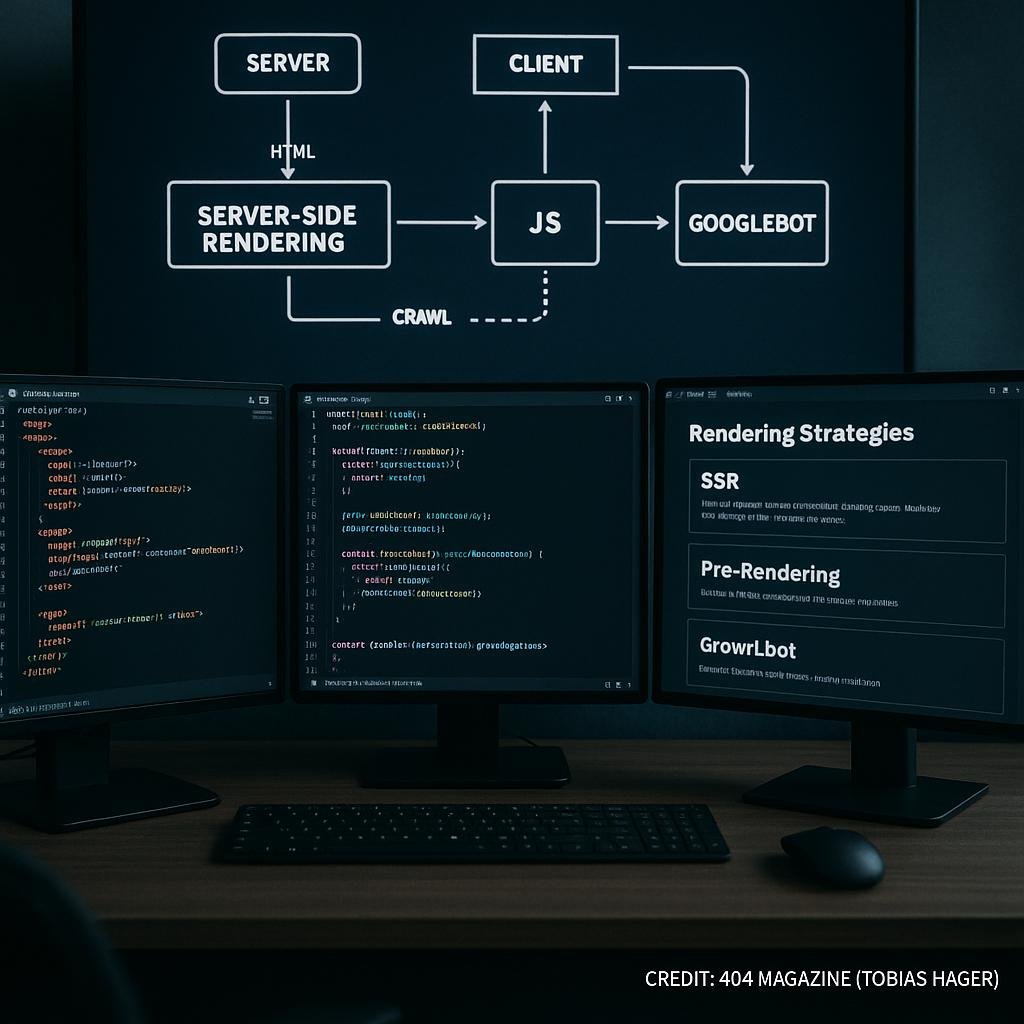

- Wie Google JavaScript-Inhalte rendern und was das für dein Crawling bedeutet

- Techniken zur Steuerung der Crawl-Performance durch JavaScript: SSR, Pre-Rendering, Dynamic Rendering

- Die wichtigsten SEO-Fehlerquellen bei JavaScript-basierten Websites und wie du sie vermeidest

- Tools und Prozesse für eine effektive JavaScript-Crawling-Optimierung

JavaScript im SEO: Warum es zur Achillesferse wird – oder zur Geheimwaffe

In der Welt des technischen SEO gilt: Wer JavaScript ignoriert, spielt mit dem Feuer. Früher war das Web simpel: HTML, CSS, ein bisschen PHP – fertig. Heute? Da dominieren Frameworks wie React, Vue oder Angular, die Inhalte erst auf Client-Seite generieren. Für den menschlichen Nutzer ist das genial, für Suchmaschinen-Crawler eine Herausforderung. Das Problem: Google hat zwar nachgerüstet, um JavaScript zu rendern, aber dieser Prozess ist alles andere als trivial. Er kostet Ressourcen, Zeit und birgt zahlreiche Fallstricke. Und genau hier liegt die Chance für alle, die es clever angehen.

Wenn du deine Website nur auf clientseitiges JavaScript setzt, riskierst du, dass Google nur die halbe Wahrheit sieht. Der Googlebot führt zwar inzwischen ein Rendering durch, doch das dauert. Es ist eine zweite, aufwendige Runde – und bei großen, komplexen Seiten wird das Crawl-Budget schnell zur Achillesferse. Inhalte, die nur durch JavaScript nachgeladen werden, sind dann im Index kaum vorhanden – oder nur verzögert. Das ist kein Problem, wenn du die Mechanismen kennst und steuerst.

Die Frage ist: Wie kannst du JavaScript so steuern, dass Google deine Inhalte zuverlässig indexiert? Die Antwort lautet: durch intelligente Render-Strategien. Nicht nur, um die Sichtbarkeit zu sichern, sondern auch, um Crawl-Bimits zu umgehen und deine Website performanter zu machen. Denn JavaScript ist kein Feind, sondern ein Werkzeug – wenn du es richtig nutzt.

Technische Strategien zur Steuerung der Crawler durch JavaScript: SSR, Pre-Rendering & Dynamic Rendering

Die wichtigsten Techniken, um JavaScript für SEO zu bändigen, sind Server-Side Rendering (SSR), Pre-Rendering und Dynamic Rendering. Sie alle haben das Ziel, Content bereits beim ersten Request vollständig auszuliefern – ohne, dass Google im zweiten Rendering-Wurf verzweifelt. Hier die wichtigsten Ansätze im Detail:

- Server-Side Rendering (SSR): Hierbei wird der komplette Content auf dem Server generiert und als statisches HTML ausgeliefert. Frameworks wie Next.js (für React) oder Nuxt.js (für Vue) sind prädestiniert dafür. Vorteil: Google sieht sofort den vollständigen Content, keine Render-Blocks. Nachteil: Komplexität und Server-Last.

- Pre-Rendering: Bei dieser Technik werden statische Versionen der Seiten im Voraus generiert – meist mittels Build-Tools. Google crawlt die vorgerenderte Version, Nutzer bekommen die dynamische App. Besonders bei Content-Seiten, Blog-Posts oder Produktseiten effektiv.

- Dynamic Rendering: Das umstrittenste, aber manchmal notwendigste Tool. Hier werden unterschiedliche Versionen für Suchmaschinen und Nutzer ausgeliefert – z.B. durch User-Agent-Erkennung. Google erhält eine serverseitig gerenderte Version, während User die clientseitige App sehen. Vorsicht: Diese Methode ist fehleranfällig und sollte nur mit Know-how eingesetzt werden.

Der Schlüssel liegt darin, eine Strategie zu wählen, die zur Website passt. Für große, komplexe Anwendungen ist SSR meist die beste Lösung. Für kleinere Projekte oder Content-Seiten reicht Pre-Rendering oft aus. Wichtig ist, dass du verstehst, wann und warum du welche Technik einsetzt.

SEO-Fehlerquellen bei JavaScript und wie du sie vermeidest

Viele Website-Betreiber stolpern über typische JavaScript-Fallen, die den SEO-Erfolg im Keim ersticken. Hier die häufigsten Fehler und wie du sie vermeidest:

- Fehlendes Server-Side Rendering: Content wird nur clientseitig geladen, Google sieht nur einen leeren Container. Lösung: SSR implementieren oder Pre-Rendering nutzen.

- Inhalt durch JavaScript nur nachgeladen, aber nicht indexiert: Google indexiert nur, was beim ersten Render sichtbar ist. Lösung: statische Versionen oder prerendern.

- Unvollständige oder fehlerhafte Fetch-Requests: API-Calls, die nur im Browser funktionieren, werden vom Googlebot ignoriert. Lösung: SSR-Integration für API-Daten.

- Langsame Renderzeiten: Wenn der JavaScript-Renderprozess zu lange dauert, wird Google den Content möglicherweise nicht vollständig erfassen. Lösung: Code-Optimierung, Lazy Loading, Code-Splitting.

- Blockierte Ressourcen in robots.txt oder via Noindex: Kritische JS- und CSS-Dateien werden blockiert, was das Rendern verhindert. Lösung: Ressourcen prüfen und freigeben.

Tools und Prozesse für eine effiziente JavaScript-Crawling-Optimierung

Ohne die richtigen Tools ist das Steuerungsspiel im JavaScript-SEO nur halb so effektiv. Hier die wichtigsten Werkzeuge, um deine Crawler-Performance zu verbessern:

- Google Search Console: Überwache Render-Fehler, Indexierungsstatus, mobile Usability und die Darstellung deiner Seiten im Google-Renderer.

- Lighthouse & PageSpeed Insights: Teste, wie gut deine Seiten beim Rendering abschneiden, und erhalte konkrete Empfehlungen zur Verbesserung.

- Render-Tools wie Puppeteer oder Rendertron: Simuliere Google-Renderings in einer kontrollierten Umgebung, um Content-Lücken zu identifizieren.

- WebPageTest.org: Analysiere Lade- und Renderzeiten aus verschiedenen Regionen, inklusive Wasserfall-Diagrammen.

- Logfile-Analyse: Verstehe, wie Googlebot deine Seite tatsächlich crawlt. Nutze Tools wie Screaming Frog Log Analyzer oder Elastic Stack.

Fazit: JavaScript steuern, um im SEO-Game 2025 nicht abzurutschen

JavaScript ist kein Feind, sondern ein mächtiges Werkzeug im Arsenal eines modernen SEO-Strategen. Die Kunst besteht darin, den Content für Google optimal zugänglich zu machen, ohne die Nutzererfahrung zu opfern. Das bedeutet: klare Render-Strategien, saubere technische Umsetzung und konsequentes Monitoring. Wer heute noch glaubt, JavaScript sei nur für die Frontend-Show, riskiert, im Algorithmus-Dschungel verloren zu gehen.

Nur wer die Kontrolle über die Render- und Crawling-Strategien durch JavaScript übernimmt, bleibt wettbewerbsfähig. Es ist kein Hexenwerk, sondern eine technische Notwendigkeit. Und wer diese Herausforderungen ignoriert, legt den Grundstein für den SEO-Abstieg im Jahr 2025. Also: Clever steuern, effizient crawlen – sonst ist dein Content nur ein Schatten im Google-Labyrinth.