KI Stimmen: Zukunft der digitalen Klangrevolution

Du dachtest, Autotune sei der Peak der Audio-Technologie? Willkommen im Jahr der KI Stimmen – wo künstliche Intelligenz nicht nur mitsingt, sondern dich auch ersetzen kann. Was nach dystopischem Sci-Fi klingt, ist längst Realität. Und wenn du immer noch glaubst, dass deine Stimme im Podcast unersetzbar ist, dann solltest du diesen Artikel lieber laut lesen – bevor es jemand anderes für dich tut. In deiner Stimme. Mit deinen Worten. Und einem besseren Skript.

- Was KI Stimmen wirklich sind – und warum sie keine Spielerei mehr sind

- Wie Text-to-Speech (TTS) mit Deep Learning die Audiowelt verändert

- Welche Technologien hinter synthetischen Stimmen stecken – von Tacotron bis WaveNet

- Warum Voice Cloning ethisch kritisch, aber technisch brillant ist

- Wie Marken KI Stimmen strategisch im Marketing einsetzen (und dabei Geld sparen)

- Welche rechtlichen Grauzonen Unternehmen ignorieren – und warum das gefährlich ist

- Welche Tools heute führend sind – und was du wirklich davon brauchst

- Warum authentische Audioerlebnisse künftig nicht mehr menschlich sein müssen

- Ein Ausblick auf das, was kommt – inklusive Risiken, Chancen und Kontrollverlust

KI Stimmen: Definition, Einsatzgebiete und disruptive Kraft

KI Stimmen – auch als synthetische oder künstliche Stimmen bekannt – sind computergenerierte Audiosignale, die mithilfe künstlicher Intelligenz erzeugt werden. Sie simulieren menschliche Sprache, Intonation, Emotion und sogar regionale Akzente. Während einfache Text-to-Speech-Systeme seit Jahrzehnten existieren, hat sich in den letzten Jahren eine völlig neue Generation durchgesetzt: neurale TTS-Systeme, die auf Deep Learning basieren und Stimmen erzeugen, die selbst Experten kaum noch vom Original unterscheiden können.

Die Einsatzbereiche sind vielfältig – und wachsen exponentiell. Von virtuellen Assistenten über E-Learning-Plattformen, Podcasts, Hörbüchern bis hin zu personalisierter Werbung und Gaming. Immer mehr Unternehmen setzen auf KI Stimmen, um Inhalte schneller zu skalieren, internationale Märkte zu erreichen und Produktionskosten massiv zu senken. Kein Wunder: Eine synthetische Stimme braucht keine Studiozeit, keinen Kaffee, keine GEMA und meckert nicht über zu lange Skripte.

Die disruptive Kraft liegt in der Skalierbarkeit. Was früher Tage oder Wochen kostete – z. B. ein vertonter Produktkatalog – lässt sich heute in Minuten generieren. Und das in 47 Sprachen, mit verschiedenen Stimmlagen, Emotionen und Tempi. Für Content-Marketer, die global denken, ist das ein Gamechanger. Für Sprecher, Synchronstudios und klassische Audioproduzenten eher der Anfang vom Ende.

Die Qualität der heutigen Modelle ist nicht nur „gut genug“, sie ist häufig besser als bei menschlichen Einsprechern – zumindest, wenn es um Konsistenz, Klarheit und Geschwindigkeit geht. Und genau das ist das Problem: Wenn die Maschine besser performt als der Mensch, wird der Mensch überflüssig. Willkommen in der schönen neuen Audio-Welt.

Technologie hinter KI Stimmen: Von Tacotron bis WaveNet

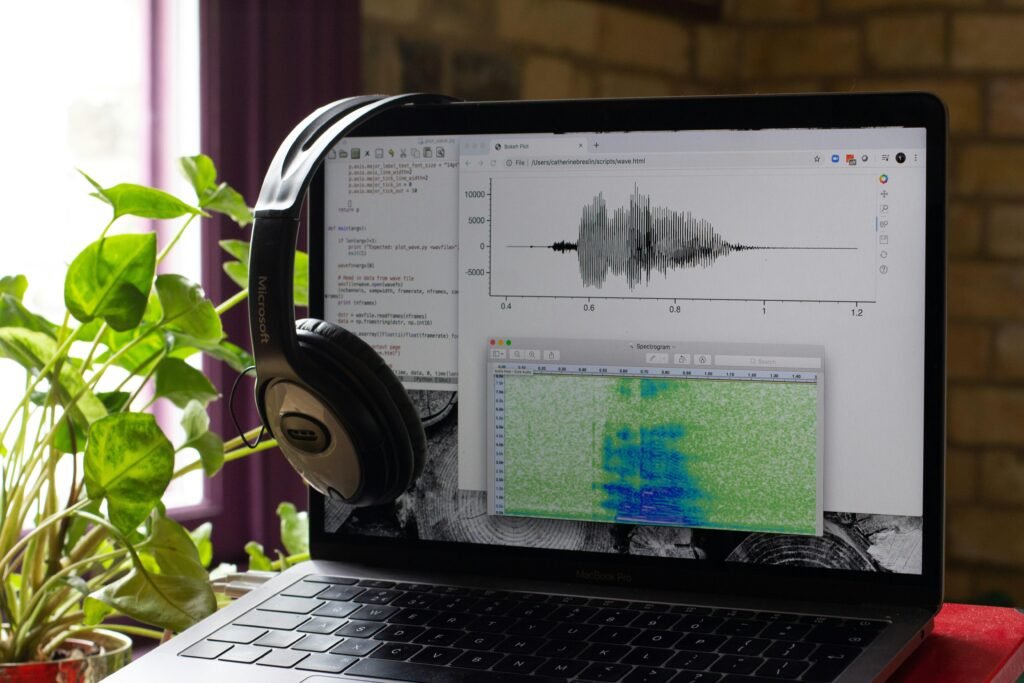

Die Magie hinter KI Stimmen basiert auf Kombinationen aus Natural Language Processing (NLP), Deep Learning und Audiosynthese. Die bekanntesten Architekturen sind Tacotron 2 (entwickelt von Google), WaveNet (DeepMind) und FastSpeech (Microsoft). Diese Modelle transformieren Text in Audio über zwei Hauptschritte: Sprachmodellierung und Audiosynthese.

Bei Tacotron 2 wird der eingegebene Text zunächst in ein sogenanntes Mel-Spectrogram übersetzt – eine visuelle Darstellung der Frequenzverteilung über die Zeit. Dieses wird dann von einem neuronalen Netzwerk (z. B. WaveNet) in Sprachwellen umgewandelt. WaveNet selbst ist ein autoregressives Modell, das Sprachsignale Sample für Sample generiert – mit beeindruckender Authentizität und Natürlichkeit.

FastSpeech beschleunigt diesen Prozess deutlich, indem es die autoregressive Natur von WaveNet umgeht und stattdessen auf parallele Verarbeitung setzt. Das Ergebnis: Sprachsynthese in Echtzeit, ohne nennenswerte Einbußen bei der Qualität. Und das ist keine Spielerei – es ist die Grundlage für Live-Anwendungen wie Chatbots mit Audioausgabe oder interaktive Sprachinterfaces.

Zusätzlich kommen Techniken wie Voice Activity Detection (VAD), Prosody Modeling und Speaker Embeddings zum Einsatz. Letztere ermöglichen es, individuelle Stimmen zu klonen, zu speichern und bei Bedarf wiederzuverwenden. Die Kombination dieser Technologien erlaubt es, Kontext, Emotion und sogar Ironie in synthetische Sprache zu integrieren – mit erschreckender Präzision.

Voice Cloning und Deepfake-Stimmen: Zwischen Genie und Wahnsinn

Voice Cloning ist die nächste Eskalationsstufe. Hier wird eine bestehende Stimme – z. B. von einem CEO oder Influencer – analysiert, modelliert und reproduziert, sodass beliebige Texte in exakt derselben Stimmfarbe ausgegeben werden können. Das Verfahren basiert auf sogenannten Speaker Embeddings, also einem digitalen Fingerabdruck der Stimme. Mit wenigen Minuten Audiomaterial lassen sich heute Stimmen täuschend echt klonen – inklusive der Eigenheiten, Atemgeräusche und Pausen.

Das Problem: Die Technik ist so gut, dass die ethischen Fragen kaum aufholen können. Wer darf wessen Stimme nutzen? Was passiert, wenn jemand in deiner Stimme Dinge sagt, die du nie gesagt hast? Das Thema Deepfake-Audio ist nicht nur ein mediales Schreckgespenst, sondern längst Realität. Bereits jetzt gibt es dokumentierte Fälle von CEO-Fraud, bei denen Betrüger per synthetischer Stimme Millionenbeträge ergaunert haben.

Die rechtliche Lage ist diffus. In vielen Ländern gelten Stimmen nicht als schützenswerte biometrische Merkmale. Das bedeutet: Sobald du deine Stimme irgendwo hochlädst, könnte sie theoretisch geklont werden – ohne dass du es erfährst oder dich wehren kannst. Und selbst wenn du es erfährst, ist der Schaden meist nicht mehr reparabel.

Trotzdem nutzen immer mehr Unternehmen Voice Cloning aktiv – etwa für Sprachassistenten, Markenbotschafter oder internationale Synchronisation. Der Grund ist logisch: Konsistenz, Markenidentität und Kostenersparnis. Aber wer dabei keine sauberen Nutzungsrechte klärt oder auf dubiose Anbieter setzt, riskiert nicht nur rechtliche Probleme – sondern auch einen massiven Reputationsschaden.

KI Stimmen im Marketing: Skalierung, Branding und Automatisierung

Für das Online-Marketing sind KI Stimmen ein Geschenk des Himmels – oder der Teufel in Audioform, je nachdem, welche Jobs man gerade streicht. Sie ermöglichen hyperpersonalisierte Kampagnen, mehrsprachige Werbespots, interaktive Voicebots und skalierbare Content-Produktion ohne menschliche Limitierung. Und das alles in einem Bruchteil der Zeit und Kosten.

Ein Beispiel: Statt ein Video in fünf Sprachen mit fünf Sprechern zu produzieren, generierst du einmal den Content, übersetzt ihn automatisch mit einem Neural Machine Translation Tool (z. B. DeepL API), und vertonst ihn mit synthetischen Stimmen – angepasst auf Land, Dialekt und Zielgruppe. Die Conversion-Raten steigen, die Produktionskosten sinken. Willkommen im Maschinenzeitalter des Marketings.

Auch im Bereich Branding spielt Stimme eine zunehmende Rolle. Marken definieren heute nicht mehr nur Logo, Farben und Slogans – sondern auch ihre “Brand Voice”. Mit KI lassen sich eigene, unverwechselbare Stimmen generieren und systematisch in allen Kanälen einsetzen: Website, App, Alexa, Callcenter, Podcast, Werbung. Die Stimme wird zum digitalen Fingerabdruck der Marke – und das ganz ohne Personalengpässe oder Krankmeldungen.

Tools wie Descript, Resemble AI, Murf oder ElevenLabs bieten APIs, mit denen sich synthetische Stimmen direkt in Marketing-Workflows integrieren lassen. Vom automatisierten Newsletter-Readout bis zum personalisierten Sales-Pitch im Podcast-Feed ist alles möglich. Und wer clever ist, nutzt A/B-Tests nicht nur für Texte, sondern auch für Stimmlagen, Tonalitäten und Sprechgeschwindigkeiten.

Rechtliche und ethische Herausforderungen synthetischer Stimmen

Die Technologie ist schneller als die Gesetzgebung – wie immer. Und genau das macht KI Stimmen zu einer rechtlichen Grauzone mit Sprengkraft. In vielen Ländern fehlt eine klare Regulierung, was die Nutzung, Speicherung und Verbreitung von synthetischen Stimmen betrifft. Datensicherheit, Urheberrecht und Persönlichkeitsrechte sind gefährlich unterdefiniert.

Ein zentrales Problem: Die fehlende Transparenz. Nutzer hören eine Stimme – aber wissen nicht, ob sie real oder synthetisch ist. Das öffnet Tür und Tor für Manipulation, Fake News, Meinungsmache und Identitätsdiebstahl. Wer garantiert, dass der Politiker im nächsten Wahlvideo wirklich selbst spricht? Oder dass der Kundenservice-Mitarbeiter nicht nur ein gut trainierter Bot ist?

Unternehmen, die KI Stimmen einsetzen, müssen daher proaktiv auf Transparenz, Einwilligung und Datenschutz achten. Das bedeutet: klare Kennzeichnung synthetischer Inhalte, Einholung von Rechten bei Voice Cloning und sichere Speicherung sensibler Stimmprofile. Wer das ignoriert, riskiert nicht nur Abmahnungen, sondern auch den Verlust von Vertrauen – und das ist im Marketing tödlich.

Ein weiterer Faktor: Diskriminierung durch Datenbasis. Wenn Trainingsdaten überwiegend aus männlichen, westlichen Stimmen bestehen, entstehen Verzerrungen. Das kann zu Bias führen – z. B. bei der Auswahl synthetischer Stimmen für bestimmte Rollen oder Zielgruppen. Wer hier nicht auf Diversität und Inklusion achtet, reproduziert unbewusst Vorurteile – im schlimmsten Fall in Millionen von Audioausgaben.

Die besten Tools für KI Stimmen – und welche du wirklich brauchst

Der Markt ist voll mit Anbietern – von Open-Source-Projekten bis hin zu Enterprise-Lösungen mit API-First-Strategie. Doch nicht alle Tools halten, was sie versprechen. Hier ein Überblick über die relevantesten Plattformen und ihre Stärken:

- ElevenLabs: Extrem natürliche Stimmen, überzeugendes Voice Cloning, API-Zugriff, breite Sprachunterstützung. Ideal für Podcasts, E-Learning und Content-Multiplikation.

- Descript: Fokus auf Audio-Editing mit Overdub-Feature. Besonders stark im Bereich Video-Postproduktion, Podcasting und Schnitt.

- Resemble AI: Bietet Echtzeit-Voice Cloning mit Emotion Control. Spannend für interaktive Anwendungen und Gaming.

- Play.ht: Große Auswahl an Stimmen, einfache Bedienung, gute Integration in CMS-Systeme. Eher für einfache TTS-Projekte geeignet.

- Open Source (Coqui, Mozilla TTS): Für Entwickler mit technischer Tiefe. Ermöglicht Training eigener Modelle, volle Kontrolle, aber hoher Aufwand.

Wichtig ist: Nicht jedes Tool passt zu jedem Use Case. Wer skalieren will, braucht API-Zugriff und Batch-Processing. Für Branding ist die Möglichkeit zur Stimmindividualisierung entscheidend. Und wer Voice Cloning betreibt, muss auf Datenschutz und Nutzungsrechte achten – sonst endet das Projekt schneller vor Gericht als im Feed.

Fazit: KI Stimmen sind keine Zukunft – sie sind Gegenwart

Die digitale Klangrevolution hat begonnen – und sie ist nicht mehr aufzuhalten. KI Stimmen verändern nicht nur, wie wir Inhalte konsumieren, sondern auch, wie wir sie produzieren, skalieren und personalisieren. Für Marketing, Medien und E-Learning ist das eine historische Chance – für klassische Sprecher eine existenzielle Bedrohung.

Wer in der digitalen Kommunikation von morgen bestehen will, kommt an synthetischen Stimmen nicht vorbei. Aber: Technologie ersetzt keine Strategie. Wer blind auf Tools setzt, ohne ethische, rechtliche und qualitative Fragen zu klären, spielt mit dem Feuer. Die Zukunft spricht – aber wer sie kontrolliert, entscheidet sich jetzt. Mach deine Stimme hörbar – bevor es jemand anderes in deiner Stimme tut.