Scikit-Learn Workflow: Clevere Wege für smarte Modelle

Du willst Machine Learning, aber keine Vorlesung in Theorie? Willkommen bei Scikit-Learn: Hier entscheidet nicht der Algorithmus, sondern der Workflow über Sieg oder Niederlage. Wer 2024 noch Daten “irgendwie” in Modelle kippt, kann gleich wieder zu Excel zurück. In diesem Artikel zerlegen wir die Scikit-Learn Pipeline in ihre Einzelteile – radikal ehrlich, maximal effizient und so praxisnah, dass selbst KI-Hipster ins Schwitzen kommen. Zeit, deinen ML-Workflow auf das nächste Level zu bringen.

- Scikit-Learn Workflow: Von der Datenvorbereitung bis zum Deployment – warum der richtige Ablauf wichtiger ist als der “beste” Algorithmus

- Warum Data Preprocessing der wahre Gamechanger im Machine Learning ist – und wie Feature Engineering dich von der Masse abhebt

- Welche Rolle Pipelines, GridSearchCV und Cross-Validation wirklich spielen – und wie du sie effizient einsetzt, statt nur Buzzwords zu droppen

- Fallstricke bei Skalierung, Imputation und Encoding – und wie du sie mit Scikit-Learn brutal sauber löst

- Step-by-Step: Von Rohdaten zu praxistauglichen Modellen mit dem Scikit-Learn Workflow

- Wie du Model Selection und Hyperparameter-Tuning in der Praxis automatisierst und nicht im Trial-&-Error-Sumpf versinkst

- Deployment: Warum Pickle-Dateien kein Produktivsystem sind und welche smarteren Wege es gibt

- Fehlerquellen, Best Practices und No-Gos, die jeder Data Scientist kennt – aber kaum einer offen anspricht

- Das Fazit: Wer Scikit-Learn nur als “Toolbox” nutzt, hat Machine Learning nicht verstanden

Scikit-Learn Workflow, Scikit-Learn Workflow, Scikit-Learn Workflow, Scikit-Learn Workflow, Scikit-Learn Workflow – genau darum geht es. Die meisten, die mit Machine Learning anfangen, wollen sofort das “beste Modell”. Sie laden Daten, wählen einen Algorithmus, klicken auf “fit” und wundern sich dann, warum alles Schrott ist. Die Wahrheit: Ohne einen sauberen Scikit-Learn Workflow ist jedes Modell eine Blackbox mit eingebauter Selbstsabotage. Wer nicht weiß, wie Daten aufbereitet, Features gebaut und Pipelines gebaut werden, kann gleich im Kaggle-Sandbox-Modus bleiben. In diesem Artikel bekommst du die gnadenlos ehrliche Anleitung für einen Scikit-Learn Workflow, der nicht nur auf dem Notebook funktioniert, sondern auch im echten Leben. Keine “One-Click-ML”-Illusionen, sondern tiefe technische Insights, die du sofort umsetzen kannst.

Scikit-Learn Workflow: Der unsichtbare Hebel im Machine Learning

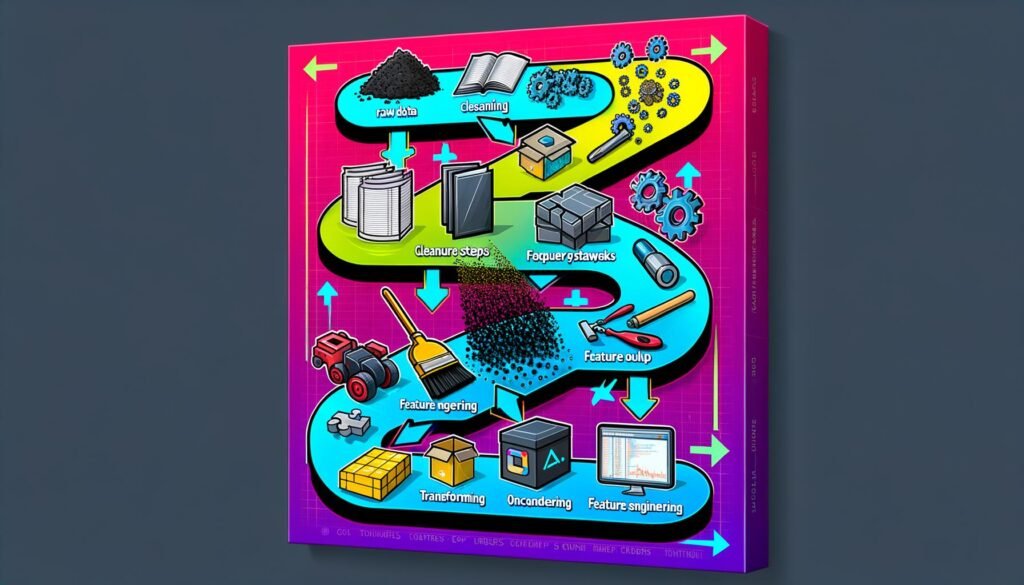

Scikit-Learn Workflow klingt erstmal nach Prozessfolklore für Berater. Tatsächlich entscheidet der Workflow aber darüber, ob dein Modell performant, reproduzierbar und skalierbar wird – oder ob du beim nächsten Datenimport von vorne anfängst. Der Scikit-Learn Workflow umfasst alle Schritte von der Datenbereinigung über Feature Engineering, Modelltraining, Hyperparameter-Tuning bis hin zum Deployment. Wer den Ablauf nicht versteht, produziert Modelle, die schon beim kleinsten Daten-Drift auseinanderfallen.

Der Clou: Scikit-Learn zwingt dich, in Pipelines zu denken. Kein wildes Rumgefrickel, sondern ein strukturierter Ablauf aus Transformationen, Selektionsmechanismen und sauberem Model Management. Genau das unterscheidet den Data Science-Profi vom Notebook-Hobbyisten. Jedes Element im Workflow – sei es StandardScaler, OneHotEncoder, ColumnTransformer oder GridSearchCV – hat seine Rolle. Wer sie blind aneinanderreiht, hat vielleicht Glück. Wer sie versteht, baut robuste, portable Modelle, die auch morgen noch funktionieren.

Im Zentrum steht die Pipeline-Architektur: Sie sorgt dafür, dass alle Vorverarbeitungsschritte, Feature-Engineering-Methoden und das Modelltraining als geschlossene Einheit behandelt werden. Das ist nicht nur für Reproduzierbarkeit wichtig, sondern auch für echtes Modell-Monitoring und Deployment. Denn mal ehrlich: Wer will schon beim nächsten Data Update die Hälfte der Preprocessing-Schritte vergessen?

Der Scikit-Learn Workflow setzt auf Komponenten wie:

- Transformer: Klassen wie StandardScaler, MinMaxScaler, SimpleImputer, die Daten vorverarbeiten

- Pipelines: Die Kette aller Vorverarbeitungsschritte und Modelle

- Model Selection Tools: Cross-Validation, GridSearchCV, RandomizedSearchCV

- Encoders: OneHotEncoder, OrdinalEncoder, TargetEncoder für kategorische Features

- Deployment-Tools: joblib, ONNX, MLflow für Export und Produktivbetrieb

Wer den Workflow meistert, steuert den gesamten ML-Lifecycle – und nicht nur das “fit” auf dem Trainingsset.

Data Preprocessing und Feature Engineering: Die wahre Magie im Scikit-Learn Workflow

Data Preprocessing ist im Scikit-Learn Workflow der Unterschied zwischen Glückstreffer und Systemerfolg. Rohdaten sind in der Regel ein Desaster: fehlende Werte, Ausreißer, falsche Formate, gemischte Skalen. Wer hier nachlässig ist, optimiert später am Symptom, nicht an der Ursache. Scikit-Learn liefert eine Armada an Tools, um Daten brutal sauber zu machen – von SimpleImputer für fehlende Werte bis RobustScaler für Ausreißerbehandlung.

Feature Engineering ist der unterschätzte Star. Hier entstehen aus banalen Rohdaten Features, die Machine-Learning-Modellen überhaupt erst Lernfähigkeit ermöglichen. Ob PolynomialFeatures für Interaktionen, FeatureUnion für parallele Transformationen oder CustomTransformer für individuelle Berechnungen – der Scikit-Learn Workflow macht’s möglich. Wer den Schritt skippt, verschenkt 80% der Modellgüte.

Typische Schritte im Preprocessing sind:

- Imputation: Fehlende Werte mit Mittelwert, Median oder Custom-Strategien ersetzen

- Skalierung: Features mit StandardScaler, MinMaxScaler oder RobustScaler normalisieren

- Encoding: Kategorische Daten in numerische Form bringen (OneHot, Label Encoding etc.)

- Feature Selection: Unnötige, korrelierende oder irrelevante Features entfernen

- Outlier Handling: Ausreißer identifizieren und behandeln, z. B. mit IQR-Methode oder Winsorizing

Der Trick: All das passiert idealerweise in einer Scikit-Learn Pipeline. Nur so werden dieselben Transformationen auch auf Testdaten und im Deployment angewendet. Wer Features per Hand vorverarbeitet, produziert inkonsistente Modelle – und das rächt sich spätestens im echten Einsatz.

Feature Engineering ist kein Buzzword, sondern Pflicht. Ob statistische Aggregationen, Interaktionsfeatures oder Zeitreihen-Transformationen – wer hier kreativ ist, baut Modelle, die nicht nur auf dem Trainingsset glänzen, sondern auch unter realen Bedingungen bestehen.

Pipelines, GridSearchCV und Cross-Validation: Die Königsdisziplinen im Scikit-Learn Workflow

Ohne Pipelines ist der Scikit-Learn Workflow ein Kartenhaus. Die Pipeline-Klasse verbindet sämtliche Vorverarbeitungsschritte und das Modell zu einem einzigen Objekt – damit ist Schluss mit “vergessene Standardisierung” und “unterschiedliche Skalierungen” zwischen Training und Test. Pipelines machen Modelle portabel, wiederholbar und verhindern Data Leakage (also das ungewollte Einfließen von Testdaten in den Trainingsprozess).

GridSearchCV und RandomizedSearchCV sind die Werkzeuge für Hyperparameter-Tuning – also das systematische Durchprobieren von Modellparametern, um das Optimum zu finden. Kombiniert mit Pipelines kannst du nicht nur den Algorithmus, sondern auch die Preprocessing-Schritte automatisch optimieren. Das ist der Unterschied zwischen Try-and-Error und professioneller Modellentwicklung.

Cross-Validation (Kreuzvalidierung) ist der Goldstandard, um Modelle ehrlich zu bewerten. Statt das Modell einmal zu trainieren und zu testen, wird der Datensatz mehrfach in Trainings- und Testteile aufgeteilt, um Overfitting zu entlarven und die echte Modellgüte zu messen. Scikit-Learn bietet vielfältige Varianten: KFold, StratifiedKFold, GroupKFold – für jeden Datentyp die passende Methode.

Der clevere Weg: Alle Schritte (Preprocessing, Feature Engineering, Modell, Hyperparameter-Tuning) in eine einzige Pipeline packen und das gesamte Set-up mit GridSearchCV oder RandomizedSearchCV optimieren. Das Resultat: Ein robustes, validiertes Modell, das echten Business-Impact liefert statt nur schöne Notebook-Plots.

Step-by-Step – so geht’s:

- Definiere eine Pipeline mit allen notwendigen Preprocessing- und Modellschritten

- Lege einen Parameter-Grid für Modell- und Preprocessing-Optionen an

- Starte GridSearchCV mit der Pipeline und Cross-Validation

- Analysiere die Ergebnisse, wähle das beste Setup

- Exportiere die komplette Pipeline für Deployment

Fallstricke und Best Practices: Skalierung, Imputation, Encoding und Modell-Export

Scikit-Learn Workflow klingt simpel – in der Praxis lauern aber zahllose Stolperfallen. Der Klassiker: Du skalierst Features im Training, vergisst aber die gleiche Transformation auf Test- oder Produktivdaten anzuwenden. Folge: Das Modell performt im Einsatz miserabel. Die Lösung: Alle Transformationen gehören in die Pipeline, nie separat ausführen!

Imputation ist ein weiteres Minenfeld. Wer erst nach dem Split fehlende Werte ersetzt, riskiert Data Leakage. Die Imputation muss innerhalb der Pipeline erfolgen, damit Testdaten nicht “vorab” mit Trainingsinformationen kontaminiert werden. Mit ColumnTransformer kannst du unterschiedliche Spalten gleichzeitig mit verschiedenen Methoden behandeln – ein Gamechanger bei heterogenen Datensätzen.

Encoding von Kategorien ist besonders kritisch: OneHotEncoder, OrdinalEncoder & Co. müssen im Training alle Kategorien “sehen”, damit sie im Einsatz mit neuen Daten umgehen können. Wer hier schlampig arbeitet, produziert Modelle, die bei neuen Kategorien crashen oder falsche Vorhersagen liefern. Für den Export empfiehlt sich joblib (statt pickle), da es effizienter und sicherer ist. Noch smarter: Model-Export mit ONNX oder MLflow, um Modelle plattformübergreifend und in produktiven APIs einzusetzen.

Best Practices im Scikit-Learn Workflow:

- Alle Preprocessing-Schritte in Pipeline oder ColumnTransformer kapseln

- Splitte Daten strikt in Training, Validation, Test – und zwar vor aller Verarbeitung

- Verwende Cross-Validation für ehrliche Modell-Evaluation

- Automatisiere Hyperparameter-Tuning mit GridSearchCV/RandomizedSearchCV

- Exportiere nur komplette Pipelines – nie einzelne Modelle ohne Preprocessing!

No-Gos, die du vermeiden solltest:

- Preprocessing-Schritte “von Hand” außerhalb der Pipeline durchführen

- Testdaten im Preprocessing “mitbenutzen” (Data Leakage!)

- Modelle als einzelne Pickle-Dateien ohne Kontext abspeichern

- Hyperparameter “nach Bauchgefühl” einstellen

- Keine Cross-Validation (Overfitting-Garantie!)

Step-by-Step: Der perfekte Scikit-Learn Workflow für smarte Modelle

Jetzt wird’s konkret. Ein sauberer Scikit-Learn Workflow ist kein Hexenwerk, aber erfordert Disziplin. Hier die Schritte, die aus Daten Chaos, aus Modellen Business-Mehrwert machen:

- Daten laden und inspizieren: Mit pandas einlesen, erste Checks auf Missing Values, Ausreißer und Datentypen machen.

- Daten splitten: Mit

train_test_splitstrikt nach Training und Test aufteilen – alles weitere geschieht nur auf dem Trainingsset! - Preprocessing-Pipeline bauen:

- Numerische Features: Imputation (SimpleImputer), Skalierung (StandardScaler/MinMaxScaler)

- Kategorische Features: Imputation (z. B. “missing”-Kategorie), Encoding (OneHotEncoder)

- Mit ColumnTransformer alle Schritte bündeln

- Feature Engineering einbauen: PolynomialFeatures, Interaktionen, CustomTransformer für Spezialfeatures

- Modell definieren: Algorithmus wählen (RandomForest, LogisticRegression, SVM etc.)

- Pipeline aufbauen: Preprocessing + Feature Engineering + Modell in eine Pipeline packen

- Hyperparameter-Tuning: Parameter-Grid aufstellen, GridSearchCV oder RandomizedSearchCV mit Cross-Validation laufen lassen

- Bestes Modell evaluieren: Mit Testdaten prüfen, Metriken wie Accuracy, F1, ROC-AUC analysieren

- Modell exportieren: Mit joblib, ONNX oder MLflow die komplette Pipeline speichern

- Deployment vorbereiten: Modell in API (FastAPI, Flask), Batch-Prozess oder Stream-Lösung integrieren

Wer diesen Ablauf konsequent einhält, baut Scikit-Learn Modelle, die nicht nur im Jupyter Notebook, sondern auch im Produktivsystem glänzen – und das ist die Messlatte.

Deployment und Monitoring: Scikit-Learn Modelle im echten Leben

Der beste Scikit-Learn Workflow endet nicht beim Speichern der Pickle-Datei. Deployment ist die Königsklasse – und hier trennt sich die Spreu vom Weizen. Modelle müssen im Backend, in Microservices oder auf Edge Devices laufen. Ein Modell, das nur im Notebook performt, ist wie ein Ferrari ohne Motorhaube: hübsch, aber nutzlos.

Scikit-Learn Pipelines lassen sich mit joblib oder ONNX exportieren und in Python-APIs (FastAPI, Flask) einbinden. Wer Monitoring, Versionierung und Reproducibility will, setzt auf MLflow oder DVC. Im Deployment lauern neue Fallstricke: Datenformate müssen identisch zum Training bleiben, alle Preprocessing-Schritte müssen exakt reproduzierbar sein. Sonst gibt’s im Live-Betrieb böse Überraschungen.

Best Practices für das Scikit-Learn Deployment:

- Komplette Pipeline exportieren, nie nur das Modell

- API-Input-Checks: Validierung aller Eingabedaten

- Monitoring: Metriken wie Drift, Accuracy, Latenz regelmäßig checken

- Automatisierte Tests vor jedem Rollout

- Versionierung aller Modelle und Pipelines

Pfusch beim Deployment rächt sich doppelt: Schlechte Daten führen zu schlechten Vorhersagen, und das System ist kaum zu debuggen. Wer hier spart, verliert – und zwar schnell und sichtbar.

Fazit: Scikit-Learn Workflow – der unterschätzte Schlüssel zu echten ML-Erfolgen

Scikit-Learn Workflow ist weit mehr als ein paar Methodenaufrufe. Wer die komplette Pipeline beherrscht – von Preprocessing über Feature Engineering bis zum Deployment – baut Modelle, die robust, nachvollziehbar und skalierbar sind. Der Rest bleibt im Sandkasten stecken.

Die Wahrheit ist unbequem: Wer Scikit-Learn nur als “Toolbox” nutzt, verschenkt das Potenzial moderner Machine-Learning-Technologien. Der Workflow entscheidet über Erfolg oder Misserfolg. Wer ihn ignoriert, optimiert am Symptom statt an der Ursache. Wer ihn meistert, liefert echten Mehrwert – und das messbar, wiederholbar, skalierbar. Willkommen in der echten Welt des Machine Learnings. Willkommen bei 404.