SQL Pipeline: Datenflüsse clever automatisieren und steuern

Du schiebst stundenlang Daten von A nach B, hantierst mit Excel-Exports, und wenn ein Datenfeld fehlt, fliegt dir die ganze schöne Analyse um die Ohren? Willkommen im Zeitalter, in dem Datenflüsse endlich automatisiert werden müssen – und zwar richtig. SQL Pipeline ist nicht nur ein Buzzword, sondern die Antwort auf den täglichen Datenfrust. Hier kommt die ungeschönte, technisch tiefe Rundum-Abrechnung: Warum du mit SQL Pipelines endlich Herr deiner Daten wirst, wie du sie effizient baust, wo die Fallstricke liegen – und wie du dich gegen veraltete Script-Lösungen endgültig immunisierst. Wer jetzt noch manuell Daten verarbeitet, hat 2025 schon verloren.

- Was eine SQL Pipeline ist – und warum sie das Rückgrat moderner Datenarchitektur bildet

- Die wichtigsten Komponenten einer SQL Pipeline und wie sie zusammenspielen

- Automatisierung, Monitoring und Fehlerhandling: Wie du Datenflüsse stabil steuerst

- Best Practices für Aufbau, Skalierung und Sicherheit von SQL Pipelines

- Vergleich: SQL Pipelines vs. klassische ETL-Prozesse – was taugt wirklich?

- Typische Fehlerquellen, Anti-Patterns und wie du sie umschiffst

- Step-by-Step-Anleitung: So setzt du eine performante SQL Pipeline auf

- Tools und Frameworks, die im Jahr 2025 den Unterschied machen

- Warum ohne smarte Datenflüsse kein datengetriebenes MarketingMarketing: Das Spiel mit Bedürfnissen, Aufmerksamkeit und Profit Marketing ist weit mehr als bunte Bilder, Social-Media-Posts und nervige Werbespots. Marketing ist die strategische Kunst, Bedürfnisse zu erkennen, sie gezielt zu wecken – und aus Aufmerksamkeit Profit zu schlagen. Es ist der Motor, der Unternehmen antreibt, Marken formt und Kundenverhalten manipuliert, ob subtil oder mit der Brechstange. Dieser Artikel entlarvt das... mehr funktioniert

SQL Pipeline – das klingt nach Buzzword-Bingo, ist aber der kritische Erfolgsfaktor, wenn es um die Automatisierung und Steuerung von Datenflüssen geht. Wer heute noch manuell Daten abruft, zusammenklebt und ins Marketing-Reporting kippt, betreibt Daten-Masochismus auf höchstem Niveau. Denn Datenmengen explodieren, Anforderungen werden komplexer und die Toleranz für Fehler tendiert gegen null. Eine SQL Pipeline nimmt dir den langweiligen, fehleranfälligen Kram ab – wenn du sie richtig baust. Aber Achtung: Zwischen “irgendwas mit SQL” und einer wirklich skalierbaren, wartbaren Datenpipeline liegen Welten. Hier bekommst du das volle Brett: Technische Tiefe, glasklarer Blick auf Best Practices – und die schonungslose Wahrheit darüber, warum 90% aller Datenpipelines in deutschen Unternehmen komplett am Ziel vorbeischrammen.

Was ist eine SQL Pipeline? Datenflüsse automatisieren – das technische Fundament

Die SQL Pipeline ist das technische Rückgrat moderner Datenverarbeitung. Sie beschreibt eine automatisierte Kette von SQL-Abfragen und Daten-Transformationen, die strukturierte DatenStrukturierte Daten: Das Power-Upgrade für SEO, Rich Snippets & Maschinenverständnis Strukturierte Daten sind der geheime Zaubertrank im SEO-Arsenal: Sie machen Inhalte maschinenlesbar und verhelfen Websites zu prominenteren Darstellungen in den Suchergebnissen – Stichwort Rich Snippets. Im Kern geht es darum, Informationen so zu kennzeichnen, dass Suchmaschinen wie Google, Bing oder Yandex exakt verstehen, worum es auf einer Seite geht. Keine... von der Quelle bis zum Ziel (zum Beispiel Data Warehouse, DashboardDashboard: Die Kommandozentrale für Daten, KPIs und digitale Kontrolle Ein Dashboard ist weit mehr als ein hübsches Interface mit bunten Diagrammen – es ist das digitale Cockpit, das dir in Echtzeit den Puls deines Geschäfts, deiner Website oder deines Marketings zeigt. Dashboards visualisieren komplexe Datenströme aus unterschiedlichsten Quellen und machen sie sofort verständlich, steuerbar und nutzbar. Egal ob Webanalyse, Online-Marketing,..., APIAPI – Schnittstellen, Macht und Missverständnisse im Web API steht für „Application Programming Interface“, zu Deutsch: Programmierschnittstelle. Eine API ist das unsichtbare Rückgrat moderner Softwareentwicklung und Online-Marketing-Technologien. Sie ermöglicht es verschiedenen Programmen, Systemen oder Diensten, miteinander zu kommunizieren – und zwar kontrolliert, standardisiert und (im Idealfall) sicher. APIs sind das, was das Web zusammenhält, auch wenn kein Nutzer je eine... oder Machine Learning-Modell) zuverlässig, wiederholbar und skalierbar bewegen. Anders als beim simplen SQL-Script, das einmal ausgeführt wird und dann verstaubt, ist die SQL Pipeline ein Prozess, der dauerhaft läuft, überwacht und gesteuert wird. Sie ist ein zentrales Werkzeug im Daten-Engineering – und das nicht nur in hippen Tech-Firmen, sondern überall, wo Datenmengen und Datenqualität kritisch sind.

Im Kern besteht jede SQL Pipeline aus mindestens drei Komponenten: Datenextraktion (Extract), Transformation (Transform) und Laden (Load) – kurz: ETL. Der Unterschied zu klassischen ETL-Tools? SQL Pipelines setzen konsequent auf deklarative, wiederverwendbare SQL-Statements, sind modular aufgebaut und lassen sich flexibel orchestrieren. Das Ziel: Datenflüsse, die wartbar, nachvollziehbar und hochgradig automatisierbar sind.

Das ist kein akademisches Konzept, sondern die bittere Realität moderner Unternehmen. Wer seine Datenflüsse nicht automatisiert, verliert Zeit, produziert Fehler und riskiert, dass im entscheidenden Moment die Zahlen nicht stimmen. SQL Pipelines sind die Antwort auf das Daten-Chaos: Sie machen Schluss mit Copy-Paste-Skripten, Excel-Höllen und Nachtschichten, weil die Umsatzdaten wieder mal nicht stimmen. Automatisierung ist hier kein Nice-to-have – sondern Überlebensnotwendigkeit.

Und noch etwas: SQL Pipelines sind nicht exklusiv für Data Scientists oder Entwickler. Jeder, der mit Reporting, Marketing AutomationMarketing Automation: Automatisierung im modernen Online-Marketing Marketing Automation ist der Versuch, den Wahnsinn des digitalen Marketings in den Griff zu bekommen – mit Software, Algorithmen und einer Prise künstlicher Intelligenz. Gemeint ist die Automatisierung von Marketingprozessen entlang der gesamten Customer Journey, vom ersten Touchpoint bis zum loyalen Stammkunden. Was nach Roboter-Werbung klingt, ist in Wahrheit der Versuch, Komplexität zu beherrschen,... oder Customer AnalyticsAnalytics: Die Kunst, Daten in digitale Macht zu verwandeln Analytics – das klingt nach Zahlen, Diagrammen und vielleicht nach einer Prise Langeweile. Falsch gedacht! Analytics ist der Kern jeder erfolgreichen Online-Marketing-Strategie. Wer nicht misst, der irrt. Es geht um das systematische Sammeln, Auswerten und Interpretieren von Daten, um digitale Prozesse, Nutzerverhalten und Marketingmaßnahmen zu verstehen, zu optimieren und zu skalieren.... zu tun hat, profitiert davon. Das technische Fundament – sauber strukturierte, skalierbare SQL-Flows – entscheidet darüber, ob deine Datenstrategie fliegt oder baden geht.

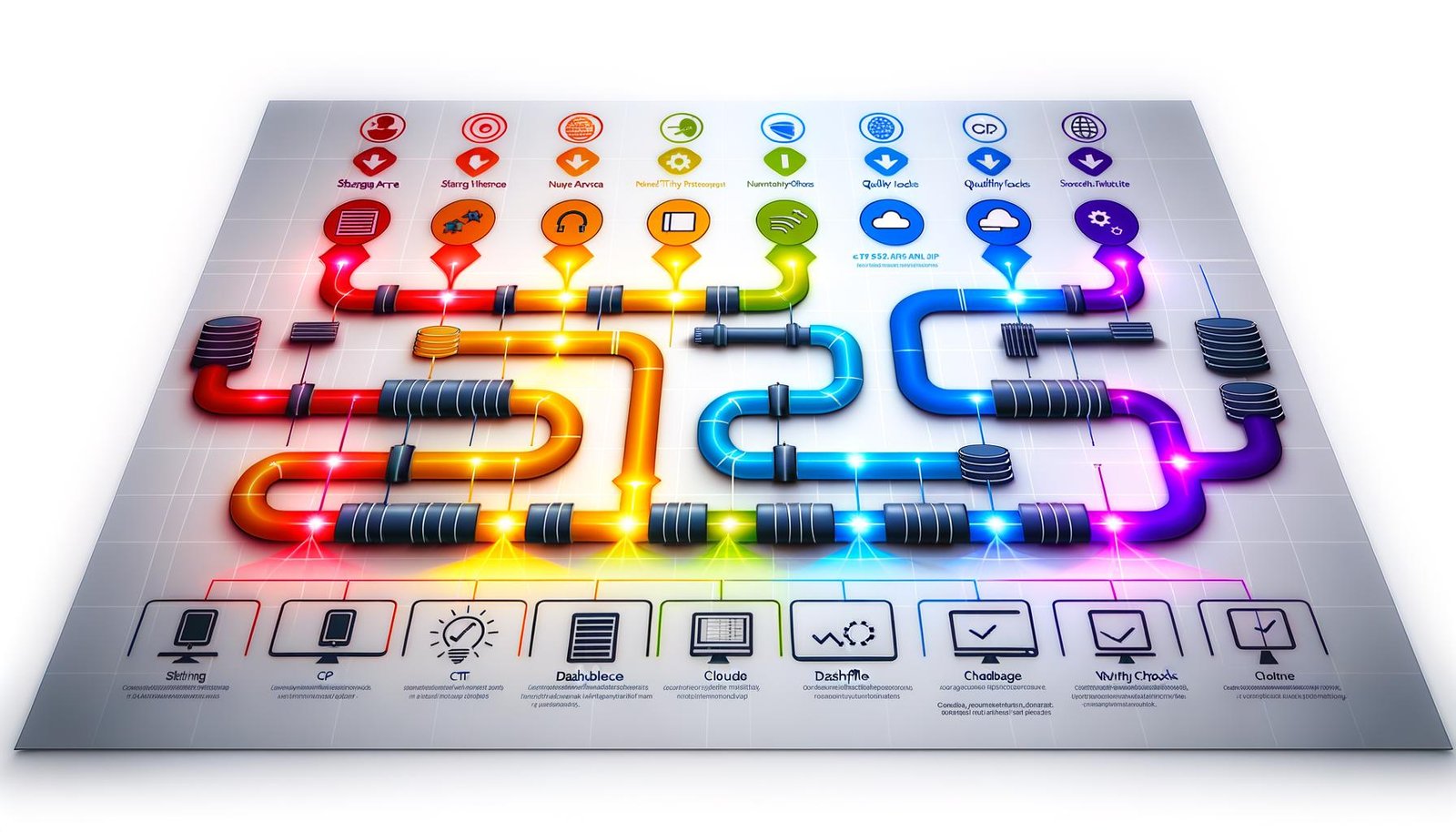

Komponenten und Architektur einer modernen SQL Pipeline: So funktioniert der Datenfluss

Jede SQL Pipeline besteht aus einer klar definierten Abfolge von Komponenten. Wer hier schludert, baut sich ein Daten-Monster, das irgendwann außer Kontrolle gerät. Die wichtigsten Bausteine sind:

- Source Layer: Hier werden Rohdaten aus unterschiedlichen Quellen (z.B. Datenbanken, APIs, Flatfiles) eingespeist. Die Verbindung erfolgt meist über Connectoren oder native Treiber.

- Staging Layer: Die Daten werden in einen temporären, oft rohen Zwischenbereich geladen. Ziel: Validierung, Strukturangleichung und erste Qualitätsprüfungen.

- Transformations-Layer: Im Herzen der Pipeline laufen SQL-Transformations-Statements ab. Hier werden Daten bereinigt, aggregiert, angereichert und in das gewünschte Zielschema gebracht. Typische Techniken: Window Functions, CTEs (Common Table Expressions), Joins, Nested Queries.

- Data Quality & Validation: Automatisierte Checks auf Konsistenz, Vollständigkeit, Dubletten und geschäftslogische Regeln. Fehlerhafte Datensätze werden isoliert und gemeldet.

- Output Layer: Die fertigen Daten werden in das Zielsystem (Data Warehouse, Data Lake, DashboardDashboard: Die Kommandozentrale für Daten, KPIs und digitale Kontrolle Ein Dashboard ist weit mehr als ein hübsches Interface mit bunten Diagrammen – es ist das digitale Cockpit, das dir in Echtzeit den Puls deines Geschäfts, deiner Website oder deines Marketings zeigt. Dashboards visualisieren komplexe Datenströme aus unterschiedlichsten Quellen und machen sie sofort verständlich, steuerbar und nutzbar. Egal ob Webanalyse, Online-Marketing,..., APIAPI – Schnittstellen, Macht und Missverständnisse im Web API steht für „Application Programming Interface“, zu Deutsch: Programmierschnittstelle. Eine API ist das unsichtbare Rückgrat moderner Softwareentwicklung und Online-Marketing-Technologien. Sie ermöglicht es verschiedenen Programmen, Systemen oder Diensten, miteinander zu kommunizieren – und zwar kontrolliert, standardisiert und (im Idealfall) sicher. APIs sind das, was das Web zusammenhält, auch wenn kein Nutzer je eine...) geladen. Hier muss die Struktur 100% passen, sonst kracht es beim Reporting oder in nachgelagerten Prozessen.

- Orchestrierung und Monitoring: Steuerung der Ausführungsreihenfolge, Überwachung der Laufzeiten, automatisierte Fehlerbenachrichtigung und Logging. Ohne Monitoring ist jede Pipeline eine Blackbox – und das rächt sich früher oder später.

Die große Stärke der SQL Pipeline: Sie lässt sich modular aufbauen. Jeder Verarbeitungsschritt ist klar abgegrenzt, kann einzeln getestet, überwacht und bei Bedarf angepasst werden. Das verhindert den typischen “Spaghetti-Code”, der bei gewachsenen Script-Lösungen schnell entsteht. Moderne SQL Pipelines setzen auf Versionierung (z.B. über Git), CI/CD-Mechanismen und transparente Logging-Strategien. So bleibt der Datenfluss nicht nur stabil, sondern auch nachvollziehbar – ein unverzichtbarer Vorteil, wenn Compliance, Audits oder schnelle Fehlerbehebung gefragt sind.

Ein weiteres technisches Asset: SQL Pipelines sind nicht an ein bestimmtes Datenbanksystem gebunden. Egal ob du mit PostgreSQL, MySQL, MS SQL Server, BigQuery, Snowflake oder Redshift arbeitest – das Grundprinzip ist immer gleich. Die wichtigsten Unterschiede liegen in Syntaxdetails, Performance-Tuning und den Möglichkeiten der Parallelisierung. Wer seine Pipeline sauber designt, kann sie mit überschaubarem Aufwand auf verschiedene Systeme portieren – ein echter Wettbewerbsvorteil beim Wechsel der Infrastruktur.

Und: Eine echte SQL Pipeline ist nicht einfach ein Batch-Job, der nachts läuft. Moderne Pipelines sind event-getrieben, können in Echtzeit (Streaming) oder Near-Real-Time (Micro-Batching) arbeiten. Das ist der Unterschied zwischen “wir haben gestern die Zahlen von vorgestern” und “wir wissen jetzt, wie der Shop läuft”.

Automatisierung, Monitoring und Skalierung: Wie du SQL Pipelines robust steuerst

Die große Schwäche klassischer Datenverarbeitung ist der manuelle Faktor. Solange irgendjemand regelmäßig ein Skript ausführen, einen Report klicken oder einen Export hochladen muss, ist die Fehleranfälligkeit maximal – und die Skalierbarkeit null. Eine SQL Pipeline eliminiert diesen Faktor durch clevere Automatisierung und robustes Monitoring.

Automatisierung bedeutet: Jede Pipeline läuft nach definiertem Zeit- oder Ereignistrigger. Ob stündlich, minütlich oder bei neuen Daten – der Prozess startet automatisch, ohne dass jemand nachhelfen muss. Das Zauberwort heißt Orchestrierung: Tools wie Apache Airflow, dbt Cloud, Prefect oder native Cloud Scheduler übernehmen die Steuerung. Sie sorgen dafür, dass Abhängigkeiten beachtet, Fehler transparent gemeldet und Folgeprozesse gezielt angestoßen werden.

Monitoring ist der zweite kritische Baustein. Ohne Echtzeit-Überwachung weißt du nicht, ob deine Datenflüsse sauber laufen oder gerade in die Wand fahren. Moderne Pipelines setzen auf automatisierte Alerts (z. B. via Slack, E-Mail, PagerDuty) und detailliertes Logging. Fehler werden nicht mehr erst im Monatsabschluss bemerkt, sondern sofort – inklusive Stacktrace und Kontext. So lässt sich schnell gegensteuern, ohne dass ganze Analysen auf faulen Daten basieren.

Skalierung ist der dritte Hebel: Was bei 1.000 Datensätzen trivial läuft, wird bei Millionen schnell zur Performance-Falle. Hier punkten Pipelines, die auf Parallelisierung, Partitionierung und effizientes SQL-Design setzen. Typische Techniken:

- Partitionierte Tabellen für schnelle Loads und Queries

- Batch-Processing für große Datenmengen

- Streaming-Ansätze für Near-Real-Time-Daten

- Pushdown-Transformationen, damit Berechnungen möglichst nah an der Datenquelle passieren

Die Folge: Datenflüsse, die auch unter hoher Last stabil laufen, keine Bottlenecks erzeugen und problemlos erweitert werden können. Wer hier spart, wird von seinem eigenen Datenwachstum überrollt – und steht am Ende wieder mit Excel und Nervenflattern da.

SQL Pipeline vs. klassische ETL-Prozesse: Was ist besser für dein Datenprojekt?

“Wir haben ein ETL-Tool, läuft doch!” – diesen Satz hört man oft, wenn es um Datenintegration geht. Doch der Teufel steckt im Detail. Klassische ETL-Prozesse (Extract-Transform-Load) setzen auf spezialisierte Tools, die grafisch konfiguriert werden und ihre eigene Scripting-Logik mitbringen (Stichwort: Informatica, Talend, SSIS, Pentaho). Das Problem: Die eigentliche Datenlogik verschwindet in Blackbox-Flows, die ohne Spezialwissen kaum wartbar sind. Änderungen werden zur Hängepartie, Fehlerquellen sind schwer zu finden, und die Flexibilität leidet massiv.

SQL Pipelines drehen den Spieß um: Sie setzen konsequent auf deklarative, transparente SQL-Statements. Jeder Transformationsschritt ist nachvollziehbar, versionierbar und lässt sich im Zweifel auch manuell debuggen. Integration mit Git, automatisierte Tests und Rollbacks sind Standard. Das macht SQL Pipelines zum Favoriten für alle, die Wert auf Wartbarkeit, Transparenz und Geschwindigkeit legen.

Ein weiterer Unterschied: Während viele klassische ETL-Tools als monolithische Plattformen arbeiten, sind SQL Pipelines typischerweise modular und leichtgewichtig. Sie lassen sich in bestehende DevOps-Prozesse integrieren, skalieren besser in der Cloud und sind einfacher zu automatisieren. Wer heute noch auf Legacy-ETL setzt, zahlt mit Flexibilität und Geschwindigkeit – und riskiert, dass beim nächsten Systemwechsel alles von vorne gebaut werden muss.

Natürlich gibt es Ausnahmen: Wenn du mit Hunderten von Datenquellen, komplexen Transformationen und Non-SQL-Logik (z.B. Text Mining) arbeiten musst, kann ein spezialisiertes ETL-Tool Sinn machen. Aber für 90% aller Marketing-, Analytics- und Reporting-Projekte ist eine gut gebaute SQL Pipeline das bessere, schnellere und wartungsärmere Fundament.

Best Practices, Fallstricke und Step-by-Step-Anleitung: So baust du eine stabile SQL Pipeline

Eine SQL Pipeline ist kein Selbstläufer – sie steht und fällt mit Technik, Disziplin und sauberem Design. Hier die wichtigsten Best Practices:

- Baue jede Pipeline modular und versionierbar auf – keine monolithischen Scripts, keine Copy-Paste-Orgien.

- Setze auf deklarative SQL-Statements statt auf prozedurale Script-Logik. Jeder Schritt muss einzeln testbar und nachvollziehbar sein.

- Nutze dedizierte Staging-Layer zur Qualitätskontrolle, bevor Daten in die Produktivumgebung fließen.

- Automatisiere alles: Ausführung, Monitoring, Fehlerbenachrichtigung und Dokumentation.

- Implementiere Data Quality Checks und Logging auf jedem einzelnen Verarbeitungsschritt.

- Dokumentiere Struktur, Logik und Abhängigkeiten – Versionierung über Git ist Pflicht.

- Denke an DatenschutzDatenschutz: Die unterschätzte Macht über digitale Identitäten und Datenflüsse Datenschutz ist der Begriff, der im digitalen Zeitalter ständig beschworen, aber selten wirklich verstanden wird. Gemeint ist der Schutz personenbezogener Daten vor Missbrauch, Überwachung, Diebstahl und Manipulation – egal ob sie in der Cloud, auf Servern oder auf deinem Smartphone herumlungern. Datenschutz ist nicht bloß ein juristisches Feigenblatt für Unternehmen, sondern... und Compliance: Maskiere oder anonymisiere sensible Daten direkt in der Pipeline.

Und jetzt zum praktischen Teil – so setzt du eine performante SQL Pipeline Schritt für Schritt auf:

- 1. Datenquellen identifizieren: Welche Daten willst du verarbeiten? Datenbanken, APIs, Flatfiles?

- 2. Staging Layer einrichten: Lege temporäre Tabellen oder Views für Rohdaten an. Prüfe Formate und Strukturen.

- 3. Transformation designen: Schreibe modulare SQL-Statements für Bereinigung, Anreicherung, Aggregation. Nutze CTEs, Window Functions und Joins intelligent.

- 4. Data Quality implementieren: Baue Validierungs-Queries für Dubletten, Nullwerte, Wertebereiche. Logge alle Fehlerfälle separat.

- 5. Output Layer definieren: Strukturiere Zieltabelle oder View. Stelle sicher, dass alle nachgelagerten Systeme das Format verstehen.

- 6. Orchestrierung automatisieren: Setze einen Scheduler (z.B. Airflow, dbt, Prefect) auf, der alle Schritte in richtiger Reihenfolge ausführt.

- 7. Monitoring und Logging aktivieren: Implementiere Alerts für Fehlschläge, Anomalien und Laufzeitüberschreitungen.

- 8. Performance testen und optimieren: Prüfe Laufzeiten, IndexierungIndexierung: Wie Webseiten den Weg in die Suchmaschine finden (und warum sie dort bleiben wollen) Autor: Tobias Hager Was bedeutet Indexierung? Definition, Grundlagen und der technische Prozess Indexierung ist im SEO-Kosmos das Eintrittsticket ins Spiel. Ohne Indexierung kein Ranking, keine Sichtbarkeit, kein Traffic – schlicht: keine Relevanz. Kurz gesagt bezeichnet Indexierung den Prozess, durch den Suchmaschinen wie Google, Bing oder..., Partitionierung. Optimiere SQL auf Skalierbarkeit.

- 9. Dokumentation und Versionierung: Pflege eine saubere Dokumentation, versioniere alle Pipelines über Git.

- 10. Go-Live und Monitoring: Starte die Pipeline produktiv, beobachte die ersten Runs, passe ggf. nach.

Anti-Pattern, die du vermeiden solltest: Keine Inline-SQL-Scripts im Scheduler, keine undokumentierten Workarounds, keine Verquickung von Transformation und Business-Logik in einem Schritt. Wer hier schlampt, baut sich eine Zeitbombe – und darf die nächsten Jahre Debuggen statt Optimieren.

Tools, Frameworks und Trends: Was im SQL Pipeline-Stack 2025 wirklich zählt

SQL Pipelines sind kein Selbstzweck – sie leben von den Tools und Frameworks, die sie orchestrieren und skalieren. 2025 gibt es einige Platzhirsche, auf die kein Datenprojekt verzichten sollte:

- dbt (Data Build Tool): Das Open-Source-Framework für modulare, versionierte SQL-Transformationen. Integriert mit Git, automatisierten Tests, Dokumentation und CI/CD. Quasi-Standard für moderne Analytics-Stacks.

- Apache Airflow: Der Orchestrierungs- und Scheduling-Standard. Ermöglicht komplexe Pipelines mit Abhängigkeiten, Monitoring, Alerting und beliebiger Skalierung – on Premise oder in der Cloud.

- Prefect: Frischer, Python-basierter Workflow-Orchestrator – schlanker als Airflow, sehr gute Cloud-Integration, schnell aufgesetzt.

- native Cloud Scheduler: z.B. Google Cloud Composer (Airflow-basiert), AWS Step Functions, Azure Data Factory – ideal für Cloud-native Pipelines.

- Monitoring-Lösungen: Prometheus, Grafana, DataDog oder dedizierte Pipeline-Logger für Echtzeit-Sichtbarkeit und Alerting.

Neue Trends: DataOps, also Continuous Integration und Delivery für Data Pipelines, setzt sich durch. Data Contracts (explizite Schnittstellen und Validierungsregeln zwischen Datenproduzenten und -konsumenten) sorgen für stabile Flows auch bei wechselnden Anforderungen. Und: Automatisierte Data Lineage macht transparent, woher jede Zahl im Reporting kommt – ein Muss für Compliance und Audits.

Die Wahrheit ist: Am Ende zählt nicht das hübscheste DashboardDashboard: Die Kommandozentrale für Daten, KPIs und digitale Kontrolle Ein Dashboard ist weit mehr als ein hübsches Interface mit bunten Diagrammen – es ist das digitale Cockpit, das dir in Echtzeit den Puls deines Geschäfts, deiner Website oder deines Marketings zeigt. Dashboards visualisieren komplexe Datenströme aus unterschiedlichsten Quellen und machen sie sofort verständlich, steuerbar und nutzbar. Egal ob Webanalyse, Online-Marketing,..., sondern ein Datenfluss, der stabil, nachvollziehbar und schnell läuft. Wer 2025 noch auf manuelle Exporte, veraltete ETL-Plattformen oder Copy-Paste-SQL setzt, verliert. Der Vorsprung entsteht im Backend – bei der SQL Pipeline.

Fazit: SQL Pipeline – der Schlüssel zu automatisierten, robusten Datenflüssen

SQL Pipeline ist kein weiteres Trendthema für Datennerds, sondern der entscheidende Hebel für effizientes, skalierbares Datenmanagement. Wer seine Datenflüsse nicht automatisiert, wird im datengetriebenen MarketingMarketing: Das Spiel mit Bedürfnissen, Aufmerksamkeit und Profit Marketing ist weit mehr als bunte Bilder, Social-Media-Posts und nervige Werbespots. Marketing ist die strategische Kunst, Bedürfnisse zu erkennen, sie gezielt zu wecken – und aus Aufmerksamkeit Profit zu schlagen. Es ist der Motor, der Unternehmen antreibt, Marken formt und Kundenverhalten manipuliert, ob subtil oder mit der Brechstange. Dieser Artikel entlarvt das... und Reporting gnadenlos abgehängt. Die Pipeline bringt Ordnung ins Datenchaos, eliminiert Fehlerquellen und macht Reporting, AnalyticsAnalytics: Die Kunst, Daten in digitale Macht zu verwandeln Analytics – das klingt nach Zahlen, Diagrammen und vielleicht nach einer Prise Langeweile. Falsch gedacht! Analytics ist der Kern jeder erfolgreichen Online-Marketing-Strategie. Wer nicht misst, der irrt. Es geht um das systematische Sammeln, Auswerten und Interpretieren von Daten, um digitale Prozesse, Nutzerverhalten und Marketingmaßnahmen zu verstehen, zu optimieren und zu skalieren.... und Machine LearningMachine Learning: Algorithmische Revolution oder Buzzword-Bingo? Machine Learning (auf Deutsch: Maschinelles Lernen) ist der Teilbereich der künstlichen Intelligenz (KI), bei dem Algorithmen und Modelle entwickelt werden, die aus Daten selbstständig lernen und sich verbessern können – ohne dass sie explizit programmiert werden. Klingt nach Science-Fiction, ist aber längst Alltag: Von Spamfiltern über Gesichtserkennung bis zu Produktempfehlungen basiert mehr digitale Realität... erst wirklich möglich – und zwar in Echtzeit, nicht “irgendwann”.

Das klingt technisch? Ist es auch – und genau das ist der Punkt. Wer heute auf Daten setzt, braucht kein weiteres Tool, sondern ein stabiles, transparentes Fundament. SQL Pipelines liefern genau das. Sie sind der Unterschied zwischen digitaler Handarbeit und echter Skalierung. Wer jetzt nicht automatisiert, bleibt zurück. Willkommen in der Zukunft der Datenströme – powered by SQL Pipeline.