AI Fake News Angst widerlegt: Fakten statt Panikmache

Wer glaubt, dass Künstliche Intelligenz das Internet in eine toxische Fake News-Hölle verwandelt, sollte mal einen Gang runterschalten – und diesen Artikel lesen. Statt aufgescheuchter Panikmache gibt’s hier knallharte Fakten, technische Hintergründe und pragmatische Lösungen, die zeigen: Die Angst vor AI Fake News ist übertrieben, oft falsch verstanden und vor allem das Ergebnis massiver Unwissenheit. Willkommen bei 404 Magazine – wo wir lieber aufklären, als mit dystopischem ClickbaitClickbait: Was steckt wirklich hinter dem Köder im Netz? Clickbait – das schmutzige kleine Geheimnis der Online-Welt. Jeder hat es gesehen, viele sind darauf hereingefallen und noch mehr regen sich darüber auf: Überschriften, die mehr versprechen, als sie halten, und Inhalte, die vor allem eins wollen – Klicks, Klicks, Klicks. Was genau ist Clickbait, wie funktioniert es, warum funktioniert es... zu spielen.

- Warum der AI Fake News Hype mehr Mythos als Realität ist

- Wie Künstliche Intelligenz wirklich funktioniert – und wo ihre Grenzen liegen

- Welche Technologien Fake News erkennen, stoppen und sogar verhindern können

- Warum klassische Medien und Social Networks hausgemachte Probleme haben

- Wie Deepfakes, Chatbots und GPT-basierte Systeme tatsächlich genutzt werden

- Konkrete technische Maßnahmen zur Erkennung und Eindämmung von AI Fake News

- Warum Panikmache gefährlicher ist als die Technologie selbst

- Was Unternehmen, Publisher und Endnutzer praktisch tun können

- Wie die Zukunft von News, Medienkompetenz und AI aussieht – jenseits der Hysterie

AI Fake News, Deepfakes, Chatbots, GPT – es gibt kaum einen Buzzword-Mix, der mehr Ängste schürt und gleichzeitig so wenig Substanz hat wie die Debatte um Künstliche Intelligenz und Desinformation. Dabei ist das meiste, was in den Medien kursiert, eine Mischung aus Halbwissen, ClickbaitClickbait: Was steckt wirklich hinter dem Köder im Netz? Clickbait – das schmutzige kleine Geheimnis der Online-Welt. Jeder hat es gesehen, viele sind darauf hereingefallen und noch mehr regen sich darüber auf: Überschriften, die mehr versprechen, als sie halten, und Inhalte, die vor allem eins wollen – Klicks, Klicks, Klicks. Was genau ist Clickbait, wie funktioniert es, warum funktioniert es... und digitaler Folklore. Fakt ist: Die technische Realität sieht differenzierter aus. Nicht jede AI ist ein Desinformations-Golem. Nicht jeder Deepfake ist glaubwürdig. Und die meisten AI-generierten Falschmeldungen werden schneller entlarvt, als sie viral gehen. Wer die Technologie versteht, erkennt: Angst ist ein mieser Ratgeber. Was wirklich zählt, sind Fakten, technische Hintergründe und eine nüchterne Bewertung der Risiken – und genau das liefert dieser Artikel.

Die Angst vor AI Fake News ist der neue heiße Scheiß – aber sie ist selten fundiert. Wer heute über KI-generierte Desinformation spricht, sollte erstmal klären, was wirklich technisch möglich ist, welche Schutzmechanismen existieren und wo die eigentlichen Schwachstellen liegen. Spoiler: Die größte Gefahr sind nicht die Algorithmen, sondern schlecht informierte Nutzer und eine Medienlandschaft, die lieber Panik verkauft als Aufklärung betreibt. Zeit für einen Realitätscheck, powered by 404 Magazine.

AI Fake News: Hysterie vs. Faktenlage – Woher kommt die Panik?

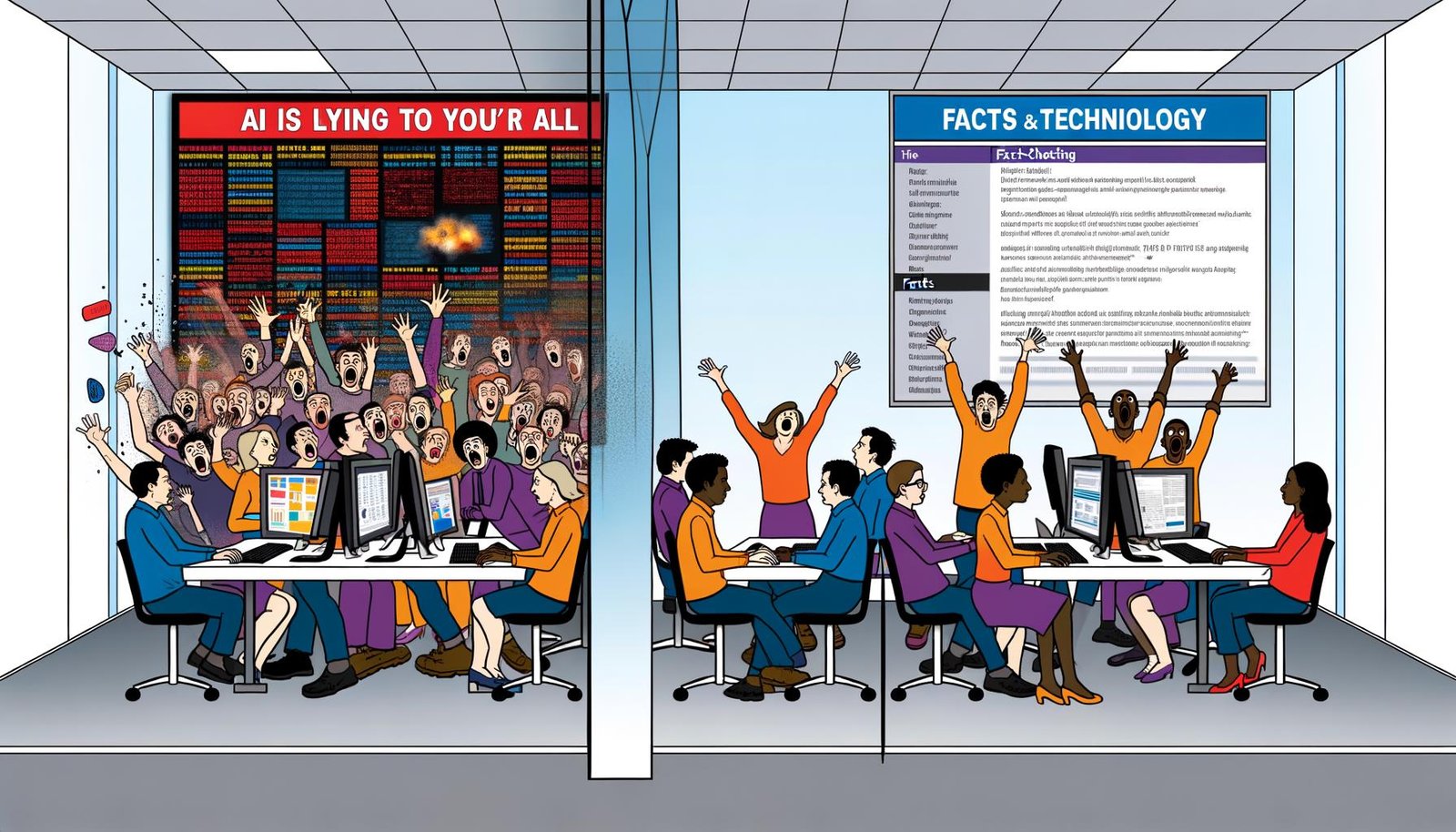

Wer regelmäßig Online-Medien und Tech-Foren verfolgt, stößt zwangsläufig auf eine Wand aus Warnungen: Deepfakes, Chatbots, GPT-Modelle und neuronale Netze könnten das Internet mit Fake News, Desinformation und Manipulation überschwemmen. Headlines wie “Die KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie... lügt uns alle an” oder “Mit GPT zum Informations-GAU” sind längst Standard. Doch was steckt hinter der Panikmache?

Im Kern basiert die Angst vor AI Fake News auf einer Mischung aus Unkenntnis über die Funktionsweise moderner KI-Modelle und einer tiefsitzenden Skepsis gegenüber technologischer Disruption. Viele verwechseln “Künstliche Intelligenz” mit einer allmächtigen, autonom agierenden EntitätEntität: Das unsichtbare Bindeglied moderner Suchmaschinenoptimierung Der Begriff „Entität“ ist mittlerweile das Buzzword im digitalen Marketing und SEO – und das zu Recht. Eine Entität ist mehr als nur ein Begriff, ein Name oder ein Keyword. Im Kontext von Suchmaschinenoptimierung und semantischem Web bezeichnet sie einen eindeutig identifizierbaren Gegenstand, eine Person, ein Konzept oder einen Ort, der unabhängig von der... – dabei sind selbst die neuesten Large Language Models (LLMs) wie GPT-4 oder Gemini nichts anderes als statistisch trainierte Textgeneratoren. Sie verstehen keine Wahrheit, sondern berechnen Wahrscheinlichkeiten für das nächste Wort im Satz. Wer das Prinzip kennt, weiß: KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie... kann nur so gut lügen, wie ihre Trainingsdaten es zulassen – und die sind (zum Glück) alles andere als perfekt.

Die mediale Panik wird zusätzlich durch spektakuläre Deepfake-Videos, Chatbot-Experimente und Social Media-Skandale befeuert. Doch die technische Realität ist komplexer: Deepfakes sind aufwendig, lassen sich immer besser detektieren, und die meisten AI-generierten Fake News sind inhaltlich so platt, dass sie von jedem halbwegs kritischen Leser entlarvt werden. Der eigentliche Skandal: Klassische Medien und Social Networks haben ihre eigenen Hausaufgaben nicht gemacht, setzen kaum auf technische Verifikation und schieben die Verantwortung lieber auf “die KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie...”.

Wer sich also fragt, ob die Angst vor AI Fake News berechtigt ist, sollte sich weniger von ClickbaitClickbait: Was steckt wirklich hinter dem Köder im Netz? Clickbait – das schmutzige kleine Geheimnis der Online-Welt. Jeder hat es gesehen, viele sind darauf hereingefallen und noch mehr regen sich darüber auf: Überschriften, die mehr versprechen, als sie halten, und Inhalte, die vor allem eins wollen – Klicks, Klicks, Klicks. Was genau ist Clickbait, wie funktioniert es, warum funktioniert es... leiten lassen – und mehr auf technische Fakten schauen. Die Wahrheit: Die Risiken sind real, aber technisch beherrschbar. Die meiste Desinformation entsteht immer noch, weil Menschen schlecht informiert sind – nicht weil Algorithmen plötzlich das Denken übernehmen.

Künstliche Intelligenz: Was kann sie wirklich – und wo sind die Grenzen bei Fake News?

Bevor wir die AI Fake News Angst endgültig zerlegen, hilft ein technischer Deep Dive: Wie funktionieren eigentlich die Systeme, die angeblich das Internet mit Lügen fluten? Das Zauberwort heißt “Machine LearningMachine Learning: Algorithmische Revolution oder Buzzword-Bingo? Machine Learning (auf Deutsch: Maschinelles Lernen) ist der Teilbereich der künstlichen Intelligenz (KI), bei dem Algorithmen und Modelle entwickelt werden, die aus Daten selbstständig lernen und sich verbessern können – ohne dass sie explizit programmiert werden. Klingt nach Science-Fiction, ist aber längst Alltag: Von Spamfiltern über Gesichtserkennung bis zu Produktempfehlungen basiert mehr digitale Realität...” – genauer: Deep Learning auf Basis neuronaler Netze. Modelle wie GPT-4, Llama oder Gemini werden mit gigantischen Datenmengen trainiert, erkennen Muster, Wahrscheinlichkeiten und erzeugen daraus Texte, Bilder oder Videos. Aber: Sie bewerten keine Wahrheiten. Sie simulieren menschliche Sprache, keine Faktenprüfung.

Das größte Missverständnis: KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie... hat keine eigene Agenda. Sie ist kein bösartiger Manipulator, sondern ein Statistik-Monster. Wenn ein LLM einen Fake News-Artikel generiert, dann weil es in den Trainingsdaten Vorlagen dafür gab – oder weil es vom User explizit dazu aufgefordert wurde. Die “Kreativität” von AI in Sachen Fake News ist also nichts anderes als ein Spiegel menschlicher Fehler, Tendenzen und Vorurteile. Und genau deshalb sind viele AI Fake News plump, inkonsistent und voller Logikfehler. Wer sie lesen kann, erkennt sie oft sofort.

Gleichzeitig gibt es technische Grenzen: Je komplexer, spezifischer und aktueller eine Fake News sein soll, desto schwieriger ist es für KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie..., eine glaubwürdige Variante zu erzeugen. Die Modelle kennen keine tagesaktuellen Ereignisse (außer sie werden nachtrainiert), können keine Fakten prüfen und sind bei Details oft fehleranfällig. Deepfakes wiederum benötigen Unmengen an Originalmaterial, laufen Gefahr, durch Artefakte oder Unschärfen aufzufliegen – und werden durch spezialisierte Detektionsalgorithmen zunehmend zuverlässig erkannt.

Der eigentliche Gamechanger: Die besten AI Fake News entstehen immer noch im Zusammenspiel Mensch-Maschine. Erst wenn Profis gezielt Modelle steuern, prompten und die Ergebnisse redigieren, wird Desinformation wirklich gefährlich. Für den Massenmarkt gilt: Die meisten KI-Fakes sind technisch limitiert, durchschaubar und für professionelle Medien kaum ein Problem.

Technologien gegen AI Fake News: So funktioniert die Erkennung in der Praxis

Wer behauptet, AI Fake News seien nicht zu stoppen, hat entweder keine Ahnung von aktueller Tech oder will Panik verbreiten. In Wahrheit gibt es eine ganze Armada an Tools, Frameworks und Algorithmen, die speziell zur Erkennung, Analyse und Eindämmung von KI-generierter Desinformation entwickelt wurden. Hier die wichtigsten Ansätze:

- ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... Authenticity Detection: Spezialisierte Machine Learning-Modelle erkennen typische Muster, Textstrukturen und statistische Abweichungen, die für KI-generierte Inhalte charakteristisch sind. Projekte wie “GLTR” (Giant Language Model Test Room) analysieren Text auf Wahrscheinlichkeitssignaturen, die menschliche Autoren kaum reproduzieren.

- Deepfake-Detektion: Bild- und Videoanalyse-Algorithmen (z.B. basierend auf Convolutional Neural Networks) spüren Deepfakes anhand von Artefakten, unnatürlichen Bewegungen oder Inkonsistenzen bei Licht und Schatten auf. Tools wie Deepware Scanner oder Microsoft Video Authenticator sind längst im Einsatz.

- Reverse Image Search & Fact Checking APIs: Automatisierte Systeme gleichen Bilder, Videos und Textpassagen mit bekannten Datenbanken ab, um Manipulationen zu entlarven. Google Fact Check Tools, Snopes APIs und InVID-WeVerify sind nur einige Beispiele.

- Blockchain-basierte Verifikation: Projekte wie Truepic oder OriginStamp sichern digitale Inhalte mit Zeitstempeln und Hashes ab, so dass nachträgliche Manipulationen sofort auffallen.

- Social Graph Analysis: Netzwerkanalysen entlarven künstlich aufgeblasene Reichweiten, Bot-Schwärme und koordinierte Desinformationskampagnen durch Anomalien im Verbreitungsmuster.

Die technische Erkennung von AI Fake News ist längst Alltag in großen Redaktionen, Social Networks und sogar bei klassischen Medienhäusern. Die Systeme sind nicht perfekt – aber sie werden mit jedem Update besser. Wer heute KI-basiert täuschen will, muss mit einer Armada technischer Gegenspieler rechnen. Die Vorstellung, dass AI Fake News unaufhaltsam durchs Netz marschieren, ist schlicht falsch.

Was hilft wirklich? Eine Mischung aus automatisierter Erkennung, menschlicher Nachprüfung und konsequenter Medienkompetenz. Wer sich blind auf Algorithmen verlässt, verliert – aber wer gar nicht hinsieht, ist noch schneller verloren.

Deepfakes, Chatbots & Co.: Wie real ist das Risiko für Gesellschaft und Unternehmen?

Deepfakes, Chatbots, GPT – was ist Hype, was ist Gefahr? Im Diskurs um AI Fake News wird oft übersehen, dass die Risiken extrem unterschiedlich sind. Deepfakes beispielsweise machen in der öffentlichen Wahrnehmung den größten Lärm, sind aber technisch immer noch schwierig massentauglich einzusetzen. Ein überzeugender Deepfake erfordert Stunden an Originalmaterial, GPU-Power und Know-how. Die Erkennung wird immer besser, und für die meisten Unternehmen gilt: Die Wahrscheinlichkeit, Ziel einer Deepfake-Kampagne zu werden, ist verschwindend gering – sofern sie nicht im politischen Rampenlicht stehen.

Chatbots und GPT-basierte Systeme können zwar automatisiert Fake News generieren – aber die Qualität ist meist so schwach, dass professionelle Medien sie sofort entlarven. Viel gefährlicher sind hier Social Bots, die gezielt Trends pushen, Hashtags manipulieren oder koordinierte Shitstorms lostreten. Auch hier gibt es technische Gegenmaßnahmen: Network-Sniffing, Bot-Detection-Algorithmen und Social Listening-Tools decken unnatürliches Verhalten schnell auf.

Für Unternehmen ist das eigentliche Risiko nicht die technische Brillanz von AI Fake News, sondern die Geschwindigkeit der Verbreitung und die Lücken in der eigenen Krisenkommunikation. Wer auf Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... schläft, keine Monitoring-Systeme nutzt oder auf klassische Pressearbeit vertraut, hat verloren. Die technischen Lösungen sind vorhanden – sie müssen nur eingesetzt werden.

Für die Gesellschaft ist Medienkompetenz wichtiger denn je. Die Fähigkeit, Quellen zu prüfen, Fakten zu hinterfragen und technische Hilfsmittel zu nutzen, entscheidet darüber, wie groß das Risiko durch AI Fake News wirklich ist. Und hier liegt der eigentliche Hebel: Wer aufklärt, entzaubert die Technologie – und nimmt den Fake News den Schrecken.

Praktische Maßnahmen gegen AI Fake News: Was wirklich hilft – Schritt für Schritt

Genug Theorie – wie sieht der AI Fake News Schutz in der Praxis aus? Hier ein systematischer Ansatz in fünf Schritten, der Technik, Prozesse und Mindset kombiniert:

- Content-Authentizität automatisiert prüfen:

Setze AI-basierte Detektions-Tools wie GLTR, ZeroGPT oder Deepware ein, um Texte, Bilder und Videos auf typische KI-Muster zu scannen. Integriere Fact-Checking-APIs direkt in Redaktions- oder Publishing-Workflows. - Medien-Monitoring & Social ListeningSocial Listening: Das digitale Stethoskop für Marken, Märkte und Meinungen Social Listening bezeichnet das systematische Überwachen, Sammeln und Analysieren von öffentlichen Online-Äußerungen zu Marken, Produkten, Themen oder Mitbewerbern in sozialen Netzwerken, Foren und anderen digitalen Kanälen. Ziel ist es, relevante Trends, Meinungen und Stimmungen zu erkennen und daraus in Echtzeit strategische Maßnahmen abzuleiten. Social Listening ist keine Kuschelmaßnahme: Wer es... etablieren:

Nutze Tools wie Meltwater, Talkwalker oder Brandwatch, um Erwähnungen, Trends und potenziell virale Fake News in Echtzeit zu tracken. Filtere automatisiert nach auffälligen Accounts, Bot-Aktivität und Koordinationsmustern. - Digitale Verifikation stärken:

Implementiere Blockchain-basierte Content-Signaturen, Timestamp-Services oder digitale Wasserzeichen, um die Integrität kritischer Inhalte zu gewährleisten. Setze Reverse Image Search und Video Hashing ein, um Manipulationen frühzeitig zu erkennen. - Redaktionelle Prozesse anpassen:

Trainiere Redakteure im Umgang mit AI Fake News, baue technische Fact-Checking-Tools in die täglichen Workflows ein und etabliere klare Eskalationsprozesse für Verdachtsfälle. - Medienkompetenz fördern:

Investiere in Schulungen, Awareness-Kampagnen und digitale Lernplattformen, um Nutzer zu befähigen, KI-generierte Inhalte kritisch zu hinterfragen und technische Hilfsmittel zu nutzen.

Wer diese Schritte konsequent umsetzt, macht es AI Fake News so schwer wie möglich. Die Technik ist da, die Methoden sind erprobt – was fehlt, ist der Wille, sie auch tatsächlich einzusetzen. Und daran scheitert es oft weniger an der KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie..., sondern an fehlender Priorität im Unternehmen oder Redaktionsalltag.

Warum Panikmache kontraproduktiv ist – und wie die Zukunft von AI und News wirklich aussieht

Die Angst vor AI Fake News ist nicht nur übertrieben – sie ist gefährlich. Wer ständig den Untergang des freien Internets herbeischreibt, nimmt den Diskursen die Sachlichkeit und verhindert Innovation. Die Realität: Künstliche Intelligenz ist ein Werkzeug. Sie kann missbraucht werden – wie jede Technologie, die jemals entwickelt wurde. Aber sie ist auch der Schlüssel, um Desinformation auf eine Art und Weise zu bekämpfen, wie es manuell nie möglich wäre.

Die Zukunft liegt in der Kombination aus Tech, Prozessen und Aufklärung. Algorithmen werden immer besser darin, Deepfakes, GPT-Texte und Social Bots zu erkennen. Redaktionen und Plattformbetreiber müssen diese Technik nicht nur nutzen, sondern auch transparent machen. Und Nutzer brauchen keine Angst vor KI-generierten Inhalten – sondern die Kompetenz, sie kritisch einzuordnen. Panikmache hilft niemandem, außer denjenigen, die von Klicks und Reichweite leben. Fakt ist: Wer die Technologie versteht, kann sie beherrschen.

Fazit: AI Fake News – Problem erkannt, Gefahr gebannt

Der Hype um AI Fake News ist groß, die technische Bedrohung real – aber keineswegs unkontrollierbar. Künstliche Intelligenz wird nicht das Ende der Wahrheit einläuten, sondern ist längst Teil der Lösung. Die meisten AI Fake News scheitern an technischer Detektion, Medienkompetenz und gesundem Menschenverstand. Wer aufklärt, schützt. Wer Panik schürt, verliert.

404 Magazine sagt: Die Angst vor AI Fake News ist überbewertet. Mit den richtigen Technologien, Prozessen und einer kritischen Öffentlichkeit wird KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie... zum Verbündeten im Kampf gegen Desinformation – nicht zum Totengräber der Wahrheit. Es wird Zeit, die Debatte zu entgiften, Fakten zu liefern und die Panikmaschine abzuschalten. Willkommen in der Realität.