Free AI Detector: So entlarvt Technik versteckte KI-Texte

Du willst KI-Texte entlarven, ohne Budget zu verbrennen und ohne auf Hokuspokus zu vertrauen? Dann brauchst du einen Free AI Detector, der mehr kann als Buzzwords zählen. In diesem Leitartikel zeigen wir dir gnadenlos ehrlich, wie du mit Free AI Detector Ansätzen, offenen Modellen und harten Metriken versteckte KI-Texte identifizierst, Angriffe abwehrst und deine Prozesse sauber skalierst – ohne rechtlich zu stolpern und ohne deinen Ruf mit falschen Anschuldigungen zu riskieren.

- Was ein Free AI Detector wirklich leistet – und wo die physikalischen Grenzen liegen

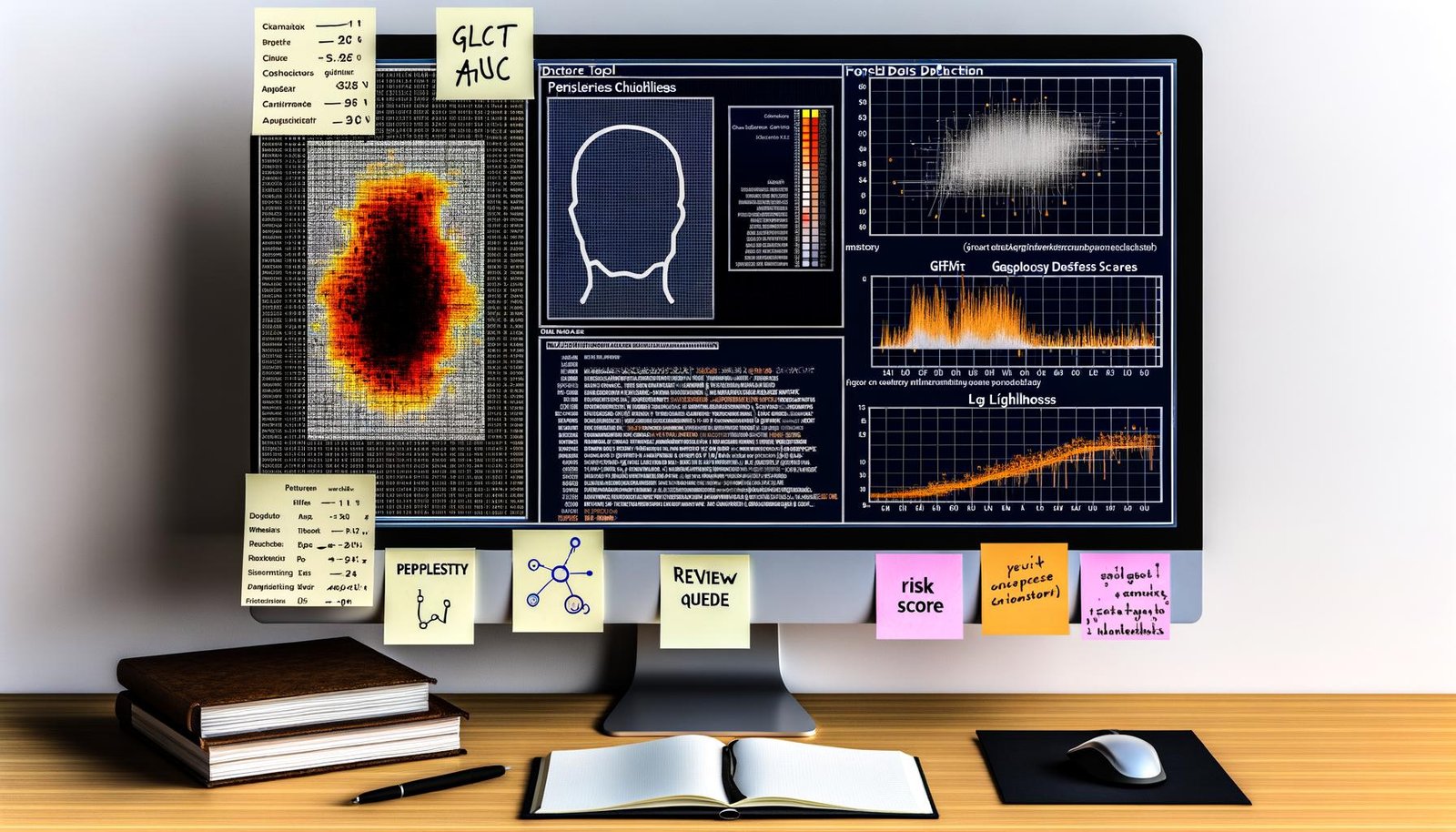

- Die Kernmethoden der AI ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... Detection: Perplexity, Burstiness, Log-Likelihood, Stylometrie und GLTR

- Welche Free-Tools in 2025 brauchbar sind, wie du sie evaluierst und korrekt kalibrierst

- Wie Autoren KI-Texte tarnen – Paraphrasing, Übersetzungs-Loops, Mensch-in-der-Schleife

- Schritt-für-Schritt: Deinen eigenen Free AI Detector mit Open-Source aufsetzen

- Messmethoden: ROC-AUC, Precision/Recall, FPR, Kalibrierung und Schwellenwerte

- Recht, Compliance und Ethik: DSGVO, Beweislast, Risikoklassen, Transparenzpflicht

- Produktionsreife Workflows: Review-Queues, Risk-Scoring, Forensik und Audit-Trails

- Woran schlechte Detektoren scheitern und wie du False Positives drastisch reduzierst

- Ein ehrliches Fazit: Detection ist Wahrscheinlichkeitsrechnung, kein Wahrheits-Orakel

Der Hype ist groß, die Enttäuschung auch: Ein Free AI Detector verspricht Klarheit, liefert aber oft Bauchschmerzen. Viele vergessen, dass KI-Erkennung probabilistisch ist und nie eine gerichtsfeste Wahrheit ausspuckt. Trotzdem kannst du mit einem Free AI Detector auf Enterprise-Niveau arbeiten, wenn du Metriken verstehst, Thresholds klug setzt und deine Datenbasis im Griff hast. Der Trick besteht darin, Signale zu kombinieren, statt in ein einziges, fehleranfälliges Urteil zu verlieben. Genau hier trennt sich Technik von Marketing-Märchen. Und genau hier beginnt dieser Artikel.

Free AI Detector ist nicht gleich Free AI Detector, und die Trefferquote hängt brutal von Sprache, Genre und Textlänge ab. Deutsch verhält sich anders als Englisch, und kurze Social-Posts sind notorisch schwerer zu erkennen als lange Fachartikel. Dazu kommen Stilbrüche, Domain-Spezifika und unterschiedliche LLM-Generationen mit variablen Token-Statistiken. Ein brauchbarer Free AI Detector muss deshalb adaptiv sein, kontextsensitiv und sauber kalibriert. Wer blind vertraut, produziert juristische Risiken und schlechte Entscheidungen. Wer intelligent kombiniert, gewinnt.

Wir zeigen dir, wie ein Free AI Detector aus mehreren Schichten besteht, die sich gegenseitig absichern. Dazu gehören probabilistische Scores, stilometrische Fingerabdrücke, Meta-Signale und robuste Prozesse. Wir erklären, warum Perplexity allein nicht reicht, wie GLTR interpretiert werden will und weshalb Wasserzeichen aktuell mehr Theorie als Praxis sind. Außerdem lernst du, welche Open-Source-Stacks für dich arbeiten, statt dich zu belügen. Am Ende baust du dir deinen Free AI Detector, der jeden bezahlten Blender alt aussehen lässt.

Free AI Detector und KI-Texte erkennen: Grundlagen, Grenzen, harte Wahrheiten

Ein Free AI Detector schätzt die Wahrscheinlichkeit, dass ein Text von einem Sprachmodell generiert wurde. Er liefert kein binäres Urteil, sondern Scores, die in einem Kontext interpretiert werden müssen. Der Kern liegt in statistischen Auffälligkeiten, die menschliche und maschinelle Texte unterschiedlich verteilen. Menschliche Sprache liebt Unordnung, Umwege und idiosynkratische Muster, Maschinen bevorzugen glatte Wahrscheinlichkeiten. Trotzdem ist die Unterscheidung nie perfekt, weil LLMs zunehmend menschliche Varianz simulieren. Je neuer das Modell, desto härter der Detektionsjob.

Die wichtigste Basisgröße heißt Log-Likelihood, also die logaritmierte Wahrscheinlichkeit, dass ein Modell jeden Token eines Textes generieren würde. Daraus leiten sich Perplexity und Burstiness ab, die die Glattheit und die Varianz über Passagen hinweg messen. Ein Free AI Detector kann über diese Metriken konsistente Muster erkennen und Abweichungen bewerten. Allerdings erzeugen kreative Prompts, Temperatur-Tuning und post-hoc Bearbeitung verwischte Spuren. Deshalb müssen mehrere Signale korreliert werden, um robuste Aussagen zu treffen. Einzelmetriken sind fast immer zu schwach.

Ein oft übersehener Faktor ist die Textlänge, die die statistische Stabilität massiv beeinflusst. Kurze Texte liefern zu wenig Token, um zuverlässig zu entscheiden, was für den Free AI Detector tödlich ist. Ab etwa 250 bis 300 Wörtern steigt die Aussagekraft spürbar, darüber hinaus stabilisieren sich Scores deutlich. Gleichzeitig verschiebt sich die Fairness-Frage, weil Nichtmuttersprachler häufig “glatter” schreiben und dadurch fälschlich als KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie... markiert werden. Das musst du mit Kalibrierung, Spracherkennung und risikobasierten Schwellen kompensieren. Ohne diese Vorkehrungen sind Fehlalarme programmiert.

Methoden der AI Content Detection: Perplexity, Burstiness, Log-Likelihood, Stylometrie, GLTR, Wasserzeichen

Perplexity misst, wie überraschend ein Text für ein Sprachmodell ist, und ist der Klassiker unter den KI-Detektionssignalen. Niedrige Perplexity kann auf maschinelle Generierung hindeuten, weil LLMs gern wahrscheinliche Tokenketten setzen. Burstiness schaut auf die Varianz über Sätze und Passagen und entdeckt glatte, zu gleichmäßige Sequenzen. Die Kombination reduziert Fehler gegenüber einem Single-Metric-Ansatz signifikant. Allerdings kippt die Aussagekraft, sobald Autoren paraphrasieren oder Temperatur und Top-p geschickt variieren. Dann braucht es zusätzliche Ebenen.

GLTR (Giant Language Model Test Room) visualisiert Token-Ränge und macht sichtbar, wie “wahrscheinlich” jeder Token war. Das hilft Analysten, Hotspots zu sichten, bleibt aber heikel für automatische Entscheidungen. Stylometrie erweitert den Blick, indem sie syntaktische und semantische Muster extrahiert: POS-n-Gramme, Satzlängenverteilung, Funktionswortprofile, Kollokationen und Interpunktionsmuster. Ein Free AI Detector, der Stylometrie und Perplexity verbindet, erreicht oft eine bessere ROC-AUC als beide Einzelsysteme. Trotzdem braucht es regelmäßiges Re-Training, weil LLMs ihre Signaturen verändern. Daten-Drift ist real, keine Randnotiz.

Wasserzeichen klingen nach der Silberkugel, sind aber in der Praxis aktuell instabil. Theoretische Verfahren markieren Token-Auswahlen über pseudozufällige Schlüssel, die später überprüfbar sein sollen. In realen Workflows zerstören leichte Edits, Übersetzungen oder Zusammenfassungen die Signatur sehr schnell. Deshalb taugen Wasserzeichen momentan eher als ergänzende Spur, nicht als Hauptbeweis. Zusätzlich gibt es modellbasierte Klassifikatoren, die direkt auf “KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie... vs. Mensch” trainiert sind, aber oft unter Domain-Shift leiden. Ein Free AI Detector sollte diese Methoden additiv nutzen, nie exklusiv.

Free AI Detector Tools in der Praxis: GPTZero, GLTR, ZeroGPT, Sapling, Writer – Stärken, Schwächen, Tuning

GLTR ist kostenlos, transparent und großartig, um eine erste, visuelle Hypothese zu bilden. Es zwingt Analysten, Token-Wahrscheinlichkeiten zu verstehen, statt blind Scores zu glauben. Als alleinige Entscheidungsinstanz eignet es sich aber nicht, weil es leicht umgehbar ist. GPTZero, ZeroGPT, Sapling und der Detector von Writer liefern schnell konsumierbare Scores, die in Workflows passen. Ihre Blackbox-Natur ist jedoch ein Risiko für Audits und Erklärbarkeit. Ein Free AI Detector Stack kombiniert daher ein visuelles Tool, ein Perplexity-Modul und eine stylometrische Ebene. So baust du Redundanz statt Abhängigkeit.

Viele dieser Free-Tools sind freemium, haben API-Limits oder unklare Trainingsdaten. Das macht eine eigene Validierung unverzichtbar, bevor du groß ausrollst. Lege einen Goldstandard-Datensatz an, der menschliche und KI-Texte aus deiner Domäne enthält, inklusive paraphrasierter Varianten. Miss ROC-AUC, Precision, Recall und die False-Positive-Rate auf Sprache, Genre und Länge. Stelle Thresholds je Segment ein, statt einen globalen Grenzwert zu nutzen. So verhinderst du, dass ein Free AI Detector dein Redaktionsteam unfair trifft. Fairness ist kein Feature, sondern Pflicht.

Bei der Nutzung im Betrieb gewinnt Kalibrierung über Ruhm. Du brauchst Platt-Scaling oder Isotonic Regression, um Scores auf echte Wahrscheinlichkeiten zu kalibrieren. Nur dann sind Schwellenwerte sinnvoll und auditierbar. Außerdem solltest du Risk-Scoring einführen, das Scores mit Metadaten verknüpft: Erstellzeit, Edit-Historie, Autorprofil, Prompt-Indikatoren oder Copy-Paste-Muster. In Summe entsteht ein Entscheidungsbaum, der Low-Risk-Fälle automatisch frei gibt und High-Risk-Fälle in eine Review-Queue schiebt. Ein guter Free AI Detector ist damit nicht nur ein Modell, sondern ein Prozess. Das ist der Unterschied zwischen Gimmick und Governance.

Wie Autoren KI-Texte verschleiern – und wie du mit einem Free AI Detector trotzdem triffst

Paraphrasing ist die populärste Tarnmethode, weil es Perplexity-Signale glättet und stilistische Spuren verwischt. Tools drehen Synonyme, variieren Satzbau und modifizieren Interpunktion, ohne den semantischen Kern zu ändern. Translation-Loops mit mehreren Sprachen erzeugen zusätzlich Rauschen in Token-Verteilungen. Mensch-in-der-Schleife ist noch hinterhältiger, wenn Redakteure KI-Output kuratieren und mit eigenen Absätzen verquicken. Ein Free AI Detector darf deshalb nicht nur lokale, sondern auch globale Muster prüfen. Kohärenzsprünge, Topic-Drift und unplausible Wissensfehler bleiben oft als Artefakte zurück. Genau dort setzt Forensik an.

Robuste Strategien kombinieren statistische Signale mit Wissensprüfungen und Metadaten. Ein semantischer Konsistenzcheck über Embeddings findet Brüche zwischen Absätzen und Überschriften. Wissens-Assertions lassen sich gegen verlässliche Quellen verifizieren, um typische LLM-Halluzinationen dingfest zu machen. Edit-Historien verraten, ob ein Text in Sekundenbruchteilen “perfekt” entstanden ist, was biologisch schwer möglich ist. Word-Processing-Metadaten und Formatierungsartefakte liefern zusätzliche Hinweise, auch wenn sie nicht beweiskräftig sind. Ein Free AI Detector aggregiert all das zu einem nachvollziehbaren Risk-Score. Transparenz ist hier kein Luxus, sondern Verteidigung.

Gegen die neuesten LLMs helfen adversarial gedachte Testsuites. Du simulierst Angriffe wie paraphrasiertes Summarizing, mehrfache Übersetzungen, Random-Interpunktion oder temperaturgesteuerte Outputs. Dann misst du Robustheit über AUC-Deltas pro Angriff. Fällt der Score drastisch, ist dein System nicht produktionsreif. Mit Data Augmentation kannst du deine Klassifikatoren härten, indem du diese Angriffe in den Trainingsmix kippst. Zusätzlich führen Segment-Thresholds dazu, dass kurze Texte nicht denselben Grenzwert nutzen wie lange Whitepaper. So bleibt dein Free AI Detector treffsicher, auch wenn Gegner kreativ werden.

Eigenbau: In 10 Schritten deinen Free AI Detector mit Open-Source bauen

Eigenbau heißt Kontrolle, und Kontrolle heißt bessere Entscheidungen bei weniger Kosten. Du nutzt offene Modelle, reproduzierbare Metriken und skalierbare Pipelines statt Proprietärmagie. Kernbausteine sind ein LM für Log-Likelihoods, ein Stylometrie-Extractor und ein Klassifikator für die Fusion. Als LM taugt ein kompaktes GPT-2 oder ein deutschsprachiges Eleuther-/Meta-Derivat, das Perplexity sinnvoll abbildet. Stylometrische Features ziehst du über POS-Tagging, Satzlängen, Funktionswörter und Interpunktionsprofile. Die finale Fusion erledigt eine logistische Regression oder ein Gradient-Boosting-Modell, das erklärbar bleibt.

Wichtig ist eine saubere Datenstrategie, sonst tränkt dich Bias. Sammle echte menschliche Texte aus deiner Domäne, KI-Texte aus mehreren Modellen und paraphrasierte Mischformen. Segmentiere nach Sprache, Länge und Genre, um domänenspezifische Thresholds abzuleiten. Splitte die Daten streng nach Autoren und Themen, damit dein Klassifikator nicht auf Personen- oder Themenartefakte überfitten kann. Evaluiere mit k-facher Cross-Validation und halte ein hartes Holdout-Set zurück. Dokumentiere jede Modellversion mit Hyperparametern, Metriken und Confusion-Matrizen. Ohne diese Disziplin ist dein Free AI Detector ein Kartenhaus.

Baue die Pipeline so, dass sie reproduzierbar und auditierbar ist. Für die Produktion brauchst du Batch- und API-Wege, Queues, Observability und Versionierung. Ein Review-Frontend zeigt Score, Feature-Attributionen und Begründungen, damit Redakteure verstehen, was passiert. Alerts feuern bei Drift oder Anomalien, wenn sich die Score-Verteilung plötzlich verschiebt. Rollouts erfolgen stufenweise, mit Shadow-Mode und kontrollierten Threshold-Anpassungen. Erst wenn die False-Positive-Rate stabil bleibt, erhöhst du Automatisierung. Ein guter Free AI Detector wächst mit Erfahrung, nicht mit Wunschdenken.

- Datensatz definieren: Menschlich, KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie..., Mischformen, segmentiert nach Sprache, Länge, Genre.

- Preprocessing: Normalisierung, Tokenisierung, Sprach- und Zeichensatzprüfung, Satzsegmentierung.

- LM wählen: Offenes Modell für Log-Likelihood und Perplexity, stabil auf Deutsch.

- Perplexity-Engine: Durchschnittliche und satzweise Perplexity, plus Varianz (Burstiness).

- Stylometrie: POS-n-Gramme, Satzlängen, Funktionswörter, Interpunktionsmuster, Kollokationen.

- Feature-Fusion: Konkateniere statistische und stilometrische Features, skaliere sie sauber.

- Klassifikator: Logistische Regression oder Gradient Boosting, mit Kalibrierung der Wahrscheinlichkeiten.

- Evaluation: ROC-AUC, PR-AUC, F1, FPR bei kritischen Thresholds, segmentiert nach Sprache und Länge.

- Kalibrierung: Isotonic/Platt-Scaling, separat pro Segment, Validierung auf Holdout-Set.

- Deployment: APIAPI – Schnittstellen, Macht und Missverständnisse im Web API steht für „Application Programming Interface“, zu Deutsch: Programmierschnittstelle. Eine API ist das unsichtbare Rückgrat moderner Softwareentwicklung und Online-Marketing-Technologien. Sie ermöglicht es verschiedenen Programmen, Systemen oder Diensten, miteinander zu kommunizieren – und zwar kontrolliert, standardisiert und (im Idealfall) sicher. APIs sind das, was das Web zusammenhält, auch wenn kein Nutzer je eine..., Queue, Monitoring, Drift-Detection, Audit-Logs, Rollback-Strategie.

Governance, Recht und Prozesse: Von ROC-Kurven bis DSGVO – Detection richtig operationalisieren

Detection ist ohne Governance ein Haftungsrisiko mit Ansage. Zuerst definierst du Policy-Ziele: Plagiatsschutz, Prüfpflichten, Qualitätsstandards und Sanktionen. Dann legst du akzeptable Fehlerraten fest, denn Null Fehler gibt es nicht. In sensiblen Szenarien priorisierst du niedrige False Positives und akzeptierst höhere False Negatives. In Content-Farmen ist es oft umgekehrt, weil Volumen und Risiko anders gewichtet werden. Diese Entscheidungen müssen dokumentiert, kommuniziert und regelmäßig überprüft werden. Ein Free AI Detector ist damit Teil eines Compliance-Systems, nicht nur ein Tool.

Rechtlich punktest du mit Transparenz und Verhältnismäßigkeit. DSGVO fordert Datenminimierung, klare Zwecke und nachvollziehbare Entscheidungen. Speichere nur, was du brauchst, und erkläre, wie Scores zustande kommen. Wenn du personenbezogene Daten verarbeitest, brauchst du eine Rechtsgrundlage und Schutzmaßnahmen. Baue Einspruchswege ein, in denen Menschen Verdachtsbewertungen anfechten können. Technisch helfen Explainability-Methoden, Feature-Attributionen und Score-Historien. Diese Elemente sind nicht optional, wenn du langfristig sicher arbeiten willst.

Im Betrieb brauchst du einen sauberen Prozessfluss mit klaren Rollen. Der Free AI Detector klassifiziert, ein Reviewer prüft High-Risk-Fälle, und ein Audit-Trail bewahrt alle Schritte. KPI-Dashboards zeigen FPR, TPR, AUC und die durchschnittliche Review-Zeit. Drift-Detection vergleicht Score-Verteilungen über Zeitfenster und schlägt Alarm bei Verschiebungen. Quartalsweise Re-Calibration stellt sicher, dass neue LLM-Generationen dich nicht überrollen. Dieser Prozess macht aus Technik dauerhaftes Risikomanagement statt Strohfeuer. Alles andere ist Selbstbetrug im Produktionskleid.

Am Ende des Tages ist ein Free AI Detector so gut wie seine Daten, seine Kalibrierung und seine Einbettung in echte Workflows. Die gute Nachricht: Du brauchst kein Budgetmonster, um nahe ans Maximum zu kommen. Mit offenen Modellen, klaren Metriken und einer robusten Pipeline schlägst du die meisten proprietären Blackboxes. Die schlechte Nachricht: Es gibt keine Abkürzung, nur saubere Arbeit. Wer das akzeptiert, spart Geld, Zeit und Reputation. Und entlarvt KI-Texte, ohne Kollateralschäden zu produzieren.

Die harte Wahrheit ist klar: KI-Detektion ist Wahrscheinlichkeitsmanagement, keine Kristallkugel. Wenn du die Signale stapelst, falsch-positive Risiken kontrollierst und deine Schwellenwerte segmentierst, wird aus Raten System. Genau so muss moderne Content-Forensik funktionieren. Mit diesem Leitfaden hast du die Blaupause in der Hand, um einen Free AI Detector auf Produktionsniveau zu heben. Du weißt jetzt, welche Metriken tragen, wo Free-Tools helfen und wann Eigenbau schlägt. Der Rest ist Disziplin, Iteration und ein gesundes Misstrauen gegenüber einfachen Antworten.