Maschinenethik Debatte Neubewertung: Zukunft digitaler Moral?

Du glaubst, Maschinenethik sei ein philosophisches Nischenthema, das nur gelangweilte Geisteswissenschaftler in verstaubten Hörsälen beschäftigt? Willkommen im 21. Jahrhundert, wo moralische Algorithmen längst darüber entscheiden, ob du einen Kredit bekommst, ob dein Auto abbremst – oder ob eine KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie... deinen Job übernimmt. Die Debatte zur Maschinenethik ist nicht nur hochaktuell, sondern wird das digitale Spielfeld der nächsten Dekade brutal neu sortieren. Zeit für eine radikale Neubewertung: Was ist digitale Moral – und wie retten wir uns vor den Ethik-Algorithmen der Zukunft?

- Maschinenethik ist kein Elfenbeinturm-Thema, sondern der neue Grundpfeiler digitaler Gesellschaften.

- Algorithmen treffen längst moralische Entscheidungen – oft ohne Transparenz oder Kontrolle.

- Die aktuelle Debatte ignoriert technische Realitäten und versteckt sich hinter leeren Ethik-Leitlinien.

- Machine LearningMachine Learning: Algorithmische Revolution oder Buzzword-Bingo? Machine Learning (auf Deutsch: Maschinelles Lernen) ist der Teilbereich der künstlichen Intelligenz (KI), bei dem Algorithmen und Modelle entwickelt werden, die aus Daten selbstständig lernen und sich verbessern können – ohne dass sie explizit programmiert werden. Klingt nach Science-Fiction, ist aber längst Alltag: Von Spamfiltern über Gesichtserkennung bis zu Produktempfehlungen basiert mehr digitale Realität..., autonome Systeme und KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie... verändern Moralbegriffe und Verantwortungsstrukturen radikal.

- Bias, Blackboxes und fehlende Verantwortlichkeit sind keine Bugs, sondern systemische Kollateralschäden.

- Regulierung, Auditing und Explainable AI sind die neuen Schlachtfelder der Maschinenethik.

- Wer digitale Moral outsourct, spielt gefährliches Roulette mit gesellschaftlicher Akzeptanz und Rechtssicherheit.

- Praktische Schritte: Wie Unternehmen und Entwickler die Maschinenethik operationalisieren können – und müssen.

- Die Zukunft: Warum Maschinenethik der entscheidende WettbewerbsfaktorWettbewerbsfaktor: Die unterschätzte Waffe im Online-Marketing Der Begriff Wettbewerbsfaktor ist im digitalen Marketing und darüber hinaus ein zentrales Konzept – und wird trotzdem von vielen Marketern sträflich unterschätzt. Ein Wettbewerbsfaktor beschreibt jene Eigenschaften, Ressourcen oder Fähigkeiten, mit denen sich ein Unternehmen oder eine Website im Marktumfeld von der Konkurrenz abhebt. Im Online-Marketing bedeutet das: Wer seine Wettbewerbsfaktoren nicht kennt, betreibt... für Tech, MarketingMarketing: Das Spiel mit Bedürfnissen, Aufmerksamkeit und Profit Marketing ist weit mehr als bunte Bilder, Social-Media-Posts und nervige Werbespots. Marketing ist die strategische Kunst, Bedürfnisse zu erkennen, sie gezielt zu wecken – und aus Aufmerksamkeit Profit zu schlagen. Es ist der Motor, der Unternehmen antreibt, Marken formt und Kundenverhalten manipuliert, ob subtil oder mit der Brechstange. Dieser Artikel entlarvt das... und Gesellschaft wird.

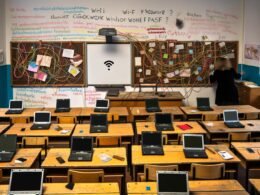

Maschinenethik – klingt nach Science Fiction, ist aber längst bittere Realität. Während “digitale Moral” in den Marketingbroschüren von Tech-Konzernen wie ein Feel-Good-Feature verkauft wird, sieht die Praxis anders aus: Systeme, die mit Machine LearningMachine Learning: Algorithmische Revolution oder Buzzword-Bingo? Machine Learning (auf Deutsch: Maschinelles Lernen) ist der Teilbereich der künstlichen Intelligenz (KI), bei dem Algorithmen und Modelle entwickelt werden, die aus Daten selbstständig lernen und sich verbessern können – ohne dass sie explizit programmiert werden. Klingt nach Science-Fiction, ist aber längst Alltag: Von Spamfiltern über Gesichtserkennung bis zu Produktempfehlungen basiert mehr digitale Realität..., Deep Neural Networks und algorithmischem Decision Making ausgestattet sind, übernehmen immer mehr Verantwortung – und treffen Entscheidungen, die früher Menschen (und damit menschliche Moral) vorbehalten waren. Der Haken? Moralische Kategorien sind für Maschinen keine native Funktion, sondern müssen als technische Layer aufgesetzt werden. Und genau hier beginnt das Dilemma: Wer entscheidet, was “gut” oder “richtig” ist, wenn die Maschine autonom handelt? Die Maschinenethik Debatte tobt – aber sie kratzt viel zu oft an der Oberfläche. Es ist Zeit für ein Update, das die technischen, gesellschaftlichen und wirtschaftlichen Realitäten brutal ehrlich in den Fokus rückt.

Maschinenethik: Definition, Status Quo und die große Illusion der Kontrolle

Maschinenethik – das ist die Disziplin, die sich mit der Frage beschäftigt, ob und wie Maschinen moralische Entscheidungen treffen können oder sollen. In der Theorie klingt das elegant: Wir schreiben ein paar Ethik-Guidelines, trainieren ein Modell auf “guten” Daten und lassen die KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie... den Rest erledigen. In der Praxis ist das nichts weiter als ein Placebo für ein viel größeres Problem. Denn die klassische Ethik – ob Deontologie, Utilitarismus oder Tugendethik – lässt sich nicht 1:1 in Code übersetzen. Jede noch so ausgefeilte If-Else-Logik oder probabilistische Entscheidungsstruktur bleibt eine Abstraktion von menschlicher Komplexität.

Der Status Quo? Unternehmen und Entwickler klatschen “Ethik” als Buzzword in ihre Produktpräsentationen, während im Backend Blackbox-Algorithmen auf Basis von Big DataBig Data: Datenflut, Analyse und die Zukunft digitaler Entscheidungen Big Data bezeichnet nicht einfach nur „viele Daten“. Es ist das Buzzword für eine technologische Revolution, die Unternehmen, Märkte und gesellschaftliche Prozesse bis ins Mark verändert. Gemeint ist die Verarbeitung, Analyse und Nutzung riesiger, komplexer und oft unstrukturierter Datenmengen, die mit klassischen Methoden schlicht nicht mehr zu bändigen sind. Big Data..., Natural Language Processing oder Computer Vision Entscheidungen treffen, die weder nachvollziehbar noch auditierbar sind. Wer glaubt, eine Ethik-Kommission mit halbjährlichen Meetings könne diese Systeme im Zaum halten, ist entweder naiv – oder Teil des Problems.

Das eigentliche Problem ist die Illusion der Kontrolle. Während Policy-Maker über Leitlinien diskutieren, werden in der Praxis längst systemische Biases, diskriminierende Trainingsdaten und intransparente Entscheidungsbäume deployed. Das Resultat: Maschinen entscheiden, Menschen haften. Und die Verantwortung? Landet im Nirwana der unterbesetzten Compliance-Abteilungen.

Maschinenethik ist also kein akademisches Luxusproblem, sondern knallharte Realität mit gesellschaftlicher Sprengkraft. Wer sie weiter ignoriert, riskiert den digitalen Super-GAU – und zwar nicht nur für Tech-Konzerne, sondern für ganze Gesellschaften.

Die technischen Grundlagen: Warum Algorithmen keine Moral kennen (können)

Maschinenethik Debatte Neubewertung ist ohne einen tiefen technischen Blick nicht nur unvollständig, sondern schlichtweg wertlos. Wer glaubt, dass ein AlgorithmusAlgorithmus: Das unsichtbare Rückgrat der digitalen Welt Algorithmus – das Wort klingt nach Science-Fiction, ist aber längst Alltag. Ohne Algorithmen läuft heute nichts mehr: Sie steuern Suchmaschinen, Social Media, Navigation, Börsenhandel, Werbung, Maschinen und sogar das, was du in deinem Lieblingsshop zu sehen bekommst. Doch was ist ein Algorithmus eigentlich, wie funktioniert er und warum ist er das ultimative Werkzeug... “gut” oder “böse” sein kann, hat schon verloren. Algorithmen sind deterministische oder stochastische Entscheidungsstrukturen, die Daten nach vordefinierten Regeln oder Wahrscheinlichkeiten verarbeiten. Sie kennen keine Werte, keine Moral, keine Grauzonen – sie kennen nur Input und Output.

Im Machine LearningMachine Learning: Algorithmische Revolution oder Buzzword-Bingo? Machine Learning (auf Deutsch: Maschinelles Lernen) ist der Teilbereich der künstlichen Intelligenz (KI), bei dem Algorithmen und Modelle entwickelt werden, die aus Daten selbstständig lernen und sich verbessern können – ohne dass sie explizit programmiert werden. Klingt nach Science-Fiction, ist aber längst Alltag: Von Spamfiltern über Gesichtserkennung bis zu Produktempfehlungen basiert mehr digitale Realität... – egal ob supervised, unsupervised oder reinforcement-based – entscheidet der Trainingsdatensatz über das “moralische Rückgrat” der Maschine. Biases, strukturelle Diskriminierung oder gesellschaftliche Vorurteile werden nicht erkannt, sondern mit voller Wucht repliziert. Das Paradebeispiel: Gesichtserkennungssysteme, die People of Color schlechter erkennen oder Kredit-Algorithmen, die Minderheiten systematisch benachteiligen. Ursache: Garbage in, garbage out. Die Maschine ist nicht moralisch – sie ist exakt so “fair”, wie es die Datenbasis zulässt.

Technisch gesehen sind Blackbox-Modelle wie Deep Neural Networks besonders problematisch. Ihre hochkomplexen, nichtlinearen Entscheidungsstrukturen entziehen sich selbst erfahrenen Entwicklern. Explainable AI (XAI) ist aktuell noch eher ein Versprechen als ein funktionierendes Framework. Die Maschinenethik Debatte Neubewertung muss akzeptieren: Solange wir nicht verstehen, wie Maschinen zu ihren Entscheidungen kommen, können wir auch keine Moral implementieren – wir können sie nur simulieren.

Auch bei autonomen Systemen wie selbstfahrenden Autos oder automatisierten Waffensystemen gilt: Moralische Dilemmata lassen sich nicht mit ein paar Zeilen Code lösen. Die berühmte “Trolley-Problem”-Simulation ist ein nettes Gedankenspiel, aber im Ernstfall entscheidet das System nach programmierten Zielvorgaben, Gewichtungen und Wahrscheinlichkeiten – nicht nach menschlicher Intuition oder Empathie.

Bias, Blackboxes und die systemische Verantwortungslosigkeit im Zeitalter der KI

Wenn man ehrlich ist, besteht die Maschinenethik Debatte Neubewertung aktuell aus drei Hauptproblemen: Bias, Blackbox und Verantwortungslosigkeit. Bias – also systematische Verzerrung – entsteht durch Trainingsdaten, die gesellschaftliche Vorurteile, Diskriminierung oder strukturelle Ungleichheiten abbilden. Ein AlgorithmusAlgorithmus: Das unsichtbare Rückgrat der digitalen Welt Algorithmus – das Wort klingt nach Science-Fiction, ist aber längst Alltag. Ohne Algorithmen läuft heute nichts mehr: Sie steuern Suchmaschinen, Social Media, Navigation, Börsenhandel, Werbung, Maschinen und sogar das, was du in deinem Lieblingsshop zu sehen bekommst. Doch was ist ein Algorithmus eigentlich, wie funktioniert er und warum ist er das ultimative Werkzeug..., der auf diesen Daten trainiert wird, übernimmt diese Muster nicht nur, sondern verstärkt sie oft noch durch automatisierte Skalierung.

Blackbox – das ist das kryptische Herz moderner KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie.... Deep Learning und komplexe Entscheidungsbäume führen dazu, dass selbst Entwickler nicht mehr nachvollziehen können, warum eine Entscheidung so und nicht anders getroffen wurde. Die Folge: Es gibt keine transparente Auditspur, keinen nachvollziehbaren moralischen Entscheidungsweg – sondern nur Output, der “irgendwie” zustande gekommen ist. Für Auditing, Compliance und Rechtssicherheit ist das ein Desaster.

Verantwortungslosigkeit ist das logische Resultat. Wer haftet, wenn eine KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie... eine diskriminierende Entscheidung trifft? Der Entwickler? Der Betreiber? Der Nutzer? Oder niemand? Ohne klare Verantwortungsstrukturen bleibt die Maschinenethik Debatte ein zahnloser Papiertiger. Besonders brisant: Viele Unternehmen nutzen diese Grauzonen gezielt aus, um sich regulatorischer Verantwortung zu entziehen und ethische Probleme als “unlösbar” zu deklarieren.

Die Maschinenethik Debatte Neubewertung muss deshalb radikal ehrlich sein: Maschinen übernehmen Verantwortung, aber ohne Moral. Die Moral muss auf Systemebene durchgesetzt werden – mit Auditing, Regulierung und technischer Kontrolle. Alles andere ist digitaler Fatalismus.

Maschinenethik operationalisieren: Tools, Auditing und Explainable AI in der Praxis

Wer glaubt, Maschinenethik lasse sich mit einem “Ethik-Statement” auf der Unternehmenswebsite erledigen, hat die Zeichen der Zeit nicht erkannt. Die Maschinenethik Debatte Neubewertung verlangt nach technischen, prozessualen und regulatorischen Lösungen – und zwar jetzt, nicht irgendwann. Was heißt das konkret?

Erstens: Bias-Detection-Tools und Fairness-Frameworks müssen Standard werden. Open-Source-Lösungen wie AI Fairness 360 (IBM), Fairlearn (Microsoft) oder Google’s What-If Tool sind Pflicht, keine Kür. Sie ermöglichen es, Trainingsdaten und Modelle systematisch auf Verzerrungen zu prüfen und diese aktiv zu mitigieren. Unternehmen, die darauf verzichten, spielen mit ihrem Ruf – und mit ihrem Haftungsrisiko.

Zweitens: Auditing und Monitoring. Jedes KI-System, das kritische Entscheidungen trifft, muss auditiert werden. Das heißt: Transparente Logging-Mechanismen, nachvollziehbare Entscheidungsbäume und regelmäßige externe Prüfungen. Model Cards und Data Sheets for Datasets sind hier State of the Art. Wer KI-Systeme ohne Monitoring betreibt, handelt grob fahrlässig.

Drittens: Explainable AI. Die Maschinenethik Debatte Neubewertung kommt ohne XAI nicht aus. Techniken wie LIME (Local Interpretable Model-Agnostic Explanations), SHAP (SHapley Additive exPlanations) oder Counterfactual Explanations sollen das Blackbox-Problem entschärfen. Die Realität: Wirklich verständliche Erklärungen sind noch die Ausnahme, nicht die Regel. Trotzdem gilt: Wer keine Erklärbarkeit bieten kann, sollte keine kritischen Systeme deployen.

Viertens: Regulierung und Governance. Die EU arbeitet mit dem AI Act an einem rechtlichen Rahmen, der Maschinenethik in Gesetzesform gießt. Unternehmen müssen sich auf Audits, Prüfpflichten und Haftungsregeln einstellen. Die Zeit der Selbstregulierung ist vorbei. Wer jetzt nicht handelt, wird von der regulatorischen Realität überrollt – oder aus dem Markt gedrängt.

- Bias-Detection-Tools einsetzen und regelmäßig Modelle auf Diskriminierung prüfen

- Auditing- und Monitoring-Prozesse implementieren (Model Cards, Data Sheets, Logging)

- Explainable AI als Mindeststandard für kritische Systeme verlangen

- Regulatorische Vorgaben frühzeitig antizipieren und Compliance-Strukturen schaffen

- Ethik nicht outsourcen, sondern in alle Entwicklungsphasen integrieren

Maschinenethik Debatte Neubewertung: Wie Unternehmen und Entwickler digitale Moral operationalisieren können

Die Maschinenethik Debatte Neubewertung ist kein akademisches Hobby, sondern eine Überlebensstrategie für Unternehmen und Entwickler. Wer digitale Moral operationalisieren will, muss Ethik als Teil der technischen Architektur verstehen – nicht als nachgelagerten Compliance-Check. Das funktioniert nur, wenn Ethik in jeden Schritt des Entwicklungsprozesses integriert wird: von der Datenbeschaffung über das Modelltraining bis zum Deployment und Monitoring.

Praktisch bedeutet das:

- Ethik-Reviews als Pflichtschritt in jeder Entwicklungsphase einführen – analog zu Code-Reviews.

- Interdisziplinäre Teams bilden: Entwickler, Ethiker, Juristen und Stakeholder an einen Tisch holen.

- Bias-Detection-Tools kontinuierlich einsetzen, nicht nur als einmaligen Check.

- Explainability-Standards definieren und durchsetzen – nicht nur für Regulatoren, sondern für Nutzer und Kunden.

- Regelmäßige Audits und externe Prüfungen als Standard etablieren – auch wenn das unbequem ist.

- Verantwortungsstrukturen klar definieren: Wer haftet für ethische Fehlentscheidungen?

Unternehmen, die hier nicht investieren, werden von Regulatoren, Märkten und Nutzern überrollt. Digitale Moral wird zum entscheidenden WettbewerbsfaktorWettbewerbsfaktor: Die unterschätzte Waffe im Online-Marketing Der Begriff Wettbewerbsfaktor ist im digitalen Marketing und darüber hinaus ein zentrales Konzept – und wird trotzdem von vielen Marketern sträflich unterschätzt. Ein Wettbewerbsfaktor beschreibt jene Eigenschaften, Ressourcen oder Fähigkeiten, mit denen sich ein Unternehmen oder eine Website im Marktumfeld von der Konkurrenz abhebt. Im Online-Marketing bedeutet das: Wer seine Wettbewerbsfaktoren nicht kennt, betreibt.... Wer Ethik operationalisiert, gewinnt Vertrauen, Marktanteile – und Rechtssicherheit. Wer nicht, riskiert den digitalen Super-GAU.

Die Zukunft digitaler Moral: Maschinenethik als strategischer Erfolgsfaktor

Die Maschinenethik Debatte Neubewertung ist längst mehr als ein philosophischer Diskurs. Sie ist der neue Maßstab für gesellschaftliche Akzeptanz, regulatorische Compliance und unternehmerischen Erfolg. Autonome Systeme, KI-gestützte Entscheidungsprozesse und algorithmische Steuerung werden in den nächsten Jahren explosionsartig zunehmen. Die Frage ist nicht, ob Maschinen moralisch entscheiden – sondern wie wir ihre Moral technisch, organisatorisch und rechtlich kontrollieren.

Die Zukunft digitaler Moral wird durch drei Faktoren bestimmt:

- Technische Robustheit: Systeme müssen auditierbar, nachvollziehbar und steuerbar sein.

- Regulatorische Durchsetzung: Der AI Act, DSGVO und weitere Regulierungen werden Ethik verpflichtend machen.

- Gesellschaftliche Legitimation: Wer Maschinenethik ignoriert, verliert das Vertrauen von Kunden, Partnern und Öffentlichkeit.

Die Maschinenethik Debatte Neubewertung zeigt: Digitale Moral ist kein Luxus, sondern die neue Grundlage für jede Form von digitaler Wertschöpfung. Unternehmen, Entwickler und Gesellschaft müssen jetzt handeln – sonst entscheiden Maschinen über unsere Zukunft, ohne dass wir noch mitreden können.

Fazit: Maschinenethik Debatte Neubewertung – ohne digitale Moral keine Zukunft

Die Maschinenethik Debatte Neubewertung ist kein Feigenblatt für Tech-Konzerne, sondern die Überlebensfrage für die digitale Gesellschaft. Algorithmen und KIKI (Künstliche Intelligenz): Mythos, Marketing-Buzzword oder echte Disruption? KI steht für Künstliche Intelligenz – ein Begriff, der seit Jahrzehnten zwischen Science-Fiction, Hype und handfester Technologie pendelt. Im Kern beschreibt KI die Entwicklung von Algorithmen und Systemen, die Aufgaben lösen können, für die traditionell menschliche Intelligenz notwendig war: Verstehen, Lernen, Schlussfolgern, Problemlösen, Wahrnehmen. KI ist längst mehr als ein Buzzword. Sie... übernehmen längst Verantwortung – aber Moral bleibt ein menschliches Konzept, das wir technisch, regulatorisch und organisatorisch absichern müssen. Wer das verschläft, riskiert nicht nur Skandale, sondern den Verlust von Markt, Vertrauen und Rechtssicherheit.

Die Zukunft digitaler Moral ist jetzt. Unternehmen, Entwickler und Politik müssen Maschinenethik operationalisieren, auditieren und technisch verankern. Ethik ist kein Add-on, sondern der neue Standard. Wer das ignoriert, wird von der Realität überrollt – und von smarteren, verantwortungsvolleren Wettbewerbern aus dem Markt gedrängt.