Sanity Serverless Deployment Setup: Profi-Anleitung für Profis

Du willst Sanity headless, serverless und skalierbar deployen wie die Großen? Zeit, die Spielzeug-Tutorials zu vergessen. Hier gibt’s die radikal ehrliche, technisch kompromisslose Anleitung für alle, die wirklich wissen wollen, wie man Sanity in einer serverlosen Infrastruktur robust, sicher und maximal performant betreibt. Kein Marketing-Geschwafel, keine veralteten Best Practices – sondern ein Setup, das dich garantiert nicht zum Bottleneck deiner eigenen Plattform macht.

- Warum Sanity serverless deployen? Vorteile, Mythen und harte Fakten

- Architekturüberblick: Headless, serverless, API-first – was wirklich zählt

- Die fünf größten Stolperfallen beim Sanity Serverless Deployment (und wie du sie vermeidest)

- Step-by-Step: Sanity-Deployment auf Vercel, Netlify, AWS Lambda & Co.

- CI/CD, Webhooks und Realtime-Content-Updates: So automatisierst du dein Deployment wie ein Profi

- Security, Skalierung und Monitoring: Sanity serverless ohne schlaflose Nächte

- Performance-Optimierung, Caching und API-Strategien – für wirklich schnelle Sanity-Projekte

- Best Practices aus echten Enterprise-Projekten – keine Theorie, sondern Praxiserfahrung

Sanity Serverless Deployment ist für viele Entwickler immer noch eine Blackbox. Klar, die Demos sehen schick aus – aber wenn es um echte Projekte, Speed, Sicherheit und Skalierbarkeit geht, trennt sich die Spreu vom Weizen. Wer Sanity wirklich serverless betreiben will, muss verstehen, wie Headless-CMS, deployment pipelines, API-Limits und moderne Cloud-Infrastrukturen zusammenspielen. In diesem Artikel zerlegen wir das Thema bis zur letzten Zeile YAML – damit du nie wieder im DevOps-Sumpf stecken bleibst.

Sanity Serverless Deployment ist kein “Deploy mit einem Klick” – sondern ein komplexes Zusammenspiel aus API-first-Architektur, Cloud Functions, CDN-Caching, CI/CD-Automatisierung und Turbo-Monitoring. Wer glaubt, dass ein statisches Frontend plus ein Sanity-Projekt auf Vercel schon reicht, lernt spätestens bei Traffic-Spitzen oder fehlerhafter Authentifizierung, wie schnell ein Serverless-Setup implodieren kann. Hier bekommst du keine halbgaren Best Practices, sondern eine Anleitung, die die realen Schwachstellen adressiert – und dich wirklich weiterbringt.

Sanity Serverless Deployment: Warum serverless und headless nicht nur Buzzwords sind

Sanity Serverless Deployment ist mehr als ein Hype für Tech-Buzzword-Bingos. Die Kombination aus Headless-CMS und serverloser Infrastruktur ist das Fundament moderner Digitalprojekte. Wer Sanity als Headless-CMS nutzt, setzt auf API-first – das heißt, der ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... kommt per GraphQL oder REST-API, unabhängig von Framework oder Frontend. Aber erst das serverlose Deployment macht aus einer guten Architektur ein skalierbares, hochverfügbares System. Warum? Weil serverlose Plattformen wie Vercel, Netlify oder AWS Lambda Deployments, Skalierung und Ausfallsicherheit automatisieren – ohne, dass du dich noch um klassische Server, Load Balancer oder Patch-Management kümmern musst.

Im Kontext von Sanity Serverless Deployment ist das Ziel: Zero Ops. Kein Server-Setup, keine aufwendigen Backups, keine Security-Patches von Hand. Stattdessen: Deploys via Git Push, automatische Rollbacks, globale CDN-Auslieferung und dynamische API-Limits, die sich an den TrafficTraffic: Die wahre Währung des digitalen Marketings Traffic – der Begriff klingt harmlos, fast banal. Tatsächlich ist Traffic das Lebenselixier jeder Website, der Pulsschlag des Online-Marketings und der ultimative Gradmesser für digitale Sichtbarkeit. Ohne Traffic bleibt jede noch so geniale Seite ein Geisterschiff im Ozean des Internets. Dieser Glossar-Artikel zerlegt das Thema Traffic in seine Einzelteile, von Definition bis Technologie,... anpassen. Klingt zu schön, um wahr zu sein? Ist es nicht – wenn du die Stolperfallen kennst und ein wirklich robustes Setup baust.

Der größte Vorteil von Sanity Serverless Deployment: Du trennst ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist..., Logik und Auslieferung vollständig. Dein Frontend (z.B. Next.js oder Astro) läuft als serverlose App, Sanity liefert die Inhalte via APIAPI – Schnittstellen, Macht und Missverständnisse im Web API steht für „Application Programming Interface“, zu Deutsch: Programmierschnittstelle. Eine API ist das unsichtbare Rückgrat moderner Softwareentwicklung und Online-Marketing-Technologien. Sie ermöglicht es verschiedenen Programmen, Systemen oder Diensten, miteinander zu kommunizieren – und zwar kontrolliert, standardisiert und (im Idealfall) sicher. APIs sind das, was das Web zusammenhält, auch wenn kein Nutzer je eine..., und Edge Functions oder Lambdas übernehmen dynamische Aufgaben wie Preview, Authentifizierung oder Webhook-Handling. Das Ergebnis: Skalierbarkeit, Performance und Flexibilität, die mit klassischen Monolithen nicht ansatzweise erreichbar ist.

Natürlich gibt es auch Schattenseiten: API-Rate-Limits, kalte Starts, Authentifizierungs-Token, CORS-Probleme oder Vendor-Lock-in bei Plattformen wie Vercel und Netlify. Wer Sanity Serverless Deployment nicht bis ins Detail plant, steht schnell vor Problemen, die einem nachts den Schlaf rauben. Aber genau dafür ist diese Profi-Anleitung da.

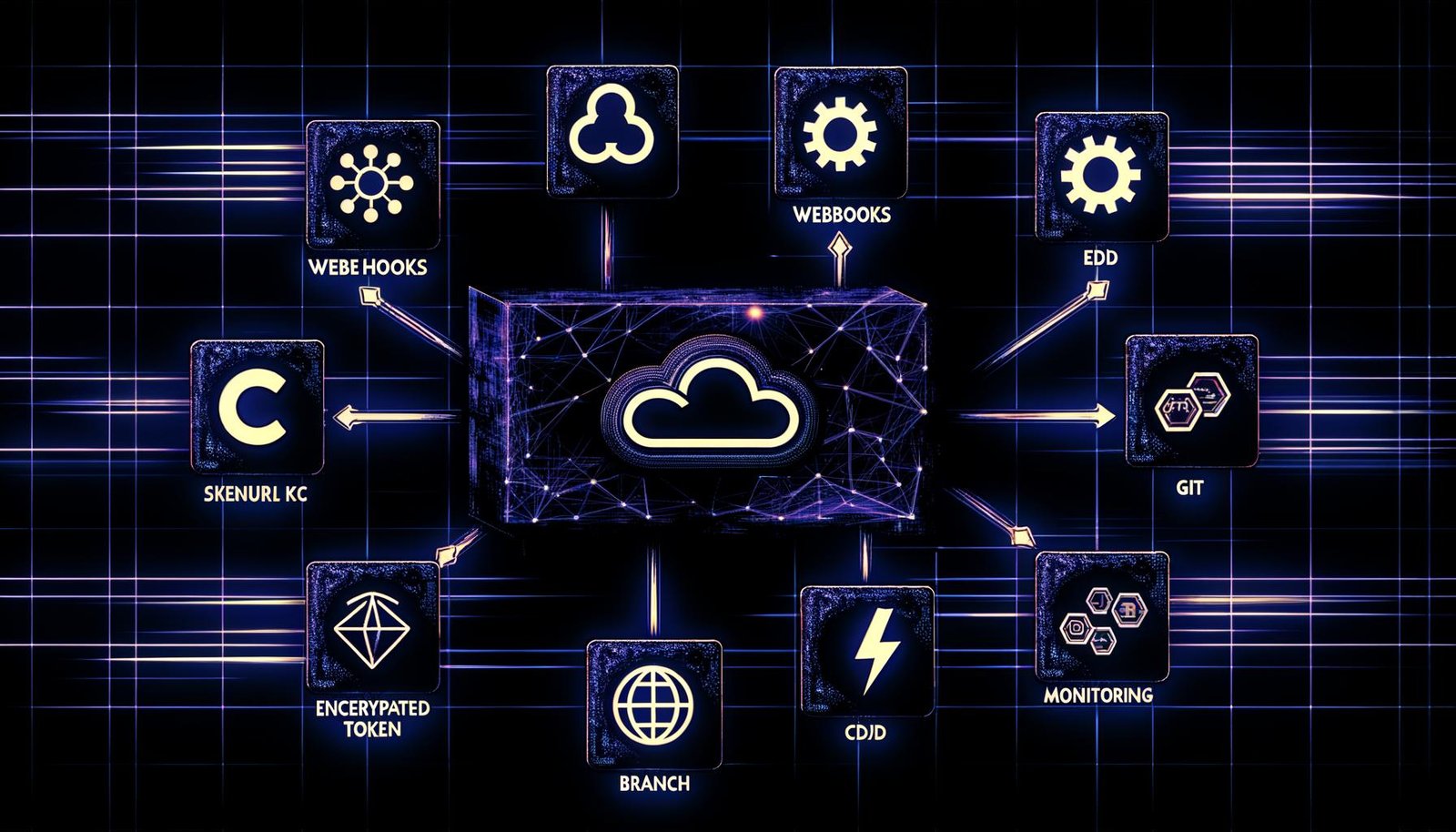

Architektur und Komponenten: Was ein echtes Sanity Serverless Deployment ausmacht

Ein professionelles Sanity Serverless Deployment ist keine “one size fits all”-Lösung. Es gibt zentrale Architekturkomponenten, die du sauber orchestrieren musst, um aus deinem Projekt mehr als nur einen MVP zu machen. Im Zentrum steht das Sanity Headless CMSCMS (Content Management System): Das Betriebssystem für das Web CMS steht für Content Management System und ist das digitale Rückgrat moderner Websites, Blogs, Shops und Portale. Ein CMS ist eine Software, die es ermöglicht, Inhalte wie Texte, Bilder, Videos und Strukturelemente ohne Programmierkenntnisse zu erstellen, zu verwalten und zu veröffentlichen. Ob WordPress, TYPO3, Drupal oder ein Headless CMS – das..., das via APIAPI – Schnittstellen, Macht und Missverständnisse im Web API steht für „Application Programming Interface“, zu Deutsch: Programmierschnittstelle. Eine API ist das unsichtbare Rückgrat moderner Softwareentwicklung und Online-Marketing-Technologien. Sie ermöglicht es verschiedenen Programmen, Systemen oder Diensten, miteinander zu kommunizieren – und zwar kontrolliert, standardisiert und (im Idealfall) sicher. APIs sind das, was das Web zusammenhält, auch wenn kein Nutzer je eine... als Content-Backbone fungiert. Doch das ist nur die halbe Miete: Erst durch die Kombination mit serverlosen Plattformen und Edge-Services entsteht ein echtes, modernes Deployment.

Die Architektur sieht in der Praxis so aus: Sanity hostet und verwaltet deinen strukturierten ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist.... Das Frontend – meist Next.js, SvelteKit, Astro oder Nuxt – wird serverless deployed (auf Vercel, Netlify, AWS Lambda, Azure Functions oder Cloudflare Workers). Die Verbindung zwischen Frontend und Sanity erfolgt über die Sanity ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... APIAPI – Schnittstellen, Macht und Missverständnisse im Web API steht für „Application Programming Interface“, zu Deutsch: Programmierschnittstelle. Eine API ist das unsichtbare Rückgrat moderner Softwareentwicklung und Online-Marketing-Technologien. Sie ermöglicht es verschiedenen Programmen, Systemen oder Diensten, miteinander zu kommunizieren – und zwar kontrolliert, standardisiert und (im Idealfall) sicher. APIs sind das, was das Web zusammenhält, auch wenn kein Nutzer je eine..., meist abgesichert über Auth-Token oder CORS-Policies. Für dynamische Aufgaben – z.B. Preview-Modus, serverseitige Authentifizierung, Webhook-Handling bei Content-Änderungen – setzt du auf Edge Functions oder Lambda Functions, die “on demand” ausgeführt werden.

Wichtige sekundäre Komponenten für ein robustes Sanity Serverless Deployment:

- Globale CDN-Auslieferung für Assets und statische Seiten

- Webhooks für Content-Updates und automatische Rebuilds

- API-Proxy-Services für sichere Verbindung zwischen Frontend und Sanity

- Monitoring & Logging (z.B. Datadog, Sentry, Vercel AnalyticsAnalytics: Die Kunst, Daten in digitale Macht zu verwandeln Analytics – das klingt nach Zahlen, Diagrammen und vielleicht nach einer Prise Langeweile. Falsch gedacht! Analytics ist der Kern jeder erfolgreichen Online-Marketing-Strategie. Wer nicht misst, der irrt. Es geht um das systematische Sammeln, Auswerten und Interpretieren von Daten, um digitale Prozesse, Nutzerverhalten und Marketingmaßnahmen zu verstehen, zu optimieren und zu skalieren....)

- Automatisiertes CI/CD (GitHub Actions, Vercel/Netlify Deploy Hooks, AWS CodePipeline)

Ein echtes Sanity Serverless Deployment ist erst dann professionell, wenn du diese Komponenten nicht einfach nur zusammensetzt, sondern automatisiert orchestrierst. Das heißt: Zero-Downtime-Deployments, Instant-Rollbacks, Versionierung, Secrets-Management für Tokens und Monitoring auf allen Ebenen. Wer das ignoriert, läuft schnell in API-Limits, Auth-Fehler oder nicht nachvollziehbare Deploy-Bugs – und verliert so die Kontrolle über sein Projekt.

Die größten Fehler beim Sanity Serverless Deployment – und wie du sie garantiert vermeidest

Sanity Serverless Deployment klingt einfach – ist aber in der Praxis voller Fallstricke. Die meisten Projekte scheitern an denselben klassischen Fehlern. Wer hier nicht aufpasst, zerschießt sich Performance, Security und Skalierbarkeit im Handumdrehen. Hier sind die fünf häufigsten Stolperfallen – und wie du sie garantiert vermeidest:

- API-Rate-Limits ignorieren: Sanity begrenzt die Zahl der API-Requests pro Minute. Wer sein Frontend nicht effizient cached oder bei jedem Seitenaufruf alle Daten frisch zieht, läuft gnadenlos ins Rate-Limit. Lösung: Server-Side Caching, Incremental Static Regeneration (ISR) oder On-Demand Revalidation einbauen.

- Authentication-Token im Frontend ausliefern: Ein Klassiker, der dich ins Security-Desaster stürzt. Auth-Tokens gehören niemals ins öffentliche Repo oder ins Client-Bundle. Lösung: Tokens in Serverless Functions oder als Umgebungsvariablen sichern.

- Keine Webhook-Revalidierung: Ohne automatische Trigger für Rebuilds werden Content-Änderungen nicht sofort sichtbar. Lösung: Nutze Sanity Webhooks, die beim Publish ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... automatisch ein Rebuild via Deployment-Hook anstoßen.

- Kalte Starts falsch einschätzen: Serverless Functions brauchen beim ersten Start (“cold start”) länger. Wer jede Page-Request dynamisch rendert, riskiert langsame TTFB. Lösung: Nutze statische Seiten oder ISR – und halte kritische Functions “warm”.

- Monitoring und Fehler-Logs vergessen: Wer Fehler nur im Browser sieht, ist verloren. Lösung: Integriere Sentry, Datadog oder Vercel/Netlify AnalyticsAnalytics: Die Kunst, Daten in digitale Macht zu verwandeln Analytics – das klingt nach Zahlen, Diagrammen und vielleicht nach einer Prise Langeweile. Falsch gedacht! Analytics ist der Kern jeder erfolgreichen Online-Marketing-Strategie. Wer nicht misst, der irrt. Es geht um das systematische Sammeln, Auswerten und Interpretieren von Daten, um digitale Prozesse, Nutzerverhalten und Marketingmaßnahmen zu verstehen, zu optimieren und zu skalieren.... – und analysiere Logs für alle Deployments und Functions.

Bonus-Fehler: Vendor-Lock-in unterschätzen. Wer sich blind an Vercel- oder Netlify-spezifische Features bindet, kommt später schwer wieder raus. Baue dein Sanity Serverless Deployment so flexibel, dass du jederzeit die Plattform wechseln kannst – etwa durch Infrastructure-as-Code (IaC) mit Terraform oder Pulumi.

Step-by-Step: Dein Sanity Serverless Deployment Setup

Hier kommt die Schritt-für-Schritt-Anleitung für ein echtes Profi-Sanity Serverless Deployment. Keine halben Sachen, sondern ein Setup, das auch unter Last, bei Fehlern und im Enterprise-Kontext nicht einknickt. Das Vorgehen ist grundsätzlich plattformunabhängig, wird aber am Beispiel von Vercel und AWS Lambda erläutert – weil das die beiden härtesten Praxisszenarien sind.

- 1. Sanity-Projekt initialisieren und API-Token generieren

- Sanity CLI installieren und

sanity initausführen - API-Token mit den nötigen Berechtigungen via Sanity.io DashboardDashboard: Die Kommandozentrale für Daten, KPIs und digitale Kontrolle Ein Dashboard ist weit mehr als ein hübsches Interface mit bunten Diagrammen – es ist das digitale Cockpit, das dir in Echtzeit den Puls deines Geschäfts, deiner Website oder deines Marketings zeigt. Dashboards visualisieren komplexe Datenströme aus unterschiedlichsten Quellen und machen sie sofort verständlich, steuerbar und nutzbar. Egal ob Webanalyse, Online-Marketing,... anlegen

- Token niemals ins Frontend-Bundle oder Repository einchecken

- Sanity CLI installieren und

- 2. Frontend-Projekt (z.B. Next.js) einrichten

- Projektstruktur aufsetzen:

/pages,/api,/components - Sanity-Client via NPM installieren und auf Server-seitige Datenabfragen einstellen

- Umgebungsvariablen für API-Token und Sanity-Projekt-ID einrichten

- Projektstruktur aufsetzen:

- 3. Serverless Deployment konfigurieren

- Vercel:

vercel.jsonmit Rewrites, Redirects, Edge Functions vorbereiten - AWS Lambda: Serverless Framework oder AWS SAM nutzen, Functions deklarieren (z.B.

getContent,preview,revalidate) - Netlify:

netlify.tomlmit Build-Befehlen, Redirects und Functions füttern

- Vercel:

- 4. Webhooks für Rebuilds und Live-Updates einrichten

- Im Sanity DashboardDashboard: Die Kommandozentrale für Daten, KPIs und digitale Kontrolle Ein Dashboard ist weit mehr als ein hübsches Interface mit bunten Diagrammen – es ist das digitale Cockpit, das dir in Echtzeit den Puls deines Geschäfts, deiner Website oder deines Marketings zeigt. Dashboards visualisieren komplexe Datenströme aus unterschiedlichsten Quellen und machen sie sofort verständlich, steuerbar und nutzbar. Egal ob Webanalyse, Online-Marketing,... Webhooks anlegen (z.B. für “publish” oder “unpublish” Events)

- Webhook-URL zeigt auf eine Serverless Function im Frontend (z.B.

/api/revalidate) - Deployment-Trigger für CI/CD-Tools (Vercel Deploy Hook, Netlify Build Hook, AWS CodePipeline) setzen

- 5. Caching-Strategien implementieren

- Incremental Static Regeneration (ISR) in Next.js aktivieren

- Edge Caching via CDN (Vercel Edge, AWS CloudFront, Netlify Edge) konfigurieren

- API-Proxy mit Cache Layer bauen, um Sanity API-Requests zu minimieren

- 6. Monitoring & Error-Tracking integrieren

- Sentry oder Datadog für Error-Logs aller Serverless Functions anbinden

- Vercel/Netlify AnalyticsAnalytics: Die Kunst, Daten in digitale Macht zu verwandeln Analytics – das klingt nach Zahlen, Diagrammen und vielleicht nach einer Prise Langeweile. Falsch gedacht! Analytics ist der Kern jeder erfolgreichen Online-Marketing-Strategie. Wer nicht misst, der irrt. Es geht um das systematische Sammeln, Auswerten und Interpretieren von Daten, um digitale Prozesse, Nutzerverhalten und Marketingmaßnahmen zu verstehen, zu optimieren und zu skalieren.... für Serverless-Performance auswerten

- Alerting für fehlgeschlagene Deployments und API-Fehler einrichten

- 7. Security und Secrets-Management

- API-Tokens als verschlüsselte Umgebungsvariablen speichern

- Secrets nie im Repo oder im Client-Code platzieren

- Access-Control für die Sanity APIAPI – Schnittstellen, Macht und Missverständnisse im Web API steht für „Application Programming Interface“, zu Deutsch: Programmierschnittstelle. Eine API ist das unsichtbare Rückgrat moderner Softwareentwicklung und Online-Marketing-Technologien. Sie ermöglicht es verschiedenen Programmen, Systemen oder Diensten, miteinander zu kommunizieren – und zwar kontrolliert, standardisiert und (im Idealfall) sicher. APIs sind das, was das Web zusammenhält, auch wenn kein Nutzer je eine... granular einstellen (Read/Write/Manage)

Wichtig: Mache nach jedem Schritt einen vollständigen Test, bevor du ins nächste Level gehst. Ein Fehler im Tokens-Handling oder bei den Webhooks killt dein Deployment schneller, als du “Rollback” schreiben kannst.

Performance, Skalierung und Monitoring: Sanity Serverless wie die Großen

Ein echtes Sanity Serverless Deployment ist nur dann wirklich professionell, wenn es auch unter Hochlast, bei Fehlern und im globalen Rollout stabil bleibt. Das Zauberwort: Monitoring, Caching und automatisierte Skalierung. Viele Teams bauen sich mit Sanity und serverlosen Deployments erst eine solide Performance-Hölle, bevor sie verstehen, wie wichtig die richtige Architektur ist.

Performance erreichst du im Serverless-Kontext nur mit einem Mix aus Edge Caching, effizienten API-Calls und intelligenter Pre-Generierung. Setze auf statische Seiten für alles, was sich selten ändert – und nutze On-Demand Revalidation für dynamische Inhalte. Halte API-Requests minimal, aggregiere Daten auf dem Server und cache sie im CDN. Die Sanity APIAPI – Schnittstellen, Macht und Missverständnisse im Web API steht für „Application Programming Interface“, zu Deutsch: Programmierschnittstelle. Eine API ist das unsichtbare Rückgrat moderner Softwareentwicklung und Online-Marketing-Technologien. Sie ermöglicht es verschiedenen Programmen, Systemen oder Diensten, miteinander zu kommunizieren – und zwar kontrolliert, standardisiert und (im Idealfall) sicher. APIs sind das, was das Web zusammenhält, auch wenn kein Nutzer je eine... skaliert zwar mit, aber API-Limits, TTFB und Cache-Invalidierung sind im Serverless-Deployment echte Fallstricke.

Skalierung funktioniert im Serverless-Modell quasi automatisch – aber nur, wenn du Bottlenecks vermeidest: Massiv frequentierte Endpunkte sollten als Edge Functions laufen, nicht als klassische Serverless Functions mit Cold-Start-Latenz. Komplexe Content-Queries auf der Sanity APIAPI – Schnittstellen, Macht und Missverständnisse im Web API steht für „Application Programming Interface“, zu Deutsch: Programmierschnittstelle. Eine API ist das unsichtbare Rückgrat moderner Softwareentwicklung und Online-Marketing-Technologien. Sie ermöglicht es verschiedenen Programmen, Systemen oder Diensten, miteinander zu kommunizieren – und zwar kontrolliert, standardisiert und (im Idealfall) sicher. APIs sind das, was das Web zusammenhält, auch wenn kein Nutzer je eine... sollten vorab aggregiert oder “pre-fetched” werden, statt bei jedem Page-Load neu zu feuern. Überwache die API-Limits – Sanity drosselt gnadenlos, wenn du es übertreibst.

Monitoring ist Pflicht: Ohne Error-Tracking, Logging und Alerting stehst du im Dunkeln. Nutze Sentry, Datadog oder Vercel/Netlify Monitoring, um Fehler, API-Latenzen und Deploy-Status in Echtzeit zu sehen. Automatisiere Alerts für kritische Fehler oder API-Overloads. Nur so bleibt dein Sanity Serverless Deployment auch dann stabil, wenn es wirklich zählt.

Best Practices für Sanity Serverless Deployment aus echten Enterprise-Projekten

Die Theorie ist das eine, die Praxis das andere. Aus echten Enterprise-Projekten mit Sanity Serverless Deployment haben sich ein paar Best Practices herauskristallisiert, die du in keinem Marketing-Whitepaper findest. Hier die wichtigsten, die dir den Hals retten können:

- API-Token nie im Client, immer nur in Serverless Functions oder Edge Functions verwenden

- Webhooks für alle relevanten Content-Events einrichten – nicht nur für “publish”, sondern auch für “delete”, “move”, “unpublish”

- Content-Previews immer serverseitig lösen – nie clientseitig

- CDN-Cache-TTLs (Time To Live) nicht zu niedrig setzen, sonst ist die Performance dahin

- Statisches Rendering maximal nutzen, dynamische Seiten gezielt “on demand” revalidieren

- API-Proxies nutzen, um komplexe, aggregierte Daten nur einmal zu holen und zu cachen

- Automatisiertes Deployment mit GitHub Actions oder anderen CI/CD-Pipelines – keine Deployments “by hand”

- Infrastructure-as-Code (IaC) für alle Plattform- und Function-Deployments – keine Klick-Orgie im DashboardDashboard: Die Kommandozentrale für Daten, KPIs und digitale Kontrolle Ein Dashboard ist weit mehr als ein hübsches Interface mit bunten Diagrammen – es ist das digitale Cockpit, das dir in Echtzeit den Puls deines Geschäfts, deiner Website oder deines Marketings zeigt. Dashboards visualisieren komplexe Datenströme aus unterschiedlichsten Quellen und machen sie sofort verständlich, steuerbar und nutzbar. Egal ob Webanalyse, Online-Marketing,...

Wer diese Best Practices ignoriert, baut sich ein technisches Schuldengrab, das spätestens beim ersten großen RelaunchRelaunch: Der radikale Neustart deiner Website – Risiken, Chancen und SEO-Fallen Ein Relaunch bezeichnet den umfassenden Neustart einer bestehenden Website – nicht zu verwechseln mit einem simplen Redesign. Beim Relaunch wird die gesamte Webpräsenz technisch, strukturell und inhaltlich überarbeitet, mit dem Ziel, die User Experience, Sichtbarkeit und Performance auf ein neues Level zu heben. Klingt nach Frischzellenkur, kann aber auch... oder bei echtem TrafficTraffic: Die wahre Währung des digitalen Marketings Traffic – der Begriff klingt harmlos, fast banal. Tatsächlich ist Traffic das Lebenselixier jeder Website, der Pulsschlag des Online-Marketings und der ultimative Gradmesser für digitale Sichtbarkeit. Ohne Traffic bleibt jede noch so geniale Seite ein Geisterschiff im Ozean des Internets. Dieser Glossar-Artikel zerlegt das Thema Traffic in seine Einzelteile, von Definition bis Technologie,... zur Katastrophe wird. Sanity Serverless Deployment ist kein Hobby – sondern ein knallharter Tech-Job, der Erfahrung und Disziplin erfordert.

Fazit: Sanity Serverless Deployment – das Setup, das wirklich skaliert

Sanity Serverless Deployment ist die Königsklasse für alle, die Headless-CMS, moderne Cloud-Architektur und echtes DevOps-Level verbinden wollen. Es reicht nicht, ein paar Deploy-Buttons zu klicken und auf “magische” Skalierung zu hoffen. Wer Sanity wirklich serverless und professionell betreibt, muss API-Limits, Security, Caching, Webhooks, CI/CD und Monitoring in der DNA seines Projekts verankern. Nur so erreichst du echte Geschwindigkeit, Ausfallsicherheit und Skalierbarkeit – und kannst dich voll auf den ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... konzentrieren, statt auf kaputte Deployments.

Vergiss die halbgaren Tutorials und den Plattform-Marketingkram. Echte Sanity Serverless Deployments brauchen technisches Knowhow, robuste Automatisierung und gnadenloses Monitoring. Wer das beherrscht, baut Projekte, die jedem Traffic-Peak und jedem API-Fail lässig standhalten – und kann sich endlich von DevOps-Burnout und Nacht-Deployments verabschieden. Willkommen im echten Serverless-Zeitalter.