Social Media Crawler Strukturen: Aufbau, Logik, Chancen – Wie soziale Netzwerke dich wirklich auslesen

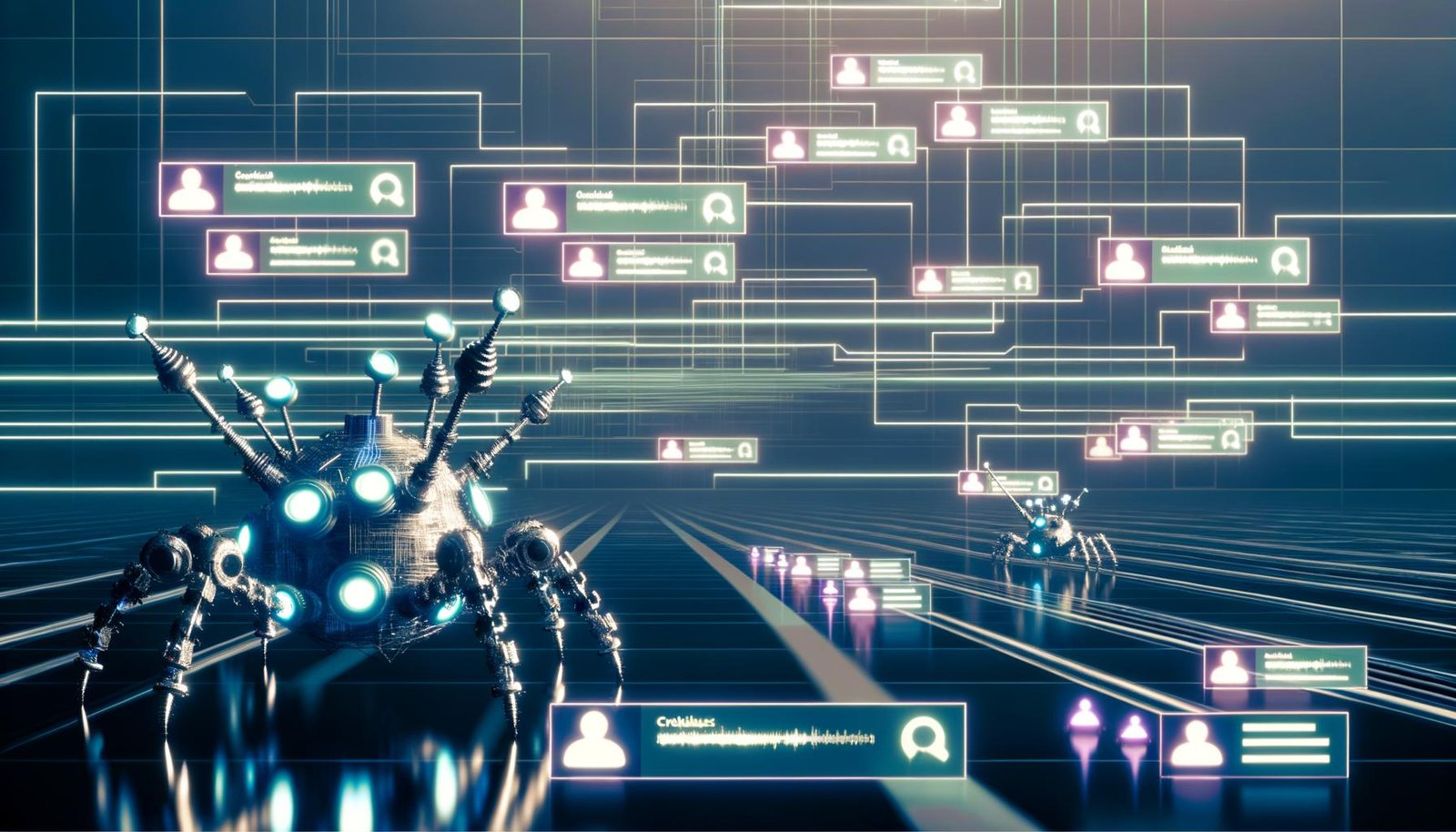

Du denkst, dein Social-Media-Kram ist sicher, solange du die richtigen Privacy-Settings setzt? Falsch gedacht. Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... sind die unsichtbaren Spione, die im Hintergrund deine Daten, deinen ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... und sogar deine Fehler abgrasen – und zwar mit einer Präzision, die jeden Datenschützer blass werden lässt. Dieser Artikel dekonstruiert schonungslos, wie Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... wirklich ticken, welche technischen Strukturen sie ausmachen, warum sie für Online MarketingMarketing: Das Spiel mit Bedürfnissen, Aufmerksamkeit und Profit Marketing ist weit mehr als bunte Bilder, Social-Media-Posts und nervige Werbespots. Marketing ist die strategische Kunst, Bedürfnisse zu erkennen, sie gezielt zu wecken – und aus Aufmerksamkeit Profit zu schlagen. Es ist der Motor, der Unternehmen antreibt, Marken formt und Kundenverhalten manipuliert, ob subtil oder mit der Brechstange. Dieser Artikel entlarvt das... Gold wert sind und wieso die meisten selbsternannten Marketing-Gurus bei diesem Thema komplett versagen. Willkommen bei der Wahrheit, die du garantiert nicht in den Hochglanzbroschüren der Social-Media-Agenturen findest.

- Was Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... sind, wie sie technisch funktionieren und warum sie für Plattformen unverzichtbar sind

- Aufbau und Architektur moderner CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer...: Von Scheduling über Parsing bis zur Datenpersistenz – die ungeschönte Realität

- Die Logik hinter Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... Crawling: Priorisierung, Throttling, Anti-Scraping-Maßnahmen

- Chancen für Online-Marketing: Monitoring, Competitive Intelligence, Trend-Detection, Content-Strategie

- Risiken und Grenzen: Rechtliches Minenfeld, API-Limits, Blacklisting und die ethische Debatte

- Technologien und Tools: Von Open-Source-Crawlern bis zu Enterprise-Lösungen

- Die wichtigsten SEO-Aspekte beim Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... Crawling

- Step-by-Step: Wie du selbst einen Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... baust – und woran 99% der Projekte scheitern

- Warum die meisten Agenturen Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... Crawling (noch) nicht beherrschen – und was das für dich bedeutet

- Ein Fazit, das keine Ausreden mehr zulässt

Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer.... Für die einen sind es Werkzeuge der Aufklärung, für die anderen digitale Raubtiere, die alles aufsaugen, was nicht bei drei auf privat gestellt ist. Fakt ist: Ohne CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... wären Netzwerke wie Facebook, Instagram, Twitter, LinkedIn oder TikTok nicht durchsuchbar, nicht analysierbar, nicht automatisierbar. Hinter jedem Like, jedem Hashtag-Trend und jedem viralen Fail steckt ein ausgeklügeltes Crawler-System, das Daten in Echtzeit scannt, bewertet und weiterverarbeitet. Wer 2024 im Online MarketingMarketing: Das Spiel mit Bedürfnissen, Aufmerksamkeit und Profit Marketing ist weit mehr als bunte Bilder, Social-Media-Posts und nervige Werbespots. Marketing ist die strategische Kunst, Bedürfnisse zu erkennen, sie gezielt zu wecken – und aus Aufmerksamkeit Profit zu schlagen. Es ist der Motor, der Unternehmen antreibt, Marken formt und Kundenverhalten manipuliert, ob subtil oder mit der Brechstange. Dieser Artikel entlarvt das... noch glaubt, sich mit “Content-Planung” und “Hashtag-Recherche” einen Vorsprung zu verschaffen, hat das Spiel nicht verstanden. Es geht um Daten. Um Geschwindigkeit. Um Strukturen, die du nicht siehst – aber die über deinen Erfolg entscheiden.

Dieser Artikel bringt dich auf den Stand, den du brauchst, um Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... nicht nur zu verstehen, sondern sie für dich zu nutzen. Ohne Bullshit, ohne Buzzword-Bingo, sondern mit der technischen Tiefe, die du sonst nur hinter verschlossenen Türen großer Tech-Konzerne findest. Und ja: Wir reden über die echten Chancen. Aber auch über die Risiken, die rechtlichen Grauzonen und die technischen Hürden, an denen 99% aller Marketing-Projekte scheitern. Willkommen bei 404. Hier gibt es keine Ausreden.

Was sind Social Media Crawler? Aufbau, Architektur und technischer Unterbau

Ein Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... ist keine simple Suchmaschine mit nettem User Interface. Es handelt sich um spezialisierte Software, die automatisiert Inhalte aus sozialen Netzwerken extrahiert, verarbeitet und persistiert. Im Kern besteht jeder CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... aus mehreren Komponenten, die in einer Pipeline zusammenarbeiten: Scheduler, Fetcher, Parser, Storage und – nicht zu vergessen – eine robuste Anti-Detection-Logic.

Der Scheduler entscheidet, wann und wie oft welche Ressourcen (z.B. User-Profile, Feeds, Hashtags, Posts) gecrawlt werden. Dafür kommen Priorisierungsalgorithmen zum Einsatz, die Faktoren wie Popularität, Aktualität oder vergangene Crawling-Ergebnisse berücksichtigen. Der Fetcher übernimmt dann die eigentliche Abfrage der Ressourcen, oft unter Verwendung von HTTP-Clients, Webdriver-Instanzen (Selenium, Puppeteer) oder direkt via (halb-)offizieller APIs. Der Parser extrahiert die relevanten Daten aus HTMLHTML: Das Rückgrat des Webs erklärt HTML steht für Hypertext Markup Language und ist der unangefochtene Grundbaustein des World Wide Web. Ohne HTML gäbe es keine Webseiten, keine Online-Shops, keine Blogs und keine digitalen Marketingwelten – nur eine triste, textbasierte Datenwüste. HTML strukturiert Inhalte, macht sie für Browser interpretierbar und sorgt dafür, dass aus rohen Daten klickbare, visuell erfassbare und..., JSON oder anderen Formaten – inklusive Metadaten, User-Informationen, Likes, Shares, Kommentaren und Mediadateien.

Die Speicherung erfolgt meist in hochperformanten Datenbanken oder Data Lakes, optimiert für parallele Zugriffe und Realtime-Analysen. Technologien wie Elasticsearch, MongoDB oder BigQuery sind hier Standard. Und weil Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... Plattformen nicht blöd sind, implementieren professionelle CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... zusätzliche Obfuscation-Layer: IP-Rotation, User-Agent-Spoofing, Cookie-Management, Request-Throttling und Captcha-Solving sind Pflicht, nicht Kür.

Die Architektur moderner Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... ist also alles andere als trivial. Sie muss hochgradig skalierbar, fehlertolerant und modular sein – sonst ist spätestens nach dem dritten API-Update Feierabend. Wer hier mit Bastellösungen und billigem Open-Source-Geschraube arbeitet, kann sich direkt wieder verabschieden. Nur robuste, skalierbare Microservice-Architekturen, orchestriert über Kubernetes, mit asynchronen Queues (RabbitMQ, Kafka) und feingranularen Monitoring-Lösungen (Prometheus, Grafana), bestehen im echten Social-Media-Crawling-Einsatz.

Die Logik hinter Social Media Crawling: Priorisierung, Throttling, Anti-Scraping

Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... Crawling folgt keiner linearen, sondern einer stark priorisierten Logik. Plattformen wie Instagram oder TikTok generieren täglich Millionen neuer Posts, Stories und Kommentare – ein vollständiges Crawling ist technisch unmöglich und rechtlich ohnehin heikel. Deshalb arbeiten fortschrittliche CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... mit dynamischen Priorisierungsmechanismen: Sie erkennen, welche Inhalte viral gehen, wie sich User-Interaktionen entwickeln und wo sich Trends abzeichnen.

Ein Kernelement ist das Request Throttling: Um nicht aufzufallen, müssen CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... ihre Anfragen intelligent timen. Zu viele Requests pro Minute führen direkt ins Blacklisting oder zum Captcha-Lockdown. Moderne CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... integrieren adaptive Rate-Limiting-Algorithmen, die Traffic-Muster der Plattformen analysieren und ihren Request-Speed dynamisch anpassen. Wer das ignoriert, wird schneller ausgesperrt, als er “Social ListeningSocial Listening: Das digitale Stethoskop für Marken, Märkte und Meinungen Social Listening bezeichnet das systematische Überwachen, Sammeln und Analysieren von öffentlichen Online-Äußerungen zu Marken, Produkten, Themen oder Mitbewerbern in sozialen Netzwerken, Foren und anderen digitalen Kanälen. Ziel ist es, relevante Trends, Meinungen und Stimmungen zu erkennen und daraus in Echtzeit strategische Maßnahmen abzuleiten. Social Listening ist keine Kuschelmaßnahme: Wer es...” buchstabieren kann.

Anti-Scraping-Maßnahmen sind das nächste große Hindernis. Plattformen setzen auf Fingerprinting, Behavioral AnalyticsAnalytics: Die Kunst, Daten in digitale Macht zu verwandeln Analytics – das klingt nach Zahlen, Diagrammen und vielleicht nach einer Prise Langeweile. Falsch gedacht! Analytics ist der Kern jeder erfolgreichen Online-Marketing-Strategie. Wer nicht misst, der irrt. Es geht um das systematische Sammeln, Auswerten und Interpretieren von Daten, um digitale Prozesse, Nutzerverhalten und Marketingmaßnahmen zu verstehen, zu optimieren und zu skalieren.... und Bot-Detection, um unliebsame CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... zu blockieren. Gegenmaßnahmen? IP-Proxies aus unterschiedlichen Regionen, wechselnde User-Agents, Headless-Browsing mit realistischen Interaktionsmustern und Advanced CookieCookie: Das meist missverstandene Bit der Webtechnologie Ein Cookie ist kein zuckriger Snack für zwischendurch, sondern ein winziger Datensatz, der beim Surfen im Web eine zentrale Rolle spielt – und zwar für alles von Login-Mechanismen bis zur personalisierten Werbung. Cookies sind kleine Textdateien, die vom Browser gespeichert und von Websites gelesen werden, um Nutzer zu erkennen, Einstellungen zu speichern und... Handling. Manche CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... bauen sogar AI-Module ein, die menschliches Scroll- und Klickverhalten simulieren. Alles andere ist digitaler Selbstmord.

Die gesamte Logik des Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... Crawling ist also ein permanenter Wettlauf zwischen Crawler-Entwicklern und Plattformbetreibern. Jeder neue Detection-Mechanismus der Plattformen zwingt die CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... zu schnellen Anpassungen. Statische CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... sind bereits nach wenigen Wochen wertlos. Nur wer flexibel bleibt, eigene Detection-Bypass-Module schreibt und seine Infrastruktur ständig updated, bleibt im Spiel.

Chancen von Social Media Crawling für Online Marketing & SEO

Kommen wir zum spannenden Teil: Warum solltest du dich überhaupt für Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... interessieren? Ganz einfach – weil sie dir Insights liefern, von denen klassische Marktforschung nur träumen kann. Für Online MarketingMarketing: Das Spiel mit Bedürfnissen, Aufmerksamkeit und Profit Marketing ist weit mehr als bunte Bilder, Social-Media-Posts und nervige Werbespots. Marketing ist die strategische Kunst, Bedürfnisse zu erkennen, sie gezielt zu wecken – und aus Aufmerksamkeit Profit zu schlagen. Es ist der Motor, der Unternehmen antreibt, Marken formt und Kundenverhalten manipuliert, ob subtil oder mit der Brechstange. Dieser Artikel entlarvt das... und SEOSEO (Search Engine Optimization): Das Schlachtfeld der digitalen Sichtbarkeit SEO, kurz für Search Engine Optimization oder Suchmaschinenoptimierung, ist der Schlüsselbegriff für alle, die online überhaupt gefunden werden wollen. Es bezeichnet sämtliche Maßnahmen, mit denen Websites und deren Inhalte so optimiert werden, dass sie in den unbezahlten, organischen Suchergebnissen von Google, Bing und Co. möglichst weit oben erscheinen. SEO ist längst... sind Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... das Werkzeug der Wahl, wenn es um Realtime-Monitoring, Competitive Intelligence, Trend Detection und Content-Strategie geht.

Mit einem eigenen Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... kannst du Hashtag-Trends identifizieren, relevante Themen frühzeitig entdecken und Content-Gaps deiner Wettbewerber ausfindig machen. Du siehst, welche Posts viral gehen, welche User als InfluencerInfluencer: Die Macht der digitalen Meinungsmacher Influencer sind die Popstars des digitalen Zeitalters – aber statt Gitarre und Stagediving setzen sie auf Reichweite, Authentizität und Content-Strategie. Der Begriff Influencer beschreibt Personen, die aufgrund ihrer Online-Präsenz, Reputation und Followerzahl in sozialen Netzwerken wie Instagram, YouTube, TikTok oder LinkedIn die Meinung und das Konsumverhalten ihrer Zielgruppe maßgeblich beeinflussen können. Klingt nach leicht... taugen und wie sich Engagement-Rates je nach Zeit, Inhalt oder Plattform entwickeln. Kurz: Du bekommst den Daten-Backstage-Pass, bevor irgendjemand anderes auch nur merkt, dass da ein neuer Trend entsteht.

Auch für SEOSEO (Search Engine Optimization): Das Schlachtfeld der digitalen Sichtbarkeit SEO, kurz für Search Engine Optimization oder Suchmaschinenoptimierung, ist der Schlüsselbegriff für alle, die online überhaupt gefunden werden wollen. Es bezeichnet sämtliche Maßnahmen, mit denen Websites und deren Inhalte so optimiert werden, dass sie in den unbezahlten, organischen Suchergebnissen von Google, Bing und Co. möglichst weit oben erscheinen. SEO ist längst... ist Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... Crawling ein Gamechanger. Social SignalsSocial Signals: Das unterschätzte Ranking-Signal im SEO-Game Social Signals sind digitale Reaktionen auf Webseiteninhalte in sozialen Netzwerken – also Likes, Shares, Kommentare, Retweets, Upvotes, Pins und alles, was irgendwie nach Aufmerksamkeit riecht. Im Kontext von Suchmaschinenoptimierung (SEO) werden diese Social Signals als Indikatoren für Popularität, Relevanz und Vertrauen einer Website diskutiert. Doch wie stark beeinflussen sie tatsächlich das Ranking? Und... – Likes, Shares, Comments – beeinflussen die SichtbarkeitSichtbarkeit: Die unbarmherzige Währung des digitalen Marketings Wenn es im Online-Marketing eine einzige Währung gibt, die wirklich zählt, dann ist es Sichtbarkeit. Sichtbarkeit – im Fachjargon gern als „Visibility“ bezeichnet – bedeutet schlicht: Wie präsent ist eine Website, ein Unternehmen oder eine Marke im digitalen Raum, insbesondere in Suchmaschinen wie Google? Wer nicht sichtbar ist, existiert nicht. Punkt. In diesem... deiner BrandBrand: Die wahre Macht hinter Marken, Mythen und Marketing Der Begriff „Brand“ ist das kryptische Zauberwort, das in jedem Marketing-Meeting mindestens fünfmal fällt – und trotzdem versteht kaum jemand, was wirklich dahintersteckt. Ein Brand ist weit mehr als ein hübsches Logo, ein schickes Corporate Design oder ein einprägsamer Slogan. Es ist der unsichtbare, aber messerscharfe Hebel, der entscheidet, ob ein... und können indirekt auf dein Google-Ranking einzahlen. Wer in der Lage ist, die Verbreitung eigener (und fremder) Inhalte über Social Networks exakt zu tracken, kann seine Linkbuilding-Strategien, Outreach-Kampagnen und Content-DistributionContent-Distribution: Der Turbo für Reichweite, Sichtbarkeit und Impact Content-Distribution beschreibt sämtliche Strategien und Maßnahmen, mit denen digitale Inhalte dorthin gebracht werden, wo sie ihre Zielgruppe tatsächlich erreichen. Anders gesagt: Wenn Content das Produkt ist, ist Distribution der Vertrieb – und ohne Vertrieb bleibt sogar der beste Inhalt im SEO-Nirwana stecken. In dieser Glossar-Referenz erfährst du, warum Content-Distribution der oft unterschätzte... gezielt steuern. Die meisten Agenturen verkaufen dir noch “Social Media MonitoringSocial Media Monitoring: Die Echtzeit-Überwachung der digitalen Öffentlichkeit Social Media Monitoring ist der Prozess, soziale Netzwerke und andere digitale Plattformen systematisch zu beobachten, um relevante Erwähnungen, Diskussionen, Trends und Stimmungen rund um Marken, Produkte, Wettbewerber oder Themen zu identifizieren und zu analysieren. Kurz: Wer wissen will, was im Netz über ihn gesprochen wird – und das möglichst in Echtzeit –...” auf Dashboard-Niveau – echte Profis bauen CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer..., die ihnen den entscheidenden Vorsprung liefern.

Die Chancen im Überblick:

- Realtime-Trend-Detection auf Hashtag- und Topic-Ebene

- Monitoring von Wettbewerber-Accounts und Influencern

- Früherkennung von Shitstorms, PR-Krisen und viralen Kampagnen

- Identifikation von Content-Gaps und neuen Themenclustern

- Automatisierte Performance-Analysen für eigene und fremde Posts

- Verknüpfung von Social SignalsSocial Signals: Das unterschätzte Ranking-Signal im SEO-Game Social Signals sind digitale Reaktionen auf Webseiteninhalte in sozialen Netzwerken – also Likes, Shares, Kommentare, Retweets, Upvotes, Pins und alles, was irgendwie nach Aufmerksamkeit riecht. Im Kontext von Suchmaschinenoptimierung (SEO) werden diese Social Signals als Indikatoren für Popularität, Relevanz und Vertrauen einer Website diskutiert. Doch wie stark beeinflussen sie tatsächlich das Ranking? Und... mit SEO-Kampagnen

Risiken, technische Grenzen und rechtliche Grauzonen

Klingt alles zu schön, um wahr zu sein? Willkommen im echten Leben. Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... Crawling ist ein technisches und rechtliches Minenfeld. Jede Plattform hat eigene Nutzungsbedingungen, API-Limits und Anti-Bot-Richtlinien. Wer dagegen verstößt, riskiert nicht nur Account-Sperren, sondern in manchen Fällen auch juristische Konsequenzen – Stichwort “Computerbetrug” oder “Umgehung technischer Schutzmaßnahmen”.

Auch technisch gibt es klare Limits. Die meisten Plattformen drosseln oder blockieren zu aggressive CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... in Sekundenbruchteilen. Moderne Bot-Detection-Systeme erkennen selbst minimale Abweichungen von menschlichem Verhalten. API-basierte CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... stoßen schnell an Rate-Limits; HTML-Scraping wird permanent durch DOM-Änderungen, Captchas und JS-Challenges sabotiert. Wer jetzt denkt, er könne mit ein paar Python-Skripten und Proxy-Listen dauerhaft Daten abziehen, lebt im Jahr 2012.

Ein weiteres Problem: Datenpersistenz und -qualität. Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... Daten ändern sich rasant – ein Post, der morgens viral ist, kann abends schon gelöscht sein. CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... müssen also in Echtzeit agieren, Daten versionieren und Redundanzen vermeiden. Fehlende Datenintegrität, Duplicate Detection und Storage Bottlenecks sind die häufigsten Killer jeder Crawler-Architektur.

Die rechtlichen Risiken im Überblick:

- Verstoß gegen Plattform-AGBs (kann zu Account-Sperren führen)

- Umgehung von technischen Schutzmaßnahmen (rechtlich riskant)

- Sammeln personenbezogener Daten ohne Einwilligung (DSGVO!)

- Haftung bei Datenmissbrauch oder -verlust

Technologien und Tools für Social Media Crawling – Open Source bis Enterprise

Wer jetzt denkt, Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... seien Rocket Science, täuscht sich. Die Basistechnologie ist weitgehend Open Source, die Kunst liegt im Zusammenspiel und in der Skalierbarkeit. Für kleinere Projekte reichen Tools wie Scrapy (Python), Puppeteer (Node.js), Selenium (multilingual) oder Playwright (Microsoft). Sie bieten alles, was du für Fetching, Parsing und Storage brauchst – vorausgesetzt, du weißt, was du tust.

Für größere Setups kommen Frameworks wie Apache Nutch, StormCrawler oder eigene Microservice-Architekturen ins Spiel. Sie ermöglichen verteiltes Crawling, horizontale Skalierung und die Integration von Machine-Learning-Modulen (für Sentiment Analysis, Image Recognition, Trend Prediction). Die Storage-Layer laufen meist auf Elasticsearch, MongoDB oder Cloud-native Stacks wie AWS DynamoDB und Google BigQuery. Für Captcha-Solving gibt es spezialisierte Services wie 2Captcha oder DeathByCaptcha – ein Muss, wenn du im großen Stil unterwegs bist.

Im Enterprise-Segment setzen Marktführer wie Brandwatch, Talkwalker oder Meltwater auf proprietäre, hochskalierbare Crawler-Engines mit eigenem Anti-Detection-Stack, Live-Daten-Anreicherung und Realtime-Alerting. Wer “nur” Social Media MonitoringSocial Media Monitoring: Die Echtzeit-Überwachung der digitalen Öffentlichkeit Social Media Monitoring ist der Prozess, soziale Netzwerke und andere digitale Plattformen systematisch zu beobachten, um relevante Erwähnungen, Diskussionen, Trends und Stimmungen rund um Marken, Produkte, Wettbewerber oder Themen zu identifizieren und zu analysieren. Kurz: Wer wissen will, was im Netz über ihn gesprochen wird – und das möglichst in Echtzeit –... mit Drittanbietern macht, bekommt maximal Dashboard-Infos – keinen echten Data Advantage.

Technische Schritt-für-Schritt-Checkliste für den Crawler-Start:

- Use-Case definieren: Was willst du crawlen? (Posts, Profile, Hashtags, Stories…)

- Plattform-Analyse: API-Access, Rate-Limits, Scraping-Möglichkeiten prüfen

- Entwicklung des Crawling-Logiks: Scheduling, Fetching, Parsing, Storage

- Anti-Detection-Mechanismen integrieren: IP-Rotation, User-Agent-Spoofing, Captcha-Solving

- Monitoring & Logging aufsetzen: Fehler, Blockierungen, Datenqualität überwachen

- Rechtliche Rahmenbedingungen evaluieren: DSGVO, AGBs, Compliance-Checks

SEO und Social Media Crawler: Die unterschätzte Verbindung

Wer Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... clever einsetzt, kann seine SEO-Strategie auf ein neues Level heben. Warum? Weil Social SignalsSocial Signals: Das unterschätzte Ranking-Signal im SEO-Game Social Signals sind digitale Reaktionen auf Webseiteninhalte in sozialen Netzwerken – also Likes, Shares, Kommentare, Retweets, Upvotes, Pins und alles, was irgendwie nach Aufmerksamkeit riecht. Im Kontext von Suchmaschinenoptimierung (SEO) werden diese Social Signals als Indikatoren für Popularität, Relevanz und Vertrauen einer Website diskutiert. Doch wie stark beeinflussen sie tatsächlich das Ranking? Und... zunehmend als Ranking-Faktoren gelten – auch wenn Google das offiziell nur halb zugeben will. Wenn du in Echtzeit siehst, welche Inhalte in deiner Branche viral gehen, kannst du gezielt LinkbuildingLinkbuilding: Die Königsdiziplin der Offpage-Optimierung Linkbuilding ist das gezielte Generieren von Backlinks – also eingehenden Hyperlinks von externen Webseiten – mit dem Ziel, die Autorität, Sichtbarkeit und das Ranking einer Website in Suchmaschinen zu verbessern. Es ist das Herzstück der Offpage-SEO und seit Anbeginn der Suchmaschinen ein entscheidender Rankingfaktor. Wer Linkbuilding unterschätzt, wird im digitalen Haifischbecken gnadenlos abgehängt. Dieser Glossar-Artikel... betreiben, Outreach-Kampagnen planen und deine Content-Strategie datengetrieben justieren.

Ein weiterer Vorteil: Über Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... lassen sich BacklinksBacklinks: Der heilige Gral der Offpage-SEO – Macht, Manipulation und Mythen Backlinks sind das Rückgrat der Offpage-Suchmaschinenoptimierung – und für viele das Synonym für Autorität im Netz. Ein Backlink ist nichts anderes als ein eingehender Link von einer externen Website auf die eigene Seite. Klingt simpel? Ist es nicht. Im Kosmos der SEO sind Backlinks Vertrauensbeweis, Rankingfaktor, Manipulationsobjekt und bis..., Erwähnungen und BrandBrand: Die wahre Macht hinter Marken, Mythen und Marketing Der Begriff „Brand“ ist das kryptische Zauberwort, das in jedem Marketing-Meeting mindestens fünfmal fällt – und trotzdem versteht kaum jemand, was wirklich dahintersteckt. Ein Brand ist weit mehr als ein hübsches Logo, ein schickes Corporate Design oder ein einprägsamer Slogan. Es ist der unsichtbare, aber messerscharfe Hebel, der entscheidet, ob ein... Signals identifizieren, die von klassischen SEO-Tools übersehen werden. Gerade im Bereich Nischen-Influencer, Micro-Communities oder Emerging Topics ist das der entscheidende Visibility-Hebel. Wer Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... mit eigenen Content- und Linkdatenbanken kombiniert, hat eine 360-Grad-Sicht auf die digitale Markenpräsenz – und kann schneller reagieren als die Konkurrenz.

Die wichtigsten SEO-Chancen im Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... Crawling:

- Entdeckung neuer Linkquellen und BrandBrand: Die wahre Macht hinter Marken, Mythen und Marketing Der Begriff „Brand“ ist das kryptische Zauberwort, das in jedem Marketing-Meeting mindestens fünfmal fällt – und trotzdem versteht kaum jemand, was wirklich dahintersteckt. Ein Brand ist weit mehr als ein hübsches Logo, ein schickes Corporate Design oder ein einprägsamer Slogan. Es ist der unsichtbare, aber messerscharfe Hebel, der entscheidet, ob ein... Mentions in Echtzeit

- Frühe Identifikation von Themen, die für organisches Wachstum taugen

- Gezieltes Outreach basierend auf Social EngagementEngagement: Metrik, Mythos und Marketing-Motor – Das definitive 404-Glossar Engagement ist das Zauberwort im Online-Marketing-Dschungel. Gemeint ist damit jede Form der aktiven Interaktion von Nutzern mit digitalen Inhalten – sei es Like, Kommentar, Klick, Teilen oder sogar das genervte Scrollen. Engagement ist nicht nur eine Kennzahl, sondern ein Spiegel für Relevanz, Reichweite und letztlich: Erfolg. Wer glaubt, Reichweite allein bringt...

- Optimierung von Content-Formaten basierend auf Social Performance

- Monitoring von negativen Trends und Reputationsrisiken

Schritt-für-Schritt: So baust du deinen eigenen Social Media Crawler (und wo es knallt)

Du willst selbst einen Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... bauen? Dann viel Spaß – aber sei ehrlich: Die meisten Projekte scheitern an technischen, rechtlichen oder schlichtweg ressourcenbedingten Hürden. Hier ist der brutal ehrliche Ablauf, der dich durch den Crawler-Bau führt – inklusive der Stolpersteine, die sonst niemand erwähnt.

- Zieldefinition: Was willst du wirklich? Nur Monitoring, oder auch Datenanreicherung, KI-Analysen oder gar Automatisierung?

- Plattform-Scouting: Welche Netzwerke willst du crawlen? Jede Plattform hat eigene APIs, HTML-Strukturen und Anti-Bot-Mechanismen.

- APIAPI – Schnittstellen, Macht und Missverständnisse im Web API steht für „Application Programming Interface“, zu Deutsch: Programmierschnittstelle. Eine API ist das unsichtbare Rückgrat moderner Softwareentwicklung und Online-Marketing-Technologien. Sie ermöglicht es verschiedenen Programmen, Systemen oder Diensten, miteinander zu kommunizieren – und zwar kontrolliert, standardisiert und (im Idealfall) sicher. APIs sind das, was das Web zusammenhält, auch wenn kein Nutzer je eine... vs. ScrapingScraping: Daten abgreifen wie die Profis – und warum das Netz davor Angst hat Scraping bezeichnet das automatisierte Extrahieren von Daten aus Webseiten oder digitalen Schnittstellen. Wer glaubt, dass das nur was für Hacker im dunklen Hoodie ist, liegt daneben: Scraping ist eine zentrale Technik im digitalen Zeitalter – für SEOs, Marketer, Analysten, Journalisten und sogar für die Konkurrenzbeobachtung. Aber...: Für viele Plattformen brauchst du API-Keys, die streng limitiert werden. ScrapingScraping: Daten abgreifen wie die Profis – und warum das Netz davor Angst hat Scraping bezeichnet das automatisierte Extrahieren von Daten aus Webseiten oder digitalen Schnittstellen. Wer glaubt, dass das nur was für Hacker im dunklen Hoodie ist, liegt daneben: Scraping ist eine zentrale Technik im digitalen Zeitalter – für SEOs, Marketer, Analysten, Journalisten und sogar für die Konkurrenzbeobachtung. Aber... ist technisch aufwändiger, aber flexibler – und rechtlich oft grenzwertig.

- Fetcher und Parser bauen: Setze auf robuste HTTP-Clients, Headless-Browser und flexible Parser (XPath, CSSCSS (Cascading Style Sheets): Die Sprache des Webdesigns entschlüsselt CSS steht für Cascading Style Sheets und ist die Sprache, mit der das Web schön gemacht wird. Ohne CSS wäre das Internet ein monochromes, typografisches Trauerspiel. CSS trennt die inhaltliche Struktur von HTML sauber von der Präsentation und sorgt für Layout, Farben, Schriftarten, Animationen und sogar komplexe Responsive Designs. Kurz gesagt:... Selectors, JSON-Deserialization).

- Anti-Detection-Logik: Ohne IP-Rotation, User-Agent-Spoofing und Captcha-Lösungen brauchst du gar nicht erst anfangen.

- Storage und Data Pipeline: Baue eine skalierbare Datenarchitektur – NoSQL, Data Lake, Realtime-Queues. Ohne saubere Pipeline explodieren deine Daten nach zwei Wochen.

- Monitoring & Logging: Tracke Fehler, Blockierungen, Response-Zeiten und Datenqualität laufend.

- Legal & Compliance: Prüfe alle rechtlichen Aspekte, bevor du Daten sammelst – sonst wird aus dem Projekt ein Fall für die Rechtsabteilung.

- Iteratives Tuning: CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... müssen laufend angepasst werden. Jede Plattform ändert ihre Strukturen – und du bist immer im Hintertreffen.

Die häufigsten Gründe, warum Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... Crawler-Projekte scheitern:

- Unterschätzung der technischen Komplexität

- Fehlende Ressourcen für Wartung und Updates

- Blockierungen und Blacklisting durch Plattformbetreiber

- Rechtliche Stolpersteine und unklare Zuständigkeiten

- Schlechte Datenqualität und fehlende Skalierbarkeit

Warum Agenturen und Marketer Social Media Crawling nicht beherrschen – und was das für dich bedeutet

Hand aufs Herz: Die meisten Marketing-Agenturen reden viel über Social Media MonitoringSocial Media Monitoring: Die Echtzeit-Überwachung der digitalen Öffentlichkeit Social Media Monitoring ist der Prozess, soziale Netzwerke und andere digitale Plattformen systematisch zu beobachten, um relevante Erwähnungen, Diskussionen, Trends und Stimmungen rund um Marken, Produkte, Wettbewerber oder Themen zu identifizieren und zu analysieren. Kurz: Wer wissen will, was im Netz über ihn gesprochen wird – und das möglichst in Echtzeit –..., aber kaum jemand versteht, wie Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... wirklich funktionieren. Der Grund? Echte Crawler-Architekturen sind teuer, technisch anspruchsvoll und voller rechtlicher Fallstricke. Für Agenturen lohnt sich der Aufwand oft nicht – sie setzen lieber auf Drittanbieter-Dashboards, die zwar hübsche Grafiken liefern, aber keine echten Insights bieten.

Für dich als Marketer oder Entscheider bedeutet das: Wer auf Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... Crawler-Expertise verzichtet, verliert systematisch an Daten, Agilität und Innovationskraft. Die ersten, die Trends erkennen, sind nicht die, die am lautesten posten, sondern die, die am tiefsten crawlen. Alles andere ist MarketingMarketing: Das Spiel mit Bedürfnissen, Aufmerksamkeit und Profit Marketing ist weit mehr als bunte Bilder, Social-Media-Posts und nervige Werbespots. Marketing ist die strategische Kunst, Bedürfnisse zu erkennen, sie gezielt zu wecken – und aus Aufmerksamkeit Profit zu schlagen. Es ist der Motor, der Unternehmen antreibt, Marken formt und Kundenverhalten manipuliert, ob subtil oder mit der Brechstange. Dieser Artikel entlarvt das... von gestern.

Fazit: Wenn du in 2024 und darüber hinaus mit Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... wirklich gewinnen willst, reicht “ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist... Creation” nicht mehr aus. Du brauchst Zugriff auf Datenströme, die nur CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... liefern können. Wer das verschläft, spielt in der Kreisklasse, während die Profis längst im Champions-League-Tempo agieren.

Fazit: Social Media Crawler Strukturen – Wer sie nicht versteht, ist raus

Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... sind das Rückgrat moderner Online-Marketing- und SEO-Strategien. Wer ihre Strukturen, Logiken und Chancen nicht versteht, bleibt Zuschauer im digitalen Wettkampf. Die Zeiten, in denen das Social-Media-Team mit ein bisschen Monitoring und PowerPoint-Reporting punkten konnte, sind vorbei. Heute geht es um Datenzugriff, technische Exzellenz und die Fähigkeit, schneller Trends zu erkennen als alle anderen.

Ob du einen eigenen Social MediaSocial Media: Die digitale Bühne für Marken, Meinungsmacher und Marketing-Magier Social Media bezeichnet digitale Plattformen und Netzwerke, auf denen Nutzer Inhalte teilen, diskutieren und interagieren – in Echtzeit, rund um den Globus. Facebook, Instagram, Twitter (X), LinkedIn, TikTok und YouTube sind die üblichen Verdächtigen, aber das Biest „Social Media“ ist weit mehr als ein paar bunte Apps. Es ist Kommunikationskanal,... CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... baust, externe Tools einsetzt oder dich ganz raushältst – die Spielregeln werden von denen gemacht, die die Technologie beherrschen. Der Rest redet über Reichweite, während die Daten längst an ihnen vorbeirauschen. Willkommen bei 404. Zeit, die Engine zu starten.