SEO Deployment Logs analysieren: Fehler finden und Chancen nutzen

Wenn deine Website im Google-Ranking feststeckt, liegt es meist nicht nur am ContentContent: Das Herzstück jedes Online-Marketings Content ist der zentrale Begriff jeder digitalen Marketingstrategie – und das aus gutem Grund. Ob Text, Bild, Video, Audio oder interaktive Elemente: Unter Content versteht man sämtliche Inhalte, die online publiziert werden, um eine Zielgruppe zu informieren, zu unterhalten, zu überzeugen oder zu binden. Content ist weit mehr als bloßer Füllstoff zwischen Werbebannern; er ist.... Vielmehr sind es die unsichtbaren technischen Fehler in deinen Deployment-Logs, die den Unterschied zwischen SichtbarkeitSichtbarkeit: Die unbarmherzige Währung des digitalen Marketings Wenn es im Online-Marketing eine einzige Währung gibt, die wirklich zählt, dann ist es Sichtbarkeit. Sichtbarkeit – im Fachjargon gern als „Visibility“ bezeichnet – bedeutet schlicht: Wie präsent ist eine Website, ein Unternehmen oder eine Marke im digitalen Raum, insbesondere in Suchmaschinen wie Google? Wer nicht sichtbar ist, existiert nicht. Punkt. In diesem... und Unsichtbarkeit ausmachen. Das richtige Analysieren dieser Logs ist kein Hexenwerk, sondern eine Notwendigkeit, wenn du im SEO-Kampf die Nase vorn haben willst. Und ja, das bedeutet tief in Logfiles eintauchen, Fehler erkennen und Chancen erkennen, bevor sie dein AlgorithmusAlgorithmus: Das unsichtbare Rückgrat der digitalen Welt Algorithmus – das Wort klingt nach Science-Fiction, ist aber längst Alltag. Ohne Algorithmen läuft heute nichts mehr: Sie steuern Suchmaschinen, Social Media, Navigation, Börsenhandel, Werbung, Maschinen und sogar das, was du in deinem Lieblingsshop zu sehen bekommst. Doch was ist ein Algorithmus eigentlich, wie funktioniert er und warum ist er das ultimative Werkzeug... zerbricht.

- Warum die Analyse von Deployment-Logs im SEOSEO (Search Engine Optimization): Das Schlachtfeld der digitalen Sichtbarkeit SEO, kurz für Search Engine Optimization oder Suchmaschinenoptimierung, ist der Schlüsselbegriff für alle, die online überhaupt gefunden werden wollen. Es bezeichnet sämtliche Maßnahmen, mit denen Websites und deren Inhalte so optimiert werden, dass sie in den unbezahlten, organischen Suchergebnissen von Google, Bing und Co. möglichst weit oben erscheinen. SEO ist längst... unverzichtbar ist

- Wichtige Fehlerquellen in Logs identifizieren und beheben

- Tools und Techniken für eine effiziente Logfile-Analyse

- Fehler in Caching, Crawl-Budget und Serverantworten aufspüren

- Chancen durch Log-Analyse: Crawl-Optimierung und IndexierungIndexierung: Wie Webseiten den Weg in die Suchmaschine finden (und warum sie dort bleiben wollen) Autor: Tobias Hager Was bedeutet Indexierung? Definition, Grundlagen und der technische Prozess Indexierung ist im SEO-Kosmos das Eintrittsticket ins Spiel. Ohne Indexierung kein Ranking, keine Sichtbarkeit, kein Traffic – schlicht: keine Relevanz. Kurz gesagt bezeichnet Indexierung den Prozess, durch den Suchmaschinen wie Google, Bing oder... verbessern

- Best Practices für kontinuierliches Monitoring deiner Deployment-Logs

Warum Deployment-Logs im SEO eine unterschätzte Rolle spielen

Viele SEO-Experten konzentrieren sich auf Onpage-OptimierungOnPage-Optimierung: Das Rückgrat effektiver Suchmaschinenoptimierung OnPage-Optimierung bezeichnet sämtliche Maßnahmen, die direkt auf der eigenen Website stattfinden, um die Sichtbarkeit und Relevanz für Suchmaschinen wie Google zu maximieren. Anders ausgedrückt: Wer OnPage-Optimierung vernachlässigt, kann sich gleich selbst ins digitale Abseits stellen. Es geht um mehr als Keyword-Stuffing und hübsche Bilder – OnPage ist die Symbiose aus Technik, Content, Struktur und Nutzererlebnis...., Content-Qualität und BacklinksBacklinks: Der heilige Gral der Offpage-SEO – Macht, Manipulation und Mythen Backlinks sind das Rückgrat der Offpage-Suchmaschinenoptimierung – und für viele das Synonym für Autorität im Netz. Ein Backlink ist nichts anderes als ein eingehender Link von einer externen Website auf die eigene Seite. Klingt simpel? Ist es nicht. Im Kosmos der SEO sind Backlinks Vertrauensbeweis, Rankingfaktor, Manipulationsobjekt und bis... – alles wichtig, aber nur die halbe Miete. Die andere Hälfte bleibt oft unberücksichtigt: die technischen Hinterlassenschaften im Server-Logfile. Diese Logs sind das Tagebuch deines Webservers, das zeigt, wie Google, BingBing: Microsofts Suchmaschine zwischen Außenseiter und Innovationstreiber Bing ist die hauseigene Suchmaschine von Microsoft und gilt als das ewige Nummer-zwei-Kind im Schatten von Google. Doch wer Bing immer noch als Randerscheinung abtut, hat die Entwicklungen der letzten Jahre verschlafen. Bing ist heute mehr als nur eine Suchmaschine – es ist ein komplexes Ökosystem mit eigener Indexierung, KI-Integration, Werbenetzwerk und technischer... und andere CrawlerCrawler: Die unsichtbaren Arbeiter der digitalen Welt Crawler – auch bekannt als Spider, Bot oder Robot – sind automatisierte Programme, die das Fundament des modernen Internets bilden. Sie durchforsten systematisch Webseiten, erfassen Inhalte, analysieren Strukturen und übermitteln diese Daten an Suchmaschinen, Plattformen oder andere zentrale Dienste. Ohne Crawler wäre Google blind, SEO irrelevant und das World Wide Web ein chaotischer... deine Seite tatsächlich sehen und interpretieren. Sie liefern ungeschönte Fakten über Crawling-Verhalten, Fehler, Redirects und Serverantworten.

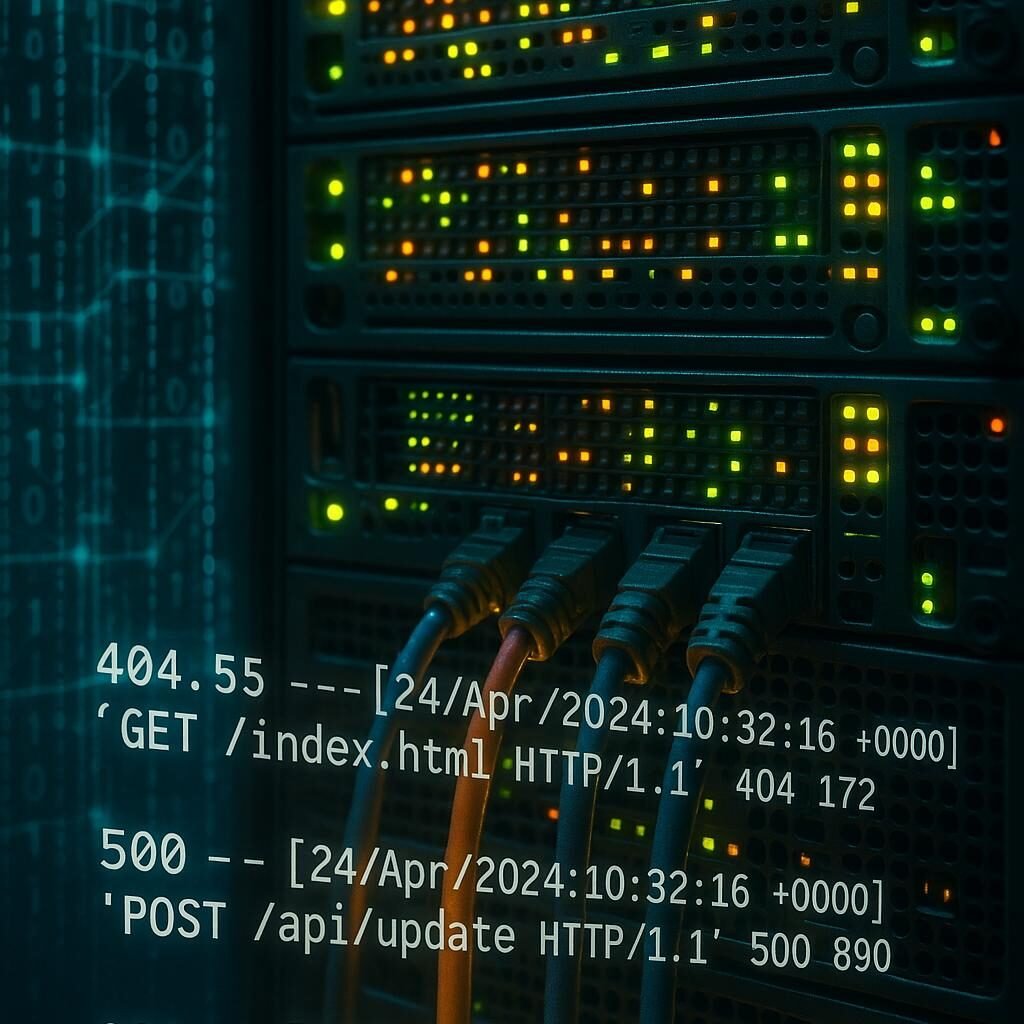

Ohne Logfile-Analyse ist es, als würdest du im Dunkeln tappen. Du siehst nur das Ergebnis, aber nicht die Ursachen. Fehler wie 404-Fehler, 500-Serverprobleme oder fehlerhafte Redirect-Ketten bleiben oft versteckt, weil sie in der normalen Google Search ConsoleGoogle Search Console: Dein Kontrollzentrum für SEO und Website-Performance Die Google Search Console (GSC) ist das offizielle, kostenlose Analyse- und Überwachungstool von Google für Website-Betreiber, SEOs und Online-Marketing-Profis. Sie liefert unverzichtbare Einblicke in Sichtbarkeit, technische Performance, Indexierung und Suchmaschinen-Rankings. Wer seine Website ernsthaft betreibt, kommt an der Google Search Console nicht vorbei – denn ohne Daten bist du im SEO... oder im PageSpeed-Report nicht sichtbar sind. Genau hier liegt der enorme Mehrwert der Logfile-Analyse: Sie zeigt dir die echten Crawling-Pfade, identifiziert Blockaden und offenbart versteckte Fehler, die dein SEO-Perfomance limitieren.

In der Praxis bedeutet das: Wer seine Deployment-Logs regelmäßig analysiert, erkennt frühzeitig, wo Google Schwierigkeiten hat. Es ist eine Art Frühwarnsystem, das dir die Chance gibt, Fehler zu beheben, bevor sie massive Rankingverluste verursachen. Und das Beste: Diese Daten sind oft viel konkreter und tiefgehender als reine Crawl-Reports – vorausgesetzt, du weißt, wie du sie richtig interpretierst.

Wichtige Fehler in Deployment-Logs erkennen und beheben

Beim Blick in deine Logfiles solltest du auf bestimmte Muster und Fehlercodes achten. Hier eine Übersicht der wichtigsten Probleme, die du sofort angehen solltest:

- 404-Fehler: Seiten, die Google crawlt, existieren nicht mehr oder sind falsch verlinkt. Das kostet Crawl-Bapget und verschwendet Ressourcen.

- Redirect-Ketten: Mehrfach-Weiterleitungen, die unnötig lang sind, erhöhen die Ladezeit und lassen Google Ressourcen verschwenden.

- Server-Antwortzeiten: Lange TTFB (Time to First Byte) oder 500-Fehler deuten auf Serverprobleme hin, die das Crawling massiv bremsen.

- Blocked Ressourcen: CSS-, JS- oder Medien-Dateien, die in der robots.txtRobots.txt: Das Bollwerk zwischen Crawlern und deinen Daten Die robots.txt ist das vielleicht meistunterschätzte, aber mächtigste Textfile im Arsenal eines jeden Website-Betreibers – und der Gatekeeper beim Thema Crawling. Sie entscheidet, welche Bereiche deiner Website von Suchmaschinen-Crawlern betreten werden dürfen und welche nicht. Ohne robots.txt bist du digital nackt – und der Googlebot tanzt, wo er will. In diesem Artikel... blockiert sind, verhindern korrektes Rendering und beeinträchtigen die IndexierungIndexierung: Wie Webseiten den Weg in die Suchmaschine finden (und warum sie dort bleiben wollen) Autor: Tobias Hager Was bedeutet Indexierung? Definition, Grundlagen und der technische Prozess Indexierung ist im SEO-Kosmos das Eintrittsticket ins Spiel. Ohne Indexierung kein Ranking, keine Sichtbarkeit, kein Traffic – schlicht: keine Relevanz. Kurz gesagt bezeichnet Indexierung den Prozess, durch den Suchmaschinen wie Google, Bing oder....

- Unnötige Redirects: Redirects, die bei jedem Crawl erneut ausgeführt werden, führen zu unnötigem Overhead und können Crawl-Bfade verursachen.

Der nächste Schritt ist die Behebung dieser Fehler. Das beginnt bei der Korrektur der internen Verlinkung, der Aktualisierung oder Entfernung fehlerhafter URLs und der Optimierung der Server-Response. In manchen Fällen hilft es, die Serverkonfiguration zu überdenken, um TTFB zu reduzieren und eine stabile Crawl-Umgebung zu schaffen. Wichtig ist, diese Fehler nicht nur zu erkennen, sondern auch zu dokumentieren und regelmäßig zu kontrollieren.

Tools und Techniken für eine effiziente Logfile-Analyse

Die Analyse von Server-Logs ist kein Hobby für Laien. Sie erfordert spezialisierte Tools, die tief in die Daten eindringen und klare Erkenntnisse liefern. Hier die wichtigsten Werkzeuge, die du kennen solltest:

- Screaming Frog Log File Analyser: Dieses Tool liest Server-Logs ein, filtert Crawling-Daten und zeigt dir detailliert, welche URLs wie oft gecrawlt wurden, inklusive HTTP-Statuscodes.

- ELK Stack (Elasticsearch, Logstash, Kibana): Für größere Webseiten bietet sich eine eigene Log-Analyse-Infrastruktur an, um Daten zu sammeln, zu visualisieren und automatisiert auszuwerten.

- GoAccess: Ein Open-Source-Tool, das Webserver-Logs in Echtzeit analysiert und übersichtlich aufbereitet.

- Awstats & Webalizer: Klassische Logfile-Viewer, die einfache Berichte liefern – gut für erste Einblicke, aber weniger tiefgehend.

Der Schlüssel zum Erfolg liegt darin, die Daten regelmäßig zu sammeln und auszuwerten. Automatisierte Reports, Dashboards und Alerts helfen dir, potenzielle Probleme sofort zu erkennen. Wichtig ist auch, die Logs in Verbindung mit anderen Datenquellen zu nutzen – etwa der Google Search ConsoleGoogle Search Console: Dein Kontrollzentrum für SEO und Website-Performance Die Google Search Console (GSC) ist das offizielle, kostenlose Analyse- und Überwachungstool von Google für Website-Betreiber, SEOs und Online-Marketing-Profis. Sie liefert unverzichtbare Einblicke in Sichtbarkeit, technische Performance, Indexierung und Suchmaschinen-Rankings. Wer seine Website ernsthaft betreibt, kommt an der Google Search Console nicht vorbei – denn ohne Daten bist du im SEO... oder PageSpeed InsightsPagespeed Insights: Das radikale Tool für Website-Performance und SEO Pagespeed Insights ist das berüchtigte Performance-Analyse-Tool von Google, das Website-Betreiber, Entwickler und Marketing-Profis gleichermaßen zum Schwitzen bringt. Es misst, wie schnell eine Seite lädt, zerlegt jede URL gnadenlos in Einzelteile und liefert konkrete Optimierungsvorschläge – alles hübsch verpackt in farbigen Scores. Doch Pagespeed Insights ist weit mehr als ein nettes Ampelsystem:... – um eine umfassende Sicht auf das SEO-Geschehen zu bekommen.

Fehlerhafte Caching-Strategien und Serverantworten aufspüren

Ein häufig unterschätzter Aspekt in der Logfile-Analyse sind Caching-Probleme. Wenn dein Server oder CDN keine effizienten Cache-Strategien implementieren, belastet du nicht nur die Server, sondern bremst auch das Crawling. Logs zeigen dir, ob Google regelmäßig die gleichen Ressourcen erneut abruft, weil Cache-Control-Header falsch gesetzt sind, oder ob Cache-Invalidierungen zu spät erfolgen.

Ebenso offenbaren Serverantworten wie 503- oder 502-Fehler, dass dein Hosting-Setup nicht stabil genug ist. Diese Fehler führen dazu, dass Googlepages verzögert oder gar nicht indexiert werden. Hier gilt: Schnelle, stabile Serverantworten sind essenziell. Cache-Header richtig setzen, CDN nutzen und Server-Performance optimieren – das sind die Schritte, um die Crawl- und Indexierungsqualität dauerhaft zu sichern.

Chancen durch Logfile-Analyse: Crawl-Optimierung und Indexierung verbessern

Wenn du die Fehlerquellen in deinen Logs erfasst hast, kannst du gezielt Optimierungen vornehmen. Hier einige Chancen, die du durch Log-Analyse nutzen kannst:

- Reduktion des Crawl-Budgets: Entferne unnötige oder doppelte URLs, die Google nur verschlingen, weil sie im Log aufgetaucht sind.

- Priorisierung wichtiger Seiten: Erkenne, welche URLs regelmäßig gecrawlt werden und optimiere sie für eine schnellere IndexierungIndexierung: Wie Webseiten den Weg in die Suchmaschine finden (und warum sie dort bleiben wollen) Autor: Tobias Hager Was bedeutet Indexierung? Definition, Grundlagen und der technische Prozess Indexierung ist im SEO-Kosmos das Eintrittsticket ins Spiel. Ohne Indexierung kein Ranking, keine Sichtbarkeit, kein Traffic – schlicht: keine Relevanz. Kurz gesagt bezeichnet Indexierung den Prozess, durch den Suchmaschinen wie Google, Bing oder....

- Fehlerbehebung bei Serverproblemen: Behebe 5xx-Fehler, lange Antwortzeiten und Blockaden, um Google einen reibungslosen Crawl zu ermöglichen.

- Verbesserung des Crawl-Managements: Nutze die Erkenntnisse, um robots.txtRobots.txt: Das Bollwerk zwischen Crawlern und deinen Daten Die robots.txt ist das vielleicht meistunterschätzte, aber mächtigste Textfile im Arsenal eines jeden Website-Betreibers – und der Gatekeeper beim Thema Crawling. Sie entscheidet, welche Bereiche deiner Website von Suchmaschinen-Crawlern betreten werden dürfen und welche nicht. Ohne robots.txt bist du digital nackt – und der Googlebot tanzt, wo er will. In diesem Artikel... und Meta-Tags gezielt anzupassen, damit nur relevante Seiten gecrawlt werden.

Monitoring und kontinuierliche Optimierung der Deployment-Logs

Die Arbeit endet nie. Ein kontinuierliches Monitoring deiner Deployment-Logs ist der Schlüssel, um langfristig erfolgreich zu sein. Setze auf automatische Log-Analysen, regelmäßige Reports und Alerts, um bei Problemen sofort reagieren zu können. Gerade bei großen Websites, bei häufigen Änderungen oder bei neuen Features ist eine permanente Überwachung unerlässlich.

Mit Tools wie Kibana, Grafana oder spezialisierten Log-Analysetools kannst du Dashboards erstellen, die dir auf einen Blick zeigen, ob alles im grünen Bereich ist. Bei kritischen Fehlern solltest du sofort Maßnahmen ergreifen, um Ranking-Verluste zu vermeiden. Denn in der Welt des SEOSEO (Search Engine Optimization): Das Schlachtfeld der digitalen Sichtbarkeit SEO, kurz für Search Engine Optimization oder Suchmaschinenoptimierung, ist der Schlüsselbegriff für alle, die online überhaupt gefunden werden wollen. Es bezeichnet sämtliche Maßnahmen, mit denen Websites und deren Inhalte so optimiert werden, dass sie in den unbezahlten, organischen Suchergebnissen von Google, Bing und Co. möglichst weit oben erscheinen. SEO ist längst... ist Stillstand gleich Rückschritt.

Fazit: Logfile-Analyse – der geheime Schlüssel zum SEO-Erfolg 2025

Wer heute im SEOSEO (Search Engine Optimization): Das Schlachtfeld der digitalen Sichtbarkeit SEO, kurz für Search Engine Optimization oder Suchmaschinenoptimierung, ist der Schlüsselbegriff für alle, die online überhaupt gefunden werden wollen. Es bezeichnet sämtliche Maßnahmen, mit denen Websites und deren Inhalte so optimiert werden, dass sie in den unbezahlten, organischen Suchergebnissen von Google, Bing und Co. möglichst weit oben erscheinen. SEO ist längst... nicht die Deployment-Logs im Blick hat, spielt digitales Roulette. Die Fehler, die sich in den Server-Logs verstecken, sind der Flaschenhals für Crawling, IndexierungIndexierung: Wie Webseiten den Weg in die Suchmaschine finden (und warum sie dort bleiben wollen) Autor: Tobias Hager Was bedeutet Indexierung? Definition, Grundlagen und der technische Prozess Indexierung ist im SEO-Kosmos das Eintrittsticket ins Spiel. Ohne Indexierung kein Ranking, keine Sichtbarkeit, kein Traffic – schlicht: keine Relevanz. Kurz gesagt bezeichnet Indexierung den Prozess, durch den Suchmaschinen wie Google, Bing oder... und letztlich Rankings. Mit den richtigen Tools, einer disziplinierten Analyse und kontinuierlichem Monitoring kannst du Fehlerquellen eliminieren, Crawl-Bfade minimieren und deine Chancen auf Top-Platzierungen deutlich erhöhen.

Das technische Verständnis deiner Deployment-Logs ist keine Option mehr, sondern die Grundvoraussetzung für nachhaltigen Erfolg im digitalen Wettbewerb. Wer diese Daten ignoriert, lässt wertvolle Chancen ungenutzt – und riskiert, von der nächsten Algorithmus-Änderung überholt zu werden. Es ist Zeit, den Blick hinter die Kulissen zu richten und aus Fehlern Chancen zu machen. Nur so bleibst du in der digitalen Liga ganz oben.