Eventstream Struktur: Aufbau, Nutzen und Praxistipps

In der heutigen Welt der Echtzeitdaten und hochkomplexen Webanwendungen ist die Eventstream-Struktur kein nettes Add-on mehr, sondern der Puls moderner Architekturen. Wer sich noch auf klassische Request-Response-Modelle verlässt, wird bald im Daten-Nirwana landen. Die Frage ist: Wie baut man eine robuste, skalierbare und performante Eventstream-Architektur auf, die den Anforderungen von 2025 gewachsen ist? Spoiler: Es ist tief, es ist technisch, und es wird vor allem eins – disruptiv.

- Was eine Eventstream Struktur eigentlich ist – und warum sie das Rückgrat moderner Systeme bildet

- Die wichtigsten Komponenten und Technologien hinter einer Eventstream Architektur

- Vorteile einer gut durchdachten Eventstream Struktur für Skalierbarkeit und Resilienz

- Praktische Tipps für den Aufbau, die Implementierung und das Monitoring

- Häufige Fehler und Fallstricke – und wie du sie vermeidest

- Best Practices und Zukunftstrends in der Eventstream-Technologie

Was eine Eventstream Struktur wirklich ist – und warum sie das Herz moderner Anwendungen ist

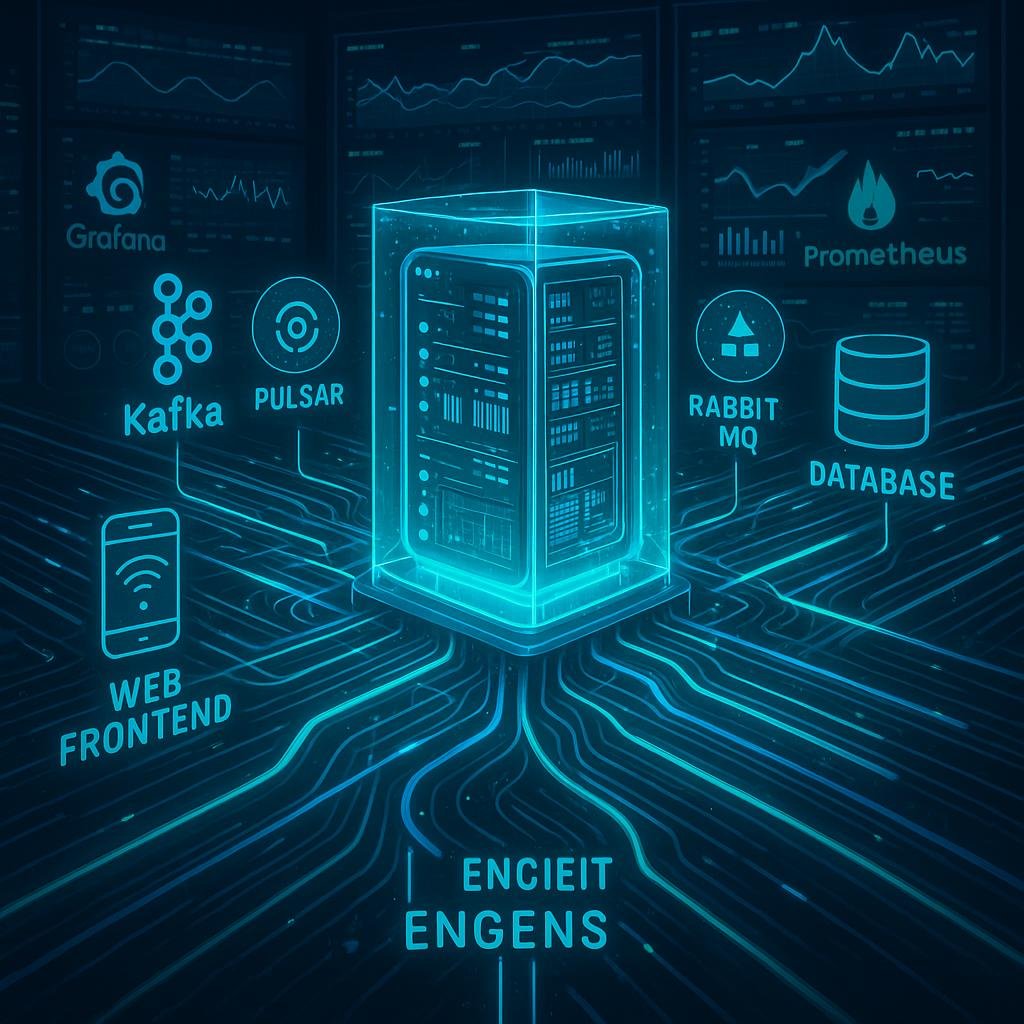

Eine Eventstream Struktur beschreibt die Art und Weise, wie Datenereignisse in Echtzeit verarbeitet, verteilt und gespeichert werden. Im Kern handelt es sich um eine Architektur, die auf asynchronen, unidirektionalen Datenströmen basiert – oft umgesetzt mit Message-Brokern wie Kafka, Pulsar oder RabbitMQ. Diese Systeme sind nicht nur Transportmittel, sondern auch Speicher- und Verarbeitungseinheiten, die es ermöglichen, Datenströme kontinuierlich zu konsumieren und in Echtzeit Aktionen auszulösen.

Was diese Architektur so mächtig macht, ist die Fähigkeit, große Mengen an Ereignissen nahezu verzögerungsfrei zu verarbeiten. Statt auf traditionelle Batch-Verarbeitung zu setzen, ermöglicht die Eventstream Struktur eine latenzarme Datenpipeline, die auch bei massivem TrafficTraffic: Die wahre Währung des digitalen Marketings Traffic – der Begriff klingt harmlos, fast banal. Tatsächlich ist Traffic das Lebenselixier jeder Website, der Pulsschlag des Online-Marketings und der ultimative Gradmesser für digitale Sichtbarkeit. Ohne Traffic bleibt jede noch so geniale Seite ein Geisterschiff im Ozean des Internets. Dieser Glossar-Artikel zerlegt das Thema Traffic in seine Einzelteile, von Definition bis Technologie,... stabil bleibt. Sie ist das Rückgrat für Microservices, Event-Driven Architecture (EDA) und serverlose Anwendungen, die heute in der Cloud fast schon Standard sind.

Die grundlegende Idee: Ereignisse werden von Produzenten (z.B. IoT-Geräte, Web-Frontends, Datenbanken) erzeugt und in den Eventstream eingespeist. Konsumenten (z.B. Analyse-Services, Benachrichtigungs-Apps, Machine Learning-Modelle) lesen diese Daten asynchron, filtern, transformieren oder speichern sie. Das Ergebnis: eine flexible, skalierbare und resilient Datenarchitektur, die auf Änderungen dynamisch reagiert und kaum stillsteht.

Technologien und Komponenten einer effizienten Eventstream Architektur

Der Grundpfeiler einer Eventstream Struktur sind die Messaging-Systeme. Kafka ist hier unbestritten der Branchenführer, doch Pulsar, RabbitMQ und Kinesis holen auf. Sie bieten unterschiedliche Modelle – von Partitioned Topics bis hin zu komplexen Streaming-APIs – und sind je nach Anwendungsfall die perfekte Wahl. Wichtig ist, die Unterschiede in Bezug auf Konsistenz, Latenz und Skalierbarkeit zu kennen.

Ein weiterer zentraler Baustein ist die Event-Serialisierung. Hier kommen Formate wie Avro, Protobuf oder JSON zum Einsatz. Sie sorgen dafür, dass Daten effizient, kompakt und plattformübergreifend übertragen werden können. Besonders bei großen Datenmengen ist die Wahl des richtigen Serialisierungsformats entscheidend für Performance und Speicherverbrauch.

Für die Verarbeitung großer Datenströme sind Stream-Processing-Engines wie Kafka Streams, Flink oder Spark Structured Streaming unverzichtbar. Sie erlauben die Echtzeit-Transformation, Aggregation und Analyse der Ereignisse. Sie sind die Logik-Engine, die deine Datenpipeline intelligent macht – von einfachen Filter- und Mapping-Operationen bis hin zu komplexen Machine-Learning-Workloads.

Monitoring und Management-Tools wie Confluent Control Center, Prometheus oder Grafana sind ebenso essenziell. Sie liefern Einblicke in die Performance, Latenzzeiten und Fehlerquoten deiner Eventstream-Infrastruktur. Nur wer seine Datenströme im Griff hat, kann bei Problemen schnell reagieren und Ausfallzeiten minimieren.

Vorteile der Eventstream Struktur: Skalierbarkeit, Resilienz und Flexibilität

Der größte Vorteil: Skalierbarkeit. Moderne Eventstream-Architekturen lassen sich horizontal auf Tausende von Knoten skalieren, ohne dass die Performance leidet. Partitionierte Topics in Kafka erlauben es, Daten auf mehrere Broker zu verteilen – und so den Durchsatz fast beliebig zu erhöhen. Das bedeutet: Du kannst bei Traffic-Explosionen nahezu unbegrenzt wachsen, ohne dass die Daten verloren gehen.

Resilienz ist eine weitere Kernkompetenz. Durch Replikation, Partitionierung und Fehlertoleranzmechanismen sind deine Daten gegen Hardware-Ausfälle oder Netzwerkprobleme geschützt. Falls ein Broker ausfällt, übernehmen andere Knoten nahtlos. Zudem erlauben Event-Backpressure-Algorithmen, dass die Systemlast geregelt wird, ohne das Gesamtsystem zum Erliegen zu bringen.

Flexibilität entsteht durch die asynchrone Natur der Eventstream Architektur. Neue Konsumenten können jederzeit an den Datenstrom angedockt werden, ohne den Betrieb zu stören. Das ermöglicht eine schnelle Integration neuer Dienste, Analysen oder KI-Modelle. Zudem unterstützt die Struktur eine einfache Event-Historisierung, Replay-Fähigkeiten und Versionierung – für Debugging, Auditing oder Recovery.

Praxistipps für den Aufbau, die Implementierung und das Monitoring

Der Aufbau einer robusten Eventstream Struktur beginnt mit einer klaren Architekturplanung. Definiere, welche Events du erfassen willst, welche Datenquellen involviert sind und welche Konsumenten Zugriff benötigen. Eine saubere Modellierung der Topics und Partitionen ist der erste Schritt zu einer skalierbaren Lösung.

Implementiere eine konsistente Serialisierung und Deserialisierung. Nutze Schema-Registrierungssysteme wie Confluent Schema Registry, um Kompatibilität bei Änderungen sicherzustellen. Das verhindert, dass alte Producer- oder Consumer-Instanzen die Daten nicht mehr verarbeiten können.

Setze auf Automatisierung beim Deployment und bei der Skalierung. Nutze Infrastructure-as-Code-Tools wie Terraform, Kubernetes oder Helm, um deine Infrastruktur reproduzierbar zu machen. Für die Überwachung sind Dashboards, Alerts und Log-Analysen Pflicht. So erkennst du Engpässe oder Fehler frühzeitig.

Ein wichtiger Punkt: Teste deine Datenpipeline regelmäßig. Schreibe Unit-Tests für Stream-Processing-Logik, führe Integrationstests durch und simuliere Ausfall-Szenarien. Nur so stellst du sicher, dass deine Architektur auch bei hoher Belastung stabil bleibt.

Häufige Fehler in Eventstream Strukturen – und ihre Vermeidung

Viele scheitern an unzureichender Planung. Eine unübersichtliche Topic-Struktur, fehlende Schema-Management oder ungenaue Partitionierung führen schnell zu Performance-Engpässen. Ebenso ist die Vernachlässigung von Monitoring und Alerting ein häufiger Fehler, der im Krisenfall teuer wird.

Ein weiterer Klassiker: Zu große oder zu kleine Nachrichten. Große Events belasten das Netzwerk, zu kleine sind ineffizient für den Durchsatz. Die richtige Message-Größe ist entscheidend. Ebenso problematisch sind unzureichende Replikationsfaktoren und mangelnde Backups – bei Datenverlust ist dann alles verloren.

Nicht zuletzt führt fehlende Sicherheitskonfiguration zu Angriffen oder Datenlecks. Verschlüsselung, Zugriffskontrollen und Auditing sind Pflicht. Ignorierst du diese Punkte, riskierst du nicht nur Performance-Probleme, sondern auch deine Compliance.

Zukunftstrends: Wohin entwickelt sich die Eventstream Technologie?

Die Zukunft gehört der hybriden Multi-Cloud-Architektur, bei der Eventstream Systeme nahtlos über verschiedene Anbieter hinweg synchronisiert werden. Edge Computing wird eine größere Rolle spielen, um Daten noch näher an der Quelle zu verarbeiten – mit minimaler Latenz und maximaler Skalierbarkeit.

KI-gestützte Automatisierung und Self-Healing-Systeme werden zur Norm. Sie erkennen Anomalien in den Datenströmen, passen die Infrastruktur automatisch an und minimieren Ausfallzeiten. Zudem wird die Integration von Eventstream-Architekturen in serverlose Umgebungen zunehmen, um Ressourcen effizienter zu nutzen.

Schließlich gewinnt die Standardisierung an Bedeutung. Neue Protokolle und Formate sollen die Interoperabilität verbessern, um die Komplexität zu reduzieren. Wer heute schon auf die richtige Technologie setzt, wird morgen den Unterschied zwischen Mittelmaß und Innovation ausmachen.

Fazit: Warum eine durchdachte Eventstream Struktur die Basis für die Zukunft ist

Wer in der digitalen Ära wettbewerbsfähig bleiben will, kommt an Eventstream Architekturen nicht vorbei. Sie sind das Rückgrat für skalierbare, resiliente und flexible Anwendungen, die in Echtzeit auf Veränderungen reagieren. Der Aufbau ist technisch anspruchsvoll, aber mit der richtigen Planung, den passenden Tools und konsequenter Überwachung erreichst du eine Infrastruktur, die auch zukünftige Anforderungen meistert.

Nicht nur technologische Trends, sondern auch Geschäftsmodelle entwickeln sich in Richtung Event-Driven Architecture. Wer heute in eine stabile, sichere und zukunftsfähige Eventstream Struktur investiert, schafft die Basis für Innovationen, die morgen den Unterschied machen. Ignorieren ist keine Option, wenn du im digitalen Rennen vorne bleiben willst.